AnimateDiff

Descripción general de AnimateDiff

¿Qué es AnimateDiff?

AnimateDiff es una herramienta innovadora de IA que transforma imágenes estáticas o indicaciones de texto en videos animados dinámicos al generar secuencias suaves de fotogramas. Construida sobre la base de Stable Diffusion, integra módulos de movimiento especializados para predecir y aplicar movimientos realistas, convirtiéndola en un punto de inflexión para la creación de videos impulsada por IA. Ya seas un artista esbozando ideas o un desarrollador prototipando visuales, AnimateDiff agiliza el proceso de convertir conceptos en animaciones atractivas sin necesidad de trabajo manual fotograma por fotograma. Este marco de código abierto, disponible a través de extensiones como las de AUTOMATIC1111's WebUI, permite a los usuarios aprovechar modelos de difusión para la generación de texto a video e imagen a video, abriendo puertas a la creación de contenido eficiente en campos como el arte, los juegos y la educación.

¿Cómo funciona AnimateDiff?

En su núcleo, AnimateDiff combina modelos de difusión preentrenados de texto a imagen o imagen a imagen, como Stable Diffusion, con un módulo de movimiento dedicado. Este módulo se entrena en clips de video del mundo real diversos para capturar patrones de movimiento comunes, dinámicas y transiciones, asegurando que las animaciones se sientan naturales y realistas.

Proceso de Texto a Video

- Indicación de Entrada: Comienza con una indicación de texto descriptiva que delinee la escena, personajes, acciones o conceptos—por ejemplo, "un bosque sereno con luciérnagas danzantes al atardecer".

- Generación del Modelo Base: La columna vertebral de Stable Diffusion genera fotogramas clave iniciales basados en la indicación, enfocándose en el contenido visual.

- Integración de Movimiento: El módulo de movimiento analiza la indicación y los fotogramas anteriores para predecir dinámicas, interpolando fotogramas intermedios para transiciones fluidas.

- Renderizado de Salida: El sistema coordinado produce un clip de video corto o GIF, típicamente 16-24 fotogramas a 8-16 FPS, mostrando elementos animados en movimiento.

Proceso de Imagen a Video

Para animar visuales existentes:

- Subir Imagen: Proporciona una foto estática, obra de arte o imagen generada por IA.

- Generación de Variaciones: Usa el img2img de Stable Diffusion para crear variaciones sutiles de fotogramas clave.

- Aplicación de Movimiento: El módulo de movimiento agrega dinámicas inferidas, animando elementos como objetos o fondos.

- Video Final: Resulta en un clip vibrante donde la imagen original cobra vida, ideal para dar vida al arte digital o fotos personales.

Este enfoque plug-and-play significa que no se requiere un reentrenamiento extenso—simplemente integra los módulos de movimiento en tu configuración de Stable Diffusion. Los usuarios pueden ajustar las salidas con opciones avanzadas como Motion LoRA para efectos de cámara (paneo, zoom) o ControlNet para movimientos guiados de videos de referencia, mejorando la controlabilidad y la creatividad.

Características Clave de AnimateDiff

- Integración Plug-and-Play: Funciona sin problemas con modelos de Stable Diffusion v1.5 a través de extensiones, sin necesidad de una configuración pesada para uso básico.

- Modos de Generación Versátiles: Soporta texto a video, imagen a video, animaciones en bucle e incluso edición de video a video con guía de texto.

- Opciones de Personalización: Combina con DreamBooth o LoRA para animar sujetos personalizados entrenados en tus conjuntos de datos.

- Controles Avanzados: Ajusta FPS, conteo de fotogramas, tamaño de lote de contexto para movimientos más suaves; habilita bucles cerrados para ciclos sin interrupciones o fotogramas inversos para fluidez extendida.

- Eficiencia: Genera clips cortos rápidamente en hardware capaz, más rápido que construir modelos de video monolíticos desde cero.

Estas características hacen de AnimateDiff una herramienta flexible para prototipado rápido, reduciendo el tiempo desde la idea hasta la salida animada.

Cómo Usar AnimateDiff

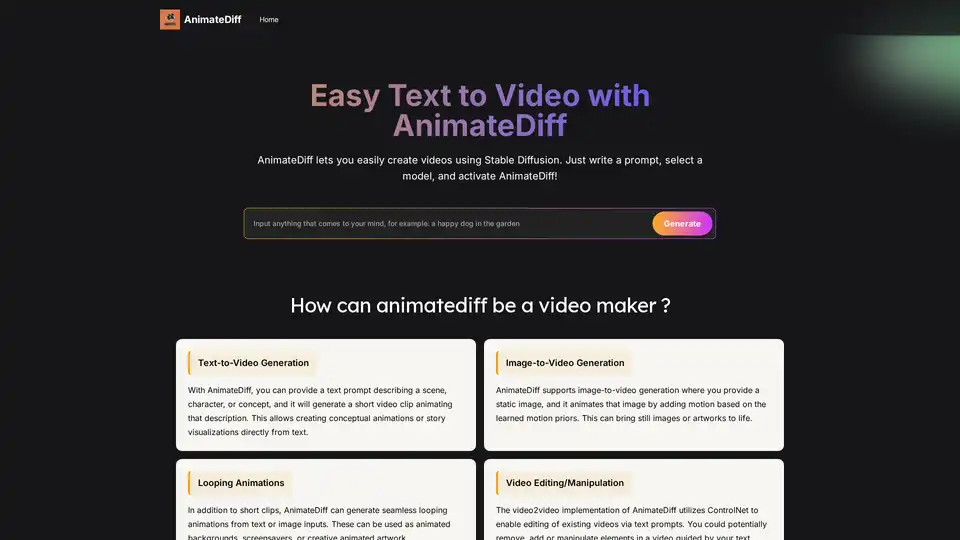

Comenzar es sencillo, especialmente con la versión gratuita en línea en animatediff.org, que no requiere instalación.

Uso en Línea (Sin Configuración Requerida)

- Visita animatediff.org.

- Ingresa tu indicación de texto (por ejemplo, "un gato saltando sobre un arcoíris").

- Selecciona un modelo y estilo de movimiento si está disponible.

- Presiona generar—la IA lo procesa en el lado del servidor y entrega un GIF o video descargable.

- Ideal para principiantes o pruebas rápidas, completamente en línea sin recursos locales.

Instalación Local para Usuarios Avanzados

Para desbloquear el potencial completo:

- Instala el WebUI de Stable Diffusion de AUTOMATIC1111.

- Ve a Extensiones > Instalar desde URL, pega: https://github.com/continue-revolution/sd-webui-animatediff.

- Descarga módulos de movimiento (por ejemplo, mm_sd_v15_v2.ckpt) y colócalos en la carpeta extensions/animatediff/model.

- Reinicia WebUI; AnimateDiff aparece en las pestañas txt2img/img2img.

- Ingresa la indicación, habilita AnimateDiff, establece fotogramas/FPS y genera.

Para usuarios de Google Colab, hay cuadernos disponibles para ejecuciones basadas en la nube. No se necesita experiencia en codificación más allá de la configuración básica—los tutoriales guían a través de dependencias como Python y Nvidia CUDA.

Requisitos del Sistema

- GPU: Nvidia con 8GB+ VRAM (10GB+ para video a video); se recomienda RTX 3060 o mejor.

- SO: Windows/Linux principal; macOS vía Docker.

- RAM/Almacenamiento: 16GB RAM, 1TB almacenamiento para modelos y salidas.

- Compatibilidad: Solo Stable Diffusion v1.5; verifica actualizaciones en GitHub.

Con estos, los tiempos de generación caen a minutos por clip, escalando con el poder del hardware.

Casos de Uso Potenciales y Aplicaciones

AnimateDiff brilla en escenarios que demandan animaciones rápidas asistidas por IA, alineándose con intenciones de búsqueda para narración visual eficiente.

Arte y Animación

Los artistas pueden prototipar bocetos o storyboards desde texto, ahorrando horas en dibujo manual. Por instancia, visualiza el ciclo de caminata de un personaje instantáneamente, iterando más rápido en flujos de trabajo creativos.

Desarrollo de Juegos

Genera rápidamente animaciones de activos para prototipos—por ejemplo, movimientos de enemigos o transiciones de UI—acelerando la preproducción sin equipos completos de animación.

Educación y Visualización

Convierte conceptos abstractos en videos atractivos, como animar eventos históricos o procesos científicos, haciendo el aprendizaje interactivo y memorable.

Redes Sociales y Marketing

Crea publicaciones o anuncios llamativos: describe una revelación de producto y obtén una animación en bucle lista para Instagram o TikTok, impulsando el engagement con esfuerzo mínimo.

Gráficos de Movimiento y Previsualización

Produce intros dinámicos para videos o previsualiza escenas complejas antes de renders/costosos films, ideal para cineastas o desarrolladores de AR/VR.

En realidad aumentada, anima personajes con movimientos naturales; en publicidad, crea clips promocionales personalizados a partir de imágenes de marca.

¿Por Qué Elegir AnimateDiff?

Comparado con herramientas tradicionales como Adobe After Effects, AnimateDiff automatiza el trabajo pesado, haciendo animaciones de alta calidad accesibles sin habilidades pro. Su dependencia de priors de movimiento aprendidos de videos reales asegura realismo, mientras que la controlabilidad vía indicaciones aborda puntos de dolor comunes en la generación de IA. Gratuito y de código abierto, es rentable para aficionados y profesionales por igual, con actualizaciones impulsadas por la comunidad vía GitHub. Aunque no es perfecto para complejidad a nivel de Hollywood, es imbatible para ideación y contenido de corto formato, fomentando la innovación en herramientas de video de IA.

Para usuarios buscando 'mejor IA de texto a video' o 'animar imágenes con Stable Diffusion', AnimateDiff entrega resultados confiables, respaldados por su herencia de modelo de difusión y experiencia en movimiento.

¿Para Quién es AnimateDiff?

- Profesionales Creativos: Artistas, animadores y diseñadores que necesitan visualizaciones rápidas.

- Desarrolladores y Gamers: Para prototipar elementos interactivos.

- Educadores/Creadores de Contenido: Construyendo medios explicativos o entretenidos.

- Marketers/Influencers Sociales: Activos animados rápidos y personalizables.

- Aficionados: Cualquiera curioso sobre animación de IA sin barreras técnicas profundas.

Es particularmente adecuado para aquellos familiarizados con Stable Diffusion, pero la demo en línea baja el punto de entrada.

Limitaciones y Consejos para Mejores Resultados

Aunque poderoso, AnimateDiff tiene restricciones:

- Alcance de Movimiento: Mejor para movimientos simples alineados con datos de entrenamiento; acciones complejas pueden necesitar ajuste.

- Artefactos: Movimientos más altos pueden introducir fallos—comienza con conteos de fotogramas bajos.

- Longitud/Coherencia: Excelente en clips cortos (menos de 50 fotogramas); videos largos arriesgan inconsistencia.

- Límites del Modelo: Solo SD v1.5; vigila compatibilidad v2.

Consejos: Usa indicaciones detalladas con descriptores de acción (por ejemplo, "cámara rotando lentamente"), experimenta con LoRAs para estilos y post-procesa en herramientas como Premiere para pulido. A medida que la tecnología de difusión evoluciona, la comunidad de AnimateDiff continúa refinando estos, prometiendo salidas aún más suaves.

En resumen, AnimateDiff revoluciona cómo creamos animaciones, combinando la destreza en imágenes de Stable Diffusion con predicción inteligente de movimiento. Para cualquiera explorando generación de video de IA, es una herramienta imprescindible que convierte la imaginación en movimiento sin esfuerzo.

Etiquetas Relacionadas con AnimateDiff