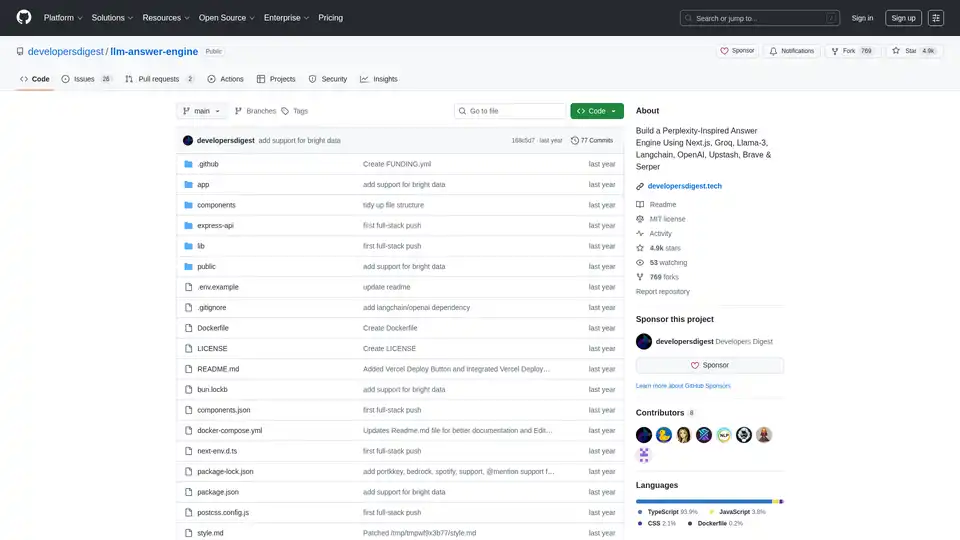

llm-answer-engine

Vue d'ensemble de llm-answer-engine

Moteur de réponse LLM : construisez votre propre système de questions-réponses alimenté par l'IA

Ce projet open source, llm-answer-engine, fournit le code et les instructions pour construire un moteur de réponse d'IA sophistiqué inspiré de Perplexity. Il exploite des technologies de pointe telles que Groq, Mixtral de Mistral AI, Langchain.JS, Brave Search, Serper API et OpenAI pour fournir des réponses complètes aux requêtes des utilisateurs, avec des sources, des images, des vidéos et des questions de suivi.

Qu'est-ce que llm-answer-engine ?

llm-answer-engine est un point de départ pour les développeurs intéressés par l'exploration du traitement du langage naturel et des technologies de recherche. Il vous permet de créer un système qui répond efficacement aux questions en :

- Récupérant des informations pertinentes provenant de diverses sources.

- Générant des réponses concises et informatives.

- Fournissant des preuves à l'appui et des médias connexes.

- Suggérant des questions de suivi pour guider l'exploration plus approfondie.

Comment fonctionne llm-answer-engine ?

Le moteur utilise une combinaison de technologies pour traiter les requêtes des utilisateurs et générer des réponses pertinentes :

- Compréhension des requêtes: Des technologies telles que Groq et Mixtral sont utilisées pour traiter et comprendre la question de l'utilisateur.

- Récupération d'informations:

- Brave Search: Un moteur de recherche axé sur la confidentialité est utilisé pour trouver du contenu et des images pertinents.

- Serper API: Utilisée pour récupérer des résultats vidéo et image pertinents en fonction de la requête de l'utilisateur.

- Cheerio: Utilisée pour l'analyse HTML, permettant l'extraction de contenu à partir de pages web.

- Traitement du texte:

- Langchain.JS: Une bibliothèque JavaScript axée sur les opérations de texte, telles que la division de texte et les intégrations.

- OpenAI Embeddings: Utilisée pour créer des représentations vectorielles de morceaux de texte.

- Composants optionnels:

- Ollama: Utilisée pour l'inférence et les intégrations en streaming.

- Upstash Redis Rate Limiting: Utilisée pour configurer la limitation de débit pour l'application.

- Upstash Semantic Cache: Utilisée pour la mise en cache des données afin d'accélérer les temps de réponse.

Principales caractéristiques et technologies:

- Next.js: Un framework React pour la création d'applications web statiques et rendues côté serveur, fournissant une base solide pour l'interface utilisateur.

- Tailwind CSS: Un framework CSS utilitaire pour la création rapide d'interfaces utilisateur personnalisées, permettant un style et une personnalisation efficaces.

- Vercel AI SDK: Une bibliothèque pour la création d'interfaces utilisateur de texte et de chat en streaming alimentées par l'IA, améliorant l'expérience utilisateur avec un retour d'information en temps réel.

- Prise en charge des appels de fonction (Beta): Étend les fonctionnalités avec des intégrations pour les cartes et les lieux (Serper Locations API), le shopping (Serper Shopping API), les données boursières de TradingView et Spotify.

- Prise en charge d'Ollama (partiellement prise en charge): Offre une compatibilité avec Ollama pour le streaming de réponses textuelles et d'intégrations, permettant l'exécution de modèles locaux.

Comment utiliser llm-answer-engine ?

Pour commencer avec llm-answer-engine, suivez ces étapes :

- Prérequis:

- Obtenez les clés API d'OpenAI, Groq, Brave Search et Serper.

- Assurez-vous que Node.js et npm (ou bun) sont installés.

- (Facultatif) Installez Docker et Docker Compose pour le déploiement en conteneur.

- Installation:

git clone https://github.com/developersdigest/llm-answer-engine.git

cd llm-answer-engine

3. **Configuration**: * **Docker**: Modifiez le fichier `docker-compose.yml` et ajoutez vos clés API. * **Non-Docker**: Créez un fichier `.env` à la racine de votre projet et ajoutez vos clés API. 4. **Exécutez le serveur**: * **Docker**:bash

docker compose up -d

* **Non-Docker**:bash

npm install # or bun install

npm run dev # or bun run dev

```

Le serveur sera à l'écoute sur le port spécifié.

Pourquoi choisir llm-answer-engine ?

- Inspiré par Perplexity: Offre une expérience utilisateur similaire à celle d'un moteur de réponse d'IA de premier plan.

- Exploite des technologies puissantes: Combine le meilleur des technologies NLP, de recherche et de développement web.

- Open source et personnalisable: Vous permet d'adapter le moteur à vos besoins spécifiques.

- Prise en charge des appels de fonction: Étend les fonctionnalités avec des intégrations pour les cartes et les lieux, le shopping, les données boursières de TradingView et Spotify.

À qui s'adresse llm-answer-engine ?

Ce projet est idéal pour :

- Les développeurs intéressés par le traitement du langage naturel et les technologies de recherche.

- Les chercheurs qui explorent les systèmes de questions-réponses.

- Toute personne souhaitant construire sa propre base de connaissances alimentée par l'IA.

Feuille de route:

La feuille de route du projet comprend des fonctionnalités intéressantes telles que :

- Téléchargement de documents + RAG pour la recherche/récupération de documents.

- Un composant de paramètres pour permettre aux utilisateurs de sélectionner le modèle, le modèle d'intégrations et d'autres paramètres à partir de l'interface utilisateur.

- Ajout de la prise en charge des questions de suivi lors de l'utilisation d'Ollama

Contribution:

Les contributions sont les bienvenues ! Fourchez le dépôt, effectuez vos modifications et soumettez une demande de tirage.

Ce projet est sous licence MIT.

Construisez votre propre moteur de réponse alimenté par l'IA et explorez les possibilités du traitement du langage naturel avec llm-answer-engine !

Tags Liés à llm-answer-engine