主要AIエージェントフレームワーク徹底比較・選定ガイド (LangChain vs. LangGraph vs. CrewAI vs. AutoGen vs. Semantic Kernel, 2026年版)

大規模言語モデル(LLM)の能力が絶え間なく向上するにつれて、AIエージェントは概念実証(PoC)の段階から、産業レベルの実装へと移行しつつあります。2023年から2024年の間に、オープンソースのAIエージェントフレームワークの数は数倍に増加し、現在ではGitHub上に20,000を超える「AIエージェント」関連のリポジトリが存在します。開発者、テクニカルリード、起業家にとって、LangChain、AutoGen、CrewAIといったソリューションの中から最適な選択をすることは、AIアプリケーション構築における主要な意思決定となっています。最も成熟したエコシステムを優先すべきか、それともより明確で制御しやすいアーキテクチャを優先すべきか?迅速なプロトタイプ作成を目指すのか、それとも長期的なエンジニアリングの安定性と企業のスケーラビリティを求めるのか?

本記事は、この意思決定のための「明確で実践的な選定ロードマップ」を提供することを目指します。 2025年12月時点の公開データとコミュニティの動向に基づき、5つの主要AIエージェントフレームワークについて、コア設計パラダイム、エンジニアリングの複雑性、エコシステムの成熟度、実際のプロジェクトからのフィードバック、およびパフォーマンスとコストのトレードオフといった複数の側面から体系的な横断比較を行います。本ガイドは単なる機能リストにとどまらず、具体的なビジネスシナリオ、チーム規模、技術的背景を組み合わせ、フレームワーク選定のための反復可能な方法論を導き出します。

本記事の内容は、コンテンツ自動化システム、NavGood AIツールナビゲーションサイト、社内プロセスエージェントといったプロジェクトにおける当チームの実践経験に基づいています。2026年のAIエージェント導入加速期という重要な時期に、概念、エンジニアリング、ビジネスニーズの間のギャップを埋め、適切なAIエージェント製品またはフレームワークを見つけるお手伝いをすることを目指しています。

推奨読者:

- 技術愛好家および入門レベルの学習者

- 企業の意思決定者およびビジネスリーダー

- AIの将来のトレンドに関心のある一般ユーザー

目次:

- Part 1: AIエージェントフレームワークの全体像

- Part 2: 主要5大フレームワークの徹底比較

- Part 3: 各フレームワークの詳細分析

- Part 4: 実践的な選定ガイド

- Part 5: パフォーマンスとコストの考慮事項

- Part 6: 将来のトレンド (2025年〜2026年)

- 結論:「最良」のフレームワークはなく、「最適」な選択があるのみ

- よくある質問(FAQ)

- リソース

Part 1: AIエージェントフレームワークの全体像

AIエージェントフレームワークとは?

AIエージェントフレームワークとは、自律性、計画性、ツール利用、記憶能力を備えたLLMベースのインテリジェントエージェントを構築するプロセスを簡素化するために設計されたツールとライブラリの集合体です。その核となる価値は、Chain-of-Thought(思考の連鎖)プランニング、短期/長期記憶管理、ツール呼び出しのオーケストレーション、マルチエージェントコラボレーションなど、エージェントに求められる普遍的な能力を再利用可能なモジュールとして抽象化することにあります。これにより、開発者は複雑な状態や制御フローをゼロから構築するのではなく、ビジネスロジックに集中できるようになります。

AIエージェントフレームワーク進化の3段階

- 初期実験段階(2022年〜2023年初頭): LangChainやBabyAGIに代表されます。概念実証が特徴で、LLMアプリケーションに「チェーン」ロジックを導入しました。基本的なツール呼び出しと記憶の問題を解決しましたが、アーキテクチャは比較的シンプルでした。

- 機能洗練段階(2023年〜2024年): アプリケーションが深まるにつれて、複雑なワークフローへの要求が急増しました。LangGraph、CrewAI、AutoGenに代表されるフレームワークは、状態管理、ビジュアルオーケストレーション、ロールベースのコラボレーション、会話スケジューリングを重視し始め、シンプルな線形チェーンからグラフやチームといったより複雑なパラダイムへと進化しました。

- エコシステム成熟・専門化段階(2025年〜現在): フレームワークは差別化を図り、クラウドサービスや企業のITスタックとの深い統合を進め始めました。焦点は本番環境対応、パフォーマンス最適化、セキュリティ、コンプライアンス、ローコード体験へと移行しました。Semantic KernelやHaystackのエンタープライズ市場での拡大が、この段階の際立った特徴です。

現在のAIエージェント市場の状況

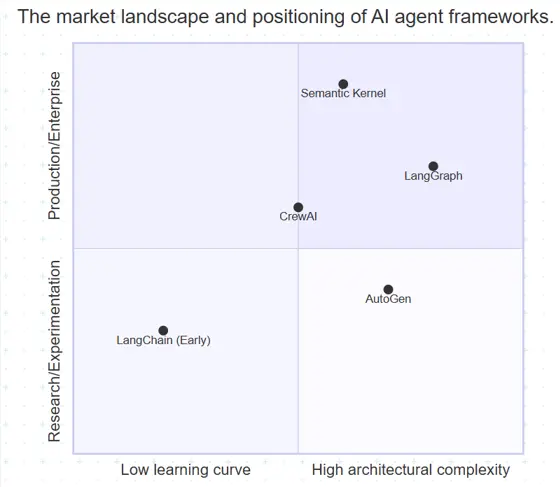

現在の市場は「一強多弱」の構造を呈しています。以下の図は、主要フレームワークのニッチと関係を示しています。

- リーダー: LangChainは先行者利益と最大のコミュニティを有し、ツール、統合、知識ベースにおいて最も完全なエコシステムを提供しています。多くの開発者にとって依然として第一の選択肢です。

- 強力なチャレンジャー: CrewAIは直感的な「Role-Task-Process」モデルによりチームコラボレーションのシナリオで際立っています。AutoGenはマルチエージェント会話のオーケストレーションと研究において深い優位性を築いています。

- エコシステム進化型: LangGraphはLangChainエコシステム内の「アップグレード」として、ステートマシングラフを用いて複雑でステートフルなビジネスプロセスを解決することに焦点を当てています。高複雑性アプリケーションの新しい標準となりつつあります。

- エンタープライズプレイヤー: Microsoftが支援するSemantic Kernelは、Azure OpenAIおよび.NETエコシステムと深く統合されており、セキュリティ、可観測性、既存の企業システムとの統合において自然な利点を提供します。

Part 2: 主要5大フレームワークの徹底比較

比較の側面

これらのフレームワークを、設計思想(考え方を決定)、アーキテクチャ機能(スケーラビリティとメンテナンスに影響)、学習曲線(チームのオンボーディングコスト)、コミュニティの活発さ(サポートの得やすさと長期的な進化の保証)、エンタープライズサポート(本番環境にとって重要)、そしてパフォーマンス(大規模アプリケーションの基盤)という6つの主要な側面から評価します。

詳細比較表

| Feature Dimension | LangChain | LangGraph | CrewAI | AutoGen | Semantic Kernel |

|---|---|---|---|---|---|

| Core Positioning | 汎用AIアプリフレームワーク | 状態駆動型複雑ワークフローフレームワーク | 役割駆動型チームコラボレーションフレームワーク | マルチエージェント会話オーケストレーション | エンタープライズAI統合フレームワーク |

| Design Philosophy | 「LEGOスタイル」のモジュール性 | 「ビジュアルフローチャート」のステートマシン | 「会社組織」の役割シナジー | 「グループチャット」スタイルの会話オーケストレーション | 「プラグインベースのスキル」の計画と実行 |

| Core Architecture | Chains, Agents, Tools | State Graph, Nodes, Edges | Agent, Task, Process, Crew | ConversableAgent, GroupChat | Plugins, Planners, Memories |

| Learning Curve | 中程度: 多くの概念、だが豊富なエコシステム | 中〜高: 状態/ループの理解が必要 | 低: 直感的で分かりやすい概念 | 高: 柔軟だが複雑な設定 | 中程度: 概念は明確、エコシステムへの慣れが必要 |

| GitHub Stars | 約122k+ (2025.12) | 約22.3k+ (2025.12) | 約41.5k+ (2025.12) | 約52.7k+ (2025.12) | 約26.9k+ (2025.12) |

| Docs/Community | 優秀、大量のチュートリアル | 良好、急速に改善中 | 優秀、豊富なユースケース | 中程度、API中心 | 優秀、エンタープライズグレードのドキュメント |

| Multi-Agent Support | 基本的、手動オーケストレーションが必要 | ネイティブ&優秀、自然なグラフ構造 | コア機能、コラボレーションのために構築 | コア機能、会話に特化 | Plannerの組み合わせにより実現 |

| Tool/Integration | 非常に豊富、主要サービスを全てカバー | LangChainに依存、フローに焦点を当てる | 良好、一般的なツールに焦点を当てる | 良好、カスタマイズをサポート | Microsoftエコシステムと深く統合 (Azure, Copilot) |

| Visual Debugging | 限定的 (LangSmith) | 強力な利点、視覚的な実行 | 基本的なプロセス可視化 | サードパーティツールが必要 | Azureサービスを通じて提供 |

| Enterprise Features | LangSmith/LangServe経由 | 高い、複雑なロジック追跡をサポート | 中程度 | 低い、研究指向 | 非常に高い、セキュリティ、モニタリング、コンプライアンス |

| Best Scenario | 迅速なプロトタイプ、教育、カスタムコンポーネント | カスタマーサポート、承認フロー、ETL複雑なワークフロー | コンテンツ作成、市場分析、チームベースのタスク | 学術研究、複雑な議論、シミュレーション | 高コンプライアンス業界 (金融/ヘルスケア) |

データソース:

https://github.com/langchain-ai/langchain

https://github.com/langchain-ai/langgraph

https://github.com/crewaiinc/crewai

https://github.com/microsoft/autogen

https://github.com/microsoft/semantic-kernel

フレームワークの背後にある核となる設計パラダイム

フレームワーク間の違いは、その根底にある設計パラダイムに起因しています。

| Architectural Paradigm | Core Idea | Representative Framework | Pros | Cons |

|---|---|---|---|---|

| Chain / Pipeline | タスクを線形実行の「チェーン」に分解 | LangChain (初期) | シンプルで直感的 | ループ/分岐の処理が困難 |

| Graph / State Machine | ノードとエッジを使って状態を持つワークフローを形成 | LangGraph | 強力で柔軟、複雑なロジックに最適 | 学習曲線が高く、設計の複雑性も高い |

| Role-based Collaboration | エージェントに明確な役割/タスクを割り当ててチームをシミュレート | CrewAI | 自然なモデリング、役割分担が容易 | 厳密な線形フローではグラフほど柔軟ではない |

| Conversation-Oriented | 「対話」をエージェントインタラクションの核となるメカニズムとして使用 | AutoGen | 交渉や反復的なコミュニケーションに最適 | 予測不能な実行フロー、デバッグが難しい |

| Plugin / Skill-based | 機能をプラグインとしてカプセル化し、Plannerが動的に呼び出す | Semantic Kernel | 分離され、拡張・統合が容易 | 強力なPlannerが必要、パフォーマンス課題あり |

Part 3: 各フレームワークの詳細分析

LangChain: 最も包括的な汎用フレームワーク

主要な利点: エコシステムが最大の強みです。最も包括的なドキュメント、最も多くのコミュニティチュートリアル、そして最も豊富なサードパーティ統合(主要なデータベース、ベクターストア、SaaSサービスをカバーする数百の公式およびコミュニティ統合)を誇ります。そのモジュール設計により、開発者はLEGOブロックのようにプロトタイプを組み立てることができます。

典型的なアプリケーション:

- 迅速な概念実証(PoC): 例えば、ある日の午後だけでプライベート文書に基づくQ&Aボットを構築するなど。

- AIエージェントの原理学習: その明確なモジュール性により、Tools、Memory、Chainsといった概念を理解するための最適な教材です。

- 高度なカスタマイズニーズ: 特定のリンク(独自のメモリインデックス方法など)を深くカスタマイズする必要がある場合、LangChainの低レベルインターフェースがそれを可能にします。

注意点: 「包括的」であることは複雑さをもたらします。シンプルで固定されたワークフローには肥大化していると感じるかもしれません。そのAgentエクゼキューターは、非常に複雑な多段階ループには苦戦する可能性があります。そのような場合は、LangGraphを検討してください。

当社のNavGoodにおける自動化スクリプトのテストでは、当初、標準のLangChain Agentで10段階のスクレイピングロジックを処理しようとしました。しかし、Chainsの「ブラックボックス」的な性質により、中間ステップが一度失敗すると状態の回復が難しいことが判明しました。この経験から、主要なロジックをLangGraphに移行することになりました。

LangGraph: 複雑なビジネスプロセスに最適な選択肢

主要な利点: 状態管理と可視化です。エージェントシステム全体を有向グラフとして抽象化し、各ノードが関数またはサブエージェントであり、エッジが状態遷移の条件を定義します。これにより、開発者はループ、条件分岐、並列処理、待機状態を含むビジネスプロセスを明確にモデル化できます。

LangChainとの関係: LangChainエコシステムの「高レベルコンポーネント」であり、LangChainが複雑なステートフルワークフローで抱える課題を解決するために特別に設計されています。ツールチェーンとモデルインターフェースは完全に互換性があります。

ユースケース:

- カスタマーサービスチケット処理: ユーザーの意図(返品、問い合わせ、苦情)に基づいてルーティングし、ノード間でやり取りが発生する可能性のあるケース。

- 多段階承認プロセス: 「申請 → マネージャー承認 → 財務承認 → アーカイブ」をシミュレートし、どの段階で拒否されても修正のために戻る必要があるケース。

- データ処理パイプライン: 再試行や例外処理ブランチを含む「スクレイピング → クリーニング → 検証 → 分析 → レポート」のパイプラインを実行するケース。

注意点: 「チェーン思考」から「グラフ思考」への転換が必要です。良い状態スキーマを設計することが重要であり、設計が悪いと混乱を招きます。

初心者は、すべての中間結果、コンテキスト、ログを単一のStateオブジェクトに詰め込み、肥大化させがちです。私たちの提案は、Stateを「コアビジネス状態」と「一時的な計算データ」に分割し、ノード間で必須の情報のみをStateに保持することです。

CrewAI: チームコラボレーションのための選択肢

主要な利点: 役割駆動の抽象化です。Agent(役割、目標、背景を定義)、Task(目的、期待される出力を定義)、Crew(Process(順次または並列など)を定義してAgentとTaskを組織化)を使用します。これは、人間がチームで協力する様子と非常によく似ています。

独自の概念: Processのhierarchicalモードでは、「マネージャー」エージェントが「ワーカー」エージェントを調整することができ、企業の階層構造をシミュレートするのに最適です。

ユースケース:

- コンテンツ作成チーム: プランナー(アウトライン作成)、ライター(下書き)、エディター(推敲)、出版マネージャー(フォーマット)が同期して作業。

- 市場分析レポート: リサーチャー、データアナリスト、インサイト要約担当者、PPT作成者がリレー形式でタスクを完了。

- アジャイルプロジェクト管理: プロダクトマネージャー、開発者、QAエージェントがスプリントプロセスをシミュレート。

注意点: そのプロセスは比較的構造化されています。非常に自由で動的な対話(公開討論など)を必要とするシナリオでは、AutoGenほど柔軟ではないかもしれません。

よくある間違いは、具体的な責任や出力制約なしに壮大な役割記述(例:「シニア市場専門家」)を設定することです。これは結果のずれにつながります。提案:Agent内で「入力 → 出力形式 → 基準」を明確に定義し、Taskのexpected_outputを構造化された形式(例:MarkdownテンプレートやJSONフィールド)に保つことです。

AutoGen: マルチエージェント会話研究のための選択肢

主要な利点: 会話のオーケストレーションにおける柔軟性と研究の深さです。AutoGenの中心はConversableAgentであり、メッセージを送信することで協調します。豊富な会話パターン(GroupChatとGroupChatManagerなど)とカスタマイズ可能な「Human-in-the-loop」フックを提供し、探索的なマルチエージェントインタラクション研究に最適です。特に、Microsoftによる2025年の全面改訂(AutoGen 0.4+またはMagentic-One)では、ネイティブなマルチモーダルサポートとAutoGen Studioのビジュアルインターフェースが導入されました。

ユースケース:

- 学術研究: 異なる背景を持つ複数のAI専門家がある問題について議論するシミュレーション。

- 複雑な対話システム: 複数のAIの役割を必要とする没入型RPGのNPCやインタラクティブな物語の構築。

- コード生成&レビュー: マルチターンの対話を通じてコードを最適化する「プログラマー」エージェントと「レビュアー」エージェントの作成。

注意点: 設定とデバッグが複雑です。固定されたパイプラインよりも探索とインタラクションに傾いており、決定論的な本番タスクには追加のエンジニアリング制約が必要です。

エージェントがお互いに質問し続け、明確な終了がない「無限ループ」を避けてください。提案:明確なmax_roundまたは終了関数を設定し、「要約エージェント」を使用して結論に収束させます。

Semantic Kernel: エンタープライズ統合のための堅実な選択肢

主要な利点: エンタープライズグレードの機能とシームレスなMicrosoft統合です。Microsoftによって開発され、Azure OpenAI、Azure AI Search、その他のクラウドサービスをネイティブにサポートしており、セキュリティ、認証、可観測性(Azure Monitor経由)に優れています。その多言語SDK(Python、C#、Java)は、多様な技術スタックを持つ大企業がAI開発を統一するための強力なツールです。2025年には、Semantic Kernelは「Agentic SDK」の概念を強調し、分散トランザクションの安全性に焦点を当てました。

コアコンセプト: Plugin(Functionsを含むスキル)、Planner(どのスキルを呼び出すかを自動的に計画)、およびMemory(ベクターストレージ)。

ユースケース:

- 企業のデジタル変革: 既存のCRM/ERP APIをPluginとしてラップし、AIエージェントがビジネスデータを安全に操作できるようにする。

- 社内Copilotの構築: Microsoft 365と深く統合し、従業員向けのスマートアシスタントを提供する。

- 高コンプライアンス業界: 金融やヘルスケアなど、厳格なアクセス制御、監査ログ、データガバナンスが必須となる分野。

注意点: チームがMicrosoftエコシステム(.NET、Azure)に縛られていない場合、その利点の一部が失われる可能性があります。コミュニティは上記のPython主導のフレームワークよりも小さいです。

Part 4: 実践的な選定ガイド

これら5つのフレームワークの中から適切なものを迅速に選択するために、意思決定ツリーを使用したり、チームのスキル、プロジェクト段階、将来のスケーラビリティを考慮したりすることができます。

意思決定ツリー:あなたの主要なニーズに基づく

まず、自問自答してください**:AIエージェントで解決しようとしている核となる問題は何ですか?**

- 「AIアイデアを迅速に検証したい」または「入門レベルの学習」が必要ですか?

- はい → LangChainを選択してください。豊富なエコシステムがあり、例を見つけやすいです。

- いいえ → 次の質問に進んでください。

- 核となるシナリオは「チーム(例:マーケティング、R&D)をシミュレートしてタスクを完了すること」ですか?

- はい → CrewAIを選択してください。その役割-タスクモデルが最も適しています。

- いいえ → 次の質問に進んでください。

- 核となるシナリオは「複雑なロジック、ループ、状態を持つビジネスプロセス(例:承認、チケット)を構築すること」ですか?

- はい → LangGraphを選択してください。グラフ状態マシンはここでは究極の武器です。

- いいえ → 次の質問に進んでください。

- 核となるシナリオは「マルチエージェントの対話/議論の研究」または「非常に柔軟なインタラクションが必要」ですか?

- はい → AutoGenを選択してください。

- いいえ → 次の質問に進んでください。

- あなたのプロジェクトはMicrosoftスタック内ですか、それともセキュリティとコンプライアンスに関して極端な要件がありますか?

- はい → Semantic Kernelを選択してください。

- いいえ → ステップ1に戻るか、LangChain/CrewAIから始めてください。

チームとプロジェクトフェーズによる選定

| Framework | Recommended For | Not Recommended For |

|---|---|---|

| LangChain | 個人の学習、スタートアップのプロトタイプ、多くの統合を必要とするPoC。 | 非常に複雑で厳密な状態ロジックを持つ本番ワークフロー。 |

| LangGraph | 複雑なビジネスフロー(例:EC注文、リスク監査)を開発する中〜大規模チーム。 | シンプルなワンオフスクリプトや、ビジュアルフローが関係ないシナリオ。 |

| CrewAI | 「役割分担」と「チーム出力」に焦点を当てたプロジェクト(例:コンテンツ作成)。 | 内部推論のきめ細かい制御や、非常に非線形で動的なフロー。 |

| AutoGen | マルチエージェントメカニズムや実験的な対話システムを探求する学術研究室。 | 本番タスクにおける安定した予測可能な出力。 |

| Semantic Kernel | .NET/C#とAzureを使用し、強力なセキュリティ/監査ニーズを持つ大企業。 | 最大限の速度とコミュニティサポートを求める個人開発者やスタートアップ。 |

迅速な選定推奨

- 迅速なプロトタイピングには: LangChain

- 複雑なワークフローには: LangGraph

- チームコラボレーションには: CrewAI

- マルチエージェント会話の研究には: AutoGen

- エンタープライズレベルのシステムには: Semantic Kernel

Part 5: パフォーマンスとコストの考慮事項

AIエージェントシステムにおいて、パフォーマンスはフレームワークだけでなく、LLMモデルの呼び出し、ワークフロー戦略、タスクの複雑性、デプロイメントアーキテクチャにも依存します。

パフォーマンスベンチマークと実世界での挙動

LLM呼び出しが主要なボトルネック: LLM呼び出しの回数とコンテキスト長が、パフォーマンスとコストに影響する主要な要因です。単純なタスクでは、フレームワークのパフォーマンス差はごくわずかであり、ボトルネックはLLMのレイテンシーとトークン消費です。

言い換えれば、「ワンステップでコンテンツを生成 → ツールを1回呼び出す → 結果を返す」といったシンプルなプロセスでは、フレームワーク自体のパフォーマンス差を明確に見ることは困難です。

複雑なシナリオでのフレームワークの挙動がコストに影響:

- LangGraphは、明示的な状態管理とDAGワークフローにより冗長な呼び出しを削減し、エラー回復時のトークンコストと時間コストを低減します。

- CrewAIの階層的なフローは、エージェントがフィードバックを交換したりステップを調整したりする際に、追加の呼び出しを生成する可能性があります。

- Semantic KernelのPlannerは、タスクを分割する前に常に計画を立てる傾向があり、固定された単純なフローでは非効率となる可能性のある余分なモデル呼び出しの「ホットスポット」を生み出すことがあります。

開発およびメンテナンスコスト

学習曲線のランキング(コミュニティのフィードバック): AutoGen > LangGraph ≈ Semantic Kernel > LangChain > CrewAI

これは、最も複雑なものから最も使いやすいものまでのスペクトルを示しています。AutoGenは高い柔軟性を提供しますが、セットアップとデバッグの面で参入障壁が高く、CrewAIは役割の抽象化により、より直感的で初心者にも優しいです。

メンテナンス:

- LangChain & CrewAIは、シンプルから中程度のタスクに対して直感的であり、チームコラボレーションや引き継ぎが容易です。

- LangGraphは、適切なドキュメントなしにグラフが非常に多くのノード/ブランチで巨大化した場合、メンテナンスが困難になる可能性があります。

- Semantic Kernelは、既存のインフラストラクチャに関する専門知識(Azure DevOps、セキュリティコンプライアンス)を必要とすることがよくあります。

クラウドデプロイメントと運用コスト

コールドスタートとメモリ消費: フレームワーク自体のランタイム抽象化レイヤーは、必然的にメモリ使用量に影響を与えます。軽量な設計(Python SDKを直接呼び出すなど)は通常、コールドスタートが高速ですが、より複雑なステートフルモジュールやPlannerモジュールを持つフレームワークは、追加のメモリを必要とする場合があります。

コンテナ化とサーバーレスの親和性: 現在、すべての主要フレームワークは、コンテナ化されたデプロイ(Docker/Kubernetesなど)とサーバーレスモードに最適化を進めています。これは、リソース分離や自動スケーリングなどによってコストをさらに削減できることを意味しますが、これも適切なエンジニアリングプラクティスに依存します。

トークンとモデルのコスト: 同じフレームワーク内であっても、異なるモデルのトークン価格は大きく異なります。GPT-4.1のようなより強力なモデルは、軽量バージョンよりもはるかに高価です(2023年〜2025年のコスト比較を参照)。適切なモデルを選択し、コンテキスト長を制御することがコスト最適化の重要なステップです。

Part 6: 将来のトレンド (2025年〜2026年)

AIエージェント技術が成熟し続けるにつれて、エコシステムは単一のツールやフレームワークから、より大規模で、より自律的で、より専門的で、よりエンジニアリングされたアーキテクチャシステムへと徐々に進化しています。以下は、2025年〜2026年に注目すべきいくつかの主要なトレンドです。

1. フレームワーク統合と「メタ調整レイヤー」の出現

AIエージェントのエコシステムは、「個々のフレームワークが孤立して動作する」状態から、「相互接続と統合されたガバナンス」へと進化しています。将来的には、**異なるフレームワーク間のさまざまなエージェントスタックをスケジューリング、監視、調整できる「メタ調整レイヤー」**が出現する可能性が高く、これにより企業は異なるエージェントエンジン間でデータ、実行戦略、セキュリティポリシーを共有できるようになります。例えば、コンサルティング会社PwCは、異なるソースからのエージェントを調整できるミドルウェアプラットフォームを発表しました。この種の「AIエージェントOS」は、企業のマルチエージェントアーキテクチャの重要なコンポーネントとなりつつあります。

2. ローコード/ビジュアルオーケストレーションが標準に

AIエージェント利用の参入障壁を下げることは、普及にとって不可欠です。単なるシンプルなドラッグ&ドロップインターフェースだけでなく、タスクワークフロー、ステートマシンの可視化、デバッグツール、自動エラープロンプトを統合したローコードおよびビジュアルオーケストレーションツールが市場で急速に成長しています。例えば、GitHubやその他のプラットフォームからのドラッグ&ドロップ式Agent Builderツールは、開発者が広範なプログラミングなしに複雑なエージェントワークフローを構築することを可能にすると期待されています。 このトレンドは、AIエージェントをエンジニアリングチーム向けの専門ツールから、ビジネスチームやプロダクトチームがアクセスできる生産性プラットフォームへと変革し、さまざまなビジネスシナリオでのより広範な導入を促進するでしょう。

3. 垂直特化型AIエージェントフレームワークとソリューションの台頭

汎用フレームワークは重要ですが、異なる垂直産業はコンプライアンス、セキュリティ、シナリオ固有の機能に関して様々なニーズを持っています。金融コンプライアンスエージェント、医療インテリジェントアシスタント、法務文書エージェント、製造/ゲームプロセス自動化などの専用ソリューションといった、より多くの産業特化型AIエージェントフレームワークやプラットフォームが出現すると予想されます。これらのフレームワークは、組み込みの業界知識、ルールエンジン、監査メカニズムに関してより成熟するでしょう。

4. AIネイティブ開発パラダイムとの深い統合

将来的には、AIエージェントは従来のアプリケーションに追加される機能ではなく、AIネイティブアプリケーション開発の基本的なパラダイムとなるでしょう。これは、エージェントフレームワークが**ワークフロープログラミング、イベント駆動システム、プロンプトエンジニアリング技術(ReAct、Chain-of-Thought推論など)、**および異なるデータモダリティ(テキスト、画像、構造化データ)のための統一インターフェースといった概念とより密接に統合されることを意味します。この進化は、エージェントが「タスク実行者」から「インテリジェントなビジネスコンポーネント」へと変革し、次世代アプリケーション開発の核となる基盤を形成するでしょう。

5. オープンソースと商用化の分岐トレンド

AIエージェントエコシステムは、オープンソースの革新性を維持し続ける一方で、主要なフレームワークは企業レベルのニーズに対応するため、商用バージョンとマネージドサービスのリリースを加速しています。例えば、成熟したフレームワークエコシステムでは、モニタリング、ホスティング、自動スケーリング、セキュリティポリシー、監査ログなどの付加価値サービスモジュールが出現しています。この開発モデルは、過去の基盤ソフトウェアの商用化経路と類似しています。オープンソース側は革新とコミュニティエコシステムの拡大に焦点を当て、商用バージョンは安定性、セキュリティ、可観測性を要求する企業ユーザーにサービスを提供します。

6. エージェントの標準化、セキュリティ、認証メカニズムの改善

さまざまな業界が本番環境でAIエージェントを展開し始めるにつれて、セキュリティと認証メカニズムが主要な技術的焦点となるでしょう。現在のエージェントは、外部システムやユーザーデータにアクセスする際に、より安全で制御可能な認証プロトコルを必要としており、これにより新しい標準(統一されたAPI認証、セキュアサンドボックス、信頼された実行環境など)が徐々に形成されることになります。エンタープライズレベルの展開では、これらの標準化メカニズムがフレームワークの選定と実装能力を評価する重要な指標となるでしょう。

7. 急速な市場成長とプロジェクト統合圧力

業界アナリストは、コストやビジネスモデルの問題により多くのAIエージェントプロジェクトが断念される可能性があるものの、2026年から2028年にかけてエージェント技術に対する市場全体の需要と投資熱は継続的に成長すると予測しています。より多くの企業がAIエージェントをコアビジネスプロセスに組み込むことを計画しており、「パイロットフェーズ」から「大規模アプリケーションフェーズ」への移行を推進しています。

結論:「最良」のフレームワークはなく、「最適」な選択があるのみ

AIエージェントの世界は急速に進化しています。フレームワークを選択するということは、本質的に複雑なインテリジェントシステムを構築するための考え方を選択することにほかなりません。

私たちの最終的なアドバイスです:

- 核となるシナリオを定義する: ツールを選ぶ前に、理想的なエージェントワークフローを具体化してください。

- 迅速に検証する: 候補となるフレームワークでコアモジュールを1〜2週間で実装し、その使い勝手をテストしてください。

- チームとエコシステムを評価する: あなたの技術的背景と必要な統合を考慮してください。

- 将来を見据える: フレームワークのロードマップがあなたの製品の方向性と一致していることを確認してください。

どのフレームワークであっても、その設計思想を深く理解し、構築を始めることの方が、「完璧な」フレームワークを待つよりも価値があります。

よくある質問(FAQ)

Q1: まずLangChainとLangGraphのどちらを学ぶべきですか? まずLangChainのコアコンセプト(Tools、Chains、Agents)を習得することをお勧めします。これが基礎となります。複雑なワークフローを構築する必要がある場合にLangGraphを学びましょう。両者は相補的な関係にあります。

Q2: スタートアップ企業にはどのフレームワークが最適ですか? CrewAIまたはLangChainです。もしあなたの製品アイデアが「マルチエージェントコラボレーション」(AI企業のように)を自然に含んでいるならCrewAIを選び、様々なAPIと迅速に連携・統合する必要があるならLangChainを選んでください。

Q3: どの程度のPython知識が必要ですか? 非同期プログラミング、デコレータ、Pydanticモデルの知識を含め、少なくとも中級レベルのPythonが必要です。Semantic Kernelの場合、C#バージョンを使用するなら、対応する.NET知識が必要です。

Q4: これらのフレームワークは本番環境で使用できますか? はい、可能ですが、追加の投資が必要です。LangGraph + LangSmith、CrewAI、Semantic Kernelはすべて、優れた本番環境対応機能を持っています。堅牢なエラー処理、ロギング、モニタリング、ロールバックメカニズムを持つことが鍵となります。

Q5: 中国語のドキュメントとコミュニティサポートはありますか? LangChainとCrewAIには比較的活発な中国語コミュニティ(例:知乎のコラム、技術ブログ、WeChatグループ)があります。LangGraphとAutoGenの中国語リソースは急速に増加しています。Semantic Kernelの中国語リソースは主にMicrosoftによって提供されます。

Q6: 最初の選択が間違っていた場合、フレームワーク間の移行コストは高いですか? はい、かなり高いです。 異なるフレームワークの設計パラダイムは大きく異なり、移行はコアビジネスロジックのオーケストレーション部分を書き直すことを意味します。したがって、最初のフレームワーク選定は非常に重要です。フレームワークの適合性を検証するために、小さなプロトタイプから始めることをお勧めします。

著者について

このコンテンツは、NavGood編集チームがキュレーションしています。 NavGoodは、AIツールエコシステムに特化したプラットフォームであり、AIエージェントと自動化されたワークフローの開発を追跡しています。

免責事項: 本記事はいかなるフレームワークの公式見解を代表するものではなく、商業的または投資に関する助言を構成するものではありません。提示された実験データは特定のテスト環境に基づき比較参考のためのみであり、本番環境での実際の結果は異なる場合があります。

リソース

- 公式サイトへのリンク:

LangChain

LangGraph

CrewAI

AutoGen

Semantic Kernel