huntr の概要

huntr: AI/MLセキュリティのためのバグ報奨金プラットフォーム

huntrとは?

Huntrは、AI(人工知能)および機械学習(ML)プロジェクト専用に設計された世界初のバグ報奨金プラットフォームです。セキュリティ研究者がAI/MLオープンソースアプリケーション、ライブラリ、およびモデルファイル形式の脆弱性を報告できる中心的なハブとして機能し、これらの重要なコンポーネントのセキュリティと安定性を強化するのに役立ちます。構造化され、インセンティブが与えられた脆弱性開示環境を提供することにより、huntrは成長著しいAIセキュリティ分野で重要な役割を果たします。

huntrはどのように機能しますか?

Huntrは、脆弱性の報告と解決のための合理化されたプロセスを促進します。

- 開示: セキュリティ研究者は、huntrプラットフォーム上の安全なフォームを通じて脆弱性を特定して送信します。

- 検証: huntrチームは、影響を受けるプロジェクトのメンテナに連絡し、レポートに応答するための31日間を与えます。応答がない場合、huntrは14日以内に重大度が高いレポートとクリティカルなレポートを手動で解決します。

- 報酬: レポートがメンテナまたはhuntrのいずれかによって検証された場合、研究者はその貢献に対する報酬として報奨金を受け取ります。

- 公開: オープンソースプロジェクトの場合、脆弱性レポートは90日後に公開され、メンテナが問題に対処する時間を与えます。メンテナは必要に応じて延長をリクエストできます。モデルファイル形式に関するレポートは公開されません。

huntrが重要な理由は何ですか?

AIとMLが私たちの生活のさまざまな側面にますます統合されるにつれて、これらのシステムのセキュリティを確保する必要性が最重要事項となっています。Huntrは、次の方法でこのニーズに対応します。

- 脆弱性の発見を奨励する: 報奨金を提供することにより、huntrはセキュリティ研究者がAI/MLプロジェクトの脆弱性を積極的に探し出して報告することを奨励します。

- コラボレーションを促進する: Huntrは、研究者とメンテナがセキュリティ問題の解決に向けて協力するためのプラットフォームを提供します。

- AI/MLセキュリティを向上させる: 脆弱性を特定して解決することにより、huntrはAI/MLシステムの全体的なセキュリティと安定性に貢献します。

huntrは誰のためのものですか?

Huntrは、さまざまな関係者にとって価値があります。

- セキュリティ研究者: 脆弱性を報告し、報酬を獲得し、AI/MLプロジェクトのセキュリティに貢献するためのプラットフォーム。

- AI/MLプロジェクトメンテナ: プロジェクトのセキュリティ問題を事前に特定して対処する方法。

- AI/MLを使用する組織: 依存しているAI/MLコンポーネントのセキュリティに対する信頼性の向上。

サポートされているAI/MLプロジェクト:

Huntrは、次の人気のあるプロジェクトを含む、240を超えるAI/MLプログラムをサポートしています。

- NVIDIA/nvidia-container-toolkit

- apache/spark

- huggingface/text-generation-inference

- intel/neural-compressor

- mongodb/mongo-python-driver

- huggingface/transformers

- pytorch/pytorch

- scikit-learn/scikit-learn

- keras-team/keras

- apache/airflow

- numpy/numpy

- microsoft/LightGBM

- onnx/onnx

- jupyter/jupyter

- mlflow/mlflow

- aws/aws-cli

- nltk/nltk

- kubeflow/kubeflow

- apache/arrow

- apache/tvm

- microsoft/onnxruntime

- deepmind/sonnet

- NVIDIA/TensorRT

- triton-inference-server/server

- huggingface/tokenizers

- Netflix/metaflow

- elastic/elasticsearch-py

- pytorch/serve

- h5py/h5py

- aimhubio/aim

- joblib/joblib

- scikit-optimize/scikit-optimize

- keras-team/keras-tuner

- aws/sagemaker-python-sdk

- run-llama/llama_index

- facebookresearch/faiss

- facebookresearch/fairseq

- deepjavalibrary/djl

- microsoft/autogen

- microsoft/promptbench

- ollama/ollama

- huggingface/smolagents

これらのプロジェクトは、幅広いAI/MLアプリケーションをカバーしており、AIセキュリティに対するhuntrの包括的なアプローチを強調しています。

主な機能

- AI/MLプロジェクトのバグ報奨金プラットフォーム

- 安全な脆弱性開示プロセス

- 研究者向けのインセンティブ報酬システム

- 研究者とメンテナ間のコラボレーション

- オープンソースプロジェクトの公開脆弱性レポート

HuntrはProtect AIによってサポートされており、MLSecOpsとより高度なAIセキュリティへの道をリードしています。

AI/MLプロジェクトを保護する最良の方法は?今すぐhuntrに参加して、より安全なAIエコシステムに貢献してください。

"huntr" のベストな代替ツール

BugRaptorsのAI搭載の品質エンジニアリングサービスでソフトウェアの品質を向上させましょう。AI拡張手動テスト、AI駆動の自動化、AIセキュリティテストのメリットを享受してください。

iBEAM の AI 駆動 4 ステッププロセスで、数週間でレガシー アプリケーションを近代化。専門家主導のアプリ変革で、パフォーマンスを向上させ、コストを削減し、セキュリティを強化し、スケーラビリティを確保。

nbot.aiはAI駆動のコンテンツキュレーターで、ウェブソースからパーソナライズドフィードを作成、洞察を要約、ノイズをフィルタリングし、どんなニッチでもリアルタイムチャットで洗練可能。

AquilaX Securityは、AIを搭載したDevSecOpsプラットフォームであり、セキュリティスキャンを自動化し、誤検知を減らし、開発者がより迅速に安全なコードを出荷できるようにします。SAST、SCA、コンテナ、IaC、シークレット、マルウェアスキャナーを統合します。

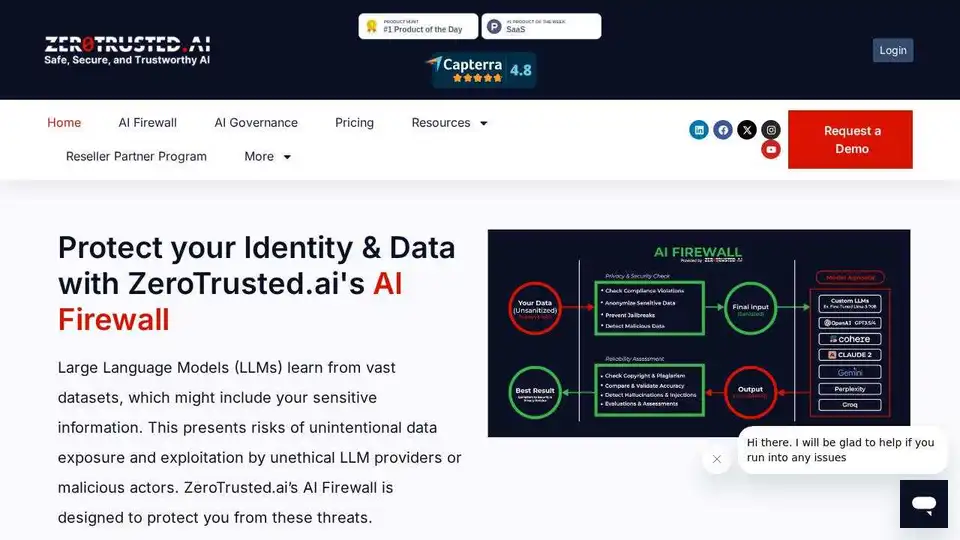

ZeroTrusted.ai は、AI エコシステムを保護するための AI ファイアウォール、AI ゲートウェイ、AI ヘルスチェックを提供します。 未承認の AI ツールを検出してブロックし、データ セキュリティを確保し、コンプライアンスを維持します。

Pervaziv AI は、マルチクラウド環境向けに生成 AI 搭載のソフトウェアセキュリティを提供し、アプリケーションを安全にスキャン、修正、構築、デプロイします。Azure、Google Cloud、AWS でより高速かつ安全な DevSecOps ワークフローを実現します。

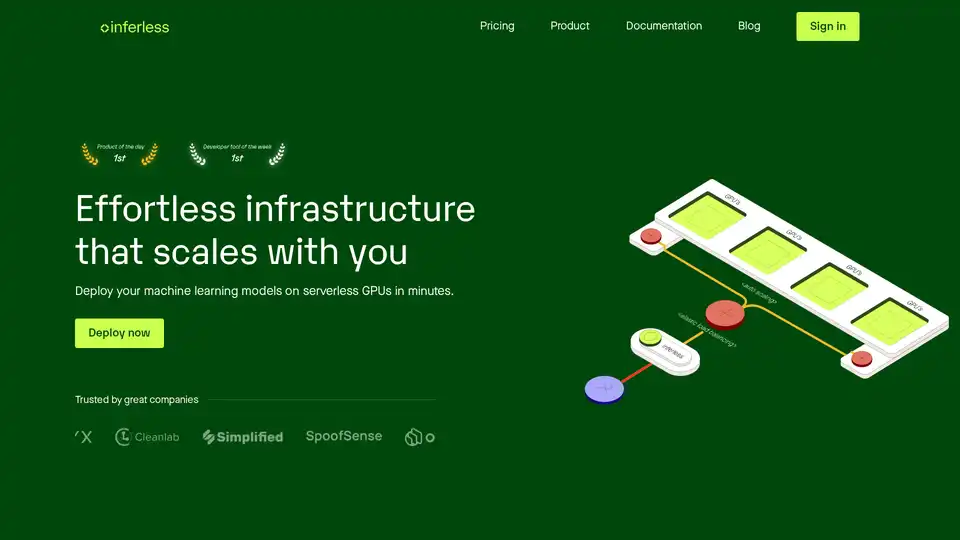

Inferlessは、MLモデルをデプロイするための超高速なサーバーレスGPU推論を提供します。自動スケーリング、動的バッチ処理、企業セキュリティなどの機能により、スケーラブルで簡単なカスタム機械学習モデルのデプロイを実現します。

Amazon Q Developer は、ソフトウェア開発向けの AWS 上の生成 AI を利用したアシスタントであり、コードの実装、テスト、リファクタリングなどの機能を提供して、開発ライフサイクルを加速します。

Vectra AI は、AI を使用してネットワーク、ID、クラウド全体で現代の攻撃を検出・停止するリーディングサイバーセキュリティプラットフォームで、応答時間を最大 99% 短縮します。世界中の 2,000 以上のチームから信頼されています。

Learn Promptingは、ChatGPT、LLM、AIセキュリティを網羅した包括的なプロンプトエンジニアリングコースを提供しており、世界中の何百万人ものユーザーから信頼されています。無料で学習を始めましょう!

WhyLabsは、AIの可観測性、LLMセキュリティ、モデル監視を提供します。リアルタイムで生成AIアプリケーションを保護し、リスクを軽減します。

ROK Solutionは、ワークフロー、BPM、RPA、AI、ノーコード機能を提供するハイパーオートメーションプラットフォームです。ビジネスプロセスを合理化し、セキュリティとコンプライアンスを確保し、企業および政府組織向けに設計されています。

BasicAI は、AI/ML モデル向けのリーディングデータアノテーションプラットフォームとプロフェッショナルなラベリングサービスを提供し、AV、ADAS、智能都市アプリケーションで数千のユーザーに信頼されています。7年以上の専門知識により、高品質で効率的なデータソリューションを保証します。

Philonet.aiは、知的関与と共有コンテンツに関するリアルタイムの会話に焦点を当てることで、ソーシャルネットワーキングを再考し、本物の思考に基づいたコミュニティを育成します。