Sanctum の概要

Sanctum: あなたのプライベートなローカル AI アシスタント

Sanctumとは?

Sanctumは、フル機能を備えたオープンソースのLarge Language Models (LLM)をローカルデバイス上で実行し、操作できるデスクトップアプリケーションです。データが暗号化され、保護され、デバイスから離れることがないようにすることで、ユーザーのプライバシーを優先します。Sanctumは、個人データの分析、コンテンツ作成、ブレインストーミング、コード開発など、さまざまなAI駆動型タスクのための安全な環境を提供します。

Sanctumはどのように機能するのですか?

Sanctumは、デバイス上での暗号化と処理を活用して、データをプライベートに保ちます。Hugging Faceと統合されており、数千ものGGUFモデルへのアクセスを提供します。この統合により、ユーザーは互換性を簡単に確認し、モデルをダウンロードして、PCまたはMac上で直接使用できます。Sanctumを使用すると、PDFと100%プライベートにチャットしたり、質問したり、最初のダウンロード後にインターネット接続を必要とせずに安全な環境でファイルを要約したりできます。

主な機能:

- ローカルAI処理: クラウドサーバーに依存せずに、AIモデルをデバイス上で直接実行します。

- プライバシー第一のアプローチ: データは暗号化され、Sanctum内に保持されます。

- Hugging Face統合: 幅広いオープンソースモデルにアクセスし、簡単に統合できます。

- PDFチャット: 安全にPDFとチャットし、情報を抽出します。

- 簡単なセットアップ: シンプルなダウンロードとインストールプロセス。

ユースケース:

- 個人の健康データの分析

- コンテンツの作成

- アイデアやソリューションのブレインストーミング

- データ分析の実施

- 通話メモのレビュー

- プライベートな財務データの分析

- コード開発での共同作業

- ユーザーフィードバックの分析

- 営業スクリプトの改善

- ウェルネスの進捗状況の追跡

実際のユーザー体験:

- 「あなたのラップトップに存在し、すべてのデータをプライベートに保つ生成AI!私は朝からずっと遊んでいますが、とてもクールです!」 - @itscrazybro(XのSanctumユーザー)

- 「私たちが非常に情熱を注いでいるのは、AIの制御をユーザーに戻すことです。これがどのように進化するか楽しみです。」 - Aaron McDonald(@futureverse創業者)

- 「Sanctumを使い始めるまで、自分がどれほど必要としているかに気づきませんでした。」 - Noah Jessop (ProofGroup)

Sanctumを始める方法:

- お使いのオペレーティングシステム(WindowsまたはMac)用のSanctumをダウンロードします。

- アプリケーションをインストールします。

- Sanctumインターフェースを通じてHugging Faceからモデルを探索してダウンロードします。

- AIとのチャットを開始するか、PDFを安全に分析します。

FAQ:

- Sanctumアプリはどのように機能しますか? SanctumはAIモデルをローカルデバイス上で実行し、データがプライベートかつ安全に保たれるようにします。

- どのオペレーティングシステムがサポートされていますか? Sanctumは現在、WindowsとMacで利用可能です。

- Sanctumはどのくらい安全ですか? Sanctumはデータを暗号化し、ローカルで処理するため、デバイスから離れることはありません。

Sanctumが重要な理由は何ですか?

Sanctumは、AIインタラクションにおけるプライバシーのニーズの高まりに対応するため、重要です。AIモデルをローカルで実行し、データを暗号化することにより、Sanctumはユーザーが個人情報を損なうことなくAI機能を活用できるようにします。

結論として、SanctumはAIと対話するためのプライベートで安全な方法を提供します。その機能、使いやすさ、およびプライバシーへの取り組みは、データセキュリティを犠牲にすることなくAIを活用したいと考えている人にとって、貴重なツールになります。

"Sanctum" のベストな代替ツール

Enclave AIは、完全にオフラインで動作するiOSおよびmacOS用のプライバシー重視のAIアシスタントです。インターネット接続を必要とせずに、ローカルLLM処理、安全な会話、ボイスチャット、ドキュメントインタラクションを提供します。

NativeMindはオープンソースChrome拡張で、OllamaなどのローカルLLMを実行し、完全にオフラインでプライベートなChatGPT代替を提供。コンテキスト認識チャット、エージェントモード、PDF分析、執筆ツール、翻訳を特徴とし、すべてデバイス上で100%クラウド不要。

Private LLMは、オフラインで動作するiOSおよびmacOS用のローカルAIチャットボットであり、情報を完全にデバイス上に保持し、安全かつプライベートに保ちます。 iPhone、iPad、Macで検閲されていないチャットをお楽しみください。

LM Studioは、LLaMaやGemmaなどのオープンソース大規模言語モデル(LLM)をローカルPCで実行およびダウンロードするための使いやすいデスクトップアプリケーションです。アプリ内チャットUIとOpenAI互換のローカルサーバーを備え、プログラミングスキルなしでオフラインAIモデルとの対話を可能にします。

Privacy AIは、究極のデータプライバシーを保証するオフラインAIチャットボットハブです。インターネットなしでデバイス上でローカルに言語モデルを実行し、安全な会話を実現します。

On-Device AI:iPhone、iPad、Mac上で、音声テキスト変換、自然なテキスト読み上げ、LLMとのチャットをオフラインかつ安全に行います。プライベートでパワフル!

DotはMistral 7Bを搭載したローカル、オフラインAIチャットツールで、データを送信せずにドキュメントとチャットできます。無料でプライバシー重視。

OmniBot:WebGPUを使用してLLMをブラウザでネイティブに実行し、ブラウザ内およびオフラインのAIエクスペリエンスを提供するプライベートAIアシスタント。

Floneumは、ローカルの大規模言語モデルを使用してAI駆動のワークフローを視覚的に構築できるグラフエディタです。 分離されたWASMプラグインで安全に拡張され、複数の言語をサポートします。

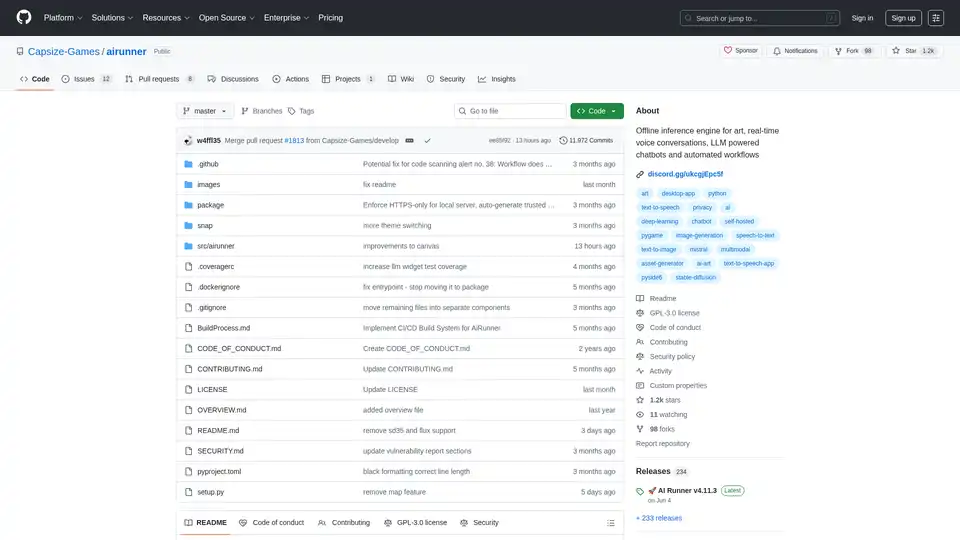

AI Runnerは、アート、リアルタイムの音声会話、LLMを搭載したチャットボット、および自動化されたワークフローのためのオフラインAI推論エンジンです。画像生成、音声チャットなどをローカルで実行します!

RecurseChat:ローカルAIと対話できるパーソナルAIアプリ。オフライン対応で、PDFやmarkdownファイルとのチャットも可能です。

Janは、オープンソースのオフライン優先AIクライアントです。プライバシーを保護し、API料金なしで大規模言語モデル(LLM)をローカルで実行します。さまざまなモデルやサービスに接続します。

Roo Code は VS Code 向けのオープンソース AI 駆動コーディングアシスタントで、多ファイル編集、デバッグ、アーキテクチャのための AI エージェントを備えています。さまざまなモデルをサポートし、プライバシーを確保し、ワークフローに合わせてカスタマイズして効率的な開発を実現します。

ProxyAIは、JetBrains IDE用のAI搭載コードアシスタントで、コード補完、自然言語編集、ローカルLLMによるオフラインサポートを提供します。AIでコーディングを強化しましょう。