Reflection 70B 개요

Reflection 70B: 세계 최고의 오픈 소스 AI 모델

Reflection 70B란 무엇인가요? Reflection 70B는 Reflection-Tuning이라는 새로운 학습 기술을 활용하는 획기적인 오픈 소스 대규모 언어 모델(LLM)입니다. 이 접근 방식을 통해 모델은 실시간으로 자체 추론 오류를 감지하고 수정하여 보다 정확하고 신뢰할 수 있는 결과를 얻을 수 있습니다.

주요 기능 및 이점:

- Reflection-Tuning: 모델이 추론 오류를 동적으로 식별하고 수정할 수 있는 고유한 학습 방법을 사용합니다.

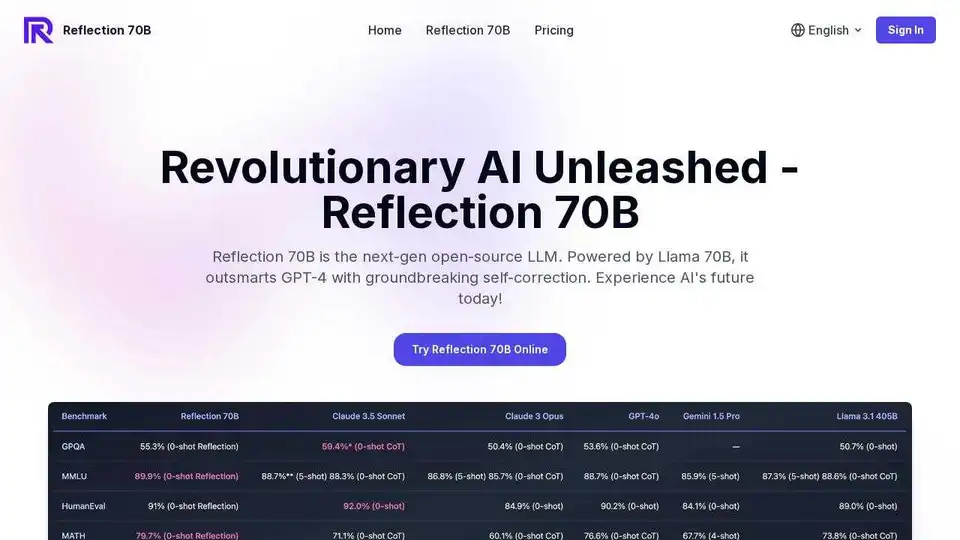

- 최고 성능: 다양한 벤치마크에서 다른 오픈 소스 LLM보다 뛰어난 성능을 보여주며 우수한 추론 및 언어 이해 능력을 입증합니다. 이러한 뛰어난 성능은 AI 연구원 및 개발자에게 최고의 선택입니다.

- 실시간 추론: 명확한 사고, 반영 및 출력 단계를 통해 모델의 사고 과정에 대한 투명한 뷰를 제공합니다. 이를 통해 사용자는 모델이 결론에 도달하는 방식을 이해할 수 있습니다.

- 다재다능한 응용: 복잡한 추론, 질의응답 및 창의적인 글쓰기를 포함한 광범위한 작업에 적합합니다. 기업은 고객 서비스에서 콘텐츠 제작에 이르기까지 다양한 사용 사례에 Reflection 70B를 활용할 수 있습니다.

- 쉬운 통합: 기존 Llama 모델 파이프라인 및 채팅 형식과 호환되도록 설계되어 기존 프로젝트에 원활하게 통합할 수 있습니다.

- 오픈 소스: 개인 및 상업 프로젝트 모두에 무료로 사용할 수 있어 투명성과 협업적인 AI 개발을 장려합니다.

Reflection 70B는 어떻게 작동합니까?

Reflection 70B는 Reflection-Tuning 기술을 활용합니다. Reflection-Tuning은 어떻게 작동합니까? 이 기술은 모델에게 자신의 추론 프로세스를 비판적으로 평가하고 오류를 식별하도록 가르칩니다. 모델은 자신의 실수를 되돌아봄으로써 실수를 수정하는 방법을 배우고, 이는 보다 신뢰할 수 있고 정확한 결과를 가져옵니다. 이러한 기능을 통해 Reflection 70B는 다른 오픈 소스 LLM과 차별화됩니다.

자주 묻는 질문

Reflection 70B 및 그 기능에 대해 가장 자주 묻는 질문은 다음과 같습니다.

- Reflection 70B란 무엇입니까? Reflection 70B는 Reflection-Tuning이라는 새로운 기술을 사용하여 학습된 세계 최고의 오픈 소스 대규모 언어 모델(LLM)입니다. 추론 과정에서 오류를 감지하고 수정할 수 있습니다.

- Reflection-Tuning은 어떻게 작동합니까? Reflection-Tuning은 모델에게 추론에서 오류를 식별하고 수정하도록 가르쳐 보다 정확하고 신뢰할 수 있는 결과를 가져옵니다.

- Reflection 70B를 특별하게 만드는 것은 무엇입니까? Reflection 70B는 자체 추론을 되돌아보는 능력, 벤치마크에서 뛰어난 성능 및 오픈 소스 특성으로 인해 두드러집니다.

- Reflection 70B를 어떻게 사용할 수 있습니까? 채팅 인터페이스를 통해 Reflection 70B를 사용하거나 표준 Llama 모델 파이프라인 및 채팅 형식을 사용하여 프로젝트에 통합할 수 있습니다.

- Reflection 70B는 무료로 사용할 수 있습니까? 예, Reflection 70B는 오픈 소스이며 개인 및 상업적 목적으로 무료로 사용할 수 있습니다.

- Reflection 70B는 어떤 유형의 작업을 처리할 수 있습니까? Reflection 70B는 복잡한 추론, 질의응답, 창의적인 글쓰기 및 다양한 기타 자연어 처리 작업에 능숙합니다.

- 모바일 장치에서 Reflection 70B를 사용할 수 있습니까? 예, Reflection 70B는 스마트폰 및 태블릿을 포함한 모든 장치에서 완전히 반응형이고 기능적으로 작동하도록 설계되었습니다.

- Reflection 70B는 개인 데이터를 저장합니까? 아니요, Reflection 70B는 개인 데이터 또는 사용자가 입력한 콘텐츠를 저장하지 않아 개인 정보 보호 및 보안을 보장합니다.

- Reflection 70B에 대한 자세한 정보는 어디에서 찾을 수 있습니까? 웹사이트 또는 AI 기술 전용의 평판이 좋은 교육 웹사이트에서 Reflection 70B에 대한 자세한 정보를 찾을 수 있습니다.

- Reflection 70B를 내 프로젝트에 통합할 수 있습니까? 예, 개발자는 Reflection 70B를 프로젝트에 통합하는 것을 환영합니다. API 액세스 및 자세한 내용은 개발자 섹션을 참조하십시오.

결론

Reflection 70B는 오픈 소스 AI 모델의 중요한 발전을 나타내며, 사용자에게 복잡한 추론, 언어 이해 및 창의적인 작업을 위한 강력한 도구를 제공합니다. 고유한 Reflection-Tuning 기능과 쉬운 통합 및 무료 가용성이 결합되어 AI 개발자, 연구원 및 기업에게 귀중한 리소스입니다. Reflection 70B를 탐색하고 AI 프로젝트에서 실시간 추론의 잠재력을 발휘하십시오.

"Reflection 70B"의 최고의 대체 도구

Reflection 70B 온라인 체험: Llama 70B 기반 오픈 소스 LLM. 혁신적인 자체 수정 기능으로 GPT-4보다 뛰어난 성능을 제공합니다. 온라인 무료 평가판을 이용할 수 있습니다.

Nebius AI Studio Inference Service는 호스팅된 오픈소스 모델을 제공하여 독점 API보다 더 빠르고 저렴하며 정확한 추론 결과를 제공합니다. MLOps 없이 원활하게 확장 가능하며, RAG 및 생산 워크로드에 이상적입니다。

Private LLM은 오프라인으로 작동하여 정보를 완전히 장치에 안전하고 비공개로 유지하는 iOS 및 macOS용 로컬 AI 챗봇입니다. iPhone, iPad 및 Mac에서 검열되지 않은 채팅을 즐기십시오.

Nebius는 AI 인프라를 민주화하도록 설계된 AI 클라우드 플랫폼으로, 유연한 아키텍처, 테스트된 성능, NVIDIA GPU를 통한 장기적인 가치, 학습 및 추론을 위해 최적화된 클러스터를 제공합니다.

Alan AI는 엔터프라이즈 애플리케이션을 위한 자체 코딩 인텔리전스를 지원하는 적응형 앱 AI 플랫폼입니다. 자체 코딩 시스템으로 주문형 기능을 제공하여 개발자의 노력을 줄이고 사용자 경험을 변화시킵니다.

Falcon LLM은 TII의 오픈소스 생성 대형 언어 모델 계열로, Falcon 3, Falcon-H1, Falcon Arabic 등의 모델을 통해 일상 기기에서 효율적으로 실행되는 다국어·멀티모달 AI 애플리케이션을 제공합니다.

smolagents는 코드로 추론하고 행동하는 AI 에이전트를 생성하기 위한 미니멀리즘 Python 라이브러리입니다. LLM-agnostic 모델, 보안 샌드박스, Hugging Face Hub와의 원활한 통합을 지원하여 효율적인 코드 기반 에이전트 워크플로를 제공합니다.

Lampi AI는 금융 전문가를 위한 AI 에이전트를 제공하여 복잡한 금융 워크플로를 몇 분 안에 구조화되고 고품질 분석으로 변환합니다. M&A, 투자 은행, 사모 펀드 및 법률 부문에 이상적입니다.

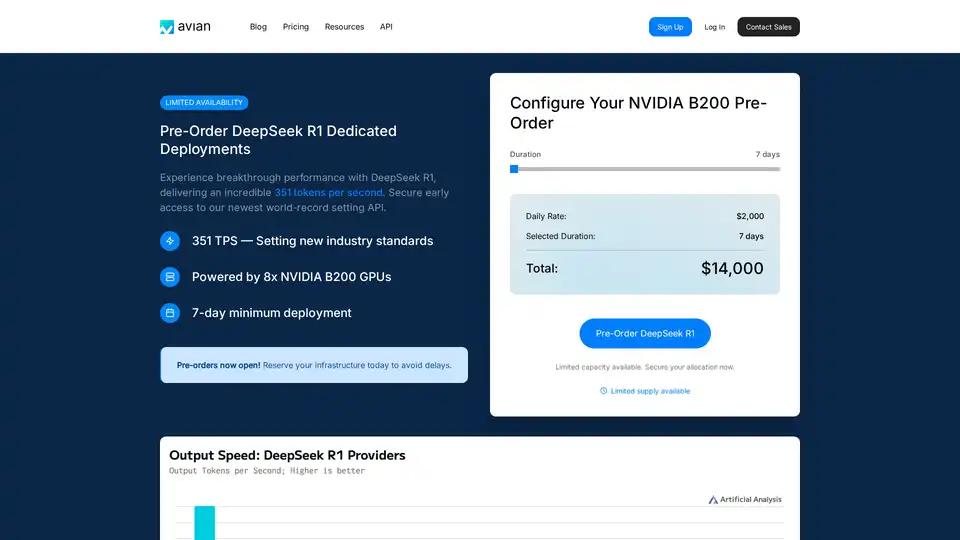

Avian API는 오픈 소스 LLM에 가장 빠른 AI 추론을 제공하여 DeepSeek R1에서 351 TPS를 달성합니다. OpenAI 호환 API를 사용하여 HuggingFace LLM을 3~10배 빠른 속도로 배포하십시오. 엔터프라이즈급 성능 및 개인 정보 보호.

Fireworks AI는 최첨단 오픈 소스 모델을 사용하여 생성적 AI를 위한 매우 빠른 추론을 제공합니다. 추가 비용 없이 자신의 모델을 미세 조정하고 배포하십시오. AI 워크로드를 전 세계적으로 확장하십시오.

Predibase는 오픈 소스 LLM을 미세 조정하고 제공하기 위한 개발자 플랫폼입니다. 강화 미세 조정 기능을 통해 엔드 투 엔드 트레이닝 및 서비스 인프라로 비교할 수 없는 정확도와 속도를 달성하십시오.

Unsloth AI는 gpt-oss 및 Llama와 같은 LLM에 대한 오픈 소스 미세 조정 및 강화 학습을 제공하여 30배 더 빠른 교육과 메모리 사용량 감소를 자랑하므로 AI 교육에 접근하고 효율적으로 사용할 수 있습니다.

Sagify는 AWS SageMaker에서 머신러닝 파이프라인을 간소화하는 오픈 소스 Python 도구로, 독점 및 오픈 소스 대형 언어 모델의 원활한 통합을 위한 통합 LLM 게이트웨이를 제공합니다.

Atla AI의 Selene은 AI 앱 성능에 대한 정확한 판단을 제공합니다. 업계 최고의 정확도와 신뢰할 수 있는 AI 평가를 위해 오픈 소스 LLM Judge 모델을 살펴보세요.