AnimateDiff

AnimateDiff 개요

AnimateDiff란?

AnimateDiff는 정적 이미지 또는 텍스트 프롬프트를 부드러운 프레임 시퀀스로 변환하여 동적 애니메이션 동영상을 생성하는 혁신적인 AI 도구입니다. Stable Diffusion을 기반으로 구축되었으며, 전문 모션 모듈을 통합하여 현실적인 움직임을 예측하고 적용하므로 AI 기반 동영상 제작의 게임 체인저가 됩니다. 아이디어를 스케치하는 아티스트이든 시각적 프로토타입을 제작하는 개발자이든, AnimateDiff는 개념을 매력적인 애니메이션으로 전환하는 과정을 간소화하여 수동 프레임별 작업이 필요 없습니다. 이 오픈소스 프레임워크는 AUTOMATIC1111's WebUI와 같은 확장 기능을 통해 사용 가능하며, 사용자가 확산 모델을 활용하여 텍스트-투-비디오 및 이미지-투-비디오 생성을 수행할 수 있도록 하여 예술, 게임, 교육 분야에서 효율적인 콘텐츠 제작의 문을 엽니다.

AnimateDiff 작동 방식

핵심적으로 AnimateDiff는 Stable Diffusion과 같은 사전 학습된 텍스트-투-이미지 또는 이미지-투-이미지 확산 모델과 전용 모션 모듈을 결합합니다. 이 모듈은 다양한 실제 동영상 클립으로 훈련되어 일반적인 모션 패턴, 역학 및 전환을 포착하여 애니메이션이 자연스럽고 생생하게 느껴지도록 합니다.

텍스트-투-비디오 프로세스

- 입력 프롬프트: 장면, 캐릭터, 동작 또는 개념을 개요하는 설명적 텍스트 프롬프트로 시작합니다(예: "황혼에 반딧불이가 춤추는 고요한 숲").

- 기본 모델 생성: Stable Diffusion 백본이 프롬프트를 기반으로 시각적 콘텐츠에 초점을 맞춘 초기 키 프레임을 생성합니다.

- 모션 통합: 모션 모듈이 프롬프트와 이전 프레임을 분석하여 역학을 예측하고 원활한 전환을 위해 중간 프레임을 보간합니다.

- 출력 렌더링: 조정된 시스템이 일반적으로 8-16 FPS로 16-24 프레임의 짧은 동영상 클립 또는 GIF를 생성하여 움직임의 애니메이션 요소를展示합니다.

이미지-투-비디오 프로세스

기존 시각 자료를 애니메이션화하는 경우:

- 이미지 업로드: 정적 사진, artwork 또는 AI 생성 이미지를 제공합니다.

- 변형 생성: Stable Diffusion의 img2img를 사용하여 미묘한 키 프레임 변형을 생성합니다.

- 모션 적용: 모션 모듈이 추론된 역학을 추가하여 객체 또는 배경과 같은 요소를 애니메이션화합니다.

- 최종 동영상: 원본 이미지가 생명력을 얻은 생동감 있는 클립으로 결과가 나타나며, 디지털 아트或个人 사진에 생기를 불어넣는 데 이상적입니다.

이 플러그 앤 플레이 접근 방식은 광범위한 재훈련이 필요하지 않음을 의미합니다—단순히 모션 모듈을 Stable Diffusion 설정에 통합하기만 하면 됩니다. 사용자는 카메라 효과(패닝, 줌)를 위한 Motion LoRA 또는 참조 동영상에서 유도된 모션을 위한 ControlNet과 같은 고급 옵션으로 출력을 미세 조정하여 제어성과 창의성을 향상시킬 수 있습니다.

AnimateDiff 주요 기능

- 플러그 앤 플레이 통합: 확장 기능을 통해 Stable Diffusion v1.5 모델과 원활하게 작동하며, 기본 사용을 위한 무거운 설정이 필요 없습니다.

- 다양한 생성 모드: 텍스트-투-비디오, 이미지-투-비디오, 루프 애니메이션 및 텍스트 guidance를 통한 비디오-투-비디오 편집을 지원합니다.

- 개인화 옵션: DreamBooth 또는 LoRA와 결합하여 데이터셋에서 훈련된 사용자 정의 주제를 애니메이션화합니다.

- 고급 제어: 더 부드러운 모션을 위해 FPS, 프레임 수, context batch size 조정; 원활한 cycles를 위한 close loops 또는 확장된 유동성을 위한 reverse frames 활성화.

- 효율성: capable hardware에서 짧은 클립을 빠르게 생성하며, monolithic video models를 처음부터 구축하는 것보다 빠릅니다.

이러한 기능으로 AnimateDiff는 rapid prototyping을 위한 유연한 도구가 되어 아이디어에서 애니메이션 출력까지의 시간을 단축합니다.

AnimateDiff 사용 방법

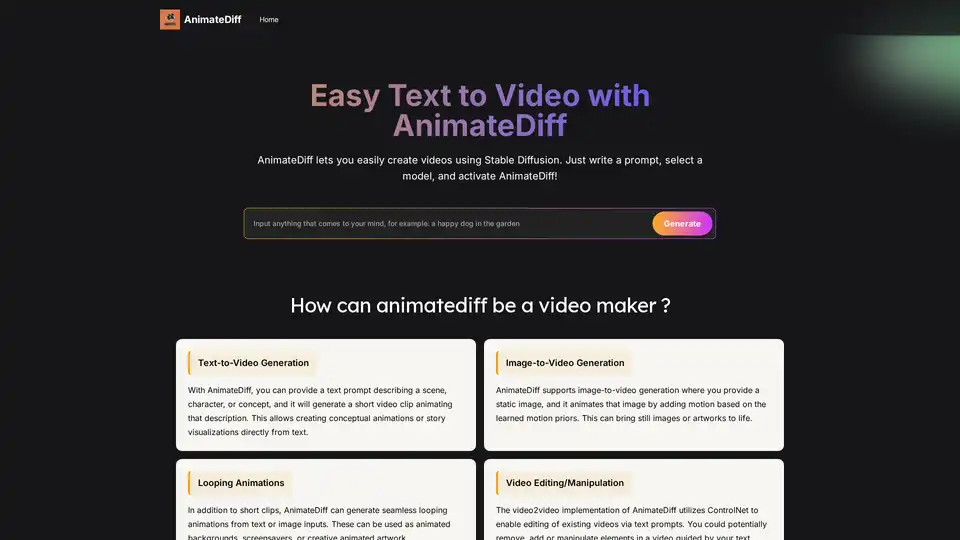

시작은 간단하며, 특히 animatediff.org의 무료 온라인 버전은 설치가 필요하지 않습니다.

온라인 사용 (설정 불필요)

- animatediff.org 방문

- 텍스트 프롬프트 입력(예: "무지개를 뛰어넘는 고양이")

- 사용 가능한 model 및 motion style 선택

- 생성 실행—AI가 서버 측에서 처리하여 다운로드 가능한 GIF 또는 동영상 제공

- 초보자 또는 빠른 테스트에 이상적이며, 로컬 resources 없이 완전히 온라인

고급 사용자를 위한 로컬 설치

전체 potential을 unlock하려면:

- AUTOMATIC1111's Stable Diffusion WebUI 설치

- Extensions > Install from URL로 이동, https://github.com/continue-revolution/sd-webui-animatediff 붙여넣기

- motion modules(예: mm_sd_v15_v2.ckpt) 다운로드하여 extensions/animatediff/model 폴더에 배치

- WebUI 재시작; AnimateDiff가 txt2img/img2img 탭에 나타남

- 프롬프트 입력, AnimateDiff 활성화, frames/FPS 설정, 생성

Google Colab 사용자를 위해 cloud-based runs용 notebooks 사용 가능. 기본 설정 beyond coding expertise 불필요—tutorials가 Python 및 Nvidia CUDA와 같은 dependencies 안내.

시스템 요구 사항

- GPU: 8GB+ VRAM이 있는 Nvidia(비디오-투-비디오의 경우 10GB+); RTX 3060 이상 권장

- OS: Windows/Linux 기본; macOS via Docker

- RAM/Storage: 16GB RAM, models 및 outputs용 1TB storage

- 호환성: Stable Diffusion v1.5 only; GitHub에서 updates 확인

이러한 조건에서 생성 시간이 클립당 minutes로 줄어들며 hardware power에 따라 scaling.

잠재적 사용 사례 및 응용

AnimateDiff는 빠른 AI 지원 애니메이션을 요구하는 scenarios에서 빛나며, efficient visual storytelling에 대한 search intents와一致합니다.

Art 및 Animation

아티스트는 텍스트에서 스케치 또는 storyboards를 prototype화하여 수동 drawing 시간을 절약할 수 있습니다. 예를 들어, 캐릭터의 walk cycle을 즉시 시각화하고 creative workflows에서 더 빠르게 반복합니다.

Game Development

프로토타입용 asset animations를 rapidly generate—예: enemy movements 또는 UI transitions—full animation teams 없이 pre-production 가속화.

Education 및 Visualization

추상적인 개념을 engaging videos로 전환합니다. historical events 또는 scientific processes의 애니메이션화와 같이 학습을 interactive 및 memorable하게 만듭니다.

Social Media 및 Marketing

눈에 띄는 posts 또는 ads 생성: product reveal 설명, Instagram 또는 TikTok용 준비된 looping animation 얻기, minimal effort로 engagement 향상.

Motion Graphics 및 Pre-Visualization

동영상용 dynamic intros 생성 또는 costly renders/films 전에 complex scenes preview. filmmakers 또는 AR/VR developers에 이상적.

augmented reality에서는 natural motions로 characters 애니메이션화; advertising에서는 brand images에서 personalized promo clips 제작.

AnimateDiff 선택 이유

Adobe After Effects와 같은 traditional tools와 비교하여 AnimateDiff는 heavy lifting을 자동화하여 pro skills 없이 high-quality animations에 accessible하게 만듭니다. real videos에서 learned motion priors에 대한 reliance는 realism을 보장하는 반면, prompts를 통한 controllability는 AI generation의 common pain points를 해결합니다. 무료 및 open-source이므로 hobbyists 및 pros alike에게 cost-effective이며, GitHub를 통한 community-driven updates가 있습니다. Hollywood-level complexity에는 perfect하지 않지만, ideation 및 short-form content에는 unbeatable하며 AI video tools에서 innovation을 foster합니다.

'best text-to-video AI' 또는 'animate images with Stable Diffusion'를 검색하는 사용자에게 AnimateDiff는 its diffusion model heritage 및 motion expertise로 backed되어 reliable results를 제공합니다.

AnimateDiff 대상자

- Creative Professionals: 빠른 visualizations가 필요한 artists, animators, designers

- Developers 및 Gamers: interactive elements prototyping용

- Educators/Content Creators: explanatory 또는 entertaining media 구축

- Marketers/Social Influencers: 빠르고 customizable animated assets

- Hobbyists: deep technical barriers 없이 AI animation에 curious한 anyone

특히 Stable Diffusion에 familiar한 사람들에게 적합하지만, online demo가 entry point를 낮춥니다.

제한 사항 및 최상의 결과를 위한 팁

강력하지만 AnimateDiff에는 constraints가 있습니다:

- Motion Scope: simple, training-data-aligned movements에 최적; complex actions는 tuning 필요 가능

- Artifacts: higher motions는 glitches 도입 가능—lower frame counts로 시작

- Length/Coherence: short clips(50 frames 미만)에서 excels; long videos는 inconsistency 위험

- Model Limits: SD v1.5 only; v2 compatibility 주시

Tips: action descriptors가 포함된 detailed prompts 사용(예: "slowly rotating camera"), styles를 위한 LoRAs 실험, Premiere와 같은 tools에서 post-process하여 polish. diffusion tech가 evolves함에 따라 AnimateDiff's community는 these를 refining하여 even smoother outputs를 promise합니다.

요약하면, AnimateDiff는 Stable Diffusion's image prowess와 smart motion prediction을 blending하여 animations 생성 방식을 revolutionizes합니다. AI video generation을 exploring하는 anyone에게 imagination을 motion으로 effortlessly turning하는 must-try tool입니다.

AnimateDiff 관련 태그