LMQL 개요

LMQL이란 무엇입니까?

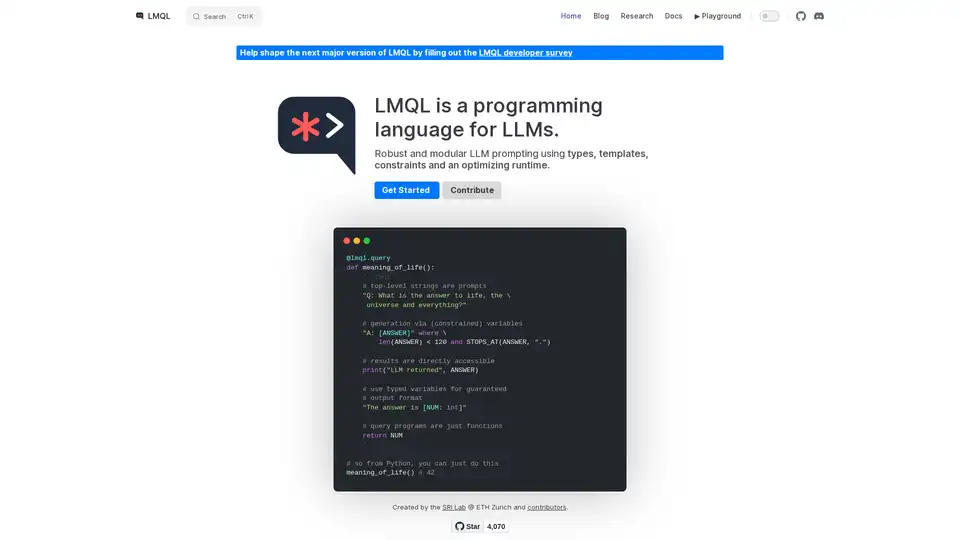

LMQL(Language Model Query Language)은 대규모 언어 모델(LLM)과의 상호 작용을 위해 특별히 설계된 프로그래밍 언어입니다. 유형, 템플릿, 제약 조건 및 최적화된 런타임을 활용하여 LLM 프롬프트에 대한 강력하고 모듈식인 접근 방식을 제공하여 안정적이고 제어 가능한 결과를 보장합니다. LMQL은 전통적인 프로그래밍 패러다임과 LLM의 확률적 특성 간의 간극을 해소하여 개발자가 더욱 정교하고 예측 가능한 AI 애플리케이션을 구축할 수 있도록 하는 것을 목표로 합니다.

LMQL은 어떻게 작동합니까?

LMQL은 개발자가 변수, 제약 조건 및 제어 흐름을 통합하여 프롬프트를 코드로 정의할 수 있도록 함으로써 작동합니다. 이 접근 방식은 덜 구조적이고 관리하기 어려울 수 있는 기존의 문자열 기반 프롬프트와 대조됩니다. 다음은 주요 LMQL 기능 분석입니다.

- 타입 변수: LMQL을 사용하면 특정 데이터 유형(예:

int,str)을 가진 변수를 정의하여 LLM의 출력이 예상되는 형식에 부합하는지 확인할 수 있습니다. 이 기능은 구조화된 데이터가 필요한 애플리케이션을 구축하는 데 중요합니다. - 템플릿: LMQL은 템플릿을 지원하여 재사용 가능한 프롬프트 구성 요소를 만들 수 있습니다. 템플릿은 변수로 매개변수화할 수 있으므로 동적 프롬프트를 쉽게 생성할 수 있습니다.

- 제약 조건: LMQL을 사용하면 LLM의 출력에 최대 길이 또는 특정 키워드와 같은 제약 조건을 지정할 수 있습니다. 이러한 제약 조건은 LMQL 런타임에 의해 적용되어 LLM의 응답이 요구 사항을 충족하는지 확인합니다.

- 중첩된 쿼리: LMQL은 중첩된 쿼리를 지원하여 프롬프트를 모듈화하고 프롬프트 구성 요소를 재사용할 수 있습니다. 이 기능은 LLM과의 여러 단계의 상호 작용이 필요한 복잡한 작업에 특히 유용합니다.

- 다중 백엔드: LMQL은 자동으로 LLM 코드를 여러 백엔드에서 이식할 수 있도록 합니다. 한 줄의 코드로 이들 간에 전환할 수 있습니다.

예제

@lmql.query

def meaning_of_life():

'''lmql

# top-level strings are prompts

"Q: What is the answer to life, the \

universe and everything?"

# generation via (constrained) variables

"A: [ANSWER]" where \

len(ANSWER) < 120 and STOPS_AT(ANSWER, ".")

# results are directly accessible

print("LLM returned", ANSWER)

# use typed variables for guaranteed

# output format

"The answer is [NUM: int]"

# query programs are just functions

return NUM

'''

## so from Python, you can just do this

meaning_of_life() # 42

LMQL 사용 방법

설치:

pip를 사용하여 LMQL을 설치합니다.

pip install lmql쿼리 정의:

@lmql.query데코레이터를 사용하여 LMQL 쿼리를 작성합니다. 이러한 쿼리에는 프롬프트, 변수 및 제약 조건이 포함될 수 있습니다.쿼리 실행:

일반 Python 함수처럼 LMQL 쿼리를 실행합니다. LMQL 런타임은 LLM과의 상호 작용을 처리하고 지정된 제약 조건을 적용합니다.

결과 액세스:

LMQL 쿼리에 정의된 변수를 통해 LLM의 출력에 액세스합니다.

LMQL을 선택하는 이유

- 강력성: LMQL의 유형 및 제약 조건은 LLM의 출력이 안정적이고 일관적인지 확인하는 데 도움이 됩니다.

- 모듈성: LMQL의 템플릿 및 중첩된 쿼리는 코드 재사용 및 모듈성을 촉진합니다.

- 이식성: LMQL은 여러 LLM 백엔드에서 작동하므로 다른 모델 간에 쉽게 전환할 수 있습니다.

- 표현력: LMQL의 Python 통합을 통해 Python의 모든 기능을 활용하여 프롬프트 구성 및 사후 처리를 수행할 수 있습니다.

LMQL은 누구를 위한 것입니까?

LMQL은 LLM 동작에 대한 정확한 제어가 필요한 AI 애플리케이션을 구축하려는 개발자에게 적합합니다. 특히 다음과 같은 작업에 유용합니다.

- 데이터 추출: 텍스트에서 구조화된 데이터를 추출합니다.

- 코드 생성: 자연어 설명을 기반으로 코드를 생성합니다.

- 챗봇: 예측 가능하고 일관된 응답으로 챗봇을 구축합니다.

- 질문 응답: 구조화된 지식을 기반으로 질문에 답변합니다.

LMQL을 사용하면 개발자는 LLM의 강력한 기능을 활용하여 더욱 안정적이고 모듈화되며 이식 가능한 AI 애플리케이션을 구축할 수 있습니다.

LMQL을 사용하는 가장 좋은 방법은 설명서를 확인하고 간단한 예제부터 시작한 다음 필요에 맞게 프롬프트의 복잡성을 점진적으로 늘리는 것입니다.

LMQL 관련 태그