Comparação Aprofundada e Guia de Seleção para Frameworks de Agentes AI Principais (LangChain vs. LangGraph vs. CrewAI vs. AutoGen vs. Semantic Kernel, 2026)

Com os avanços contínuos nas capacidades dos Large Language Models (LLM), os Agentes AI estão a transitar da prova de conceito para a implementação de nível industrial. Só entre 2023 e 2024, o número de frameworks de Agentes AI de código aberto cresceu várias vezes, com mais de 20.000 repositórios relacionados a "Agentes AI" a aparecerem agora no GitHub. Para desenvolvedores, líderes técnicos e empreendedores, escolher entre soluções como LangChain, AutoGen e CrewAI tornou-se a decisão principal na construção de aplicações de AI. Deve-se priorizar o ecossistema mais maduro ou uma arquitetura mais clara e controlável? Procura um protótipo rápido ou estabilidade de engenharia a longo prazo e escalabilidade empresarial?

Este artigo visa fornecer um "roteiro de seleção claro e acionável" para esta decisão. Com base em dados públicos e tendências da comunidade até dezembro de 2025, realizaremos uma comparação horizontal sistemática de cinco frameworks de Agentes AI principais em múltiplas dimensões: paradigmas de design central, complexidade de engenharia, maturidade do ecossistema, feedback de projetos do mundo real e o equilíbrio entre desempenho e custo. Este guia vai além de uma mera lista de recursos, combinando cenários de negócios específicos, tamanhos de equipa e formações técnicas para destilar uma metodologia repetível para a seleção de frameworks.

O conteúdo deste artigo baseia-se na experiência prática da nossa equipa em projetos como sistemas de automação de conteúdo, o site de navegação de ferramentas AI NavGood e agentes de processos corporativos internos. O nosso objetivo é preencher a lacuna entre conceitos, engenharia e necessidades de negócios para ajudá-lo a encontrar o produto ou framework de Agente AI certo durante esta fase crítica de aceleração da adoção de Agentes AI em 2026.

Público-alvo recomendado:

- Entusiastas de tecnologia e aprendizes iniciantes

- Decisores empresariais e líderes de negócios

- Utilizadores em geral interessados nas futuras tendências da AI

Índice:

- Parte 1: Visão Geral do Panorama dos Frameworks de Agentes AI

- Parte 2: Comparação Aprofundada dos Cinco Frameworks Principais

- Parte 3: Análise Detalhada do Framework

- Parte 4: Guia de Seleção Prático

- Parte 5: Considerações de Desempenho e Custo

- Parte 6: Tendências Futuras (2025–2026)

- Conclusão: Não Existe um Framework "Melhor", Apenas a Escolha "Certa"

- Perguntas Frequentes (FAQ)

- Recursos

Parte 1: Visão Geral do Panorama dos Frameworks de Agentes AI

O que é um Framework de Agente AI?

Um framework de Agente AI é uma coleção de ferramentas e bibliotecas projetadas para simplificar o processo de construção de agentes inteligentes baseados em LLMs que possuem autonomia, planeamento, uso de ferramentas e capacidades de memória. O seu valor central reside em abstrair as capacidades universais exigidas por um Agente — como planeamento Chain-of-Thought, gestão de memória de curto/longo prazo, orquestração de chamadas de ferramentas e colaboração multiagente — em módulos reutilizáveis. Isso permite que os desenvolvedores se concentrem na lógica de negócios em vez de construir fluxos de estado e controlo complexos do zero.

As Três Fases da Evolução dos Frameworks de Agentes AI

- Fase Experimental Inicial (2022 - Início de 2023): Representada por LangChain e BabyAGI. Caracterizada pela prova de conceito, introduzindo a lógica de "Chain" nas aplicações LLM. Resolveu problemas básicos de chamada de ferramentas e memória, mas tinha uma arquitetura relativamente simples.

- Fase de Refinamento de Recursos (2023 - 2024): À medida que as aplicações se aprofundavam, a procura por fluxos de trabalho complexos aumentou. Representados por LangGraph, CrewAI e AutoGen, os frameworks começaram a enfatizar a gestão de estado, orquestração visual, colaboração baseada em funções e agendamento de conversas, evoluindo de cadeias lineares simples para paradigmas mais complexos como grafos e equipas.

- Maturidade e Especialização do Ecossistema (2025 - Presente): Os frameworks começaram a diferenciar-se e a integrar-se profundamente com serviços de nuvem e pilhas de TI empresariais. O foco mudou para a prontidão para produção, otimização de desempenho, segurança, conformidade e experiências de baixo código. A expansão do Semantic Kernel e do Haystack no mercado empresarial é um marco desta fase.

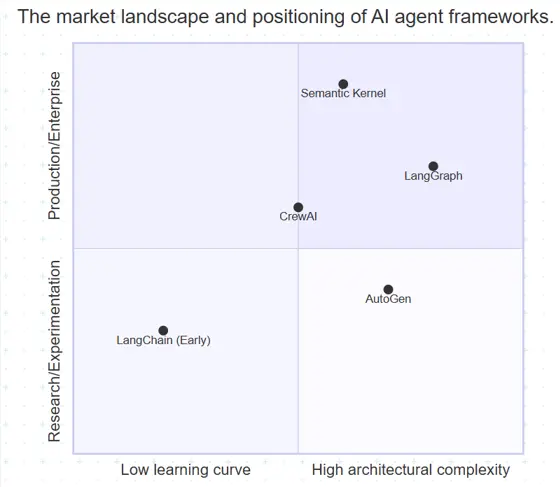

Panorama Atual do Mercado de Agentes AI

O mercado atual apresenta uma estrutura de "um líder, muitos desafiantes". O diagrama seguinte ilustra os nichos e relações dos frameworks principais:

- Líder: O LangChain detém a vantagem de ser o primeiro a mover-se e a maior comunidade, oferecendo o ecossistema mais completo de ferramentas, integrações e bases de conhecimento. Continua a ser a escolha principal para muitos desenvolvedores.

- Desafiantes Fortes: O CrewAI destaca-se em cenários de colaboração em equipa com o seu modelo intuitivo "Função-Tarefa-Processo"; o AutoGen construiu um fosso profundo na orquestração e pesquisa de conversas multiagente.

- Evoluidores de Ecossistema: O LangGraph, como uma "atualização" dentro do ecossistema LangChain, foca-se na resolução de processos de negócios complexos e com estado, usando uma máquina de estado em grafo. Está a tornar-se o novo padrão para aplicações de alta complexidade.

- Atores Empresariais: O Semantic Kernel, apoiado pela Microsoft, integra-se profundamente com o Azure OpenAI e o ecossistema .NET, oferecendo vantagens naturais em segurança, observabilidade e integração com sistemas corporativos existentes.

Parte 2: Comparação Aprofundada dos Cinco Frameworks Principais

Dimensões de Comparação

Avaliamos estes frameworks em seis dimensões principais: Filosofia de Design (determina a mentalidade), Funcionalidades da Arquitetura (impacta a escalabilidade e manutenção), Curva de Aprendizagem (custo de integração da equipa), Vitalidade da Comunidade (capacidade de obter ajuda e garantir a evolução a longo prazo), Suporte Empresarial (crucial para a produção) e Desempenho (a base para aplicações em larga escala).

Tabela de Comparação Detalhada

| Dimensão de Característica | LangChain | LangGraph | CrewAI | AutoGen | Semantic Kernel |

|---|---|---|---|---|---|

| Posicionamento Central | Framework Geral de Aplicações AI | Framework de Fluxo de Trabalho Complexo Orientado a Estado | Framework de Colaboração em Equipa Orientado a Funções | Orquestração de Conversas Multiagente | Framework de Integração Empresarial de AI |

| Filosofia de Design | Modularidade "estilo LEGO" | Máquina de estado "fluxograma visual" | Sinergia de funções "estrutura de empresa" | Orquestração de conversas "estilo chat em grupo" | Planeamento e execução de "competências baseadas em plugins" |

| Arquitetura Central | Chains, Agents, Tools | Grafo de Estado, Nós, Arestas | Agent, Task, Process, Crew | ConversableAgent, GroupChat | Plugins, Planners, Memories |

| Curva de Aprendizagem | Moderada: Muitos conceitos, mas ecossistema rico | Moderada-Alta: Requer compreensão de estado/loops | Baixa: Conceitos intuitivos e diretos | Alta: Configuração flexível mas complexa | Moderada: Conceitos claros, precisa de familiaridade com o ecossistema |

| Estrelas no GitHub | ~ 122k+ (2025.12) | ~ 22.3k+ (2025.12) | ~ 41.5k+ (2025.12) | ~ 52.7k+ (2025.12) | ~ 26.9k+ (2025.12) |

| Documentação/Comunidade | Excelente, muitos tutoriais | Boa, a melhorar rapidamente | Excelente, casos de uso ricos | Moderada, muito focada em API | Excelente, documentação de nível empresarial |

| Suporte Multiagente | Básico, requer orquestração manual | Nativo e Excelente, estrutura de grafo natural | Característica Central, construído para colaboração | Característica Central, especializada em conversas | Alcançado via combinações de Planner |

| Ferramentas/Integração | Extremamente Rica, cobre todos os principais serviços | Depende de LangChain, foca-se no fluxo | Boa, foca-se em ferramentas comuns | Boa, suporta personalização | Ecossistema Microsoft Profundo (Azure, Copilot) |

| Depuração Visual | Limitada (LangSmith) | Vantagem Forte, execução visual | Visualização básica de processos | Requer ferramentas de terceiros | Fornecida via serviços Azure |

| Recursos Empresariais | Via LangSmith/LangServe | Alta, suporta rastreamento de lógica complexa | Moderada | Mais baixa, orientada à pesquisa | Muito Alta, segurança, monitorização, conformidade |

| Melhor Cenário | Protótipos rápidos, educação, componentes personalizados | Suporte ao cliente, fluxos de aprovação, ETL fluxos de trabalho complexos | Criação de conteúdo, análise de mercado, tarefas baseadas em equipa | Pesquisa académica, debates complexos, simulações | Indústrias de alta conformidade (Finanças/Saúde) |

Fontes de Dados:

https://github.com/langchain-ai/langchain

https://github.com/langchain-ai/langgraph

https://github.com/crewaiinc/crewai

https://github.com/microsoft/autogen

https://github.com/microsoft/semantic-kernel

Paradigmas de Design Principais por Trás dos Frameworks

As diferenças entre os frameworks resultam dos seus paradigmas de design subjacentes:

| Paradigma Arquitetural | Ideia Central | Framework Representativo | Prós | Contras |

|---|---|---|---|---|

| Chain / Pipeline | Quebra tarefas em "cadeias" de execução linear | LangChain (Inicial) | Simples e intuitivo | Difícil de lidar com loops/ramificações |

| Graph / State Machine | Usa nós e arestas para formar fluxos de trabalho com estado | LangGraph | Poderoso/flexível, perfeito para lógica complexa | Alta curva de aprendizagem e complexidade de design |

| Role-based Collaboration | Atribui funções/tarefas claras aos Agentes para simular uma equipa | CrewAI | Modelação natural, fácil divisão de trabalho | Menos flexível para fluxos lineares estritos que grafos |

| Conversation-Oriented | Usa o "Diálogo" como mecanismo central para a interação do Agente | AutoGen | Ideal para negociação ou comunicação iterativa | Fluxo de execução imprevisível, difícil de depurar |

| Plugin / Skill-based | Encapsula capacidades como plugins, chamados dinamicamente por um Planner | Semantic Kernel | Desacoplado, fácil de estender e integrar | Requer um Planner poderoso; desafios de desempenho |

Parte 3: Análise Detalhada do Framework

LangChain: O Framework Geral Mais Completo

Vantagem Principal: O ecossistema é o seu maior trunfo. Possui a documentação mais abrangente, os tutoriais da comunidade mais ricos e as integrações de terceiros mais abundantes (centenas de integrações oficiais e comunitárias que cobrem as principais bases de dados, lojas de vetores e serviços SaaS). O seu design modular permite que os desenvolvedores montem protótipos como peças de LEGO.

Aplicações Típicas:

- Prova de Conceito Rápida: Por exemplo, construir um bot de perguntas e respostas baseado em documentos privados numa única tarde.

- Aprendizagem de Princípios de Agentes AI: Devido à sua modularidade clara, é o melhor "manual" para entender conceitos como Tools, Memory e Chains.

- Necessidades Altamente Personalizadas: Quando precisa de personalizar profundamente um link específico (como um método de indexação de memória único), as interfaces de baixo nível do LangChain tornam isso possível.

Nota: A "abrangência" traz complexidade. Pode parecer pesado para fluxos de trabalho simples e fixos. O seu executor Agent pode ter dificuldades com loops multi-passos extremamente complexos; nesses casos, considere o LangGraph.

Nos nossos testes de NavGood para scripts de automação, inicialmente tentámos lidar com uma lógica de scraping de 10 passos com um Agent padrão do LangChain. Descobrimos que, devido à natureza de "caixa preta" das Chains, uma vez que um passo intermédio falhava, a recuperação do estado era difícil. Isso levou-nos a migrar a nossa lógica central para o LangGraph.

LangGraph: A Melhor Escolha para Processos de Negócio Complexos

Vantagem Principal: Gestão de estado e visualização. Abstrai todo o sistema de Agente num grafo direcionado onde cada nó é uma função ou sub-agente, e as arestas definem as condições para a transição de estado. Isso permite que os desenvolvedores modelem claramente processos de negócios que envolvem loops, ramificações condicionais, paralelismo e estados de espera.

Relação com LangChain: É um "componente de alto nível" do ecossistema LangChain, especificamente projetado para abordar as deficiências do LangChain em fluxos de trabalho complexos e com estado. As suas cadeias de ferramentas e interfaces de modelo são totalmente compatíveis.

Casos de Uso:

- Tratamento de Pedidos de Serviço ao Cliente: Encaminhamento baseado na intenção do utilizador (devoluções, perguntas, reclamações), com potencial ida e volta entre nós.

- Processos de Aprovação Multi-passos: Simular "Enviar → Aprovação do Gestor → Aprovação Financeira → Arquivar", onde a rejeição em qualquer fase requer o retorno para modificação.

- Pipelines de Processamento de Dados: Executar um pipeline "Scrape → Limpar → Validar → Analisar → Relatar" com novas tentativas ou ramos de exceção.

Nota: Requer uma mudança do pensamento em "cadeia" para o pensamento em "grafo". Projetar um bom Schema de Estado é fundamental; um design deficiente leva ao caos.

Os iniciantes muitas vezes amontoam todos os resultados intermédios, contextos e logs num único objeto State, tornando-o pesado. A nossa sugestão: divida o State em "Core Business State" e "Temporary Calculation Data", mantendo apenas informações essenciais entre nós no State.

CrewAI: A Escolha para Colaboração em Equipa

Vantagem Principal: Abstração orientada por funções. Usa Agent (definição de funções, objetivos, histórias), Task (definição de objetivos, saída esperada) e Crew (organização de Agentes e Tarefas com um Process definido, como sequencial ou paralelo). Isso espelha de perto como os humanos colaboram em equipas.

Conceito Único: O modo hierarchical em Process permite que um Agent "Gestor" coordene Agents "Trabalhadores", perfeito para simular hierarquias corporativas.

Casos de Uso:

- Equipa de Criação de Conteúdo: Planeador (gera o esboço), Escritor (redige), Editor (aprimora) e Gestor de Publicação (formatação) a trabalhar em sincronia.

- Relatórios de Análise de Mercado: Pesquisadores, Analistas de Dados, Sumarizadores de Insights e Criadores de PPT a concluir tarefas em cadeia.

- Gestão Ágil de Projetos: Agentes de Gestor de Produto, Dev e QA a simular um processo de sprint.

Nota: O seu processo é relativamente estruturado. Para cenários que exigem um diálogo extremamente livre e dinâmico (como um debate aberto), pode não ser tão flexível quanto o AutoGen.

Um erro comum é definir grandes descrições de funções (por exemplo, "Especialista Sênior em Mercado") sem responsabilidades específicas ou restrições de saída, levando a desvios nos resultados. Sugestão: defina claramente "Input → Output Format → Criteria" dentro do Agent, e mantenha o expected_output para Tasks estruturado (por exemplo, modelos Markdown ou campos JSON).

AutoGen: A Escolha para Pesquisa de Conversas Multiagente

Vantagem Principal: Flexibilidade na orquestração de conversas e profundidade de pesquisa. O coração do AutoGen é o ConversableAgent, que colabora enviando mensagens. Oferece ricos padrões de conversação (como GroupChat com GroupChatManager) e Human-in-the-loop personalizáveis, tornando-o ideal para pesquisa exploratória de interação multiagente. Notavelmente, a revisão da Microsoft em 2025 (AutoGen 0.4+ ou Magentic-One) introduziu suporte multimodal nativo e a interface visual AutoGen Studio.

Casos de Uso:

- Pesquisa Académica: Simular múltiplos especialistas em AI com diferentes formações a discutir um problema.

- Sistemas de Diálogo Complexos: Construir NPCs de RPG imersivos ou histórias interativas que exigem múltiplos papéis de AI.

- Geração e Revisão de Código: Criar um Agente "Programador" e um Agente "Revisor" que otimizam o código através de diálogo multi-turno.

Nota: A configuração e depuração são complexas. Inclina-se mais para a exploração e interação do que para pipelines fixos, exigindo restrições de engenharia adicionais para tarefas de produção determinísticas.

Evite "loops infinitos" onde os Agentes continuam a questionar-se sem um término claro. Sugestão: defina um max_round ou função de término clara, e use um "Agente Sumarizador" para convergir para uma conclusão.

Semantic Kernel: A Escolha Estável para Integração Empresarial

Vantagem Principal: Recursos de nível empresarial e integração perfeita com a Microsoft. Desenvolvido pela Microsoft, suporta nativamente Azure OpenAI, Azure AI Search e outros serviços de nuvem, destacando-se em segurança, autenticação e observabilidade (via Azure Monitor). O seu SDK multi-linguagem (Python, C#, Java) é uma ferramenta poderosa para grandes empresas unificarem o desenvolvimento de AI em pilhas tecnológicas heterogéneas. Em 2025, o Semantic Kernel enfatizou o conceito de "Agentic SDK", focando na segurança de transações distribuídas.

Conceitos Principais: Plugin (competências que contêm Functions), Planner (planeia automaticamente quais competências chamar) e Memory (armazenamento de vetores).

Casos de Uso:

- Transformação Digital Empresarial: Envolver APIs de CRM/ERP existentes em

Plugins, permitindo que os Agentes AI operem com segurança nos dados de negócios. - Construção de Copilots Internos: Integração profunda com o Microsoft 365 para fornecer assistentes inteligentes para funcionários.

- Indústrias de Alta Conformidade: Finanças e Saúde, onde o controlo de acesso rigoroso, logs de auditoria e governação de dados são obrigatórios.

Nota: Se a sua equipa não estiver ligada ao ecossistema Microsoft (.NET, Azure), algumas das suas vantagens podem ser perdidas. A comunidade é menor do que os frameworks liderados por Python mencionados acima.

Parte 4: Guia de Seleção Prático

Para escolher rapidamente o framework certo entre estes cinco, pode usar uma árvore de decisão ou considerar as competências da equipa, a fase do projeto e a escalabilidade futura.

Árvore de Decisão: Com Base nas Suas Necessidades Centrais

Primeiro, pergunte-se: Qual é o problema central que estou a resolver com um Agente AI?

- A necessidade é "validar rapidamente uma ideia de AI" ou "aprendizagem de nível inicial"?

- Sim → Escolha LangChain. Ecossistema rico, fácil de encontrar exemplos.

- Não → Vá para a próxima pergunta.

- O cenário central é "simular uma equipa (por exemplo, Marketing, P&D) para concluir tarefas"?

- Sim → Escolha CrewAI. O seu modelo função-tarefa é o mais adequado.

- Não → Vá para a próxima pergunta.

- O cenário central é "construir um processo de negócio com lógica complexa, loops e estado" (por exemplo, aprovações, tickets)?

- Sim → Escolha LangGraph. Máquinas de estado em grafo são a arma definitiva aqui.

- Não → Vá para a próxima pergunta.

- O cenário central é "pesquisar diálogo/debates multiagente ou exigir interação altamente flexível"?

- Sim → Escolha AutoGen.

- Não → Vá para a próxima pergunta.

- O seu projeto está dentro da pilha Microsoft, ou tem requisitos extremos de segurança e conformidade?

- Sim → Escolha Semantic Kernel.

- Não → Retorne ao passo 1 ou comece com LangChain/CrewAI.

Seleção por Equipa e Fase do Projeto

| Framework | Recomendado Para | Não Recomendado Para |

|---|---|---|

| LangChain | Aprendizagem pessoal, protótipos de startups, POCs que exigem muitas integrações. | Fluxos de trabalho de produção extremamente complexos e com lógica de estado rigorosa. |

| LangGraph | Equipas de médio a grande porte que desenvolvem fluxos de negócios complexos (por exemplo, pedidos de e-commerce, auditorias de risco). | Scripts simples pontuais ou cenários onde o fluxo visual é irrelevante. |

| CrewAI | Projetos focados em "divisão de funções" e "produção em equipa" (por exemplo, criação de conteúdo). | Controlo detalhado do raciocínio interno ou fluxos altamente não lineares e dinâmicos. |

| AutoGen | Laboratórios académicos que exploram mecanismos multiagente ou sistemas de diálogo experimentais. | Saída estável e previsível para tarefas de produção. |

| Semantic Kernel | Grandes empresas que usam .NET/C# e Azure com fortes necessidades de segurança/auditoria. | Desenvolvedores individuais ou startups que procuram velocidade máxima e suporte da comunidade. |

Recomendações de Seleção Rápida

Para prototipagem rápida: LangChain

Para fluxos de trabalho complexos: LangGraph

Para colaboração em equipa: CrewAI

Para pesquisa de conversas multiagente: AutoGen

Para sistemas de nível empresarial: Semantic Kernel

Parte 5: Considerações de Desempenho e Custo

Em sistemas de Agentes AI, o desempenho depende não apenas do framework, mas das chamadas de modelo LLM, estratégia de fluxo de trabalho, complexidade da tarefa e arquitetura de implantação.

Benchmarks de Desempenho e Comportamento no Mundo Real

As Chamadas de LLM são o Principal Gargalo: O número de chamadas de LLM e o comprimento do contexto são os principais fatores que afetam o desempenho e o custo. Para tarefas simples, as diferenças de desempenho do framework são negligenciáveis; o gargalo é a latência do LLM e o consumo de tokens.

Por outras palavras, em processos simples como "gerar conteúdo numa etapa → uma chamada de ferramenta → retornar resultado", é difícil ver claramente as diferenças de desempenho do próprio framework.

O Comportamento do Framework Impacta o Custo em Cenários Complexos:

O LangGraph reduz chamadas redundantes através de gestão explícita de estado e fluxos de trabalho DAG, diminuindo os custos de tokens e tempo durante a recuperação de erros.

O fluxo hierárquico do CrewAI pode gerar chamadas extras quando os Agentes trocam feedback ou coordenam etapas.

O

Plannerdo Semantic Kernel tende a planear antes de cada divisão de tarefa, o que pode criar "hotspots" de chamadas de modelo extras que podem ser ineficientes para fluxos simples e fixos.

Custos de Desenvolvimento e Manutenção

Classificação da Curva de Aprendizagem (Feedback da Comunidade): AutoGen > LangGraph ≈ Semantic Kernel > LangChain > CrewAI

Isso reflete um espectro que varia do mais complexo ao mais fácil de usar: o AutoGen oferece alta flexibilidade, mas tem uma alta barreira de entrada em termos de configuração e depuração; o CrewAI, devido à sua abstração de funções, é mais intuitivo e fácil para iniciantes.

Manutenção:

LangChain e CrewAI são intuitivos para tarefas de média a simples, tornando-os mais fáceis para colaboração em equipa ou transferências.

O LangGraph pode tornar-se difícil de manter se o grafo se tornar massivo com muitos nós/ramificações sem documentação adequada.

O Semantic Kernel frequentemente requer experiência em infraestrutura existente (Azure DevOps, conformidade de segurança).

Implantação em Nuvem e Custos de Execução

Cold Start e Consumo de Memória: A camada de abstração de runtime do próprio framework irá inevitavelmente afetar o uso de memória. Designs mais leves (como chamar diretamente o SDK Python) geralmente têm cold starts mais rápidos, enquanto frameworks com módulos de estado ou Planner mais complexos podem exigir memória adicional.

Contentorização e Amigabilidade com Serverless: Atualmente, todos os principais frameworks estão a otimizar para implantação contentorizada (como Docker/Kubernetes) e modos serverless. Isso significa que os custos podem ser ainda mais reduzidos através de isolamento de recursos, escalabilidade automática, etc., mas isso também depende de práticas de engenharia corretas.

Custos de Token e Modelo: Mesmo dentro do mesmo framework, os preços dos tokens de diferentes modelos variam significativamente — modelos mais poderosos como o GPT-4.1 são muito mais caros do que as versões mais leves (consulte a comparação de custos para 2023–2025). Escolher o modelo certo e controlar o comprimento do contexto são passos chave na otimização de custos.

Parte 6: Tendências Futuras (2025–2026)

À medida que a tecnologia de agentes AI continua a amadurecer, o ecossistema está gradualmente a evoluir de ferramentas e frameworks únicos para um sistema arquitetural em maior escala, mais autónomo, mais especializado e mais engenheirado. As seguintes são várias tendências chave a observar em 2025–2026:

1. Integração de Frameworks e o Surgimento de uma "Camada de Meta-Coordenação"

O ecossistema de Agentes AI está a evoluir de "frameworks individuais a operar isoladamente" para "interconectividade e governação unificada". O futuro provavelmente verá o surgimento de uma "camada de meta-coordenação" capaz de agendar, monitorizar e coordenar diferentes pilhas de Agentes entre frameworks, permitindo que as empresas partilhem dados, estratégias de execução e políticas de segurança em diferentes motores de Agentes. Por exemplo, a empresa de consultoria PwC lançou uma plataforma de middleware que pode coordenar agentes de diferentes fontes; este tipo de "SO de Agente AI" está a tornar-se um componente chave das arquiteturas multiagente empresariais.

2. Orquestração Low-Code/Visual Tornar-se-á Padrão

Reduzir a barreira de entrada para o uso de Agentes AI é crucial para a adoção generalizada. Ferramentas de orquestração low-code e visuais — não apenas interfaces simples de arrastar e largar, mas aquelas que integram fluxos de trabalho de tarefas, visualização de máquinas de estado, ferramentas de depuração e avisos automáticos de erros — estão a crescer rapidamente no mercado. Por exemplo, ferramentas de Agent Builder de arrastar e largar do GitHub e outras plataformas prometem permitir que os desenvolvedores construam fluxos de trabalho de agentes complexos sem programação extensiva. Esta tendência transformará os Agentes AI de uma ferramenta especializada para equipas de engenharia numa plataforma de produtividade acessível a equipas de negócios e de produto, impulsionando uma adoção mais ampla em vários cenários de negócios.

3. Ascensão de Frameworks e Soluções de Agentes AI Específicos para Verticais

Embora os frameworks gerais sejam importantes, diferentes indústrias verticais têm necessidades variadas em relação à conformidade, segurança e recursos específicos do cenário. Esperamos ver mais frameworks ou plataformas de Agentes AI específicos da indústria, como soluções dedicadas para agentes de conformidade financeira, assistentes inteligentes médicos, agentes de documentos legais e automação de processos de fabrico/jogos. Estes frameworks serão mais maduros em termos de conhecimento de indústria incorporado, motores de regras e mecanismos de auditoria.

4. Integração Profunda com Paradigmas de Desenvolvimento Nativos de AI

No futuro, os Agentes AI deixarão de ser recursos adicionados a aplicações tradicionais, mas tornar-se-ão o paradigma fundamental para o desenvolvimento de aplicações nativas de AI. Isso significa que os frameworks de Agentes serão mais estritamente integrados com conceitos como programação de fluxo de trabalho, sistemas orientados a eventos, técnicas de engenharia de prompts (como ReAct, Chain-of-Thought reasoning, etc.), e interfaces unificadas para diferentes modalidades de dados (texto, imagens, dados estruturados). Esta evolução impulsionará a transformação de Agentes de "executores de tarefas" para "componentes de negócios inteligentes", tornando-se a base central do desenvolvimento de aplicações de próxima geração.

5. Tendências Divergentes em Código Aberto e Comercialização

O ecossistema de agentes AI continuará a manter a sua vitalidade de inovação de código aberto, mas os frameworks principais também estão a acelerar o lançamento de versões comerciais e serviços geridos para atender às necessidades de nível empresarial. Por exemplo, os ecossistemas de frameworks maduros estão a ver o surgimento de módulos de serviço de valor acrescentado, como monitorização, hospedagem, escalabilidade automática, políticas de segurança e logs de auditoria. Este modelo de desenvolvimento é semelhante ao caminho de comercialização de software básico no passado. O lado do código aberto foca-se na inovação e expansão do ecossistema da comunidade, enquanto as versões comerciais servem utilizadores empresariais que exigem estabilidade, segurança e observabilidade.

6. Melhoria da Estandarização, Segurança e Mecanismos de Autorização de Agentes

À medida que várias indústrias começam a implantar Agentes AI em ambientes de produção, os mecanismos de segurança e autorização tornar-se-ão um foco técnico chave. Os Agentes atuais requerem protocolos de autorização mais seguros e controláveis ao aceder a sistemas externos e dados de utilizador, impulsionando a formação gradual de novos padrões (como autenticação unificada de API, sandboxes seguras e ambientes de execução confiáveis). Para implantações de nível empresarial, estes mecanismos de padronização tornar-se-ão indicadores importantes para avaliar a seleção e as capacidades de implementação do framework.

7. Rápido Crescimento do Mercado e Pressão de Integração de Projetos

Analistas da indústria preveem que, embora muitos projetos de Agentes AI possam ser abandonados devido a problemas de custo e modelo de negócio, a procura geral do mercado e o entusiasmo de investimento pela tecnologia de Agentes continuarão a crescer de 2026 a 2028. Mais e mais empresas planeiam incorporar Agentes AI nos seus processos de negócios centrais, impulsionando uma mudança da "fase piloto" para a "fase de aplicação em larga escala."

Conclusão: Não Existe um Framework "Melhor", Apenas a Escolha "Certa"

O mundo dos Agentes AI está a evoluir rapidamente. Escolher um framework é essencialmente escolher uma mentalidade para construir sistemas inteligentes complexos.

O nosso conselho final:

- Defina o Cenário Central: Mapeie o seu fluxo de trabalho de Agente ideal antes de escolher uma ferramenta.

- Valide Rapidamente: Use 1-2 semanas para implementar um módulo central num framework candidato para testar a experiência.

- Avalie a Equipa e o Ecossistema: Considere a sua formação técnica e as integrações necessárias.

- Olhe para o Futuro: Garanta que o roteiro do framework se alinha com a direção do seu produto.

Compreender profundamente a filosofia de design de qualquer framework e começar a construir é mais valioso do que esperar por um "perfeito".

Perguntas Frequentes (FAQ)

P1: Devo aprender primeiro LangChain ou LangGraph? Recomenda-se dominar primeiro os conceitos centrais do LangChain (Tools, Chains, Agents), pois esta é a base. Aprenda LangGraph quando precisar de construir fluxos de trabalho complexos. Eles são complementares.

P2: Qual framework é melhor para uma empresa startup? CrewAI ou LangChain. Se a sua ideia de produto envolve naturalmente "colaboração multiagente" (como uma empresa de AI), escolha CrewAI; se precisa de iterar rapidamente e integrar-se com várias APIs, escolha LangChain.

P3: Quanto conhecimento de Python é necessário? É necessário pelo menos um nível intermédio de Python, incluindo familiaridade com programação assíncrona, decoradores e modelos Pydantic. Para Semantic Kernel, se usar a versão C#, precisará do conhecimento .NET correspondente.

P4: Estes frameworks podem ser usados num ambiente de produção? Sim, mas requer investimento adicional. LangGraph + LangSmith, CrewAI e Semantic Kernel têm bons recursos prontos para produção. A chave é ter mecanismos robustos de tratamento de erros, registo, monitorização e reversão.

P5: Existem documentação e suporte da comunidade em Português? LangChain e CrewAI têm comunidades em Português relativamente ativas (por exemplo, colunas no Zhihu, blogs técnicos, grupos WeChat). Os recursos em Português para LangGraph e AutoGen estão a crescer rapidamente. Os recursos em Português para Semantic Kernel são principalmente fornecidos pela Microsoft.

P6: O custo de migrar entre frameworks é alto se a escolha inicial for errada? Sim, é bastante alto. Os paradigmas de design de diferentes frameworks variam significativamente, e a migração significa reescrever a parte central da orquestração da lógica de negócios. Portanto, a seleção inicial do framework é crucial. Recomenda-se começar com pequenos protótipos para verificar a adequação do framework.

Sobre o Autor

Este conteúdo é curado pela Equipa Editorial de NavGood. NavGood é uma plataforma dedicada ao ecossistema de ferramentas AI, acompanhando o desenvolvimento de Agentes AI e fluxos de trabalho automatizados.

Isenção de Responsabilidade: Este artigo não representa a posição oficial de nenhum framework e não constitui aconselhamento comercial ou de investimento. Os dados experimentais apresentados são baseados num ambiente de teste específico e são apenas para referência comparativa; os resultados reais num ambiente de produção podem diferir.

Recursos

- Links Oficiais:

LangChain

LangGraph

CrewAI

AutoGen

Semantic Kernel