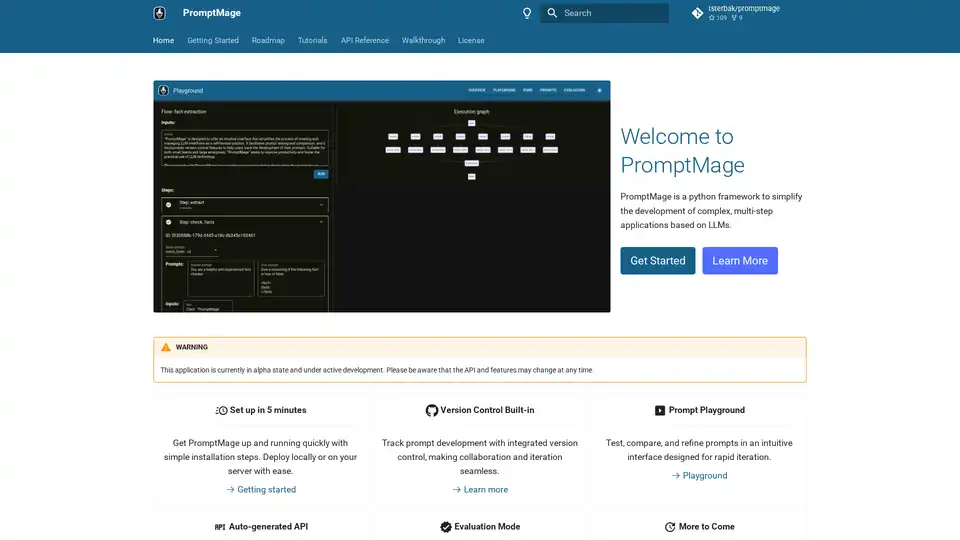

PromptMage

Visão geral de PromptMage

PromptMage: Simplificando o Desenvolvimento de Aplicações LLM

O que é PromptMage? PromptMage é um framework Python projetado para otimizar o desenvolvimento de aplicações complexas e de várias etapas baseadas em Large Language Models (LLMs). Ele fornece uma interface intuitiva para criar e gerenciar fluxos de trabalho LLM, tornando-o uma solução auto-hospedada valiosa para desenvolvedores, pesquisadores e organizações.

Principais Recursos e Benefícios:

- Gerenciamento Simplificado do Fluxo de Trabalho LLM: PromptMage simplifica a criação e o gerenciamento de fluxos de trabalho LLM com uma interface intuitiva.

- Teste e Comparação de Prompts: Facilita o teste e a comparação de prompts, permitindo que os usuários refinem os prompts para um desempenho ideal.

- Controle de Versão: Incorpora recursos de controle de versão, permitindo que os usuários rastreiem o desenvolvimento de seus prompts e colaborem de forma eficaz.

- API Autogerada: Aproveita uma API criada automaticamente e alimentada por FastAPI para fácil integração e implantação.

- Modo de Avaliação: Avalia o desempenho do prompt por meio de testes manuais e automáticos, garantindo a confiabilidade antes da implantação.

- Iteração Rápida: O playground de prompts permite testes, comparações e refinamentos rápidos de prompts.

- Colaboração Perfeita: O controle de versão integrado torna a colaboração e a iteração perfeitas.

- Fácil Integração e Implantação: Uma API criada automaticamente simplifica a integração e a implantação.

Como o PromptMage funciona?

PromptMage funciona fornecendo um conjunto de ferramentas e recursos que simplificam o processo de desenvolvimento e gerenciamento de aplicações baseadas em LLM. Estes incluem:

- Playground de Prompts: Uma interface web para testar e comparar prompts.

- Controle de Versão: Um sistema para rastrear as mudanças nos prompts ao longo do tempo.

- Geração de API: Uma ferramenta para gerar APIs automaticamente a partir de prompts.

- Modo de Avaliação: Um sistema para avaliar o desempenho dos prompts.

Funcionalidade Principal:

- Integração do Playground de Prompts: Integre perfeitamente o playground de prompts em seu fluxo de trabalho para uma iteração rápida.

- Prompts como Cidadãos de Primeira Classe: Trate os prompts como cidadãos de primeira classe com recursos de controle de versão e colaboração.

- Testes Manuais e Automáticos: Valide os prompts por meio de testes manuais e automáticos.

- Fácil Compartilhamento: Compartilhe os resultados facilmente com especialistas e stakeholders.

- API FastAPI: API integrada e criada automaticamente com FastAPI para fácil integração e implantação.

- Dicas de Tipo: Utilize dicas de tipo para inferência automática e validação mágica.

Para quem é o PromptMage?

PromptMage é adequado para:

- Desenvolvedores que criam aplicações alimentadas por LLM

- Pesquisadores que experimentam com LLMs

- Organizações que buscam otimizar seus fluxos de trabalho LLM

Casos de uso

- product-review-research: Uma aplicação web de AI construída com PromptMage para fornecer análises detalhadas de produtos, pesquisando avaliações online confiáveis.

Começando

Para começar com o PromptMage, você pode seguir estes passos:

- Instale o PromptMage usando o pip:

pip install promptmage - Explore a documentação e os tutoriais para aprender como usar o framework.

- Comece a construir sua aplicação LLM!

Por que escolher o PromptMage?

PromptMage é uma solução pragmática que preenche a lacuna atual no gerenciamento do fluxo de trabalho LLM. Ele capacita desenvolvedores, pesquisadores e organizações, tornando a tecnologia LLM mais acessível e gerenciável, apoiando assim a próxima onda de inovações em AI.

Ao usar o PromptMage, você pode:

- Aumentar a produtividade

- Melhorar a qualidade de suas aplicações LLM

- Facilitar a colaboração

- Acelerar a inovação

Contribuindo para o PromptMage

O projeto PromptMage agradece as contribuições da comunidade. Se você estiver interessado em melhorar o PromptMage, você pode contribuir das seguintes maneiras:

- Relatando Bugs: Envie um problema em nosso repositório, fornecendo uma descrição detalhada do problema e os passos para reproduzi-lo.

- Melhorar a documentação: Se você encontrar algum erro ou tiver sugestões para melhorar a documentação, envie um problema ou uma solicitação pull.

- Corrigir Bugs: Confira nossa lista de problemas abertos e envie uma solicitação pull para corrigir quaisquer bugs que você encontrar.

- Solicitações de Recursos: Tem ideias sobre como melhorar o PromptMage? Gostaríamos muito de ouvir você! Envie um problema, detalhando suas sugestões.

- Solicitações Pull: As contribuições por meio de solicitações pull são muito apreciadas. Certifique-se de que seu código adere aos padrões de codificação do projeto e envie uma solicitação pull com uma descrição clara de suas alterações.

Para mais informações ou dúvidas, você pode entrar em contato com os mantenedores do projeto em promptmage@tobiassterbak.com.

Melhores ferramentas alternativas para "PromptMage"

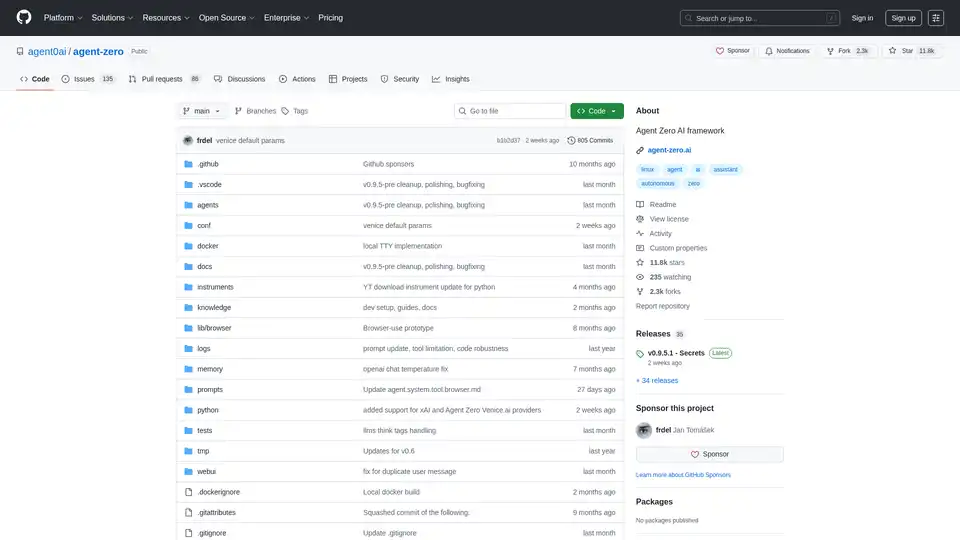

Agent Zero é um framework AI open source para construir agentes autónomos que aprendem e crescem organicamente. Possui cooperação multiagente, execução de código e ferramentas personalizáveis.

Parea AI é a plataforma definitiva de experimentação e anotação humana para equipes de IA, permitindo avaliação fluida de LLM, testes de prompts e implantação em produção para construir aplicativos de IA confiáveis.

Weco AI automatiza experimentos de aprendizado de máquina usando tecnologia AIDE ML, otimizando pipelines ML por meio de avaliação de código orientada por IA e experimentação sistemática para melhorar métricas de precisão e desempenho.

Lunary é uma plataforma de engenharia LLM de código aberto que fornece observabilidade, gestão de prompts e análises para construir aplicações de IA confiáveis. Oferece ferramentas para depuração, rastreamento de desempenho e garantia de segurança de dados.

Maxim AI é uma plataforma completa de avaliação e observabilidade que ajuda as equipes a implantar agentes de IA de forma confiável e 5 vezes mais rápido com ferramentas abrangentes de teste, monitoramento e garantia de qualidade.

Athina é uma plataforma colaborativa de IA que ajuda as equipes a construir, testar e monitorar recursos baseados em LLM 10 vezes mais rápido. Com ferramentas para gerenciamento de prompts, avaliações e observabilidade, garante a privacidade de dados e suporta modelos personalizados.

Roo Code é um assistente de codificação open-source impulsionado por IA para VS Code, com agentes de IA para edição de múltiplos arquivos, depuração e arquitetura. Suporta vários modelos, garante privacidade e se personaliza para um fluxo de trabalho eficiente.

Construa agentes personalizados orientados a tarefas para sua base de código que executam tarefas de engenharia com alta precisão, impulsionadas por inteligência e contexto de seus dados. Crie agentes para casos de uso como design de sistemas, depuração, testes de integração, onboarding, etc.

Latitude é uma plataforma de código aberto para engenharia de prompts, permitindo que especialistas de domínio colaborem com engenheiros para entregar recursos LLM de nível de produção. Construa, avalie e implemente produtos de IA com confiança.

Klu é uma plataforma de aplicativos LLM de última geração projetada para ajudar as equipes a iterar, avaliar e otimizar com confiança aplicativos baseados em LLM. Colabore em prompts, rastreie alterações e itere rapidamente com insights.

Parea AI é uma plataforma de experimentação e anotação de IA que ajuda as equipes a enviar aplicativos LLM com confiança. Oferece recursos para rastreamento de experimentos, observabilidade, revisão humana e implantação rápida.

Future AGI é uma plataforma unificada de observabilidade LLM e avaliação de agentes IA que ajuda empresas a alcançar 99% de precisão em aplicações de IA por meio de ferramentas abrangentes de teste, avaliação e otimização.

ModelFusion: Kit de ferramentas LLM completo para 2025 com calculadoras de custos, biblioteca de prompts e ferramentas de observabilidade de IA para GPT-4, Claude e muito mais.

Quixl: A plataforma de desenvolvimento de agentes de IA sem código capacita as organizações a aproveitar a IA generativa para impulsionar a eficiência e transformar as operações.