AniPortrait 概述

AniPortrait 是什么?

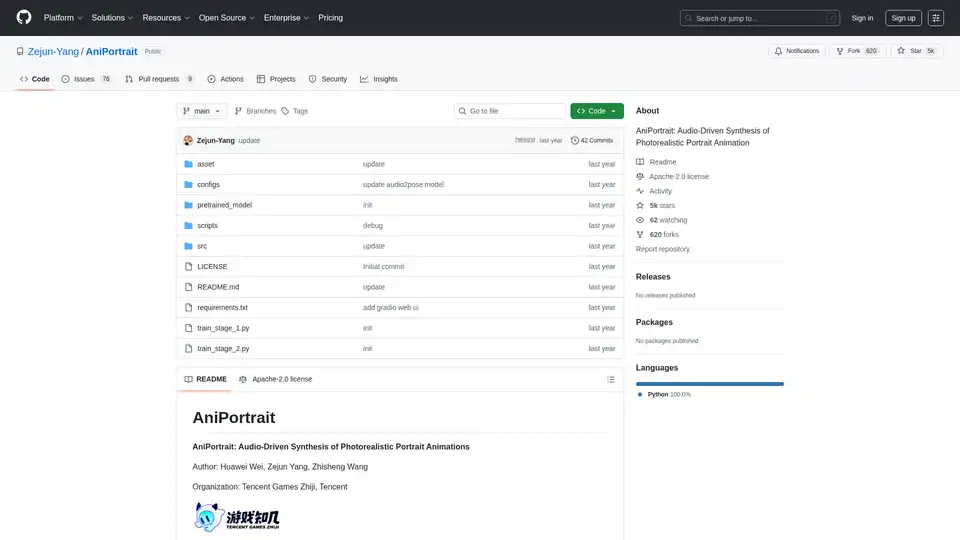

AniPortrait 是一个创新的开源框架,专为音频驱动的照片级真实肖像动画合成而设计。由华为魏、泽军杨和腾讯游戏智姬及腾讯的志胜王开发,该工具利用先进的 AI 技术,从单一参考图像和音频或视频输入创建高质量动画肖像。无论您是用语音音频动画化静态肖像,还是从源视频重演面部表情,AniPortrait 都能提供逼真的结果,捕捉唇同步和头部运动等细微差别。适合内容创作者、游戏开发者以及计算机视觉研究人员,它在 AI 视频生成工具领域脱颖而出,专注于肖像特定动画。

在 GitHub 上以 Apache-2.0 许可发布,AniPortrait 已获得超过 5,000 个星标,反映了其在 AI 社区的受欢迎程度。该项目强调可访问性,提供预训练模型、详细安装指南,甚至 Gradio Web UI 以便轻松测试。

AniPortrait 如何工作?

在其核心,AniPortrait 采用多阶段管道,集成扩散模型、音频处理和姿态估计来生成动画。该框架基于 Stable Diffusion V1.5 和 wav2vec2 等成熟模型进行特征提取,确保音频视觉同步的稳健处理。

关键组件和工作流程

- 输入处理:从参考肖像图像开始。对于音频驱动模式,使用 wav2vec2-base-960h 处理音频输入以提取语音特征。在视频模式中,通过关键点提取将源视频转换为姿态序列。

- 姿态生成:audio2pose 模型从音频生成头部姿态序列(例如 pose_temp.npy),实现对面部方向的控制。对于面部重演,姿态重定向策略将源视频中的运动映射到参考图像,支持显著的姿态差异。

- 动画合成:利用去噪 UNet、参考 UNet 和运动模块来合成帧。姿态引导器确保对齐,而可选的帧插值加速推理。

- 输出优化:生成如 512x512 分辨率的视频,使用 film_net_fp16.pt 等选项加速以减少处理时间。

这种模块化方法支持自驱动动画(使用预定义姿态)、面部重演(传输表情)和完全音频驱动合成,使其适用于各种 AI 肖像动画场景。

AniPortrait 的核心功能

AniPortrait 集成了多种强大功能,专为逼真肖像动画量身定制:

- 音频驱动肖像动画:将唇部运动和表情与音频输入同步,完美适用于配音或虚拟头像。

- 面部重演:将源视频的面部表演传输到目标肖像,适用于媒体中的深度伪造式伦理应用。

- 姿态控制和重定向:更新的策略处理多样头部姿态,包括生成自定义姿态文件以实现精确控制。

- 高分辨率输出:产生照片级真实视频,支持更长序列(最多 300 帧或更多)。

- 加速选项:帧插值和 FP16 模型加速推理,同时不牺牲质量。

- Gradio Web UI:用户友好的界面用于快速演示,也托管在 Hugging Face Spaces 上以便在线访问。

- 预训练模型:包括 audio2mesh、audio2pose 和扩散组件的权重,可从 Wisemodel 等来源下载。

这些功能使 AniPortrait 成为 AI 驱动视频合成的首选工具,通过专注于肖像保真度和音频视觉一致性超越基本工具。

安装和设置

对于使用 Python >=3.10 和 CUDA 11.7 的用户,入门非常简单:

- 克隆仓库:

git clone https://github.com/Zejun-Yang/AniPortrait。 - 安装依赖项:

pip install -r requirements.txt。 - 下载预训练权重到

./pretrained_weights/,包括 Stable Diffusion 组件、wav2vec2 和自定义模型如denoising_unet.pth和audio2pose.pt。 - 根据 README 中的目录结构组织文件。

对于训练,准备如 VFHQ 或 CelebV-HQ 数据集,通过提取关键点并运行预处理脚本。训练分为两个阶段,使用 Accelerate 进行分布式处理。

如何使用 AniPortrait?

推理模式

AniPortrait 通过命令行脚本支持三种主要模式:

自驱动动画:

python -m scripts.pose2vid --config ./configs/prompts/animation.yaml -W 512 -H 512 -acc使用参考图像或姿态视频自定义。将视频转换为姿态使用

python -m scripts.vid2pose --video_path input.mp4。面部重演:

python -m scripts.vid2vid --config ./configs/prompts/animation_facereenac.yaml -W 512 -H 512 -acc编辑 YAML 以包括源视频和参考。

音频驱动合成:

python -m scripts.audio2vid --config ./configs/prompts/animation_audio.yaml -W 512 -H 512 -acc在配置中添加音频和图像。通过移除 pose_temp 启用 audio2pose 以实现自动姿态生成。

对于头部姿态控制,使用 python -m scripts.generate_ref_pose 生成参考姿态。

Web 演示

启动 Gradio UI:python -m scripts.app。或在 Hugging Face Spaces 上尝试在线版本。

用户可以使用样本视频如 'cxk.mp4' 或 'jijin.mp4' 实验,以查看音频同步效果,这些样本来自 Bilibili 等平台。

从零训练 AniPortrait

高级用户可以训练自定义模型:

- 数据准备:下载数据集,使用

python -m scripts.preprocess_dataset预处理,并更新 JSON 路径。 - 阶段 1:

accelerate launch train_stage_1.py --config ./configs/train/stage1.yaml。 - 阶段 2:下载运动模块权重,指定阶段 1 检查点,并运行

accelerate launch train_stage_2.py --config ./configs/train/stage2.yaml。

此过程在肖像特定数据上微调,提升 AI 动画任务的泛化能力。

为什么选择 AniPortrait?

在 AI 视频生成工具的拥挤领域,AniPortrait 以其对照片级真实肖像的专攻而脱颖而出。与通用模型不同,它精确处理音频唇同步和细微表情,减少面部动画中的伪影。开源性质允许自定义,最近更新——如 2024 年 4 月的 audio2pose 发布和加速模块——使其保持前沿。社区对 EMO 和 AnimateAnyone 等项目的认可突显其协作根源,确保可靠性能。

实际价值包括为虚拟影响者、教育视频或游戏资产更快原型设计。arXiv 论文可用(eprint 2403.17694),服务于探索计算机视觉中音频视觉合成的研究人员。

AniPortrait 适合谁?

- 内容创作者和电影制作人:用于短视频的快速配音或表情传输。

- 腾讯式工作室的游戏开发者:将动画肖像集成到互动媒体中。

- AI 研究人员:实验基于扩散的动画和姿态重定向。

- 业余爱好者和教育者:使用 Web UI 教授 AI 概念,而无需繁重设置。

如果您正在寻找创建音频驱动肖像动画的最佳方式,AniPortrait 的质量、速度和可访问性平衡使其成为首选。

潜在应用和用例

- 虚拟头像:为社交媒体或元宇宙动画数字角色与同步语音。

- 教育工具:生成讲座或教程的说话头视频。

- 媒体制作:历史重演或广告的伦理面部重演。

- 研究原型:在 CV 论文中基准音频到视频模型。

演示包括自驱动剪辑如 'solo.mp4' 和音频示例如 'kara.mp4',展示无缝集成。

对于故障排除,检查 GitHub 上的 76 个开放问题或通过拉取请求贡献。总体而言,AniPortrait 赋能用户在 AI 肖像动画中推动边界,获得可靠、高保真结果。

与AniPortrait相关的标签