Clips AI

Übersicht von Clips AI

Clips AI: KI-Videoumwandlung für Entwickler

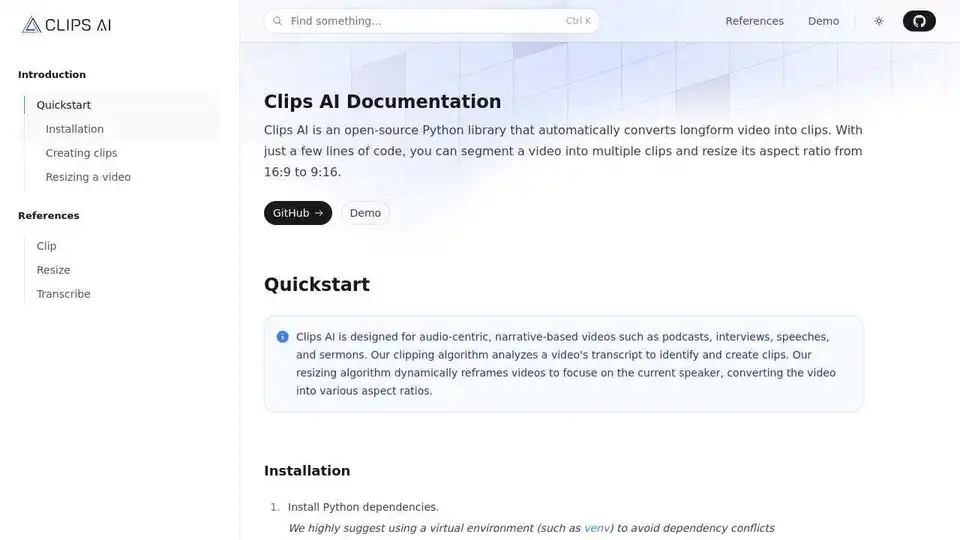

Was ist Clips AI? Clips AI ist eine Open-Source-Python-Bibliothek, die lange Videos automatisch in ansprechende Clips umwandelt. Sie ist auf audioczentrierte und narrative Inhalte wie Podcasts, Interviews, Reden und Predigten zugeschnitten. Mit nur wenigen Codezeilen können Sie Videos in mehrere Clips segmentieren und deren Seitenverhältnis von 16:9 auf 9:16 ändern.

Hauptmerkmale:

- Automatische Clips: Verwendet die Transkriptanalyse, um wichtige Segmente im Video zu identifizieren.

- Intelligente Größenänderung: Ändert die Größe von Videos dynamisch, um sich auf den aktuellen Sprecher zu konzentrieren, und wandelt das Video in verschiedene Seitenverhältnisse um.

So verwenden Sie Clips AI:

Installation:

Installieren Sie Python-Abhängigkeiten mit pip:

pip install clipsai pip install whisperx@git+https://github.com/m-bain/whisperx.gitInstallieren Sie

libmagicundffmpeg.

Erstellen von Clips:

Transkribieren Sie das Video mit WhisperX (in Clips AI integriert).

Verwenden Sie

ClipFinder, um basierend auf der Transkription Clips zu identifizieren und zu erstellen.from clipsai import ClipFinder, Transcriber transcriber = Transcriber() transcription = transcriber.transcribe(audio_file_path="/abs/path/to/video.mp4") clipfinder = ClipFinder() clips = clipfinder.find_clips(transcription=transcription) print("StartTime: ", clips[0].start_time) print("EndTime: ", clips[0].end_time)

Größe eines Videos ändern:

Für die Sprecherdiarisierung (mit Pyannote) ist ein Hugging Face-Zugriffstoken erforderlich.

from clipsai import resize crops = resize( video_file_path="/abs/path/to/video.mp4", pyannote_auth_token="pyannote_token", aspect_ratio=(9, 16) ) print("Crops: ", crops.segments)

Warum ist Clips AI wichtig?

Clips AI vereinfacht den Prozess der Umwandlung langer Videos in kurze, ansprechende Clips, die für Plattformen wie TikTok, Instagram Reels und YouTube Shorts geeignet sind. Es spart Zeit und Mühe, indem es den Clipping- und Größenänderungsprozess automatisiert.

Wo Sie weitere Informationen finden:

- GitHub: https://github.com/

- Demo:

- Schnellstart:

Beste Alternativwerkzeuge zu "Clips AI"

ThinkDiffusion: Cloud-Arbeitsbereiche für Stable Diffusion, ComfyUI und KI-Videogenerierungs-Apps. Starten Sie in 90 Sekunden mit Ihrem persönlichen KI-Kunstlabor.

Lucy Edit AI ist das erste Open-Source-Modell zur anweisungsgesteuerten Videobearbeitung. Bearbeiten Sie Videos mit Textaufforderungen und bewahren Sie dabei Bewegung und Komposition. Kostenlos für kreative Videotransformationen.

Wan 2.2 ist das führende KI-Videogenerierungsmodell von Alibaba, jetzt Open Source. Es bietet filmische Visionskontrolle, unterstützt die Generierung von Text-zu-Video und Bild-zu-Video und bietet effizientes High-Definition-Hybrid-TI2V.

SwiftSora ist ein Open-Source-KI-Videogenerator, der das Sora-Modell von OpenAI verwendet. Generieren Sie hochwertige Videos aus Text-Prompts mit One-Click-Deployment auf Vercel. Sichern Sie Ihren API-Schlüssel mit dem integrierten OpenAI-Proxy.

Flux AI bietet fortschrittliche KI-Bild- und Videogenerierungswerkzeuge. Erstellen Sie beeindruckende Grafiken mit Text-zu-Bild- und Bild-zu-Video-Technologie. Testen Sie Flux Kontext AI und Flux.1 AI-Modelle kostenlos.

MAGI-1 ist das erste Open-Source-Autoregressive-Videogenerierungsmodell mit höchster Qualität und vollständiger Kontrolle. Erstellen Sie mühelos atemberaubende KI-Videos. Probieren Sie es jetzt aus!

Deep Live Cam: Echtzeit-Gesichtstausch und One-Click-Video-Deepfake-Tool mit KI. Tauschen Sie Gesichter einfach in Videos oder Bildern aus.

FaceSwapLab ist ein professionelles, KI-gestütztes Tool zum Austauschen von Gesichtern für Videos und Fotos. Erziele hohe Genauigkeit und natürliche Ergebnisse mit einer schnellen, sicheren und einfach zu bedienenden Plattform.

MagicAnimate ist ein Open-Source-Diffusions-Framework zum Erstellen von zeitlich konsistenten Human Image Animationen aus einem einzelnen Bild und einem Bewegungsvideo. Generieren Sie animierte Videos mit verbesserter Wiedergabetreue.

AnimateDiff ist ein kostenloser Online-Video-Maker, der Bewegung in KI-generierte Visuals bringt. Erstellen Sie Animationen aus Text-Prompts oder animieren Sie bestehende Bilder mit natürlichen Bewegungen, die aus realen Videos gelernt wurden. Dieser Plug-and-Play-Framework fügt Videofähigkeiten zu Diffusionsmodellen wie Stable Diffusion hinzu, ohne Retraining. Erkunden Sie die Zukunft der KI-Inhaltscreation mit den Text-zu-Video- und Bild-zu-Video-Generierungstools von AnimateDiff.

Fabric ist ein Open-Source-AI-Framework, das modulare Muster zur Lösung spezifischer Probleme mit crowdsourcierten AI-Prompts bereitstellt. Es hilft, AI-Fähigkeiten durch Befehlszeilenschnittstelle und Webanwendungen in tägliche Workflows zu integrieren.

302.AI ist ein Enterprise AI Resource Hub, der Pay-as-you-go-Zugriff auf Bild-, Video-, Audio- und Sprachmodell-APIs bietet. Optimieren Sie die KI-Entwicklung mit Stabilität und einem reichhaltigen Ökosystem.

Preisgekrönter KI-Sprachgenerator und Text-to-Speech-Software mit über 500 Stimmen in 100 Sprachen. Realistische KI-Stimmen mit Online-Videoeditor. Klonen Sie Ihre eigene Stimme.

Visla: KI-Videoerstellungs- und -Bearbeitungstool für Unternehmen. Erstellen Sie Marketing-, Schulungs- und Vertriebsvideos mit KI-Avataren und einem leistungsstarken Videoeditor.