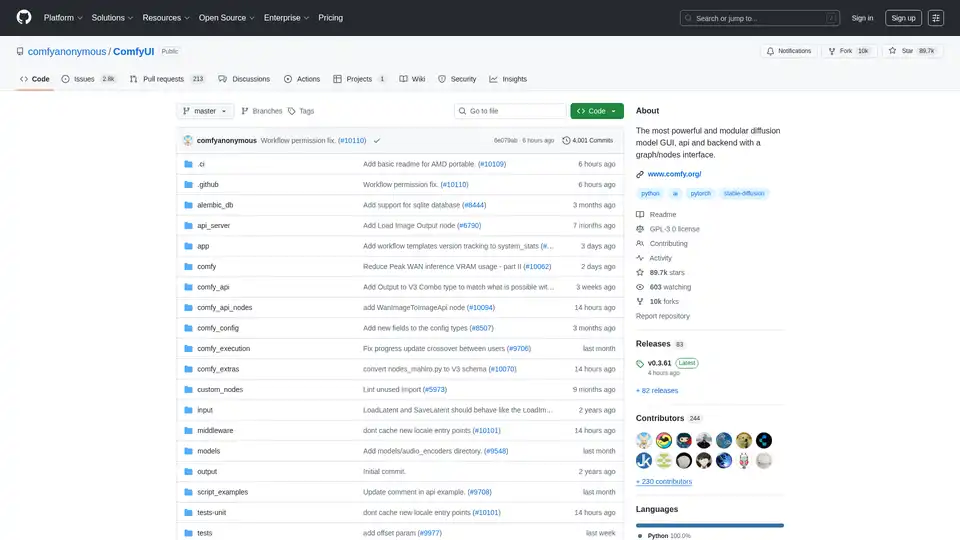

ComfyUI

Übersicht von ComfyUI

ComfyUI: Die leistungsstärkste und modularste visuelle KI-Engine

Was ist ComfyUI?

ComfyUI ist eine leistungsstarke und modulare visuelle KI-Engine, die für die Erstellung und Ausführung fortschrittlicher Stable Diffusion-Pipelines entwickelt wurde. Es verwendet eine Graph-/Knoten-/Flussdiagramm-basierte Schnittstelle, wodurch es auf Windows, Linux und macOS zugänglich ist.

Hauptmerkmale

- Knoten/Graph/Flussdiagramm-Schnittstelle: Experimentieren Sie und erstellen Sie komplexe Stable Diffusion-Workflows ohne Programmierung.

- Asynchrones Warteschlangensystem: Optimiert die Ausführung, indem nur die Teile des Workflows erneut ausgeführt werden, die sich ändern.

- Intelligentes Speichermanagement: Führt große Modelle auf GPUs mit nur 1 GB VRAM durch intelligentes Auslagern aus.

- Umfassende Modellunterstützung:

- SD1.x, SD2.x (unCLIP)

- SDXL, SDXL Turbo

- Stable Cascade

- SD3 und SD3.5

- Pixart Alpha und Sigma

- AuraFlow, HunyuanDiT, Flux, Lumina Image 2.0, HiDream, Qwen Image, Hunyuan Image 2.1

- Omnigen 2, Flux Kontext, HiDream E1.1, Qwen Image Edit

- Stable Video Diffusion, Mochi, LTX-Video, Hunyuan Video, Wan 2.1, Wan 2.2

- Stable Audio, ACE Step

- Hunyuan3D 2.0

- Flexibles Laden: Lädt Checkpoints und Safetensors, einschließlich Standalone-Diffusionsmodelle, VAEs und CLIP-Modelle.

- Sicheres Laden von Dateien: Gewährleistet das sichere Laden von ckpt-, pt-, pth- und anderen Dateien.

- Vielseitige Techniken: Unterstützt Embeddings, Textual Inversion, LoRAs (regulär, locon und loha) und Hypernetworks.

- Workflow-Integration: Lädt vollständige Workflows (mit Seeds) aus generierten PNG-, WebP- und FLAC-Dateien.

- Anpassbare Knoten: Knotenschnittstelle für die Erstellung fortschrittlicher Workflows wie Hires Fix und mehr.

- Erweiterte Funktionen: Bereichszusammensetzung, Inpainting, ControlNet, T2I-Adapter, GLIGEN, Modellverschmelzung und LCM-Modelle.

- Offline-Funktionalität: Der Kern arbeitet vollständig offline, ohne dass Downloads erforderlich sind, sofern nicht anders angegeben.

- API-Integration: Optionale API-Knoten für die Verwendung kostenpflichtiger Modelle von externen Anbietern.

- Konfigurierbare Modellpfade: Ermöglicht das Festlegen benutzerdefinierter Suchpfade für Modelle.

Wie funktioniert ComfyUI?

ComfyUI arbeitet über eine visuelle Schnittstelle, in der Sie Knoten verbinden, um komplexe Workflows zu erstellen. Jeder Knoten führt eine bestimmte Aufgabe aus, z. B. das Laden eines Modells, das Codieren von Text oder das Generieren eines Bildes. Die Daten fließen durch diese Knoten, wobei nur die Teile des Graphen, die sich geändert haben, erneut ausgeführt werden, wodurch Leistung und Ressourcennutzung optimiert werden.

Wie verwendet man ComfyUI?

- Installation: Wählen Sie zwischen der Desktop-Anwendung, dem portablen Windows-Paket oder der manuellen Installation.

- Modellplatzierung: Platzieren Sie Ihre Stable Diffusion-Checkpoints im Verzeichnis

models/checkpoints. - ComfyUI ausführen: Führen Sie das Skript

main.pymit Python aus.

Manuelle Installation

Führen Sie die folgenden Schritte aus, um ComfyUI manuell zu installieren:

- Repository klonen:

git clone https://github.com/comfyanonymous/ComfyUI cd ComfyUI - Abhängigkeiten installieren:

pip install -r requirements.txt - ComfyUI ausführen:

python main.py

Warum ComfyUI wählen?

- Modularität: Entwerfen und experimentieren Sie mit komplexen Stable Diffusion-Pipelines ohne Programmierung.

- Effizienz: Reduzieren Sie die Rechenlast mithilfe von intelligentem Speichermanagement und asynchroner Ausführung.

- Flexibilität: Unterstützt viele Modelle, Techniken und Hardwarekonfigurationen.

- Anpassung: Erstellen und teilen Sie benutzerdefinierte Knoten und Workflows.

Für wen ist ComfyUI geeignet?

ComfyUI ist für folgende Zielgruppen konzipiert:

- KI-Enthusiasten, die eine visuelle Schnittstelle zum Erstellen komplexer Stable Diffusion-Pipelines suchen.

- Forscher und Entwickler, die ein modulares und flexibles Framework zum Experimentieren mit neuen KI-Techniken benötigen.

- Künstler und Designer, die mit KI Bilder generieren und bearbeiten möchten.

Release-Prozess

ComfyUI folgt einem wöchentlichen Release-Zyklus, der sich jedoch aufgrund von Modell-Releases oder bedeutenden Code-Aktualisierungen ändern kann. Der Release-Prozess umfasst drei miteinander verbundene Repositories:

- ComfyUI Core: Veröffentlicht stabile Versionen und dient als Grundlage für die Desktop-Version.

- ComfyUI Desktop: Erstellt neue Releases mit der neuesten stabilen Core-Version.

- ComfyUI Frontend: Erhält wöchentliche Updates, wobei die Funktionen für das kommende Core-Release eingefroren werden.

Erste Schritte

Desktop-Anwendung

Der einfachste Weg, um zu beginnen, verfügbar für Windows & macOS.

Portables Windows-Paket

Erhalten Sie die neuesten Commits und eine vollständig portable Version, verfügbar für Windows.

Manuelle Installation

Unterstützt alle Betriebssysteme und GPU-Typen (NVIDIA, AMD, Intel, Apple Silicon, Ascend).

Beispiel-Workflows

Entdecken Sie Beispiel-Workflows, um zu sehen, was ComfyUI alles kann.

Wie kann man Modelle zwischen einer anderen UI und ComfyUI austauschen?

In der Konfigurationsdatei können Sie die Suchpfade für Modelle festlegen. In der eigenständigen Windows-Version finden Sie diese Datei im ComfyUI-Verzeichnis. Benennen Sie diese Datei in extra_model_paths.yaml um und bearbeiten Sie sie mit Ihrem bevorzugten Texteditor.

Community

- Discord: Probieren Sie die Kanäle #help oder #feedback aus.

- Matrix Space: #comfyui_space:matrix.org (ähnlich wie Discord, aber Open Source).

Beste Methode zum Erstellen von KI-Workflows?

Um effektive KI-Workflows in ComfyUI zu erstellen, beginnen Sie mit einem klaren Ziel und unterteilen Sie den Prozess in kleinere, überschaubare Schritte. Verwenden Sie die knotenbasierte Schnittstelle, um verschiedene Operationen zu verbinden, wie z. B. das Laden von Modellen, die Verarbeitung von Bildern und das Anwenden von Effekten. Experimentieren Sie mit verschiedenen Konfigurationen und nutzen Sie Community-Ressourcen für Inspiration und Anleitung.

TL;DR

ComfyUI ist eine robuste, modulare und vielseitige visuelle KI-Engine, die Benutzern die Werkzeuge bietet, um komplexe Stable Diffusion-Pipelines zu erstellen. Die visuelle Graph-/Knoten-Schnittstelle macht sie sowohl für Künstler, Forscher als auch für Entwickler zugänglich.

Beste Alternativwerkzeuge zu "ComfyUI"

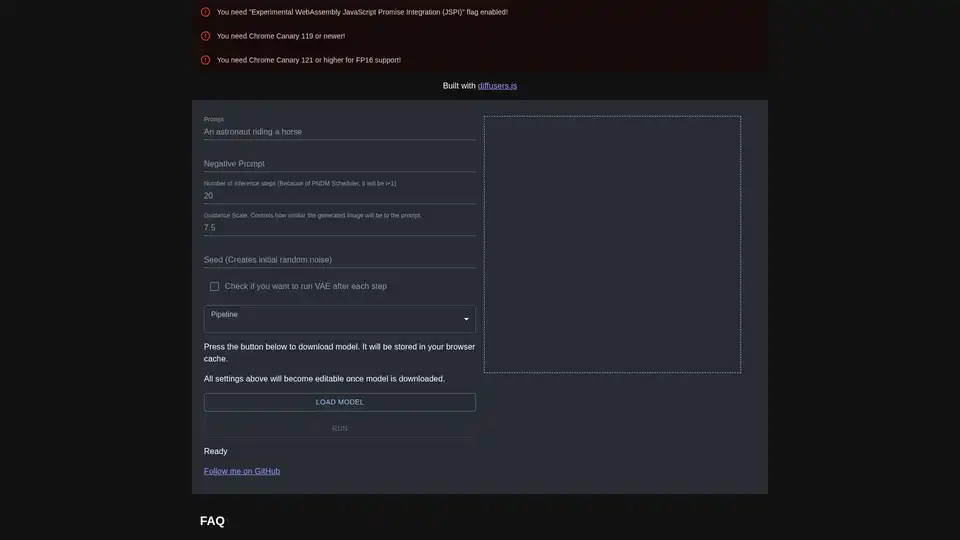

diffusers.js ist eine JavaScript-Bibliothek, die die Generierung von AI-Bildern mit Stable Diffusion im Browser über WebGPU ermöglicht. Laden Sie Modelle herunter, geben Sie Prompts ein und erstellen Sie atemberaubende visuelle Inhalte direkt in Chrome Canary mit anpassbaren Einstellungen wie Guidance Scale und Inferenzschritten.

AIimag.es ist ein kostenloses, Open-Source-Windows-Programm, das Stable Diffusion nutzt, um Bilder aus Textbeschreibungen zu erzeugen. Einfach zu installieren und zu bedienen, ermöglicht es unbegrenzte KI-Kunstkreation für persönliche oder kommerzielle Zwecke auf Ihrem PC.

Mit Image Pipeline können Sie mit den neuesten Technologien wie Stable Diffusion, ControlNets und benutzerdefinierten Modellen KI-Visuals in Produktionsqualität mit maximaler Kontrolle erstellen. Konzentrieren Sie sich auf die Entwicklung von KI-Produkten ohne GPU-Wartung.

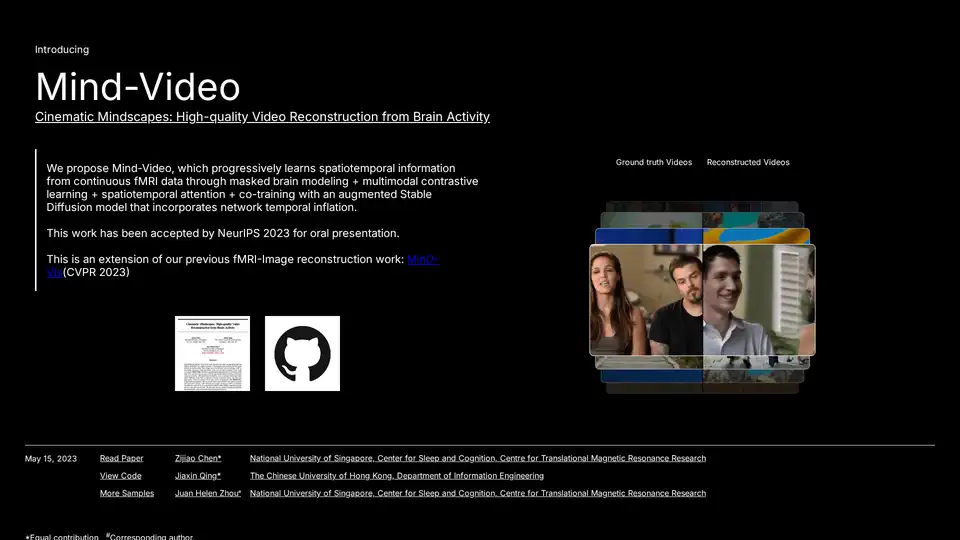

Mind-Video verwendet KI, um Videos aus Gehirnaktivität zu rekonstruieren, die über fMRT erfasst wurde. Dieses innovative Tool kombiniert maskierte Gehirnmodellierung, multimodales kontrastives Lernen und räumlich-zeitliche Aufmerksamkeit, um qualitativ hochwertige Videos zu erzeugen.

MotionAgent ist ein Open-Source-KI-Tool, das Ideen in Bewegungsfilme umwandelt, indem es Skripte, Filmstills, hochauflösende Videos und benutzerdefinierte Hintergrundmusik mit Modellen wie Qwen-7B-Chat und SDXL generiert.

AniPortrait ist ein Open-Source-AI-Framework zur Generierung fotorealistischer Porträt-Animationen, angetrieben durch Audio- oder Videoeingaben. Es unterstützt Selbstgesteuerte, Gesichts-Reenactment- und Audio-gesteuerte Modi für hochqualitative Videosynthese.

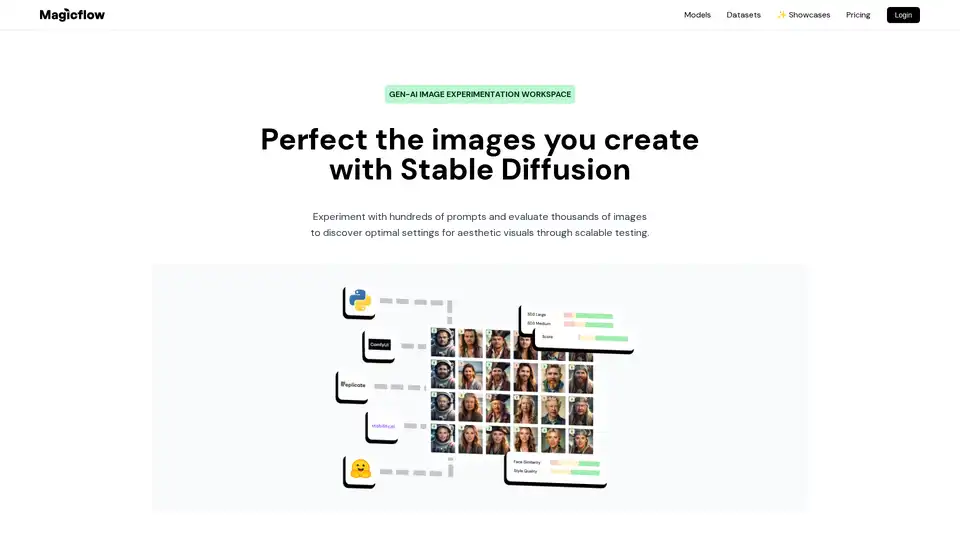

Magicflow AI ist ein generativer KI-Bildexperimentier-Arbeitsbereich, der Massenbilderzeugung, Auswertung und Teamzusammenarbeit zur Perfektionierung von Stable Diffusion-Ausgaben ermöglicht.

Entdecken Sie Magnific AI, den führenden AI-Upscaler und -Verbesserer, der Bilder mit prompt-geleiteten Details und High-Res-Magie transformiert. Ideal für Porträts, Illustrationen und mehr.

Sagify ist ein Open-Source-Python-Tool, das Machine-Learning-Pipelines auf AWS SageMaker vereinfacht und eine einheitliche LLM-Gateway für die nahtlose Integration proprietärer und Open-Source-Großsprachmodelle bietet.

Skybox AI von Blockade Labs ist ein leistungsstarkes Ein-Klick-Tool zur Generierung immersiver 360°-Welten aus einfachen Text-Prompts, ideal für Kreative, die schnelles KI-gestütztes Umgebungsdesign suchen.

InvokeAI ist eine kreative Engine für Stable Diffusion Modelle, die es Benutzern ermöglicht, mit KI visuelle Medien zu generieren. Bietet eine webbasierte Benutzeroberfläche und ist die Basis für kommerzielle Produkte.

Erfahren Sie, wie Sie Stable Diffusion mit der Web-Oberfläche von AUTOMATIC1111 auf Google Colab ausführen. Installieren Sie Modelle, LoRAs und ControlNet für schnelle KI-Bildgenerierung ohne lokale Hardware.

fast.ai zielt darauf ab, Deep Learning zugänglicher zu machen. Es bietet praktische Kurse, Software wie fastai für PyTorch und Ressourcen, die Programmierern helfen, neuronale Netze effektiv zu lernen und anzuwenden. Enthält ein Buch, 'Practical Deep Learning for Coders with fastai and PyTorch'.

i10X ist ein KI-Agenten-Marktplatz, der über 500 KI-Tools für Chat, Bilderzeugung, Dokumentenanalyse und mehr bietet. Sparen Sie Zeit und Kosten mit diesem All-in-One-KI-Arbeitsbereich. Testen Sie es risikofrei!