Featherless.ai

Descripción general de Featherless.ai

¿Qué es Featherless.ai?

Featherless.ai es un proveedor de alojamiento LLM sin servidor que le brinda acceso a una vasta biblioteca de modelos de código abierto de Hugging Face. Olvídese de las complejidades de la administración del servidor y los gastos generales operativos; Featherless se encarga de todo, lo que le permite concentrarse en aprovechar la IA para sus proyectos.

Características clave:

- Amplio catálogo de modelos: Acceda a más de 11 900 modelos de código abierto.

- Inferencia sin servidor: Implemente modelos sin administrar servidores.

- Precios fijos: Facturación predecible con tokens ilimitados.

- Baja latencia: Benefíciese de la carga avanzada de modelos y la orquestación de GPU.

- Compatibilidad con LangChain: Impulse sus aplicaciones con Featherless utilizando la compatibilidad con OpenAI SDK.

¿Cómo usar Featherless.ai?

- Regístrese: Cree una cuenta en Featherless.ai.

- Explore modelos: Explore el amplio catálogo de modelos.

- Implemente: Implemente instantáneamente modelos para ajuste fino, pruebas o producción.

- Integre: Use la API para integrar modelos en sus aplicaciones.

¿Por qué elegir Featherless.ai?

Featherless.ai ofrece una alternativa convincente a otros proveedores al combinar un vasto catálogo de modelos con infraestructura sin servidor y precios predecibles. Es la solución ideal para los equipos de IA que desean aprovechar el poder de los modelos de código abierto sin la molestia de la administración del servidor.

Casos de uso:

- OpenHands: Optimice el desarrollo de software con tareas de codificación impulsadas por IA.

- NovelCrafter: Mejore la escritura creativa con asistencia de IA durante todo el proceso de escritura de novelas.

- WyvernChat: Cree personajes únicos con personalidades personalizadas utilizando una amplia gama de modelos de código abierto.

Precios:

Featherless.ai ofrece tres planes de precios:

- Feather Basic: $10/mes para modelos de hasta 15B parámetros.

- Feather Premium: $25/mes para acceso a modelos DeepSeek y Kimi-K2.

- Feather Scale: $75/mes para planes de negocios con concurrencia escalable.

Preguntas frecuentes:

¿Qué es Featherless?

Featherless es un proveedor de alojamiento LLM que ofrece acceso a una biblioteca en continua expansión de modelos de HuggingFace.

¿Registran mi historial de chat?

No, las indicaciones y las finalizaciones enviadas a nuestra API no se registran.

¿Qué arquitecturas de modelos se admiten?

Se admite una amplia gama de modelos de llama, incluidos Llama 2 y 3, Mistral, Qwen y DeepSeek.

Para obtener más detalles, visite Featherless.ai y explore la documentación.

Mejores herramientas alternativas a "Featherless.ai"

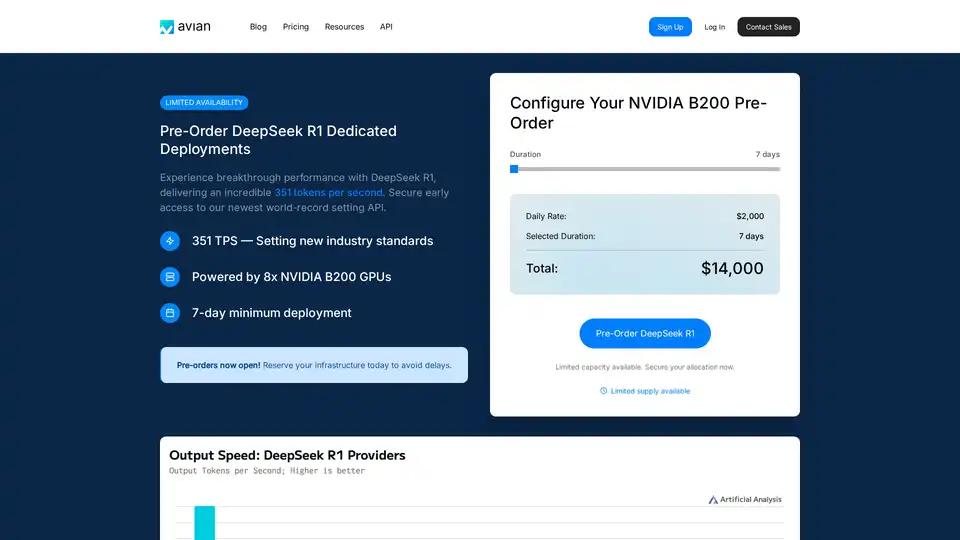

Avian API ofrece la inferencia de IA más rápida para LLM de código abierto, alcanzando 351 TPS en DeepSeek R1. Implemente cualquier LLM de HuggingFace a una velocidad de 3 a 10 veces mayor con una API compatible con OpenAI. Rendimiento y privacidad de nivel empresarial.

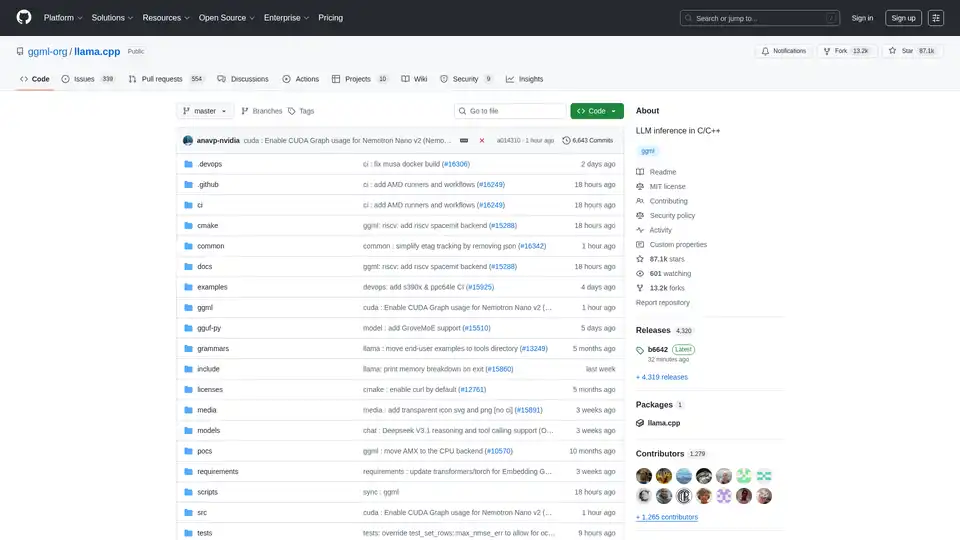

Habilite la inferencia LLM eficiente con llama.cpp, una biblioteca C/C++ optimizada para diversos hardware, que admite cuantificación, CUDA y modelos GGUF. Ideal para implementación local y en la nube.

Phala Cloud ofrece una infraestructura de nube de código abierto y sin confianza para implementar agentes de IA y aplicaciones Web3, impulsada por TEE. Garantiza la privacidad, la escalabilidad y se rige por el código.

Awan LLM proporciona una plataforma API de inferencia LLM ilimitada, sin restricciones y rentable. Permite a los usuarios y desarrolladores acceder a potentes modelos LLM sin limitaciones de tokens, ideal para agentes de IA, juegos de rol, procesamiento de datos y finalización de código.

Deep Infra es una plataforma de inferencia IA escalable y de bajo costo con +100 modelos ML como DeepSeek-V3.2, Qwen y herramientas OCR. APIs amigables para desarrolladores, alquiler de GPUs y retención cero de datos.

Confident AI es una plataforma de evaluación LLM construida sobre DeepEval, que permite a los equipos de ingeniería probar, comparar, proteger y mejorar el rendimiento de las aplicaciones LLM. Ofrece métricas y salvaguardias de primer nivel, además de observabilidad para optimizar sistemas de IA y detectar regresiones.

Magic Loops es una plataforma sin código que combina LLMs y código para construir apps nativas de IA profesionales en minutos. Automatiza tareas, crea herramientas personalizadas y explora apps de la comunidad sin habilidades de codificación.

Vext crea soluciones de IA personalizadas para empresas, incluidas aplicaciones LLM, ajuste fino de modelos, alojamiento gestionado y servicios de API personalizados.

Cree aplicaciones de datos impulsadas por IA en minutos con Morph. Marco de Python + alojamiento con autenticación integrada, conectores de datos, CI/CD.

Lunary es una plataforma de ingeniería LLM de código abierto que proporciona observabilidad, gestión de prompts y análisis para construir aplicaciones de IA confiables. Ofrece herramientas para la depuración, el seguimiento del rendimiento y la garantía de la seguridad de los datos.

LightOn Paradigm: Implemente LLM soberanos y agentes de IA en su entorno de confianza. Cree flujos de trabajo con control total de datos.

Parea AI es una plataforma de experimentación y anotación de IA que ayuda a los equipos a enviar aplicaciones LLM con confianza. Ofrece funciones para el seguimiento de experimentos, la observabilidad, la revisión humana y la implementación rápida.

Dynamiq es una plataforma on-premise para construir, desplegar y monitorear aplicaciones GenAI. Simplifica el desarrollo de AI con funciones como afinación LLM, integración RAG y observabilidad para reducir costos y aumentar el ROI empresarial.

Sutro es un conjunto de herramientas para construir aplicaciones de IA de pila completa utilizando LLM. Proporciona API modulares para backend, frontend, planificación y flujos de trabajo, lo que permite la creación de aplicaciones de IA de nivel empresarial con facilidad.