PromptsLabs

Descripción general de PromptsLabs

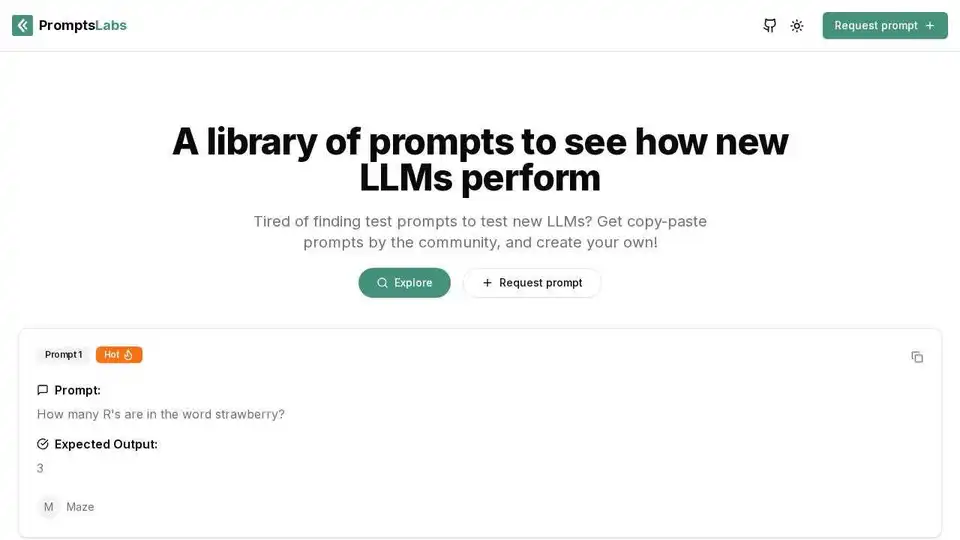

PromptsLabs: Una Biblioteca Integral de Prompts de IA para Pruebas de LLM

¿Qué es PromptsLabs? PromptsLabs es una biblioteca de prompts de IA diseñada para ayudar a los usuarios a probar nuevos Modelos de Lenguaje Grandes (LLM). Ofrece una colección de prompts aportados por la comunidad, lo que permite a los usuarios copiar y pegar fácilmente prompts para fines de prueba. Si estás cansado de luchar para encontrar prompts de prueba para tus nuevos LLM, PromptsLabs está aquí para optimizar tu proceso de prueba.

Características Clave

- Prompts Impulsados por la Comunidad: Una vasta biblioteca de prompts creados y compartidos por la comunidad. Esto asegura una gama diversa de escenarios de prueba y estilos de prompts.

- Funcionalidad Fácil de Copiar y Pegar: Los prompts se pueden copiar y pegar fácilmente, lo que hace que el proceso de prueba sea rápido y eficiente.

- Contribuye con Tus Propios Prompts: Los usuarios pueden crear y enviar sus propios prompts, contribuyendo al crecimiento y la diversidad de la biblioteca.

¿Cómo Funciona PromptsLabs?

PromptsLabs funciona proporcionando un repositorio centralizado de prompts diseñados para probar varios aspectos de los LLM. Cada prompt incluye:

- El Prompt: El prompt de texto real que se le dará al LLM.

- Salida Esperada: La respuesta deseada o correcta del LLM.

Los usuarios pueden navegar por la biblioteca, seleccionar un prompt y copiarlo en su entorno de prueba de LLM. Al comparar la salida real del LLM con la salida esperada, los usuarios pueden evaluar el rendimiento del LLM e identificar áreas de mejora.

¿Cómo usar PromptsLabs?

Usar PromptsLabs es sencillo:

- Explora la Biblioteca: Navega por los prompts disponibles para encontrar escenarios de prueba relevantes.

- Selecciona un Prompt: Elige un prompt que se alinee con tus objetivos de prueba.

- Copia el Prompt: Utiliza la funcionalidad de copiar y pegar para transferir el prompt a tu entorno de prueba de LLM.

- Evalúa la Salida: Compara la salida del LLM con la salida esperada para evaluar el rendimiento.

- Contribuye (Opcional): Comparte tus propios prompts con la comunidad para ayudar a mejorar la biblioteca.

¿Para Quién es PromptsLabs?

PromptsLabs es ideal para:

- Ingenieros de IA/ML: Profesionales que desarrollan y prueban nuevos LLM.

- Investigadores: Individuos que realizan investigaciones sobre las capacidades y limitaciones de los LLM.

- Ingenieros de Prompts: Aquellos enfocados en crear prompts efectivos para LLM.

- Educadores: Instructores que enseñan sobre LLM e ingeniería de prompts.

¿Por Qué es Importante PromptsLabs?

Las pruebas son cruciales para garantizar la confiabilidad y la eficacia de los LLM. PromptsLabs simplifica este proceso al proporcionar una biblioteca de prompts de prueba disponible de inmediato. Esto ahorra tiempo y esfuerzo, permitiendo a los usuarios concentrarse en analizar los resultados y mejorar sus modelos.

Ejemplos de Prompts

A continuación, se muestran algunos ejemplos de prompts disponibles en PromptsLabs:

- Prompt 1: "¿Cuántas 'R' hay en la palabra fresa?"

- Salida Esperada: "3"

- Prompt 2: "Tengo 3 manzanas hoy. Me comí una ayer. ¿Cuántas me quedan hoy?"

- Salida Esperada: "Hoy tienes 3 manzanas. Comerse una ayer no cambia eso para hoy."

- Prompt 3: "Compara 9.9 y 9.11, ¿cuál es el número más grande?"

- Salida Esperada: "9.9 es más grande porque en las comparaciones decimales, se verifican los dígitos de izquierda a derecha. En el lugar de las décimas (primer decimal), 9 es mayor que 1, por lo que 9.9 > 9.11."

Al usar estos prompts, puedes probar las capacidades de razonamiento, matemáticas y lógica de tus LLM.

Valor Práctico

- Ahorra Tiempo: No es necesario crear prompts desde cero.

- Mejora la Calidad de las Pruebas: Accede a una gama diversa de prompts.

- Facilita la Colaboración: Contribuye y benefíciate del conocimiento de la comunidad.

Conclusión

PromptsLabs es un recurso valioso para cualquiera que trabaje con Modelos de Lenguaje Grandes. Su biblioteca integral de prompts, su interfaz fácil de usar y su enfoque impulsado por la comunidad lo convierten en una herramienta esencial para las pruebas de LLM. Comienza a explorar PromptsLabs hoy mismo para mejorar tus esfuerzos de desarrollo e investigación de LLM. ¿Cuál es la mejor manera de probar el rendimiento de los LLM? Utiliza PromptsLabs, la Biblioteca de Prompts de IA, para garantizar la precisión y la eficacia.

Mejores herramientas alternativas a "PromptsLabs"

PromptLayer es una plataforma de ingeniería de IA para la gestión de prompts, la evaluación y la observabilidad de LLM. Colabore con expertos, supervise agentes de IA y mejore la calidad de los prompts con herramientas potentes.

Latitude es una plataforma de código abierto para la ingeniería de prompts, que permite a los expertos en el dominio colaborar con los ingenieros para ofrecer funciones LLM de grado de producción. Construye, evalúa y despliega productos de IA con confianza.

Future AGI es una plataforma unificada de observabilidad LLM y evaluación de agentes de IA que ayuda a las empresas a lograr un 99% de precisión en aplicaciones de IA mediante herramientas integrales de prueba, evaluación y optimización.

Parea AI es la plataforma definitiva de experimentación y anotación humana para equipos de IA, que permite una evaluación fluida de LLM, pruebas de prompts y despliegue en producción para construir aplicaciones de IA confiables.

Proteja sus sistemas de IA con las pruebas de seguridad y red team automatizadas de Mindgard. Identifique y resuelva los riesgos específicos de la IA, garantizando modelos y aplicaciones de IA sólidos.

Compara y comparte prompts lado a lado con Google's Gemini Pro vs OpenAI's ChatGPT para encontrar el mejor modelo AI para tus necesidades.

Athina es una plataforma colaborativa de IA que ayuda a los equipos a construir, probar y monitorear funciones basadas en LLM 10 veces más rápido. Con herramientas para gestión de prompts, evaluaciones y observabilidad, garantiza la privacidad de datos y soporta modelos personalizados.

PromptPoint te ayuda a diseñar, probar e implementar prompts rápidamente con pruebas automatizadas de prompts. Impulsa la ingeniería de prompts de tu equipo con salidas LLM de alta calidad.

Weco AI automatiza experimentos de aprendizaje automático usando tecnología AIDE ML, optimizando pipelines ML mediante evaluación de código impulsada por IA y experimentación sistemática para mejorar métricas de precisión y rendimiento.

Parea AI es una plataforma de experimentación y anotación de IA que ayuda a los equipos a enviar aplicaciones LLM con confianza. Ofrece funciones para el seguimiento de experimentos, la observabilidad, la revisión humana y la implementación rápida.

Maxim AI es una plataforma integral de evaluación y observabilidad que ayuda a los equipos a implementar agentes de IA de manera confiable y 5 veces más rápido con herramientas completas de prueba, monitoreo y garantía de calidad.

Freeplay es una plataforma de IA diseñada para ayudar a los equipos a construir, probar y mejorar los productos de IA a través de la gestión de avisos, evaluaciones, observabilidad y flujos de trabajo de revisión de datos. Agiliza el desarrollo de la IA y garantiza una alta calidad del producto.

Infrabase.ai es el directorio para descubrir herramientas y servicios de infraestructura de IA. Encuentra bases de datos vectoriales, herramientas de ingeniería de prompts, APIs de inferencia y más para construir productos de IA de clase mundial.

Bolt Foundry proporciona herramientas de ingeniería de contexto para hacer que el comportamiento de la IA sea predecible y comprobable, ayudándole a construir productos LLM confiables. Pruebe los LLM como si probara el código.