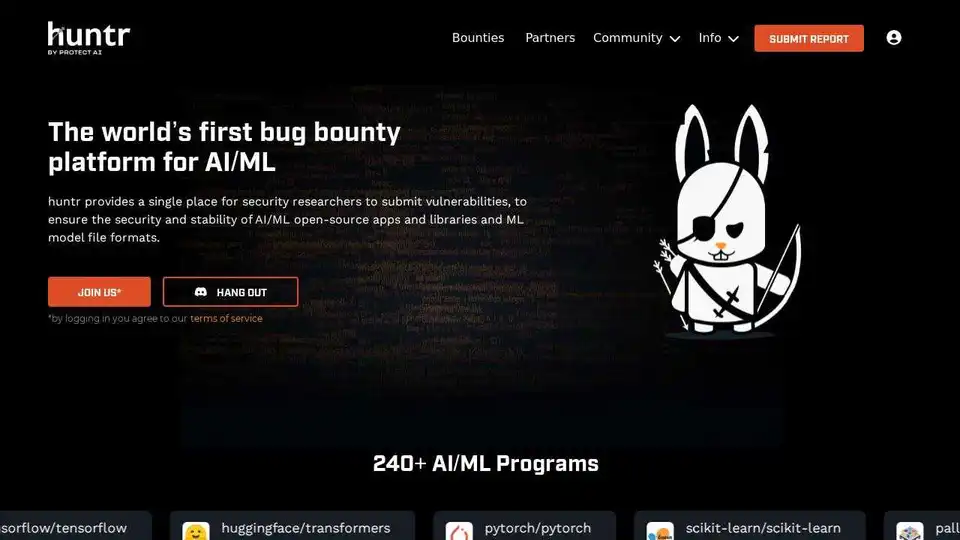

huntr

Vue d'ensemble de huntr

huntr : La plateforme de Bug Bounty pour la sécurité de l'IA/ML

Qu'est-ce que huntr ?

Huntr est la première plateforme de bug bounty au monde spécialement conçue pour les projets d'IA et d'apprentissage automatique (ML). Elle sert de plaque tournante centrale où les chercheurs en sécurité peuvent signaler les vulnérabilités dans les applications, les bibliothèques et les formats de fichiers de modèles open source d'IA/ML, contribuant ainsi à renforcer la sécurité et la stabilité de ces composants critiques. En fournissant un environnement structuré et incitatif pour la divulgation des vulnérabilités, huntr joue un rôle essentiel dans le domaine en pleine expansion de la sécurité de l'IA.

Comment fonctionne huntr ?

Huntr facilite un processus rationalisé pour le signalement et la résolution des vulnérabilités :

- Divulgation: Les chercheurs en sécurité identifient et soumettent les vulnérabilités via un formulaire sécurisé sur la plateforme huntr.

- Validation: L'équipe huntr contacte le responsable du projet concerné et lui accorde 31 jours pour répondre au rapport. Si aucune réponse n'est reçue, huntr résout manuellement les rapports élevés et critiques dans un délai de 14 jours.

- Récompense: Si le rapport est validé par le responsable ou par huntr, le chercheur reçoit une prime en récompense de sa contribution.

- Publication: Pour les projets open source, les rapports de vulnérabilité sont rendus publics après 90 jours, ce qui laisse aux responsables le temps de résoudre le problème. Les responsables peuvent demander des extensions si nécessaire. Les rapports concernant les formats de fichiers de modèles ne sont pas divulgués publiquement.

Pourquoi huntr est-il important ?

À mesure que l'IA et le ML s'intègrent de plus en plus dans divers aspects de nos vies, la nécessité de garantir la sécurité de ces systèmes est primordiale. Huntr répond à ce besoin en :

- Encourageant la découverte de vulnérabilités: En offrant des primes, huntr encourage les chercheurs en sécurité à rechercher et à signaler activement les vulnérabilités dans les projets d'IA/ML.

- Facilitant la collaboration: Huntr fournit une plateforme permettant aux chercheurs et aux responsables de collaborer à la résolution des problèmes de sécurité.

- Améliorant la sécurité de l'IA/ML: En identifiant et en résolvant les vulnérabilités, huntr contribue à la sécurité et à la stabilité globales des systèmes d'IA/ML.

À qui s'adresse huntr ?

Huntr est précieux pour diverses parties prenantes :

- Chercheurs en sécurité: Une plateforme pour signaler les vulnérabilités et gagner des récompenses, contribuant à la sécurité des projets d'IA/ML.

- Responsables de projets d'IA/ML: Un moyen d'identifier et de résoudre de manière proactive les problèmes de sécurité dans leurs projets.

- Organisations utilisant l'IA/ML: Confiance accrue dans la sécurité des composants d'IA/ML sur lesquels elles s'appuient.

Projets d'IA/ML pris en charge:

Huntr prend en charge plus de 240 programmes d'IA/ML, y compris des projets populaires tels que :

- NVIDIA/nvidia-container-toolkit

- apache/spark

- huggingface/text-generation-inference

- intel/neural-compressor

- mongodb/mongo-python-driver

- huggingface/transformers

- pytorch/pytorch

- scikit-learn/scikit-learn

- keras-team/keras

- apache/airflow

- numpy/numpy

- microsoft/LightGBM

- onnx/onnx

- jupyter/jupyter

- mlflow/mlflow

- aws/aws-cli

- nltk/nltk

- kubeflow/kubeflow

- apache/arrow

- apache/tvm

- microsoft/onnxruntime

- deepmind/sonnet

- NVIDIA/TensorRT

- triton-inference-server/server

- huggingface/tokenizers

- Netflix/metaflow

- elastic/elasticsearch-py

- pytorch/serve

- h5py/h5py

- aimhubio/aim

- joblib/joblib

- scikit-optimize/scikit-optimize

- keras-team/keras-tuner

- aws/sagemaker-python-sdk

- run-llama/llama_index

- facebookresearch/faiss

- facebookresearch/fairseq

- deepjavalibrary/djl

- microsoft/autogen

- microsoft/promptbench

- ollama/ollama

- huggingface/smolagents

Ces projets couvrent un large éventail d'applications d'IA/ML, soulignant l'approche globale de huntr en matière de sécurité de l'IA.

Principales caractéristiques

- Plateforme de Bug Bounty pour les projets d'IA/ML

- Processus sécurisé de divulgation des vulnérabilités

- Système de récompense incitatif pour les chercheurs

- Collaboration entre les chercheurs et les responsables

- Rapports publics sur les vulnérabilités pour les projets open source

Huntr est soutenu par Protect AI et ouvre la voie au MLSecOps et à une plus grande sécurité de l'IA.

Quelle est la meilleure façon de sécuriser vos projets d'IA/ML ? Rejoignez huntr dès aujourd'hui et contribuez à un écosystème d'IA plus sûr.

Meilleurs outils alternatifs à "huntr"

Pervaziv AI fournit une sécurité logicielle alimentée par l'IA générative pour les environnements multi-cloud, en scannant, corrigeant, construisant et déployant des applications en toute sécurité. Des flux de travail DevSecOps plus rapides et plus sûrs sur Azure, Google Cloud et AWS.

Think AI Agency aide à transformer les idées en MVP grâce à l'IA et à l'automatisation. Ils offrent un développement MVP rapide et abordable, soutenu par YC & Alchemist, promettant une préparation en quelques semaines. Les services incluent le NLP, les LLM personnalisés, etc.

AquilaX Security est une plateforme DevSecOps alimentée par l'IA qui automatise l'analyse de sécurité, réduit les faux positifs et aide les développeurs à livrer du code sécurisé plus rapidement. Intègre les scanners SAST, SCA, conteneur, IaC, secrets et logiciels malveillants.

Améliorez la qualité de votre logiciel grâce aux services d'ingénierie qualité basés sur l'IA de BugRaptors. Bénéficiez de tests manuels augmentés par l'IA, d'une automatisation pilotée par l'IA et de tests de sécurité de l'IA.

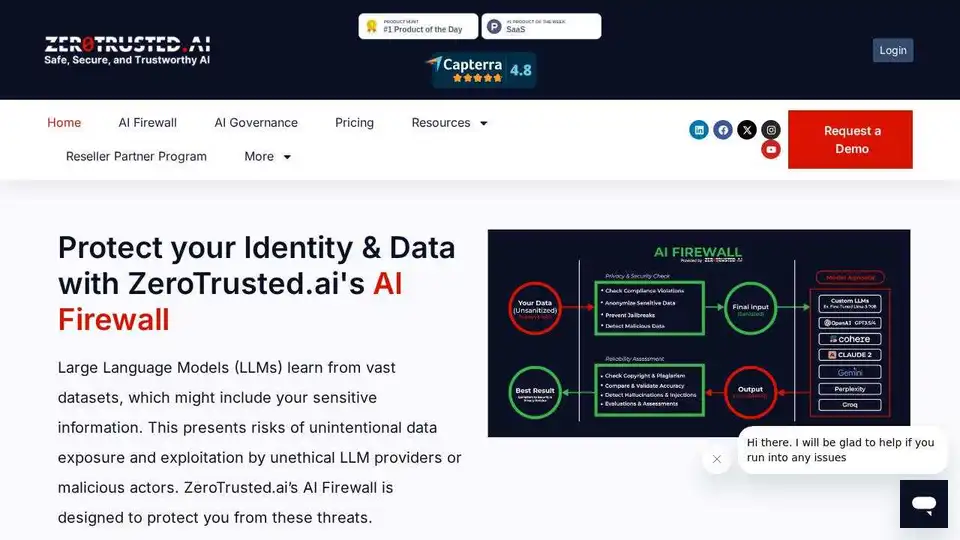

ZeroTrusted.ai propose un pare-feu IA, une passerelle IA et un contrôle de santé IA pour sécuriser votre écosystème IA. Découvrez et bloquez les outils d'IA non autorisés, assurez la sécurité des données et maintenez la conformité.

Modernisez vos applications legacy en semaines avec le processus à 4 étapes alimenté par IA d'iBEAM. Améliorez les performances, réduisez les coûts, renforcez la sécurité et assurez l'évolutivité avec une transformation d'apps dirigée par des experts.

Amazon Q Developer est un assistant d'IA générative sur AWS pour le développement de logiciels, offrant des fonctionnalités telles que l'implémentation de code, les tests et la refactorisation pour accélérer le cycle de vie du développement.

nbot.ai est un curateur de contenu alimenté par IA qui crée des flux personnalisés à partir de sources web, résume les insights, filtre le bruit et permet un affinage par chat en temps réel pour tout niche.

Sounder AI utilise l'IA pour fournir des solutions de ciblage contextuel et de sécurité de la marque pour la publicité de podcasts, aidant ainsi les éditeurs et les marques à maximiser leur portée et leurs revenus.

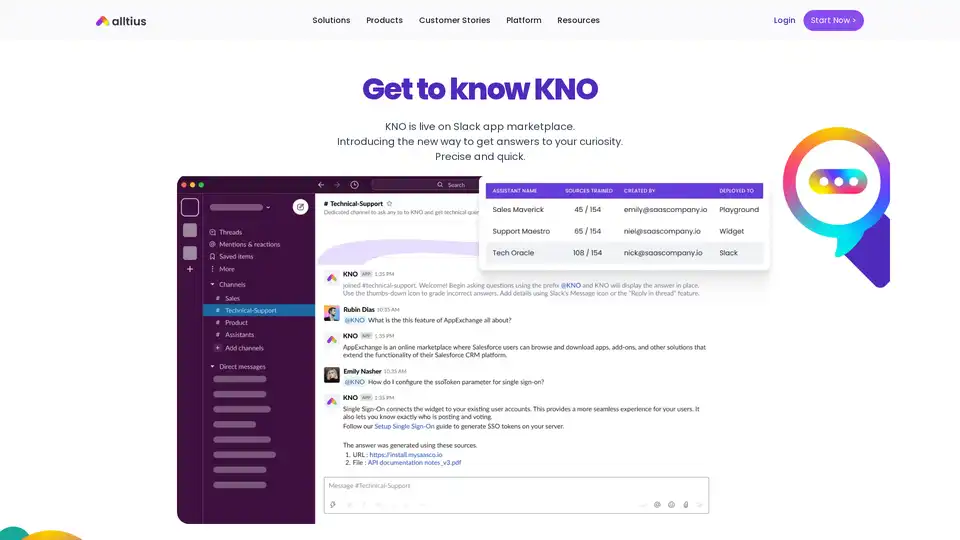

KNO est un assistant Slack alimenté par l'IA qui fournit des réponses techniques précises en utilisant la technologie GPT-3. Il offre des conversations sécurisées et privées et s'intègre parfaitement aux espaces de travail Slack.

DaveAI est un cloud d'expérience conversationnelle utilisant des agents d'IA, des avatars et des visualisations pour personnaliser les parcours clients et stimuler l'engagement sur le Web, les bornes, WhatsApp et les déploiements périphériques.

Envistudios propose des solutions basées sur l'IA, Documente & Infomente, tirant parti de l'IA, du NLP et du ML pour débloquer des informations sur les données et stimuler la transformation de l'entreprise. Simplifiez la prise de décision grâce à leurs outils intelligents.

Vectra AI est une plateforme leader en cybersécurité utilisant l'IA pour détecter et arrêter les attaques modernes sur les réseaux, l'identité et le cloud, réduisant les temps de réponse jusqu'à 99 %. De confiance pour plus de 2 000 équipes mondiales.

WhyLabs fournit l'observabilité de l'IA, la sécurité LLM et la surveillance des modèles. Protégez les applications d'IA générative en temps réel pour atténuer les risques.