Runpod

Vue d'ensemble de Runpod

Runpod : Le cloud conçu pour l’IA

Runpod est une plateforme cloud tout-en-un conçue pour simplifier le processus de formation, d’ajustement et de déploiement des modèles d’IA. Il s’adresse aux développeurs d’IA en fournissant une infrastructure GPU simplifiée et une solution cloud d’IA de bout en bout.

Qu’est-ce que Runpod ?

Runpod est une plateforme cloud complète qui simplifie les complexités de la création et du déploiement de modèles d’IA. Il offre une gamme de ressources et d’outils GPU qui permettent aux développeurs de se concentrer sur l’innovation plutôt que sur la gestion de l’infrastructure.

Comment fonctionne Runpod ?

Runpod simplifie le flux de travail de l’IA en un flux unique et cohérent, permettant aux utilisateurs de passer de l’idée au déploiement en toute transparence. Voici comment cela fonctionne :

- Spin Up: Lancez un pod GPU en quelques secondes, éliminant ainsi les délais de provisionnement.

- Build: Formez des modèles, effectuez le rendu de simulations ou traitez des données sans limitations.

- Iterate: Expérimentez en toute confiance grâce à une rétroaction instantanée et à des restaurations sécurisées.

- Deploy: Effectuez une mise à l’échelle automatique entre les régions sans coûts d’inactivité ni temps d’arrêt.

Principales caractéristiques et avantages:

- Ressources GPU à la demande:

- Prend en charge plus de 30 références GPU, des B200 aux RTX 4090.

- Fournit des environnements entièrement chargés et compatibles GPU en moins d’une minute.

- Déploiement mondial:

- Exécutez des charges de travail dans plus de 8 régions du monde.

- Garantit des performances à faible latence et une fiabilité globale.

- Mise à l’échelle sans serveur:

- S’adapte à votre charge de travail en temps réel, en passant de 0 à 100 travailleurs de calcul.

- Ne payez que ce que vous utilisez.

- Temps de disponibilité de niveau entreprise:

- Gère les basculements, garantissant ainsi le bon fonctionnement des charges de travail.

- Orchestration gérée:

- Les files d’attente sans serveur distribuent les tâches de manière transparente.

- Journaux en temps réel:

- Fournit des journaux, une surveillance et des mesures en temps réel.

Pourquoi choisir Runpod ?

- Rentable:

- Runpod est conçu pour maximiser le débit, accélérer la mise à l’échelle et accroître l’efficacité, garantissant ainsi que chaque dollar travaille plus fort.

- Flexibilité et évolutivité:

- L’infrastructure GPU évolutive de Runpod offre la flexibilité nécessaire pour s’adapter au trafic client et à la complexité des modèles.

- Convivial pour les développeurs:

- Runpod simplifie chaque étape du flux de travail de l’IA, permettant aux développeurs de se concentrer sur la création et l’innovation.

- Fiabilité:

- Offre une disponibilité de niveau entreprise et garantit le bon fonctionnement des charges de travail, même lorsque les ressources ne le font pas.

À qui s’adresse Runpod ?

Runpod est conçu pour :

- Les développeurs d’IA

- Les ingénieurs en apprentissage automatique

- Les scientifiques des données

- Les chercheurs

- Les startups

- Les entreprises

Comment utiliser Runpod ?

- Inscrivez-vous: Créez un compte sur la plateforme Runpod.

- Lancez un pod GPU: Choisissez parmi une variété de références GPU et lancez un environnement entièrement chargé en quelques secondes.

- Créez et formez: Utilisez l’environnement pour former des modèles, effectuer le rendu de simulations ou traiter des données.

- Déployez: Mettez à l’échelle vos charges de travail dans plusieurs régions sans temps d’arrêt.

Témoignages de réussite de clients:

De nombreux développeurs et entreprises ont réussi grâce à Runpod. Voici quelques exemples :

- InstaHeadshots : A économisé 90 % sur sa facture d’infrastructure en utilisant la puissance de calcul en rafale en cas de besoin.

- Coframe : A évolué sans effort pour répondre à la demande lors du lancement, grâce à la flexibilité offerte par Runpod.

Applications concrètes

Runpod est polyvalent et prend en charge diverses applications, notamment :

- L’inférence

- Le réglage fin

- Les agents d’IA

- Les tâches gourmandes en calcul

En choisissant Runpod, les organisations peuvent :

- Réduire les frais généraux de gestion de l’infrastructure.

- Accélérer les cycles de développement de l’IA.

- Réaliser une mise à l’échelle rentable.

- Garantir des performances fiables.

Runpod fait de la gestion de l’infrastructure son travail, vous permettant ainsi de vous concentrer sur la création de la prochaine étape. Que vous soyez une startup ou une entreprise, la plateforme cloud d’IA de Runpod fournit les ressources et le support nécessaires pour donner vie à vos projets d’IA.

En résumé, Runpod offre une solution complète, rentable et évolutive pour le développement et le déploiement de l’IA. Il s’agit d’une plateforme idéale pour les développeurs qui cherchent à créer, à former et à mettre à l’échelle efficacement des modèles d’apprentissage automatique.

Meilleurs outils alternatifs à "Runpod"

Runpod est une plateforme cloud IA tout-en-un qui simplifie la construction et le déploiement de modèles d'IA. Entraînez, affinez et déployez l'IA sans effort grâce à une puissance de calcul élevée et à une mise à l'échelle automatique.

Novita AI fournit plus de 200 API de modèles, un déploiement personnalisé, des instances GPU et des GPU sans serveur. Mettez à l'échelle l'IA, optimisez les performances et innovez avec facilité et efficacité.

Float16.Cloud fournit des GPU sans serveur pour un développement rapide de l'IA. Exécutez, entraînez et faites évoluer des modèles d'IA instantanément sans configuration. Comprend des GPU H100, une facturation à la seconde et une exécution Python.

Predibase est une plateforme de développement pour l'affinage et le service de LLM open source. Obtenez une précision et une vitesse inégalées grâce à une infrastructure de formation et de service de bout en bout, avec un affinage de renforcement.

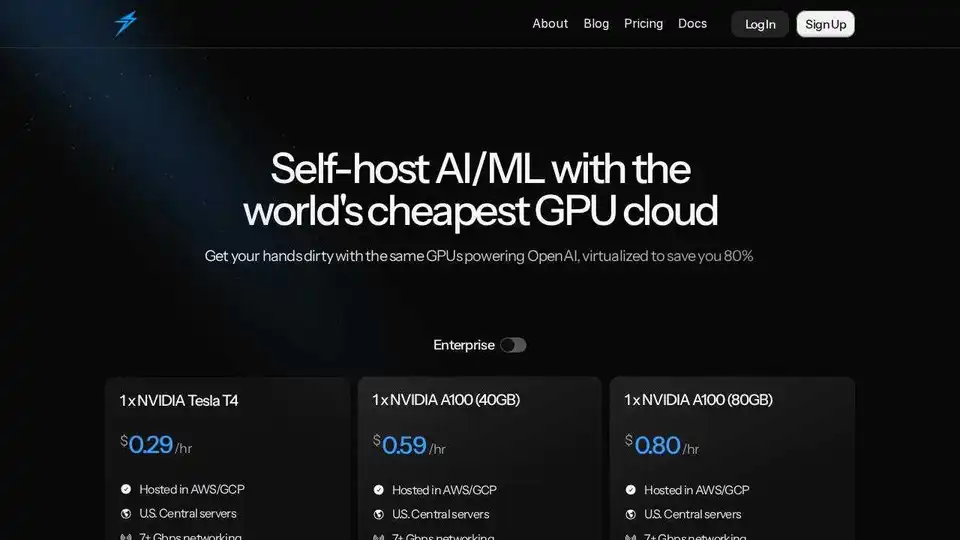

Thunder Compute est une plateforme cloud GPU pour l'IA/ML, offrant des instances GPU en un clic dans VSCode à des prix 80 % inférieurs à ceux de la concurrence. Parfait pour les chercheurs, les startups et les data scientists.

Lumino est un SDK facile à utiliser pour l'entraînement à l'IA sur une plateforme cloud mondiale. Réduisez vos coûts de formation ML jusqu'à 80 % et accédez à des GPU non disponibles ailleurs. Commencez à entraîner vos modèles d'IA dès aujourd'hui !

Cerebrium est une plateforme d'infrastructure d'IA sans serveur qui simplifie le déploiement d'applications d'IA en temps réel avec une faible latence, zéro DevOps et une facturation à la seconde. Déployez des LLM et des modèles de vision à l'échelle mondiale.

Replicate vous permet d'exécuter et d'affiner des modèles d'apprentissage automatique open source avec une API cloud. Créez et faites évoluer facilement des produits d'IA.

Anyscale, alimenté par Ray, est une plateforme pour exécuter et mettre à l'échelle toutes les charges de travail de ML et d'IA sur n'importe quel cloud ou sur site. Créez, déboguez et déployez des applications d'IA avec facilité et efficacité.

Deployo simplifie le déploiement des modèles d'IA, transformant les modèles en applications prêtes pour la production en quelques minutes. Infrastructure d'IA agnostique du cloud, sécurisée et évolutive pour un flux de travail d'apprentissage automatique sans effort.

Plateforme IA ultra-rapide pour les développeurs. Déployez, affinez et exécutez plus de 200 LLMs et modèles multimodaux optimisés avec des API simples - SiliconFlow.

Modal : Plateforme sans serveur pour les équipes d'IA et de données. Exécutez des calculs CPU, GPU et gourmands en données à grande échelle avec votre propre code.

Xander est une plateforme de bureau open source qui permet l'entraînement de modèles IA sans code. Décrivez les tâches en langage naturel pour des pipelines automatisés en classification de texte, analyse d'images et fine-tuning LLM, assurant la confidentialité et les performances sur votre machine locale.

Fluidstack est une plateforme cloud d'IA de pointe offrant un accès immédiat à des milliers de GPU avec InfiniBand pour l'entraînement et l'inférence de l'IA. Clusters GPU sécurisés et haute performance pour la recherche, les entreprises et les initiatives souveraines en matière d'IA.