Supermemory の概要

Supermemory:AI時代のメモリレイヤー

Supermemoryとは? Supermemoryは、AIのためのメモリレイヤーの構築に焦点を当てた研究および製品ラボとして紹介されており、効率的にスケールできる動的な人間のようなメモリを提供することを目指しています。開発者とエンドユーザーの両方が、アプリケーションやワークフローでAIメモリを活用するためのツールを提供します。

主な機能:

- Memory API & Router: Supermemoryは、高速でスケーラブルなMemory APIとRouterを提供し、開発者がアプリケーションに長期記憶機能を追加できるようにします。

- 効率的なメモリの作成とストレージ: システムは、効率的なメモリの作成、ストレージ、および検索機能を提供することを約束します。

- パフォーマンス: Supermemoryは、既存のメモリソリューションよりも2倍高速で安価であると主張しています。

- クロスクライアントメモリ: ユーザーは、ChatGPT、Claude、CursorなどのさまざまなAIクライアント間で自分のメモリにアクセスできます。

- 統合: Supermemoryは、MCP(メモリコントロールパネル)を介して100以上のAIクライアントと統合されています。

- 自動メモリの作成と推論: システムは、グラフを使用した自動メモリの作成と推論をサポートしています。

Supermemoryの仕組み

Supermemoryは、開発者がメモリ機能をAIアプリケーションに統合するために使用できるAPIとSDK(Supermemory SDK)を提供することで機能します。これにより、情報の効率的なストレージと検索が可能になり、AIモデルが過去のインタラクションとデータを保持およびリコールできるようになります。

Supermemoryの使い方

開発者向け: 開発者は、Supermemory APIとSDKを使用して、アプリケーションに長期記憶機能を追加できます。これには以下が含まれます。

- APIをAIアプリケーションに統合します。

- メモリの作成、ストレージ、および検索機能を活用します。

- 効率的なメモリ管理のためにルーターを活用します。

ユーザー向け: ユーザーは、100以上のAIクライアントと統合されたMCPを使用して、さまざまなAIクライアント間で自分のメモリにアクセスできます。これにより、ユーザーはさまざまなプラットフォームで一貫したメモリ体験を得ることができます。

Supermemoryは誰のためのものですか?

Supermemoryは、主に次の2つのグループを対象としています。

- AI開発者: メモリ機能をAIアプリケーションに追加しようとしている開発者は、Memory APIとSDKを使用できます。

- AIユーザー: 複数のAIプラットフォームで統一されたメモリ体験を求めているユーザーは、MCPの恩恵を受けることができます。

Supermemoryが重要な理由

メモリは、インテリジェントシステムの重要なコンポーネントです。高速でスケーラブルで動的なメモリレイヤーを提供することにより、SupermemoryはAIアプリケーションの機能を強化します。これにより、次のことが可能になります。

- 時間の経過とともに情報を保持します。

- インタラクションをパーソナライズします。

- 過去の経験に基づいて、より多くの情報に基づいた意思決定を行います。

ユースケース:

- パーソナライズされたAIアシスタント: ユーザーの好みと過去のインタラクションを記憶するAIアシスタントを作成します。

- コンテキストアウェアなチャットボット: コンテキストを維持し、より関連性の高い応答を提供できるチャットボットを開発します。

- 強化されたAIエージェント: 経験から学び、変化する環境に適応できるAIエージェントを構築します。

Supermemory Appのウェイティングリストはありますか?

はい、新しいMCP(Memory Control Panel)のウェイティングリストがあります。

主なポイント:

Supermemoryは、メモリをAIアプリケーションに統合するためのソリューションを提供します。人間の記憶を模倣するメモリレイヤーを提供することにより、AIインタラクションのパフォーマンスとパーソナライズを向上させることを目指しています。Supermemoryは、長期記憶機能でAIアプリケーションを強化しようとしている人向けであり、データを効率的に保存、リコール、およびパーソナライズする手段を提供します。

"Supermemory" のベストな代替ツール

Langbaseは、メモリとツールを備えたAIエージェントを構築、デプロイ、および拡張できるサーバーレスAI開発者プラットフォームです。250以上のLLM用の統一APIと、RAG、コスト予測、オープンソースAIエージェントなどの機能を備えています。

Marvin は、大規模言語モデル (LLM) を使用した AI アプリケーション構築のための強力な Python フレームワークです。状態管理、エージェント調整、構造化出力を簡素化し、インテリジェントなアプリを作成する開発者に適しています。

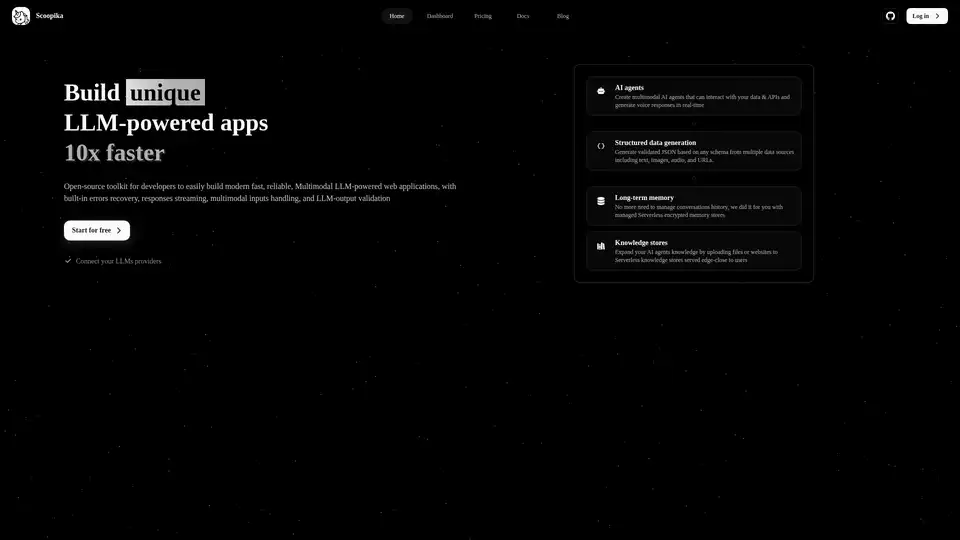

Scoopikaは、LLMとAIエージェントを使用してマルチモーダルAIアプリを構築するためのオープンソースプラットフォームであり、エラー回復、ストリーミング、データ検証機能を備えています。