AnimateDiff

AnimateDiff の概要

AnimateDiffとは?

AnimateDiffは、静止画像やテキストプロンプトをスムーズなフレームシーケンスで動的なアニメーション動画に変換する革新的なAIツールです。Stable Diffusionを基盤として構築され、専門的なモーションモジュールを統合して現実的な動きを予測・適用するため、AI駆動の動画作成においてゲームチェンジャーとなっています。アイデアをスケッチするアーティストでも、ビジュアルのプロトタイプを作成する開発者でも、AnimateDiffはコンセプトを魅力的なアニメーションに変換するプロセスを効率化し、手動でのフレームごとの作業を不要にします。このオープンソースフレームワークは、AUTOMATIC1111's WebUIなどの拡張機能を通じて利用可能で、ユーザーが拡散モデルを活用してテキストから動画、画像から動画を生成できるようにし、アート、ゲーム、教育などの分野での効率的なコンテンツ作成への道を開きます。

AnimateDiffの仕組み

中核では、AnimateDiffはStable Diffusionなどの事前学習済みテキスト-to-画像または画像-to-画像拡散モデルと、専用のモーションモジュールを組み合わせます。このモジュールは多様な実世界の動画クリップで訓練され、一般的な動きのパターン、ダイナミクス、遷移を捕捉し、アニメーションを自然で生き生きとしたものにします。

テキスト-to-動画プロセス

- 入力プロンプト: シーン、キャラクター、アクション、またはコンセプトを概説する記述的なテキストプロンプトから開始します(例:「夕暮れ時にホタルが舞う静かな森」)。

- ベースモデル生成: Stable Diffusionのバックボーンがプロンプトに基づいて視覚コンテンツに焦点を当てた初期キーフレームを生成します。

- モーション統合: モーションモジュールがプロンプトと前のフレームを分析してダイナミクスを予測し、シームレスな遷移のために中間フレームを補間します。

- 出力レンダリング: 調整されたシステムが短い動画クリップまたはGIFを生成します。通常は8-16 FPSで16-24フレーム、動きのあるアニメーション要素を表示します。

画像-to-動画プロセス

既存のビジュアルをアニメーション化する場合:

- 画像アップロード: 静止写真、アートワーク、またはAI生成画像を提供します。

- バリエーション生成: Stable Diffusionのimg2imgを使用して微妙なキーフレームのバリエーションを作成します。

- モーション適用: モーションモジュールが推論されたダイナミクスを追加し、オブジェクトや背景などの要素をアニメーション化します。

- 最終動画: 元の画像が命を得て生き生きとする動画クリップが結果として得られ、デジタルアートや個人写真に命を吹き込むのに理想的です。

このプラグアンドプレイアプローチは、大規模な再トレーニングが不要であることを意味します—単にモーションモジュールをStable Diffusion設定に統合するだけです。ユーザーは、カメラ効果(パン、ズーム)のためのMotion LoRAや、参照動画から導かれた動きのためのControlNetなどの高度なオプションで出力を微調整でき、制御性と創造性を高めます。

AnimateDiffの主な機能

- プラグアンドプレイ統合: 拡張機能を介してStable Diffusion v1.5モデルとシームレスに連携し、基本的な使用には重い設定が不要です。

- 多様な生成モード: テキスト-to-動画、画像-to-動画、ループアニメーション、さらにはテキストガイダンスによる動画-to-動画編集をサポートします。

- パーソナライゼーションオプション: DreamBoothやLoRAと組み合わせて、データセットで訓練したカスタムサブジェクトをアニメーション化します。

- 高度な制御: FPS、フレーム数、コンテキストバッチサイズを調整してよりスムーズな動きを実現;シームレスなサイクルのためのクローズループや、拡張された流動性のためのリバースフレームを有効にします。

- 効率性: capableなハードウェアで短いクリップを迅速に生成し、モノリシックな動画モデルを一から構築するよりも高速です。

これらの機能により、AnimateDiffは迅速なプロトタイピングのための柔軟なツールとなり、アイデアからアニメーション出力までの時間を短縮します。

AnimateDiffの使用方法

開始は簡単です。特にanimatediff.orgの無料オンライン版はインストール不要です。

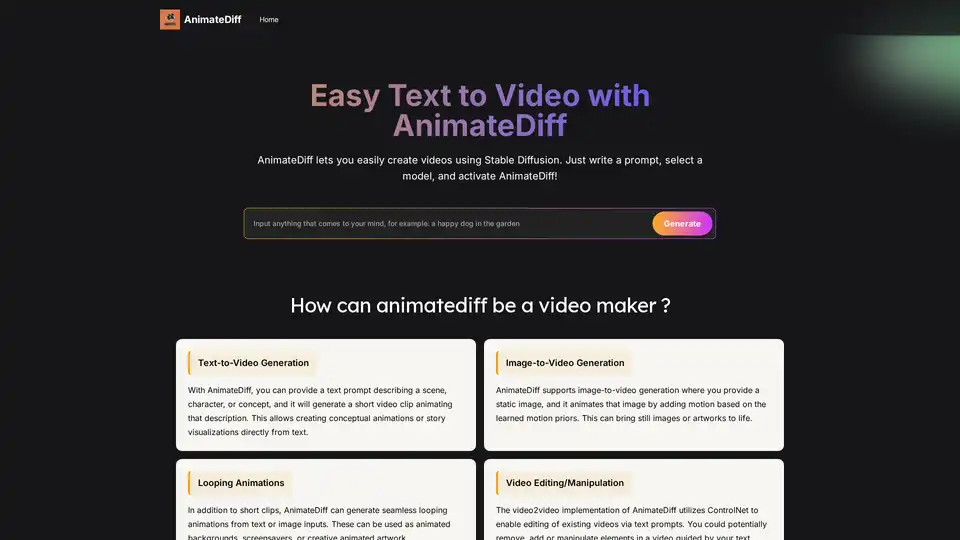

オンライン使用(設定不要)

- animatediff.orgにアクセスします。

- テキストプロンプトを入力します(例:「虹を跳び越える猫」)。

- 利用可能なモデルとモーションスタイルを選択します。

- 生成を実行—AIがサーバー側で処理し、ダウンロード可能なGIFまたは動画を提供します。

- 初心者や簡単なテストに理想的で、ローカルリソースなしで完全オンラインです。

上級ユーザー向けローカルインストール

全機能を解放するには:

- AUTOMATIC1111's Stable Diffusion WebUIをインストールします。

- 拡張機能>URLからインストールに進み、https://github.com/continue-revolution/sd-webui-animatediff を貼り付けます。

- モーションモジュール(例:mm_sd_v15_v2.ckpt)をダウンロードし、extensions/animatediff/modelフォルダに配置します。

- WebUIを再起動;AnimateDiffがtxt2img/img2imgタブに表示されます。

- プロンプトを入力し、AnimateDiffを有効化、フレーム/FPSを設定し、生成します。

Google Colabユーザー向けに、クラウドベースの実行のためのノートブックが利用可能です。基本的なセットアップ以外にコーディングの専門知識は不要—チュートリアルがPythonやNvidia CUDAなどの依存関係を案内します。

システム要件

- GPU: 8GB以上のVRAMを搭載したNvidia(動画-to-動画には10GB以上);RTX 3060以上推奨。

- OS: Windows/Linuxメイン;macOSはDocker経由。

- RAM/ストレージ: 16GB RAM、モデルと出力用に1TBストレージ。

- 互換性: Stable Diffusion v1.5のみ;GitHubでアップデートを確認。

これらを満たすと、生成時間がクリップあたり数分に短縮され、ハードウェア性能に比例します。

潜在的なユースケースと応用

AnimateDiffは、迅速なAI支援アニメーションを要求するシナリオで輝き、効率的なビジュアルストーリーテリングの検索意図に沿います。

アートとアニメーション

アーティストはテキストからスケッチやストーリーボードをプロトタイプ化し、手動描画の時間を節約できます。例えば、キャラクターの歩行周期を即座に可視化し、創造的なワークフローでより迅速に反復できます。

ゲーム開発

プロトタイプのためのアセットアニメーションを迅速に生成—例えば、敵の動きやUI遷移—完全なアニメーションチームなしでプレプロダクションを加速します。

教育と可視化

抽象的な概念を魅力的な動画に変換します。歴史的なイベントや科学的プロセスのアニメーション化など、学習をインタラクティブで記憶に残るものにします。

ソーシャルメディアとマーケティング

目を引く投稿や広告を作成:製品公開を説明し、InstagramやTikTok準備のループアニメーションを取得し、最小限の努力でエンゲージメントを向上させます。

モーショングラフィックスとプレビジュアライゼーション

動画のダイナミックなイントロを制作したり、高価なレンダリング/撮影前に複雑なシーンをプレビューしたりします。映画制作者やAR/VR開発者に理想的です。

拡張現実では、自然な動きでキャラクターをアニメーション化;広告では、ブランド画像からパーソナライズされたプロモクリップを作成します。

AnimateDiffを選ぶ理由

Adobe After Effectsなどの伝統的なツールと比較して、AnimateDiffは重労働を自動化し、プロのスキルなしで高品質のアニメーションをアクセス可能にします。実動画から学んだモーション事前分布への依存は現実性を確保し、プロンプトによる制御性はAI生成における一般的な課題点に対処します。無料でオープンソースであるため、ホビーistsとプロの両方に費用対効果が高く、GitHub経由のコミュニティ駆動のアップデートがあります。ハリウッドレベルの複雑さには完璧ではありませんが、アイデア創出とショートフォームコンテンツにおいては無敵で、AI動画ツールの革新を促進します。

「最高のテキスト-to-動画AI」や「Stable Diffusionで画像をアニメーション化」を検索するユーザーにとって、AnimateDiffはその拡散モデルの遺産とモーション専門知識に支えられて信頼できる結果を提供します。

AnimateDiffの対象者

- クリエイティブプロフェッショナル: 迅速な可視化を必要とするアーティスト、アニメーター、デザイナー。

- 開発者とゲーマー: インタラクティブ要素のプロトタイピング用。

- 教育者/コンテンツクリエイター: 説明的または娯楽的なメディアの構築。

- マーケター/ソーシャルインフルエンサー: 迅速でカスタマイズ可能なアニメーションアセット。

- ホビーists: 深い技術的障壁なしにAIアニメーションに興味がある任何人。

特にStable Diffusionに精通している人に適していますが、オンラインデモが参入障壁を下げます。

制限と最良の結果のためのヒント

強力ですが、AnimateDiffには制約があります:

- モーション範囲: シンプルでトレーニングデータに沿った動きに最適;複雑なアクションは調整が必要な場合があります。

- アーティファクト: 高い動きはグリッチを導入する可能性があります—低いフレーム数から開始します。

- 長さ/一貫性: 短いクリップ(50フレーム未満)で優れる;長い動画は一貫性のリスクがあります。

- モデル制限: SD v1.5のみ;v2互換性に注意。

ヒント:アクション記述子を含む詳細なプロンプトを使用(例:「ゆっくり回転するカメラ」)、スタイルのためのLoRAを実験し、Premiereなどのツールで後処理をして磨きをかけます。拡散技術が進化するにつれて、AnimateDiffのコミュニティはこれらを改良し続け、よりスムーズな出力を約束します。

要約すると、AnimateDiffはStable Diffusionの画像能力とスマートなモーション予測を融合させ、アニメーション作成方法を革命化します。AI動画生成を探求する任何人にとって、努力せずに想像を動きに変える必須試用ツールです。

AnimateDiff関連タグ