Spice.ai

Visão geral de Spice.ai

Spice.ai: O Motor de Inferência de Dados e IA de Código Aberto

O que é Spice.ai?

Spice.ai é um motor de inferência de dados e IA de código aberto projetado para capacitar os desenvolvedores a construir aplicações de IA com facilidade. Ele fornece os blocos de construção para criar soluções de IA orientadas a dados, permitindo federação de consultas SQL, aceleração, pesquisa e recuperação com base em dados empresariais.

Principais Características e Benefícios

- Federação de Consultas SQL: Una dados em várias fontes, incluindo bancos de dados, data warehouses, data lakes e APIs, usando uma única consulta SQL. Isso elimina silos de dados e simplifica o acesso aos dados.

- Aceleração de Dados: Alcance desempenho de consulta rápido, de baixa latência e alta simultaneidade por meio da materialização e aceleração de dados na memória ou usando bancos de dados incorporados como DuckDB ou SQLite.

- Implantação e Serviço de Modelos de IA: Carregue e sirva modelos locais como Llama3 ou utilize plataformas de IA hospedadas como OpenAI, xAI e NVidia NIM. Spice.ai fornece ferramentas LLM específicas para pesquisa e recuperação.

- Blocos de Construção Componíveis: Adote incrementalmente blocos de construção para acesso, aceleração, pesquisa, recuperação e inferência de IA de dados. Componha-os para desenvolver aplicativos e agentes baseados em dados.

- Atualizações de Dados em Tempo Real: Mantenha as acelerações atualizadas em tempo real com Change-Data-Capture (CDC) usando Debezium.

- Multi-Cloud e Alta Disponibilidade: Implante a Plataforma Spice Cloud em um ambiente multi-cloud com alta disponibilidade, segurança, desempenho e conformidade, com o apoio de um SLA e suporte de nível empresarial. É certificado SOC 2 Tipo II.

- Compatibilidade com o Ecossistema: Integre-se perfeitamente com bibliotecas populares de ciência de dados, como NumPy, Pandas, TensorFlow e PyTorch.

Como Funciona o Spice.ai?

Spice.ai aproveita um motor de computação portátil construído em Rust no Apache Arrow e DataFusion para fornecer um motor de consulta rápido de nó único. Isso permite que você consulte dados de várias fontes e os acelere para acesso de baixa latência.

Como Usar o Spice.ai

- Conecte-se aos Seus Dados: Spice.ai oferece conectores para mais de 30 fontes modernas e legadas, incluindo Databricks, MySQL e arquivos CSV em servidores FTP. Ele suporta protocolos padrão do setor, como ODBC, JDBC, ADBC, HTTP e Apache Arrow Flight (gRPC).

- Consulte Seus Dados: Use SQL para consultar seus dados em várias fontes. Spice.ai fornece um recurso de federação de consultas SQL que permite unir dados de diferentes fontes em uma única consulta.

- Acelere Seus Dados: Materialize e acelere seus dados na memória ou usando bancos de dados incorporados como DuckDB ou SQLite. Isso melhorará o desempenho de suas consultas.

- Implante e Sirva Modelos de IA: Carregue e sirva modelos locais ou utilize plataformas de IA hospedadas. Spice.ai fornece ferramentas LLM específicas para pesquisa e recuperação.

Para Quem é o Spice.ai?

Spice.ai foi projetado para desenvolvedores, cientistas de dados e engenheiros de IA que desejam construir aplicações de IA orientadas a dados. É adequado para uma ampla gama de casos de uso, incluindo:

- Aplicações alimentadas por IA: Crie aplicações inteligentes que aproveitem dados de várias fontes.

- Análise em tempo real: Analise dados em tempo real para obter insights e tomar decisões informadas.

- Aprendizado de máquina: Treine e implante modelos de aprendizado de máquina com facilidade.

Por Que o Spice.ai é Importante?

Spice.ai simplifica o processo de construção de aplicações de IA orientadas a dados, fornecendo um conjunto abrangente de ferramentas e recursos. Ele elimina a necessidade de construir data pipelines e infraestrutura complexas, permitindo que os desenvolvedores se concentrem na construção de soluções de IA inovadoras.

O Que é a Plataforma Spice Cloud?

A Plataforma Spice Cloud é um serviço gerenciado que fornece um ambiente multi-cloud de alta disponibilidade para executar o Spice.ai. Inclui recursos como segurança, desempenho e conformidade de nível empresarial, com o apoio de um SLA e suporte de nível empresarial.

Comece a Usar o Spice.ai

Começar a usar o Spice.ai é fácil. Você pode começar gratuitamente e consultar com apenas três linhas de código.

Casos de Uso

- Construção de aplicações orientadas a dados

- Implementação de análises de dados em tempo real

- Potencializando fluxos de trabalho de aprendizado de máquina

Com seus blocos de construção componíveis e infraestrutura de nível empresarial, o Spice.ai capacita os desenvolvedores a criar a próxima geração de aplicações inteligentes.

Preços do Spice.ai

Spice.ai oferece uma variedade de planos de preços para atender às necessidades de diferentes usuários. Você pode começar com um plano gratuito e fazer upgrade para um plano pago à medida que suas necessidades crescem.

Em Conclusão

Spice.ai é um poderoso motor de inferência de dados e IA de código aberto que simplifica o processo de construção de aplicações de IA orientadas a dados. Quer você esteja construindo aplicações alimentadas por IA, realizando análises em tempo real ou treinando modelos de aprendizado de máquina, o Spice.ai fornece os blocos de construção que você precisa para ter sucesso. Ele oferece federação de consultas SQL, aceleração de dados e implantação de modelos de IA, tudo isso sendo fácil de começar. Se você é um desenvolvedor procurando uma maneira de acelerar seus dados e construir aplicações de IA, então Spice.ai pode ser a solução perfeita.

Melhores ferramentas alternativas para "Spice.ai"

AI Runner é um mecanismo de inferência de IA offline para arte, conversas de voz em tempo real, chatbots alimentados por LLM e fluxos de trabalho automatizados. Execute geração de imagens, chat de voz e muito mais localmente!

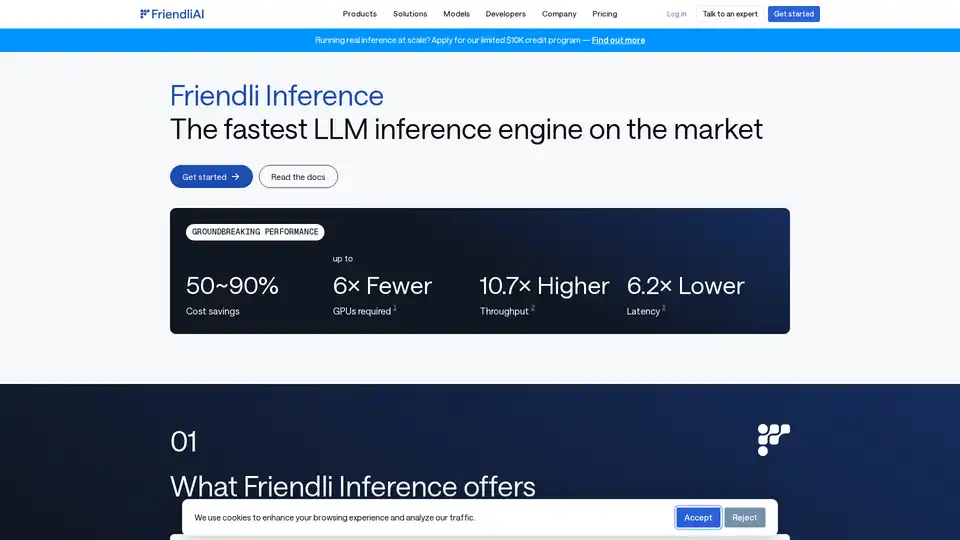

Friendli Inference é o mecanismo de inferência LLM mais rápido, otimizado para velocidade e custo-benefício, reduzindo os custos de GPU em 50-90%, oferecendo alto rendimento e baixa latência.

Habilite a inferência LLM eficiente com llama.cpp, uma biblioteca C/C++ otimizada para diversos hardwares, com suporte a quantização, CUDA e modelos GGUF. Ideal para implantação local e em nuvem.

Explore as APIs NVIDIA NIM para inferência otimizada e implantação de modelos de IA líderes. Crie aplicativos de IA generativa empresarial com APIs sem servidor ou auto-hospedagem em sua infraestrutura de GPU.

Descubra Fast3D, a solução impulsionada por IA para gerar modelos 3D de alta qualidade a partir de texto e imagens em segundos. Explore recursos, aplicações em jogos e tendências futuras.

AniPortrait é um framework de IA de código aberto para gerar animações de retrato fotorrealistas impulsionadas por áudio ou vídeo. Suporta modos autoimpulsionados, reencenação facial e por áudio para síntese de vídeo de alta qualidade.

Tradutor de mangá online com OCR para texto vertical/horizontal. Processamento em lote e diagramação que preserva o layout para mangá e doujin.

MindSpore é um framework de IA de código aberto desenvolvido pela Huawei, suportando treinamento e inferência de aprendizado profundo em todos os cenários. Possui diferenciação automática, treinamento distribuído e implantação flexível.

Cirrascale AI Innovation Cloud acelera o desenvolvimento de IA, o treinamento e as cargas de trabalho de inferência. Teste e implemente nos principais aceleradores de IA com alto rendimento e baixa latência.

Explore o UP AI Development Kit, projetado para computação de borda, automação industrial e soluções de IA. Alimentado por Hailo-8 para desempenho avançado.

Desbloqueie o CDN gratuito e o armazenamento de objetos escalável da SUFY para gerenciamento de dados e IA de mídia perfeitos. Obtenha 100 GB de CDN/mês e 3.000 minutos de transcodificação de vídeo gratuitamente.

Juice permite GPU sobre IP, permitindo que você conecte em rede e agrupe suas GPUs com software para cargas de trabalho de IA e gráficos.

LM-Kit fornece kits de ferramentas de nível empresarial para integração de agentes de IA locais, combinando velocidade, privacidade e confiabilidade para impulsionar aplicativos de próxima geração. Aproveite os LLMs locais para soluções de IA mais rápidas, econômicas e seguras.

DeepSeek v3 é um poderoso LLM orientado por IA com 671 bilhões de parâmetros, oferecendo acesso à API e artigo de pesquisa. Experimente nossa demonstração online para obter um desempenho de última geração.