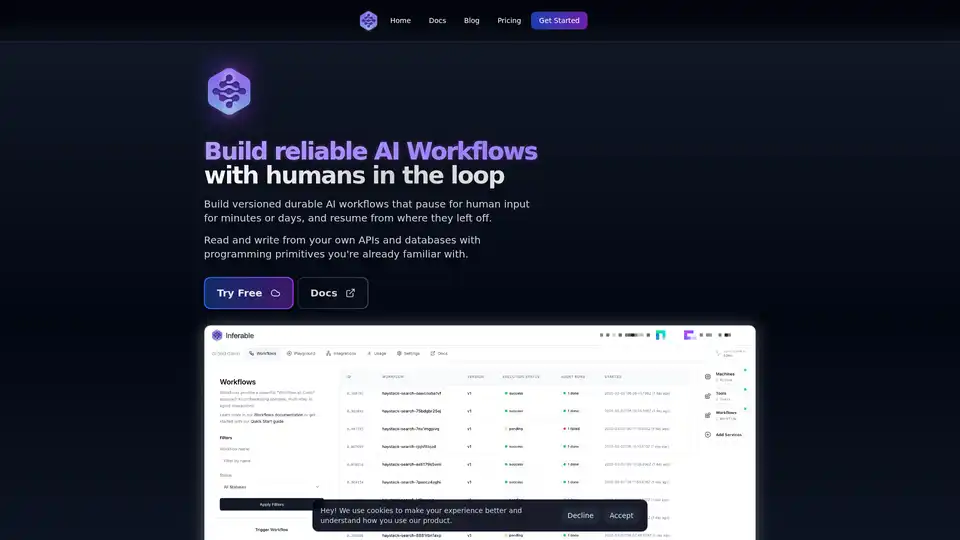

Inferable

Visão geral de Inferable

O que é Inferable?

Inferable é uma plataforma de código aberto projetada para otimizar a criação de agentes de AI, permitindo que desenvolvedores integrem suas bases de código, APIs e dados existentes de forma integrada. Ela se concentra na construção de fluxos de trabalho de AI confiáveis, especialmente aqueles que exigem validação humana no circuito.

Como o Inferable funciona?

Inferable fornece um conjunto de primitivas LLM prontas para produção que lidam com muitas das complexidades envolvidas na construção de fluxos de trabalho de AI. As principais características incluem:

- Versionamento de fluxo de trabalho: Permite a evolução de fluxos de trabalho de longa duração ao longo do tempo de uma forma compatível com versões anteriores. Diferentes versões do mesmo fluxo de trabalho podem ser definidas à medida que os requisitos mudam, garantindo que as execuções em andamento continuem usando a versão original até a conclusão.

- Estado gerenciado: Inferable gerencia todo o estado necessário para fluxos de trabalho duráveis, eliminando a necessidade de os desenvolvedores provisionarem e gerenciarem bancos de dados.

- Humano no circuito: Crie fluxos de trabalho de AI que pausam para entrada humana por minutos ou dias e retomam de onde pararam.

- Observabilidade: Oferece observabilidade de ponta a ponta com um console de desenvolvedor e a capacidade de conectar-se a pilhas de observabilidade existentes.

- Execução On-Premise: Os fluxos de trabalho são executados na infraestrutura do usuário, eliminando a necessidade de uma etapa de implantação.

- Sem conexões de entrada: Segurança aprimorada com conexões somente de saída, garantindo que a infraestrutura permaneça segura sem abrir portas de entrada.

- Código Aberto: Inferable é totalmente de código aberto, oferecendo total transparência e controle sobre o código-fonte.

Exemplo de código:

A plataforma usa uma abordagem simples, orientada por código:

import { Inferable } from "inferable";

const inferable = new Inferable({

apiSecret: require("./cluster.json").apiKey,

});

const workflow = inferable.workflows.create({

name: "customerDataProcessor",

inputSchema: z.object({

executionId: z.string(),

customerId: z.string(),

}),

});

// Versão inicial do fluxo de trabalho

workflow.version(1).define(async (ctx, input) => {

const customerData = await fetchCustomerData(input.customerId);

// Processar os dados com uma análise simples

const analysis = await ctx.llm.structured({

input: JSON.stringify(customerData),

schema: z.object({

riskLevel: z.enum(["low", "medium", "high"]),

summary: z.string(),

}),

});

return { analysis };

});

// Versão aprimorada com análise mais detalhada

workflow.version(2).define(async (ctx, input) => {

const customerData = await fetchCustomerData(input.customerId);

const transactionHistory =

await fetchTransactionHistory(input.customerId);

// Processar os dados com uma análise mais avançada

const analysis = await ctx.llm.structured({

input: JSON.stringify({ customerData, transactionHistory }),

schema: z.object({

riskLevel: z.enum(["low", "medium", "high"]),

summary: z.string(),

recommendations: z.array(z.string()),

factors: z.array(z.object({

name: z.string(),

impact: z.enum(["positive", "negative", "neutral"]),

weight: z.number(),

})),

}),

});

return {

analysis,

version: 2,

processedAt: new Date().toISOString()

};

});

Este exemplo demonstra como definir e versionar um fluxo de trabalho para processar dados do cliente usando análise baseada em LLM.

Por que escolher o Inferable?

- Flexibilidade: Funciona com primitivas de programação existentes para fluxo de controle, sem inverter o modelo de programação.

- Controle: Controle total sobre dados e computação por auto-hospedagem em sua própria infraestrutura.

- Transparência: Beneficie-se da total transparência e controle sobre o código-fonte devido à sua natureza de código aberto.

- Segurança aprimorada: Infraestrutura segura com conexões somente de saída.

Para quem é o Inferable?

Inferable é ideal para startups e scale-ups que buscam construir fluxos de trabalho confiáveis baseados em AI com validação humana no circuito. É particularmente útil para aqueles que precisam:

- Automatizar processos complexos com AI.

- Manter o controle sobre seus dados e infraestrutura.

- Garantir a conformidade com os regulamentos de privacidade de dados.

A melhor maneira de começar com o Inferable?

- Explore a documentação: A documentação abrangente está disponível para guiá-lo na configuração e no uso.

- Guia de auto-hospedagem: Fornece instruções para implantar o Inferable em sua própria infraestrutura.

- Repositório GitHub: Acesse o código-fonte completo de código aberto.

Inferable oferece uma maneira de implementar fluxos de trabalho de AI que são versionados, duráveis e observáveis, com o benefício adicional de supervisão humana, tornando-o uma ferramenta valiosa para empresas que buscam aproveitar a AI em suas operações.

Assistente de Programação com IA Complementação Automática de Código Revisão e Otimização de Código com IA Desenvolvimento Low-Code e No-Code com IA

Melhores ferramentas alternativas para "Inferable"

Langdock é uma plataforma de IA tudo-em-um projetada para empresas, oferecendo chat de IA, assistentes, integrações e automação de fluxo de trabalho. Capacita funcionários e desenvolvedores a aproveitar a IA de forma eficaz.

Agent TARS é um agente de IA multimodal de código aberto que integra perfeitamente operações de navegador, linhas de comando e sistemas de arquivos para automação de fluxo de trabalho aprimorada. Experimente interpretação visual avançada e raciocínio sofisticado para manuseio eficiente de tarefas.

Neural Newsletters é um motor poderoso que ajuda você a criar e publicar newsletters envolventes personalizadas para as preferências e interesses do seu público em minutos.

Potencialize sua marca com criação de conteúdo IA. Obtenha análise de concorrentes, geração de mood boards IA e ferramentas de marketing IA para visuais focados em conversão. Obtenha um mood board baseado em dados gratuito hoje!