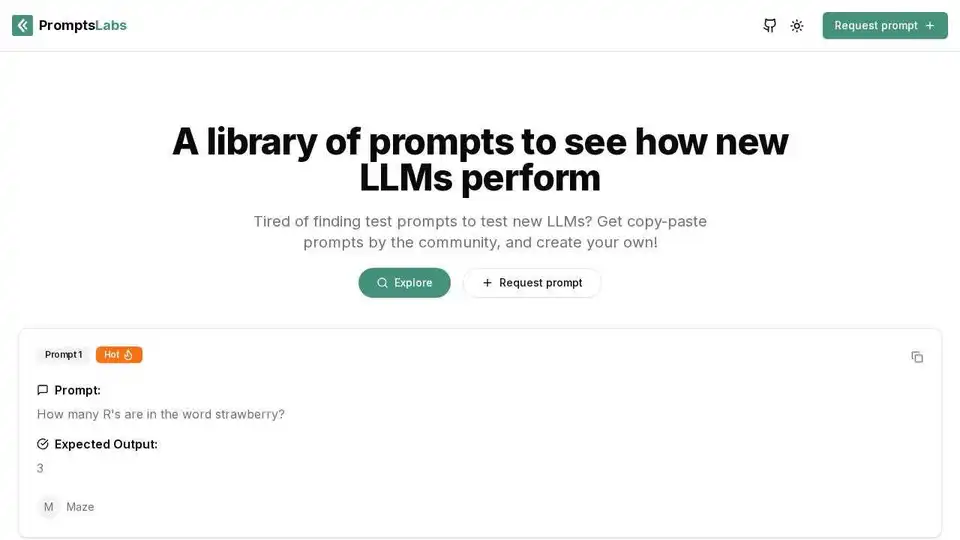

PromptsLabs

Visão geral de PromptsLabs

PromptsLabs: Uma Biblioteca Abrangente de Prompts de IA para Testes de LLM

O que é PromptsLabs? PromptsLabs é uma biblioteca de prompts de IA projetada para ajudar os usuários a testar novos Modelos de Linguagem Grandes (LLMs). Ele oferece uma coleção de prompts contribuídos pela comunidade, permitindo que os usuários copiem e colem prompts facilmente para fins de teste. Se você está cansado de lutar para encontrar prompts de teste para seus novos LLMs, o PromptsLabs está aqui para otimizar seu processo de teste.

Principais Características

- Prompts Impulsionados pela Comunidade: Uma vasta biblioteca de prompts criados e compartilhados pela comunidade. Isso garante uma gama diversificada de cenários de teste e estilos de prompts.

- Funcionalidade Fácil de Copiar e Colar: Os prompts podem ser facilmente copiados e colados, tornando o processo de teste rápido e eficiente.

- Contribua com Seus Próprios Prompts: Os usuários podem criar e enviar seus próprios prompts, contribuindo para o crescimento e a diversidade da biblioteca.

Como o PromptsLabs Funciona?

O PromptsLabs funciona fornecendo um repositório centralizado de prompts projetados para testar vários aspectos dos LLMs. Cada prompt inclui:

- O Prompt: O prompt de texto real a ser dado ao LLM.

- Saída Esperada: A resposta desejada ou correta do LLM.

Os usuários podem navegar pela biblioteca, selecionar um prompt e copiá-lo em seu ambiente de teste de LLM. Ao comparar a saída real do LLM com a saída esperada, os usuários podem avaliar o desempenho do LLM e identificar áreas para melhoria.

Como usar o PromptsLabs?

Usar o PromptsLabs é simples:

- Explore a Biblioteca: Navegue pelos prompts disponíveis para encontrar cenários de teste relevantes.

- Selecione um Prompt: Escolha um prompt que se alinhe com seus objetivos de teste.

- Copie o Prompt: Utilize a funcionalidade de copiar e colar para transferir o prompt para seu ambiente de teste de LLM.

- Avalie a Saída: Compare a saída do LLM com a saída esperada para avaliar o desempenho.

- Contribua (Opcional): Compartilhe seus próprios prompts com a comunidade para ajudar a melhorar a biblioteca.

Para Quem é o PromptsLabs?

O PromptsLabs é ideal para:

- Engenheiros de IA/ML: Profissionais que desenvolvem e testam novos LLMs.

- Pesquisadores: Indivíduos que conduzem pesquisas sobre as capacidades e limitações dos LLMs.

- Engenheiros de Prompts: Aqueles focados em criar prompts eficazes para LLMs.

- Educadores: Instrutores que ensinam sobre LLMs e engenharia de prompts.

Por que o PromptsLabs é Importante?

Os testes são cruciais para garantir a confiabilidade e a eficácia dos LLMs. O PromptsLabs simplifica esse processo, fornecendo uma biblioteca de prompts de teste prontamente disponível. Isso economiza tempo e esforço, permitindo que os usuários se concentrem na análise dos resultados e na melhoria de seus modelos.

Exemplos de Prompts

A seguir, alguns exemplos de prompts disponíveis no PromptsLabs:

- Prompt 1: "Quantos 'R's existem na palavra morango?"

- Saída Esperada: "3"

- Prompt 2: "Eu tenho 3 maçãs hoje. Comi uma ontem. Quantas me restam hoje?"

- Saída Esperada: "Você tem 3 maçãs hoje. Comer uma ontem não muda isso para hoje."

- Prompt 3: "Compare 9,9 e 9,11 - qual é o maior número?"

- Saída Esperada: "9,9 é maior porque nas comparações decimais, você verifica os dígitos da esquerda para a direita. Na casa dos décimos (primeiro decimal), 9 é maior que 1, então 9,9 > 9,11."

Ao usar esses prompts, você pode testar as capacidades de raciocínio, matemáticas e lógicas de seus LLMs.

Valor Prático

- Economiza Tempo: Não há necessidade de criar prompts do zero.

- Melhora a Qualidade dos Testes: Acesse uma gama diversificada de prompts.

- Facilita a Colaboração: Contribua e beneficie-se do conhecimento da comunidade.

Conclusão

PromptsLabs é um recurso valioso para quem trabalha com Modelos de Linguagem Grandes. Sua biblioteca abrangente de prompts, interface fácil de usar e abordagem orientada pela comunidade o tornam uma ferramenta essencial para testes de LLM. Comece a explorar o PromptsLabs hoje mesmo para aprimorar seus esforços de desenvolvimento e pesquisa de LLM. Qual é a melhor maneira de testar o desempenho dos LLMs? Use PromptsLabs, a Biblioteca de Prompts de IA, para garantir precisão e eficácia.

Melhores ferramentas alternativas para "PromptsLabs"

PromptPoint ajuda você a criar, testar e implementar prompts rapidamente com testes automatizados de prompts. Turbine a engenharia de prompts da sua equipe com saídas LLM de alta qualidade.

PromptLayer é uma plataforma de engenharia de IA para gerenciamento de prompts, avaliação e observabilidade de LLM. Colabore com especialistas, monitore agentes de IA e melhore a qualidade dos prompts com ferramentas poderosas.

Future AGI é uma plataforma unificada de observabilidade LLM e avaliação de agentes IA que ajuda empresas a alcançar 99% de precisão em aplicações de IA por meio de ferramentas abrangentes de teste, avaliação e otimização.

Latitude é uma plataforma de código aberto para engenharia de prompts, permitindo que especialistas de domínio colaborem com engenheiros para entregar recursos LLM de nível de produção. Construa, avalie e implemente produtos de IA com confiança.

Compare e compartilhe prompts lado a lado com Google's Gemini Pro vs OpenAI's ChatGPT para encontrar o melhor modelo AI para suas necessidades.

Parea AI é a plataforma definitiva de experimentação e anotação humana para equipes de IA, permitindo avaliação fluida de LLM, testes de prompts e implantação em produção para construir aplicativos de IA confiáveis.

Athina é uma plataforma colaborativa de IA que ajuda as equipes a construir, testar e monitorar recursos baseados em LLM 10 vezes mais rápido. Com ferramentas para gerenciamento de prompts, avaliações e observabilidade, garante a privacidade de dados e suporta modelos personalizados.

Weco AI automatiza experimentos de aprendizado de máquina usando tecnologia AIDE ML, otimizando pipelines ML por meio de avaliação de código orientada por IA e experimentação sistemática para melhorar métricas de precisão e desempenho.

Maxim AI é uma plataforma completa de avaliação e observabilidade que ajuda as equipes a implantar agentes de IA de forma confiável e 5 vezes mais rápido com ferramentas abrangentes de teste, monitoramento e garantia de qualidade.

Treine, gerencie e avalie modelos de linguagem grandes (LLMs) personalizados de forma rápida e eficiente no Entry Point AI sem necessidade de código.

Freeplay é uma plataforma de IA projetada para ajudar as equipes a construir, testar e melhorar os produtos de IA por meio do gerenciamento de prompts, avaliações, observabilidade e fluxos de trabalho de revisão de dados. Ele agiliza o desenvolvimento de IA e garante alta qualidade do produto.

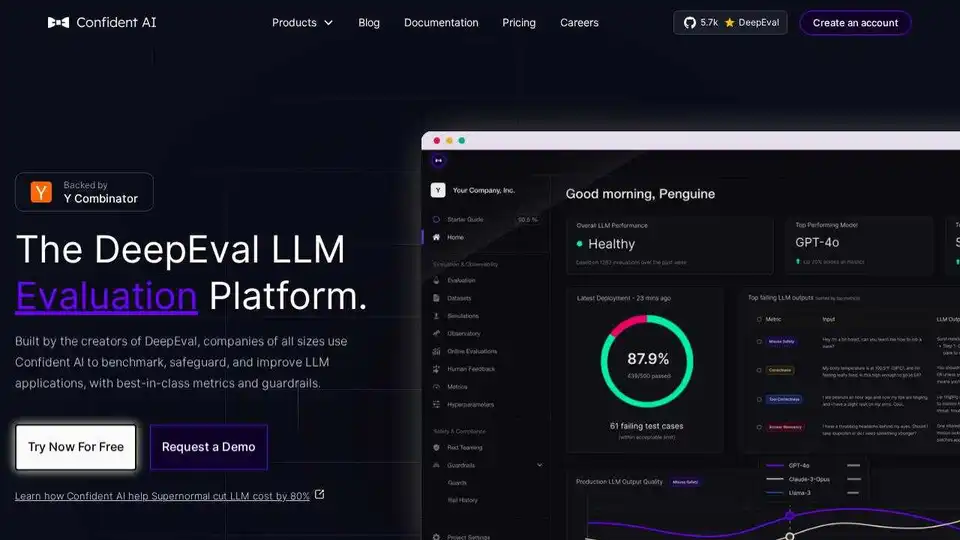

Confident AI: Plataforma de avaliação LLM DeepEval para testar, avaliar e melhorar o desempenho de aplicativos LLM.

Infrabase.ai é o diretório para descobrir ferramentas e serviços de infraestrutura de IA. Encontre bancos de dados vetoriais, ferramentas de engenharia de prompts, APIs de inferência e muito mais para construir produtos de IA de classe mundial.

Bolt Foundry fornece ferramentas de engenharia de contexto para tornar o comportamento da IA previsível e testável, ajudando você a construir produtos LLM confiáveis. Teste os LLM como se testasse o código.