Wavify

Visão geral de Wavify

O que é Wavify?

Wavify se destaca como uma plataforma de ponta projetada especificamente para IA de voz no dispositivo, empoderando engenheiros de software a integrar recursos avançados de voz diretamente em suas aplicações. Diferente de soluções tradicionais baseadas em nuvem, Wavify foca em inferência na borda, entregando qualidade de nível de nuvem enquanto mantém todo o processamento local no dispositivo. Isso significa tempos de resposta mais rápidos, maior privacidade e nenhuma dependência de conectividade à internet. Em seu núcleo, Wavify fornece ferramentas para speech-to-text (STT), speech-to-intent e detecção de palavra de ativação, tornando-o um recurso essencial para desenvolvedores construindo produtos ativados por voz em diversas indústrias.

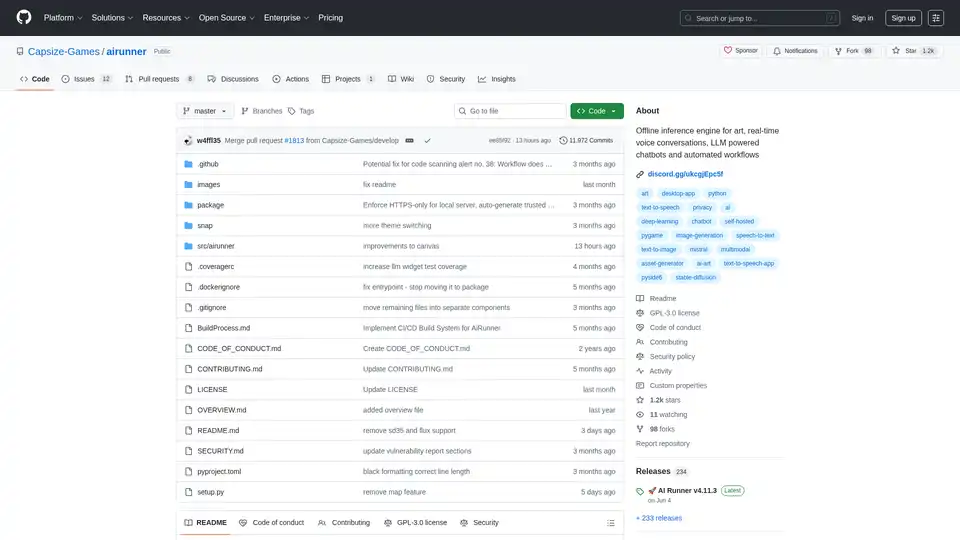

Fundada com a missão de democratizar a IA de voz, Wavify combina modelos de última geração (SOTA) com um motor de inferência robusto multiplataforma. Seja desenvolvendo para eletrônicos de consumo, sistemas automotivos ou apps de saúde, Wavify garante que interações de voz sejam naturais e responsivas. Sua natureza open-source, destacada pela disponibilidade no GitHub, permite personalização fácil e contribuições da comunidade, fomentando inovação no espaço de IA de voz.

Como o Wavify funciona?

Wavify opera através de um motor de inferência simplificado que roda inteiramente no dispositivo, aproveitando modelos otimizados para processar entradas de áudio em tempo real. A plataforma suporta funcionalidades chave como transcrever palavras faladas em texto, detectar palavras de ativação específicas para ativar recursos e interpretar comandos de voz em intenções acionáveis.

O fluxo de trabalho é direto: desenvolvedores baixam modelos pré-treinados via plataforma, integram o SDK em seu codebase e implantam a solução. Por exemplo, usando o SDK Python, você pode inicializar um motor STT com uma importação simples e chave API, então processar arquivos de áudio ou streams sem esforço. Aqui vai um exemplo básico da documentação:

import os

from wavify.stt import SttEngine

engine = SttEngine("path/to/your/model", os.getenv("WAVIFY_API_KEY"))

result = engine.stt_from_file("/path/to/your/file")

print(result)

Integrações similares estão disponíveis em Rust e outros linguagens, garantindo compatibilidade com diversas pilhas tech. A eficiência do motor é evidente em benchmarks de performance em dispositivos como o Raspberry Pi 5, onde Wavify supera alternativas como Whisper.cpp tanto em tamanho (45MB vs. 75MB) quanto em velocidade (2.21s vs. 4.91s para um arquivo de áudio de amostra), alcançando um fator de tempo real de 0.20.

A privacidade é um pilar do design de Wavify. Todos os dados de voz ficam no dispositivo, eliminando a necessidade de acordos de processamento de dados e garantindo conformidade com GDPR. Essa abordagem no dispositivo não só protege as informações do usuário, mas também reduz a latência, tornando ideal para aplicações em tempo real.

Recursos chave do Wavify

Wavify oferece um conjunto de recursos que o tornam a escolha preferida para desenvolvimento de IA de voz:

Desempenho ultrarrápido: Otimizado para dispositivos de borda, Wavify entrega tempos de inferência inferiores a um segundo, garantindo experiências de usuário suaves mesmo em hardware com recursos limitados como Raspberry Pi ou sistemas embarcados.

Qualidade SOTA no dispositivo: Acesse precisão de grau nuvem para STT, detecção de palavra de ativação e reconhecimento de intenção sem enviar dados. Modelos são ajustados finamente para precisão em tarefas diversas.

Privacidade por design: Sem transmissão para nuvem significa proteção inerente de dados, perfeito para setores sensíveis como saúde e legal.

Integração fluida: SDKs em Python, Rust e mais oferecem APIs amigáveis para desenvolvedores. Configuração rápida em poucas linhas de código, com demos para acelerar o prototipado.

Compatibilidade multiplataforma: Roda em Linux, macOS, Windows, iOS, Android, navegadores web, Raspberry Pi e vários sistemas embarcados, ampliando opções de implantação.

Suporte multilíngue: Lida com mais de 20 idiomas, atendendo audiências globais e bases de usuários diversas.

Esses recursos coletivamente reduzem tempo e custos de desenvolvimento, permitindo que equipes foquem em construir aplicações inovadoras em vez de lidar com complexidades de tech de voz.

Casos de uso para Wavify

A versatilidade do Wavify brilha em numerosas indústrias, onde a voz humana serve como uma interface de usuário intuitiva. Aqui vão algumas aplicações convincentes:

Saúde

Em ambientes de saúde, Wavify agiliza fluxos de trabalho automatizando documentação de cuidados e transcrição de diagnósticos. Ele habilita sessões de terapia impulsionadas por IA para saúde mental, permitindo que pacientes interajam via voz para suporte personalizado—tudo enquanto mantém padrões rigorosos de privacidade.

Automotivo

Para o setor automotivo, Wavify impulsiona controles mãos-livres, como navegação ou sistemas de entretenimento ativados por voz. Motoristas podem emitir comandos com segurança sem desviar a atenção da estrada, melhorando conveniência e segurança.

Legal

Profissionais legais se beneficiam de transcrição automatizada de procedimentos judiciais, reuniões e documentação de casos. O STT preciso do Wavify garante registros confiáveis, economizando horas de trabalho manual e minimizando erros.

Eletrônicos de consumo

De dispositivos smart home a jogos móveis, Wavify habilita automação controlada por voz, companheiros de IA e experiências de interação imersivas. Imagine um app ativado por voz que responde instantaneamente a consultas de usuários em um cenário de jogo.

Suporte ao cliente

Em atendimento ao cliente, Wavify transcreve chamadas para registro preciso e converte problemas falados em texto estruturado para resolução mais rápida. Isso impulsiona eficiência e satisfação do cliente.

Educação

Educadores e alunos podem aproveitar Wavify para ferramentas interativas, como quizzes baseados em voz ou feedback em tempo real em apps de aprendizado de idiomas, tornando a educação mais envolvente e acessível.

Esses casos de uso demonstram a adaptabilidade do Wavify, provando seu valor em transformar voz em um elemento de UI poderoso e focado em privacidade.

Para quem é o Wavify?

Wavify é feito para engenheiros de software, desenvolvedores de produtos e empresas se aventurando em IA de voz. É particularmente adequado para aqueles priorizando processamento no dispositivo—pense em startups construindo dispositivos IoT, empresas em indústrias reguladas como finanças ou saúde, e hobbyistas experimentando com sistemas embarcados. Se você está cansado de dependências em nuvem e busca uma alternativa escalável e privada, Wavify se encaixa perfeitamente.

Usuários não técnicos podem não interagir diretamente com os SDKs, mas gerentes de produto e designers de UX apreciarão como ele melhora as experiências dos usuários finais. Apoiada por investidores e uma comunidade em crescimento, Wavify atrai qualquer um visando inovar com tecnologia de voz sem comprometer performance ou segurança.

Por que escolher Wavify?

Em um mercado lotado de IA de voz, Wavify se diferencia por sua filosofia de foco na borda. Concorrentes frequentemente dependem de infraestrutura em nuvem, introduzindo latência e riscos de privacidade, mas Wavify mantém tudo local para velocidade superior e conformidade. Seu ethos open-source convida colaboração, enquanto as capacidades multilíngues garantem alcance global.

Desenvolvedores elogiam a excelente experiência de desenvolvedor (DX), com integração fácil e docs abrangentes. Para negócios, as economias de custo ao evitar taxas em nuvem e a habilidade de implantar em dispositivos de baixa potência adicionam ROI tangível. Seja otimizando para Raspberry Pi ou escalando para apps empresariais, Wavify entrega resultados confiáveis e de alta qualidade.

Para começar, visite o repositório GitHub para amostras de código ou agende uma demo para orientação personalizada. Com atualizações contínuas, Wavify continua evoluindo, mantendo-se à frente no mundo rápido de IA no dispositivo.

Melhores maneiras de integrar Wavify

- Download e configuração: Pegue o SDK do GitHub e instale dependências.

- Seleção de modelo: Escolha de modelos SOTA otimizados para seu caso de uso.

- Integração de código: Use APIs simples para processar áudio—suporta arquivos, streams e entrada de microfone ao vivo.

- Testes: Benchmark no seu dispositivo alvo para performance em tempo real.

- Implantação: Integre em apps para rollout multiplataforma.

Seguindo esses passos, você pode desbloquear IA de voz em horas, não semanas. Para troubleshooting, as docs cobrem cenários comuns, e a equipe está disponível para consultas expertas.

Melhores ferramentas alternativas para "Wavify"

CodeBaby oferece avatares de IA interativos em tempo real para vários setores, melhorando o envolvimento e agilizando os fluxos de trabalho em negócios, educação, saúde e muito mais. Capacitando as pessoas a fazerem mais com a IA.

Floatbot.AI é uma plataforma GenAI sem código para criar e implementar agentes de IA de voz e chat para automação de contact center empresarial e assistência de agentes em tempo real, integrando-se com qualquer fonte de dados ou serviço.

Melhore a comunicação com a implementação do modelo de voz da Neurond AI, utilizando modelos de texto para voz e voz para texto de alta qualidade para uma interação homem-computador precisa e natural.

AI Runner é um mecanismo de inferência de IA offline para arte, conversas de voz em tempo real, chatbots alimentados por LLM e fluxos de trabalho automatizados. Execute geração de imagens, chat de voz e muito mais localmente!

FreeTTS oferece ferramentas online gratuitas alimentadas por IA para texto para voz, voz para texto, conversão de áudio, remoção de vocais e aprimoramento de voz. Converta e aprimore arquivos de áudio diretamente no seu navegador.

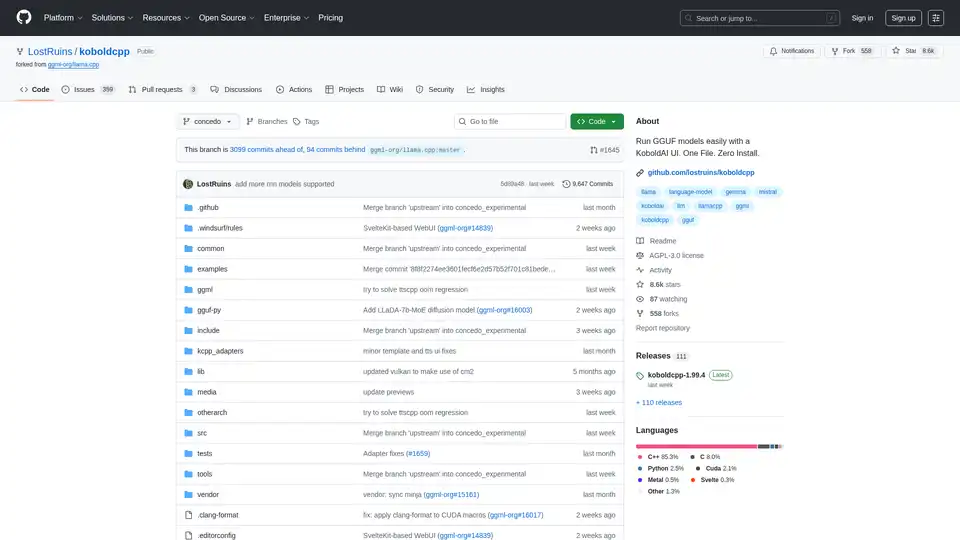

KoboldCpp: Execute modelos GGUF facilmente para geração de texto e imagem com IA usando uma interface KoboldAI. Arquivo único, instalação zero. Suporta CPU/GPU, STT, TTS e Stable Diffusion.

Klyra AI é a plataforma tudo-em-um definitiva para criar vídeos, narrações, imagens, blogs, música e mais usando ferramentas de IA avançadas. Aumente a produtividade com automação de conteúdo perfeita.

Descubra Voice to Text, uma ferramenta gratuita de reconhecimento de voz IA online que converte sua voz em texto editável em tempo real. Suporta mais de 30 idiomas para e-mails, documentos e mais.

Speech Intellect é uma solução STT/TTS alimentada por IA que usa a 'Teoria do Sentido' para processamento de fala em tempo real com compreensão emocional e semântica. Revolucione suas soluções de voz agora!

AudioPod AI é uma estação de trabalho de áudio AI e um pacote de produção tudo-em-um. Gere narrações, divida stems, crie música, dobre conteúdo automaticamente e muito mais. Inclui texto para voz, voz para texto e geração de música AI.

O assistente de reunião Krisp AI combina cancelamento de ruído, transcrição, notas de reunião, resumos e conversão de sotaque. Melhore a produtividade das reuniões com IA.

A plataforma Voice AI da Deepgram oferece APIs STT, TTS e Voice Agent para soluções de voz empresariais. Em tempo real, preciso e construído para escalar. Ganhe $200 em créditos grátis!

Wavve AI grava, transcreve, resume e gera conteúdo a partir de áudio sem esforço. Converta notas de voz em texto para notas de reuniões, e-mails, artigos e muito mais. Comece grátis!

A API de reconhecimento de voz SpeechFlow converte som em texto com alta precisão em 14 idiomas. Transcreva arquivos de áudio ou links do YouTube de forma fácil e eficiente.