SiliconFlow 概述

什么是 SiliconFlow?

SiliconFlow 是一款专为大型语言模型 (LLM) 和多模态模型设计的尖端 AI 基础设施平台。它赋能开发者和企业部署、微调和运行超过 200 个优化模型,具有闪电般的推理能力。无论您从事文本生成、图像处理还是视频分析,SiliconFlow 提供统一的解决方案,消除无服务器、预留或私有云设置中的碎片化。该平台在 AI 推理领域脱颖而出,通过简单且兼容 OpenAI 的 API 实现无缝集成,非常适合扩展 AI 应用,而无需应对常见的基建难题。

在 AI 模型日益复杂的时代,SiliconFlow 针对延迟、吞吐量和成本可预测性等关键痛点提供解决方案。从小型开发团队到大型企业,它支持广泛的应用场景,确保开源和商业 LLM 的高性能。通过专注于速度和效率,SiliconFlow 帮助用户加速 AI 开发,将创新想法更快转化为可部署的解决方案。

SiliconFlow 的核心功能

SiliconFlow 集成了为 AI 从业者量身定制的强大功能集。以下是使其成为首选平台的原因:

优化模型库:访问 200 多个模型,包括热门 LLM 如 DeepSeek-V3.1、GLM-4.5、Qwen3 系列,以及多模态选项如 Qwen-Image 和 FLUX.1。这些模型预先优化以实现更快推理,支持从自然语言处理到视觉理解的任务。

高速推理:实现闪电般的性能,降低延迟并提高吞吐量。平台的架构专为高效处理语言和多模态工作负载而设计,适用于实时应用。

灵活部署选项:选择无服务器推理以实现即时可扩展性、预留 GPU 以获得可预测性能,或自定义私有云设置。无需管理基础设施——SiliconFlow 承担重任。

微调能力:使用内置监控和弹性计算资源,将基础模型适应您的特定数据。此功能对于无需深入模型训练专长的 AI 行为定制至关重要。

隐私与控制:您的数据归您所有,平台不存储。享受对模型部署、扩展和微调的完全控制,避免供应商锁定。

集成简易性:单一 API 端点完全兼容 OpenAI 标准,简化开发。开发者可以轻松切换或集成模型,减少入职时间。

这些功能确保 SiliconFlow 不仅仅是另一个托管服务——它是一个全面的 AI 推理生态系统,优先考虑开发者的需求,如可靠性和成本效率。

SiliconFlow 如何工作?

起步使用 SiliconFlow 非常简单,符合现代 DevOps 实践。该平台基于统一的推理引擎,抽象化模型服务的复杂性。

首先,注册免费账户并探索模型目录。从用于文本任务的 LLM 或用于图像和视频生成的 multimodal 模型中选择。例如,要运行像 DeepSeek-V3 这样的 LLM,只需通过 API 调用您的提示——无服务器模式下无需设置。

以下是逐步分解:

模型选择:浏览广泛的库,其中包括如 Kimi-K2-Instruct 和 Qwen3-Coder 等高级模型,用于专业编码任务。

部署:选择无服务器以按使用付费,适合原型设计,或预留 GPU 以确保生产工作负载的稳定延迟。

推理执行:通过兼容 OpenAI 的 API 发送请求。平台优化路由,以最小延迟交付结果。

微调过程:上传您的数据集,通过仪表板配置参数,让 SiliconFlow 的弹性计算处理训练。使用集成工具监控进度,实现快速迭代。

扩展与监控:随着需求增长,无缝扩展而无中断。系统提供吞吐量和成本指标,支持明智决策。

此工作流程最小化摩擦,让您专注于创新而非运维。对于多模态任务,如使用 Qwen-Image-Edit 生成图像,该过程类似于 LLM 推理,但扩展到视觉输入,利用平台的超高速能力处理超出文本的模态。

主要用例与实际价值

SiliconFlow 在需要快速、可靠 AI 推理的多样场景中大放异彩。构建聊天机器人、内容生成器或推荐系统的开发者可以利用其 LLM 提供准确、低延迟响应。媒体或电商企业受益于多模态功能,如使用 Wan2.2 模型的视频到图像转换,提升用户体验而无需巨额计算投资。

关键用例:

- AI 驱动应用:将 LLM 集成到应用中,实现实时自然语言理解,如虚拟助手或自动化客服支持。

- 创意工作流程:使用多模态模型进行图像生成、编辑和视频合成,加速艺术家和营销人员的创意过程。

- 研发:在专有数据上微调模型,用于领域特定 AI,如金融分析或医学成像。

- 高容量推理:预留选项适合定时作业,如批量处理大型数据集以支持机器学习管道。

其实际价值在于成本效益——无服务器模式仅按使用付费——以及性能提升,通常优于传统设置。用户报告推理时间减少高达 50%,使其成为预算意识强的团队在 AI 驱动市场保持竞争力的明智选择。

SiliconFlow 适合谁?

该平台面向广泛受众:

- 开发者和初创公司:需要快速原型设计而无需基础设施成本。

- AI 研究人员:微调专家需要弹性资源进行实验。

- 企业:处理大规模推理的大型团队,并提供隐私保障。

- 多模态创新者:计算机视觉或生成 AI 领域的创作者,推动图像和视频技术的边界。

如果您厌倦了碎片化工具,并寻求可靠、可扩展的 AI 后端,SiliconFlow 是您的盟友。它特别适合从本地设置过渡到云推理的团队,提供平滑的学习曲线。

为什么选择 SiliconFlow 而非竞争对手?

在拥挤的 AI 基础设施领域,SiliconFlow 通过其开发者导向设计脱颖而出。与僵化的云提供商不同,它提供无锁定的灵活性,结合多模态任务的卓越速度。定价透明且基于使用,避免意外账单,而 OpenAI 兼容性简化了从现有工作流程的迁移。

用户反馈强调其可靠性:一位开发者指出,“API 的简易性为我们节省了数周的集成时间。”为确保可靠性,平台提供 99.9% 正常运行时间,并内置冗余。诸如无数据存储的安全功能符合 GDPR 和企业标准,建立信任。

常见问题

我可以在 SiliconFlow 上部署哪些类型的模型?

SiliconFlow 支持大量 LLM(例如 DeepSeek、Qwen3)和多模态模型(例如 FLUX.1 用于图像、Wan2.2 用于视频),涵盖文本、图像和视频领域。

定价如何运作?

它灵活:无服务器按令牌/使用付费,预留 GPU 提供固定费率以确保可预测成本。

我可以微调模型吗?

是的,通过简单的数据上传和监控——无需基础设施管理。

有哪些支持可用?

全面文档、API 参考以及企业销售联系,加上社区资源。

它兼容 OpenAI 吗?

完全兼容——使用相同的 SDK 和端点实现无缝集成。

准备好为您的 AI 项目注入活力?立即从 SiliconFlow 的免费层开始,体验速度和简易性的差异。

"SiliconFlow"的最佳替代工具

Nexa SDK 实现了 LLM、多模态、ASR 和 TTS 模型的快速、私密的设备上 AI 推理。通过 NPU、GPU 和 CPU 在移动设备、PC、汽车和 IoT 设备上实现生产就绪的性能。

创建 AI 驱动的应用和 AI 代理,它们可以自动规划和执行您的任务。使用 Momen 的灵活 GenAI 应用开发框架构建您的全栈 AI 应用并从中获利。今天就开始吧!

探索 AI Library,这是超过 2150 个神经网络和 AI 工具的综合目录,用于生成式内容创作。发现顶级 AI 艺术模型、文本到图像、视频生成工具等,提升您的创意项目。

OpenUI 是一个开源工具,让您用自然语言描述 UI 组件,并使用大语言模型实时渲染。将描述转换为 HTML、React 或 Svelte,实现快速原型设计。

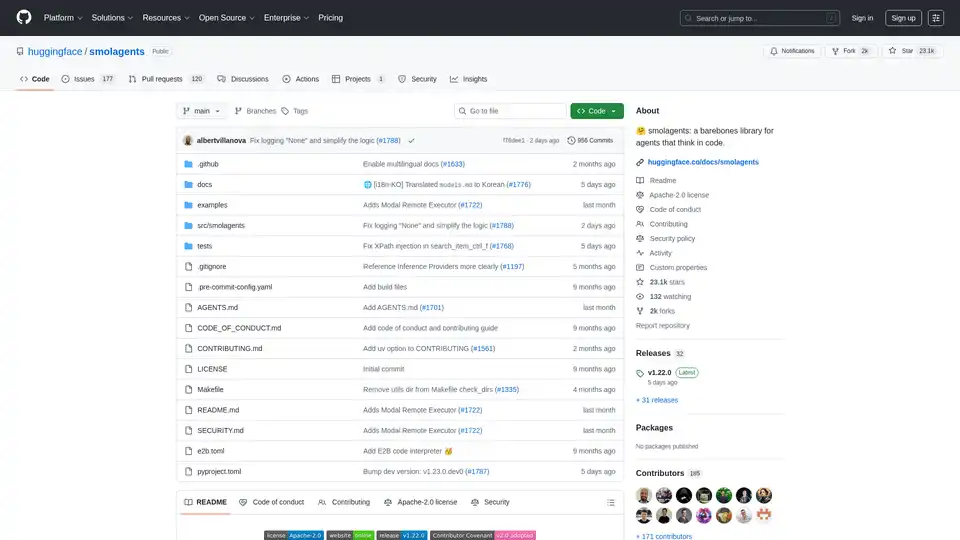

smolagents 是一个简约的 Python 库,用于创建通过代码推理和行动的 AI 代理。它支持模型无关的 LLM、安全沙箱以及与 Hugging Face Hub 的无缝集成,实现高效的基于代码的代理工作流。

Agent TARS 是一个开源多模态 AI 代理,无缝集成浏览器操作、命令行和文件系统,实现增强的工作流自动化。体验先进的视觉解释和复杂的推理,以高效处理任务。

Falcon LLM 是 TII 的开源生成式大语言模型家族,包括 Falcon 3、Falcon-H1 和 Falcon Arabic 等,支持多语言、多模态 AI 应用,可在日常设备上高效运行。

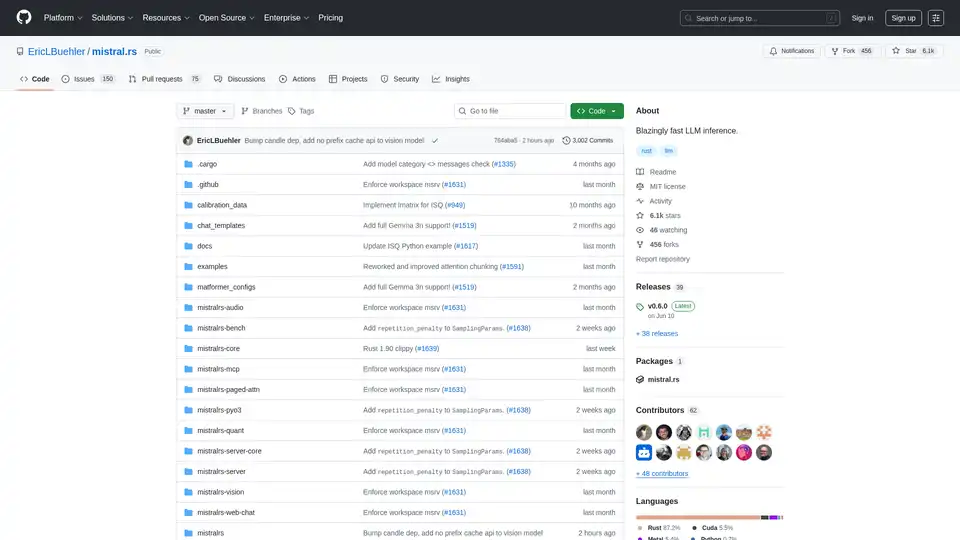

mistral.rs 是一个用 Rust 编写的极速 LLM 推理引擎,支持多模态工作流程和量化。提供 Rust、Python 和 OpenAI 兼容的 HTTP 服务器 API。

使用 Google 的 Gemini Pro 与 OpenAI 的 ChatGPT 并排比较和分享提示,以找到最适合您需求的 AI 模型。

Oda Studio为复杂数据分析提供AI驱动的解决方案,将非结构化数据转化为建筑、金融和媒体行业的可行见解。视觉语言AI和知识图谱专家。

LM-Kit提供企业级工具包,用于本地AI代理集成,结合速度、隐私和可靠性,为下一代应用提供动力。利用本地LLM获得更快、更经济、更安全的AI解决方案。