LM-Kit 概述

LM-Kit: 使用本地 AI 代理驱动更智能的应用

什么是 LM-Kit? LM-Kit 是一款企业级工具包,旨在将 AI 代理直接集成到您的基础设施中。它利用本地大型语言模型 (LLM) 提供速度、隐私和控制,使其成为驱动下一代应用的理想选择。LM-Kit 提供针对复杂自然语言处理 (NLP) 优化的、特定于任务的多模态 LLM。

主要特性和优势:

- 本地优先的 LLM 工具包: 完全在您的基础设施上运行,确保数据隐私并消除云依赖。

- 特定于任务的模型: 协调用于文档理解、数据提取、NER、PII 识别、翻译等的专用代理。

- 成本效益: 通过轻量级、专业化的模型降低基础设施和云支出。

- 数据主权: 将敏感信息完全置于您的控制之下。

- 优化执行: 通过专门用于特定任务的代理提供更快的性能。

- 资源效率: 以最少的硬件使用量实现高精度。

- 无缝集成: 提供原生 SDK,可轻松与现有应用程序集成,从而提高性能并减少延迟。

LM-Kit 如何工作?

LM-Kit 通过引入专用的、特定于任务的代理,消除了对超大、缓慢且昂贵的云模型的需求。这些代理旨在以更高的速度和准确性出色地完成特定任务,并且可以编排成超出孤立自动化的完整工作流程。

核心功能:

LM-Kit 提供了一套全面的功能,可以增强跨不同领域的 AI 应用。主要功能包括:

- 问答: 用于回答查询的单轮和多轮交互。

- 文本生成: 自动创建相关文本。

- 约束生成: 使用 JSON 模式、语法规则或模板在约束内生成文本。

- 文本校正和重写: 校正拼写/语法并以特定风格重写文本。

- 文本翻译: 在语言之间转换文本。

- 语言检测: 从文本、图像或音频输入中识别语言。

- 文本摘要: 从冗长的文本中生成简洁的摘要。

- 结构化数据提取: 从各种来源提取和构建数据。

- 情感和情绪分析: 检测文本中的情绪基调和特定情绪。

- 关键词和命名实体识别 (NER): 提取重要的关键词和关键实体。

- PII 提取: 识别和分类个人标识符以符合隐私规定。

- 语音转文本: 将口语转录为文本。

- 图像分析: 使用基于视觉的任务检查和解释图像。

为什么 LM-Kit 很重要?

在当今数据驱动的世界中,企业需要快速、安全且经济高效的 AI 解决方案。LM-Kit 通过为 AI 代理集成提供本地优先的方法来满足这些需求。通过在您自己的基础设施上运行 LLM,您可以确保数据隐私、减少延迟并降低成本。

LM-Kit 适合哪些人?

LM-Kit 非常适合希望将生成式 AI 集成到其应用程序中,同时保持对其数据控制的开发人员、产品负责人和企业。它特别适用于:

- 处理敏感数据并需要强大的隐私保护措施的企业。

- 希望减少对基于云的 AI 服务依赖的组织。

- 寻求将 AI 无缝且高效地集成到其应用程序中的开发人员。

如何使用 LM-Kit?

- 开始构建: 访问 LM-Kit 工具包,并开始使用原生 SDK 将 AI 代理集成到您的应用程序中。

- 探索功能: 利用问答、文本生成、数据提取等功能来增强您的应用程序。

- 优化性能: 利用模型量化和微调,在您的硬件上实现最佳性能。

在任何硬件、任何地点都具有无与伦比的性能

LM-Kit 经过精心设计,无论是在本地还是在云端部署,都能提供最佳性能。它以最少的配置和跨各种硬件设置的顶级性能提供无缝的 Gen-AI 功能。

- 零依赖

- 原生支持 Apple ARM (带 Metal 加速) 和 Intel

- 支持 x86 架构的 AVX 和 AVX2

- 使用 CUDA 和 AMD GPU 进行专门加速

- 混合 CPU+GPU 推理,以提高模型超出总 VRAM 容量的性能

LM-Kit Maestro 在行动

探索更多演示,了解 LM-Kit 如何提升您的 AI 项目。该平台构建在强大的认知框架之上,支持创建智能且适应性强的代理应用程序。无论您是希望改进数据处理、增强用户体验还是自动化复杂任务,LM-Kit 都能提供解决方案。

结论

LM-Kit 是一款功能强大的工具包,使开发人员和企业能够利用生成式 AI 的优势,同时保持对其数据和基础设施的控制。凭借其本地优先的方法、特定于任务的模型和无缝集成功能,LM-Kit 是释放您的应用程序中 AI 潜力的关键。考虑使用 LM-Kit 获得更快、更具成本效益且更安全的 AI 解决方案。

"LM-Kit"的最佳替代工具

StackAI 是一个无需代码的平台,用于构建和部署企业 AI 的 AI 代理。 轻松实现工作流程自动化、分析数据并增强决策能力。 符合 SOC2、HIPAA 和 GDPR 标准。

Dynamiq 是一个本地平台,用于构建、部署和监控 GenAI 应用。通过 LLM 微调、RAG 集成和可观测性等功能,简化 AI 开发,降低成本并提升业务 ROI。

Langtrace是一个开源的可观测性和评估平台,旨在提高AI代理的性能和安全性。跟踪关键指标,评估性能,并确保LLM应用程序的企业级安全性。

ThirdAI 是一个在 CPU 上运行的 GenAI 平台,提供具有增强的安全性、可扩展性和性能的企业级 AI 解决方案。它简化了 AI 应用程序的开发,减少了对专用硬件和技能的需求。

使用BrainSoup转变您的工作流程!通过自然语言创建自定义AI代理来处理任务并自动化流程。用您的数据增强AI,同时优先考虑隐私和安全。

NativeMind是一个开源Chrome扩展,使用Ollama等本地LLM运行,提供完全离线、私密的ChatGPT替代品。功能包括上下文感知聊天、代理模式、PDF分析、写作工具和翻译——全部100%设备本地运行,无云依赖。

PremAI是一个应用AI研究实验室,提供安全、个性化的AI模型,使用TrustML™的加密推理,以及像LocalAI这样可在本地运行LLM的开源工具。

AnythingLLM 是一款一体化人工智能应用程序,允许您与文档聊天、提高生产力,并在本地和私密地运行最先进的 LLM。利用人工智能代理和自定义模型,无需任何设置。

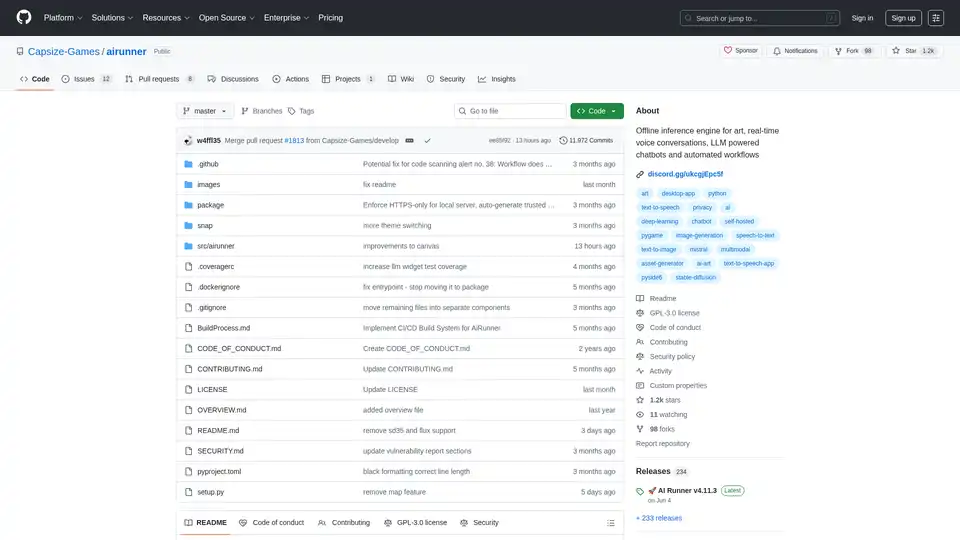

AI Runner是一个离线AI推理引擎,用于艺术创作、实时语音对话、LLM驱动的聊天机器人和自动化工作流程。在本地运行图像生成、语音聊天等!

Bottr 为企业提供一流的 AI 咨询和可定制聊天机器人。启动智能助手、自动化工作流,并与 GPT 和 Claude 等主要 LLM 集成,实现安全、可扩展的 AI 解决方案。

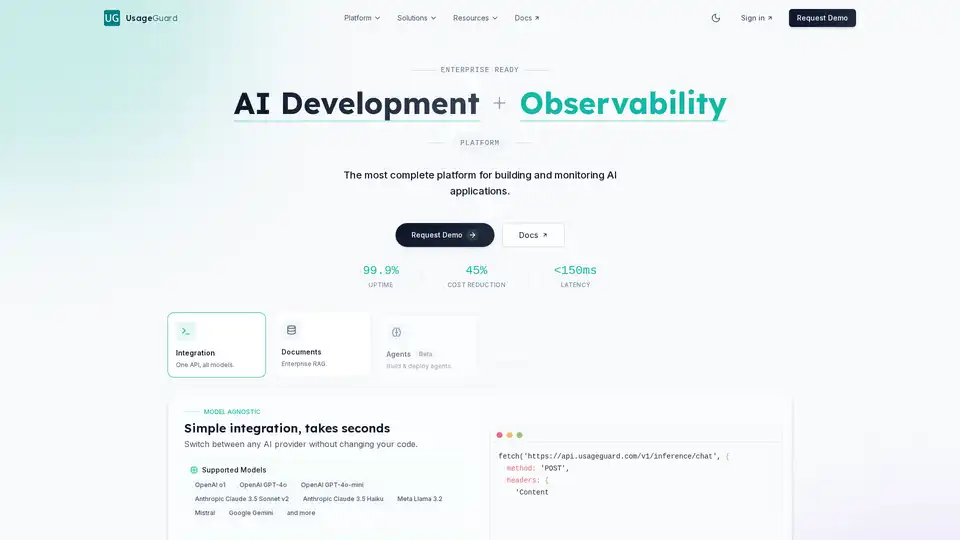

UsageGuard 提供统一AI平台,安全访问OpenAI、Anthropic等LLM,内置防护措施、成本优化、实时监控和企业级安全,简化AI开发。