Backmesh

Übersicht von Backmesh

Backmesh: Sichern Sie Ihre LLM API-Schlüssel und kontrollieren Sie den Zugriff

Was ist Backmesh? Backmesh ist ein Open-Source-, gründlich getestetes Backend, das entwickelt wurde, um Ihre Large Language Model (LLM) API-Schlüssel zu schützen. Es fungiert als API Gatekeeper und ermöglicht Ihrer Anwendung die sichere Interaktion mit LLMs. Dies verhindert kostspielige Lecks und unbefugten Zugriff und schützt Ihre Ressourcen.

Wie funktioniert Backmesh?

Backmesh bietet verschiedene Schlüsselfunktionen, um die Sicherheit und Kontrolle Ihrer LLM API-Nutzung zu verbessern:

- JWT-Authentifizierung: Backmesh verifiziert Anfragen mithilfe von JSON Web Tokens (JWTs) von Ihrem Anwendungs-Authentifizierungsanbieter. Dies stellt sicher, dass nur autorisierte Benutzer über Backmesh auf die LLM API zugreifen können.

- Ratenbegrenzungen: Konfigurieren Sie Ratenbegrenzungen pro Benutzer, um Missbrauch zu verhindern. Sie können beispielsweise Benutzer auf maximal 5 OpenAI API-Aufrufe pro Stunde beschränken.

- API-Ressourcenzugriffskontrolle: Schützen Sie sensible API-Ressourcen wie Dateien und Threads und stellen Sie sicher, dass nur die Benutzer, die sie erstellt haben, darauf zugreifen können.

Hauptmerkmale und Vorteile

- Erhöhte Sicherheit: Schützt Ihre LLM API-Schlüssel davor, im Frontend-Code Ihrer Anwendung offengelegt zu werden, wodurch Lecks und unbefugte Nutzung verhindert werden.

- Kostenkontrolle: Implementieren Sie Ratenbegrenzungen, um übermäßige API-Nutzung und unerwartete Kosten zu verhindern.

- Zugriffskontrolle: Verwalten Sie den Zugriff auf bestimmte API-Ressourcen und gewährleisten Sie so Datenschutz und Sicherheit.

- LLM-Benutzeranalysen: Instrumentieren Sie alle LLM API-Aufrufe, um Nutzungsmuster zu verfolgen, Kosten zu senken und die Benutzerzufriedenheit innerhalb Ihrer AI-Anwendungen zu verbessern.

Wie verwende ich Backmesh?

Backmesh ist so konzipiert, dass es einfach in Ihre bestehende Anwendungsarchitektur integriert werden kann. Stellen Sie einfach das Backmesh-Backend bereit und konfigurieren Sie Ihre Anwendung so, dass LLM API-Anfragen darüber geleitet werden.

- Beginnen Sie mit dem Open-Source-Backend: Sie können die Open-Source-Natur von Backmesh nutzen, um es bereitzustellen und an Ihre spezifischen Bedürfnisse anzupassen.

- Integration: Leiten Sie die LLM API-Aufrufe Ihrer App über Backmesh.

- Analysen: Gewinnen Sie Einblicke mit Nutzungsverfolgung, um Kosten und Benutzererfahrung zu optimieren.

Für wen ist Backmesh geeignet?

Backmesh ist ideal für Entwickler und Organisationen, die:

- Anwendungen erstellen, die LLMs verwenden.

- Ihre LLM API-Schlüssel schützen müssen.

- Den Zugriff auf LLM APIs steuern möchten.

- Die LLM API-Nutzung verfolgen möchten.

Warum Backmesh wählen?

Die Wahl von Backmesh bedeutet, sich für eine robuste, sichere und kostengünstige Lösung zur Verwaltung Ihrer LLM API-Interaktionen zu entscheiden. Seine Open-Source-Natur fördert gemeinschaftsgetriebene Verbesserungen und Transparenz, während seine integrierten Funktionen eine granulare Kontrolle und aufschlussreiche Analysen bieten. Durch die Implementierung von Backmesh stellen Sie sicher, dass Ihre Anwendung die Leistungsfähigkeit von LLMs sicher und effizient nutzen kann, ohne die Sicherheit oder das Budget zu gefährden.

Sind Sie bereit, die Kontrolle über Ihre LLM API-Sicherheit zu übernehmen? Beginnen Sie mit Backmesh und entwickeln Sie Ihre AI-Anwendungen mit Zuversicht.

Beste Alternativwerkzeuge zu "Backmesh"

Labellerr ist eine Datenkennzeichnungs- und Bildannotationssoftware, die hochwertige, skalierbare Datenkennzeichnung für KI und ML bietet. Es bietet automatisierte Annotationen, erweiterte Analysen und intelligente Qualitätssicherung, um KI-Teams bei der schnelleren und genaueren Datenaufbereitung zu unterstützen.

UsageGuard bietet eine einheitliche KI-Plattform für sicheren Zugriff auf LLMs von OpenAI, Anthropic und mehr, mit integrierten Schutzmaßnahmen, Kostoptimierung, Echtzeit-Überwachung und Enterprise-Sicherheit, um die KI-Entwicklung zu vereinfachen.

Superagent bietet Laufzeitschutz für KI-Agenten mit speziell trainierten Modellen. Es schützt vor Angriffen, verifiziert Ausgaben und redigiert sensible Daten in Echtzeit, um Sicherheit und Compliance zu gewährleisten.

FinetuneDB ist eine AI-Fine-Tuning-Plattform, mit der Sie Datensätze erstellen und verwalten können, um benutzerdefinierte LLMs schnell und kostengünstig zu trainieren und die Modellleistung mit Produktionsdaten und Kollaborationswerkzeugen zu verbessern.

Ollang ist eine KI-gestützte Lokalisierungsplattform, die Unternehmen dabei unterstützt, Text-, Video- und Audioinhalte mühelos in großem Umfang für die globale Expansion zu lokalisieren.

Sichern Sie Ihre KI-Systeme mit dem automatisierten Red Teaming und den Sicherheitstests von Mindgard. Identifizieren und beheben Sie KI-spezifische Risiken und stellen Sie robuste KI-Modelle und Anwendungen sicher.

APIPark ist ein Open-Source-LLM-Gateway und ein API-Entwicklerportal zur Verwaltung von LLMs in der Produktion, das Stabilität und Sicherheit gewährleistet. Optimieren Sie die LLM-Kosten und erstellen Sie Ihr eigenes API-Portal.

PremAI ist ein angewandtes KI-Forschungslabor, das sichere, personalisierte KI-Modelle, verschlüsselte Inferenz mit TrustML™ und Open-Source-Tools wie LocalAI zur lokalen Ausführung von LLMs bereitstellt.

Bottr bietet Spitzenberatung in KI und anpassbare Chatbots für Unternehmen. Starten Sie intelligente Assistenten, automatisieren Sie Workflows und integrieren Sie mit großen LLMs wie GPT und Claude für sichere, skalierbare KI-Lösungen.

MrSeek ist eine Mac-App, mit der Sie Antworten von mehreren KI-Chatbots wie ChatGPT und Gemini an einem Ort vergleichen können. Steigern Sie Ihre Produktivität mit diesem KI-Assistenten.

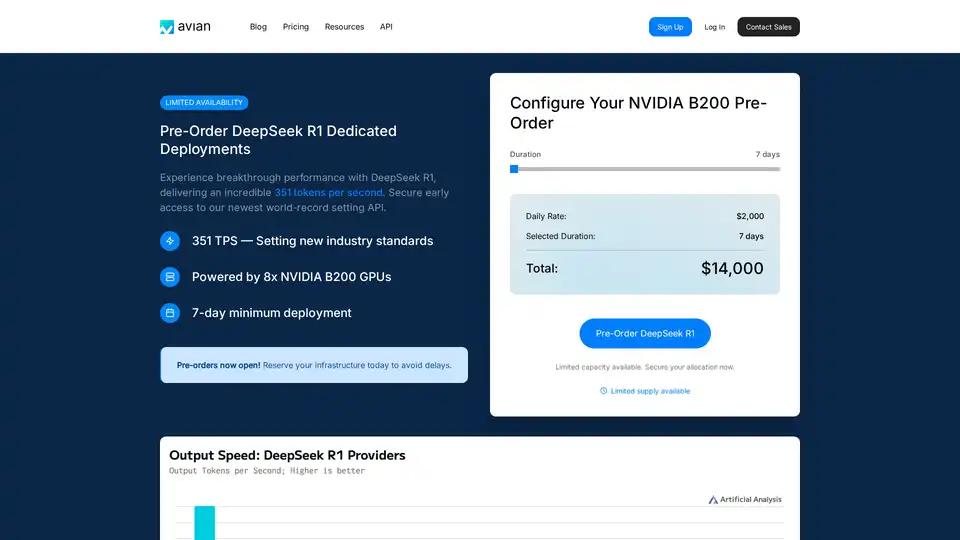

Avian API bietet die schnellste KI-Inferenz für Open-Source-LLMs und erreicht 351 TPS auf DeepSeek R1. Stellen Sie jeden HuggingFace LLM mit einer 3-10-fachen Geschwindigkeit mit einer OpenAI-kompatiblen API bereit. Enterprise-Grade-Performance und Datenschutz.

UpTrain ist eine Full-Stack-LLMOps-Plattform, die Tools der Enterprise-Klasse zur Bewertung, zum Experimentieren, Überwachen und Testen von LLM-Anwendungen bereitstellt. Hosten Sie in Ihrer eigenen sicheren Cloud-Umgebung und skalieren Sie KI zuverlässig.

Sensible ist eine API-First-Dokumentenverarbeitungsplattform, die für Entwickler entwickelt wurde, um die Datenextraktion zu optimieren. Es bietet Tools für mühelose Automatisierung, nahtlose Integration und unerschütterliche Sicherheit, geeignet für Unternehmen jeder Größe.

Langtrace ist eine Open-Source-Observability- und Evaluationsplattform, die entwickelt wurde, um die Leistung und Sicherheit von KI-Agenten zu verbessern. Verfolgen Sie wichtige Metriken, bewerten Sie die Leistung und gewährleisten Sie Sicherheit auf Unternehmensniveau für Ihre LLM-Anwendungen.