BAML

Übersicht von BAML

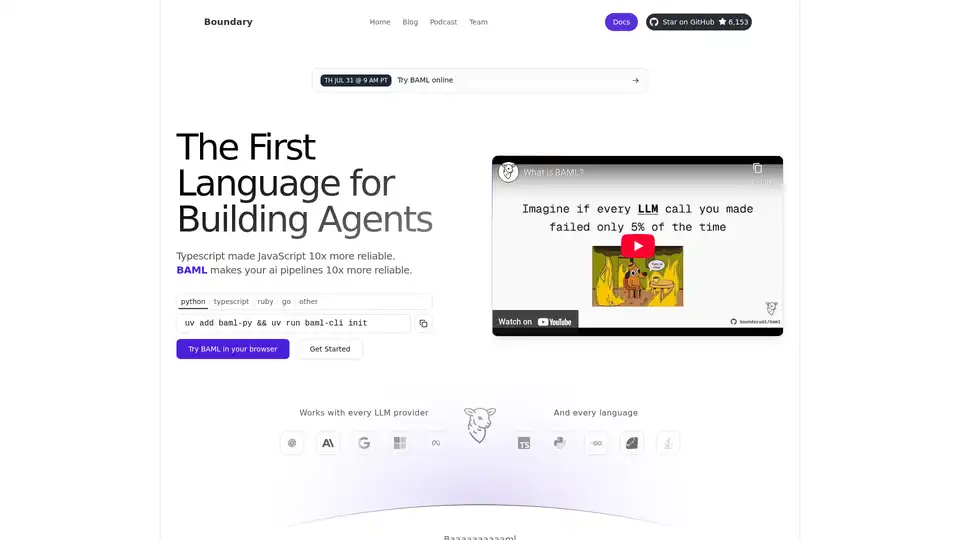

BAML: Die erste Sprache zum Erstellen von KI-Agenten

Was ist BAML? BAML, oder Basically A Made-Up Language (im Grunde eine erfundene Sprache), ist ein Open-Source-Toolkit, das Entwicklern helfen soll, typsichere und zuverlässige KI-Anwendungen zu erstellen. Ähnlich wie TypeScript JavaScript verbessert, zielt BAML darauf ab, die Zuverlässigkeit von KI-Pipelines zu verbessern, indem es einen strukturierten Ansatz für die KI-Entwicklung bietet.

Wie funktioniert BAML?

BAML hilft Entwicklern, KI-Agenten mit Zuversicht zu definieren, zu testen und bereitzustellen. Es funktioniert mit jedem LLM-Anbieter und unterstützt mehrere Sprachen, darunter Python, TypeScript, Ruby und Go. BAML transformiert die KI-Entwicklung durch einen einfachen vierstufigen Prozess:

- Prompts-Funktionen definieren: Erstellen Sie Prompts mit BAML in Ihrer IDE. BAML ist mit Tools wie Cursor und Claude kompatibel und bietet eine VSCode-Erweiterung.

- Prompts-Funktionen testen: Testen Sie Ihre Prompt-Funktionen in VSCode oder Ihrem bevorzugten Editor. Sie können auch

baml-cli testin CI/CD-Pipelines verwenden. - Prompts-Funktionen aufrufen: Generieren Sie native Funktionen aus BAML-Funktionen in Sprachen wie Python, TypeScript, Ruby und Go.

- Stellen Sie Ihren Agenten bereit: Verwenden Sie BAML auf jede gewünschte Weise, da es nativen Code generiert, der sich nahtlos in Ihre bestehende Infrastruktur integriert.

Hauptmerkmale und Vorteile

- Typsicherheit: Definieren Sie KI-Schnittstellen sicher mit BAML-Schemas, die automatisch TypeScript-Typen generieren. Es gewährleistet strukturierte Ausgaben in Formaten wie JSON, XML und YAML.

- Vollständiger Entwicklungs-Workflow: Von der Definition von Prompts bis hin zum Testen und der Bereitstellung bietet BAML einen umfassenden Workflow zur Optimierung der KI-Anwendungsentwicklung.

- Automatische Wiederholung und Fallback: Wiederholen Sie fehlgeschlagene Anfragen automatisch und stellen Sie Fallback-Antworten bereit, wenn Fehler auftreten, um zuverlässigere KI-Interaktionen zu gewährleisten.

- Multi-Cloud-Bereitstellung: Unterstützt die Bereitstellung über mehrere Cloud-Plattformen wie AWS Lambda, Vercel, Google Cloud, Azure Functions und Railway.

- Testen in CI/CD: Testen Sie Agenten in Continuous Integration- und Continuous Deployment-Pipelines, um sicherzustellen, dass sie wie erwartet funktionieren.

Von Entwicklern geschätzt

BAML wird von Entwicklern in führenden Unternehmen eingesetzt und geschätzt. Benutzer loben seine Fähigkeit, strukturierte Daten von LLMs bereitzustellen, die Iterationsgeschwindigkeit und -qualität zu verbessern und starke Typgarantien zu bieten. Hier ist, was einige Benutzer sagen:

- Adam Gitzes von Amazon: "BAML ist erstaunlich. Ich habe es in Python und Typescript verwendet. Es ist ein Game Changer."

- Jason Fan von Finic.ai: "Habe gerade baml für mein Projekt eingerichtet, 10/10 Erfahrung und viel schneller als Langchain."

- Ray del Vecchio von Cerebral Valley: "Es ist erstaunlich!! Konnte meine Token und Time-to-First-Token deutlich reduzieren, ohne Kompromisse bei den Ergebnissen einzugehen."

Warum BAML wählen?

- Erhöhte Zuverlässigkeit: BAML hilft beim Aufbau von KI-Anwendungen mit verbesserter Zuverlässigkeit, indem es Typsicherheit und strukturierte Schnittstellen bietet.

- Vereinfachte Entwicklung: Es optimiert den KI-Entwicklungsprozess mit Tools zum Definieren, Testen und Bereitstellen von KI-Agenten.

- Flexibilität: BAML ist mit mehreren LLM-Anbietern kompatibel und unterstützt mehrere Programmiersprachen, wodurch Entwicklern die Flexibilität geboten wird, die sie benötigen.

Für wen ist BAML geeignet?

BAML ist für Entwickler gedacht, die KI-Anwendungen mit Zuversicht und Zuverlässigkeit erstellen möchten. Es ist besonders nützlich für diejenigen, die:

- Strukturierte Ausgaben von LLMs benötigen.

- Die Iterationsgeschwindigkeit und -qualität ihrer KI-Projekte verbessern möchten.

- Starke Typgarantien für ihre KI-Schnittstellen wünschen.

Wie man mit BAML anfängt

Um mit der Entwicklung typsicherer KI-Anwendungen mit BAML zu beginnen, führen Sie die folgenden Schritte aus:

- Installieren Sie BAML mit

uv add baml-py && uv run baml-cli init. - Definieren Sie Ihre Prompts und Funktionen mit BAML-Schemas.

- Testen Sie Ihre Agenten mit

baml-cli test. - Stellen Sie Ihren Agenten auf Ihrer bevorzugten Plattform bereit.

Mit BAML können Entwickler KI-Anwendungen mit Zuversicht erstellen, da sie wissen, dass ihre KI-Pipelines zuverlässig und typsicher sind.

Mit BAML Verwandte Tags