Predibase

Übersicht von Predibase

Predibase: Die Entwicklerplattform für Feinabstimmung und Bereitstellung von LLMs

Was ist Predibase? Predibase ist eine umfassende Plattform, die für Entwickler konzipiert wurde, um Open-Source Large Language Models (LLMs) feinabzustimmen und bereitzustellen. Sie ermöglicht es Benutzern, Modelle anzupassen und bereitzustellen, die GPT-4 in ihrer eigenen Cloud oder der Infrastruktur von Predibase übertreffen können.

Wie funktioniert Predibase? Predibase bietet eine End-to-End-Trainings- und Bereitstellungsinfrastruktur, die Funktionen wie Reinforcement Fine-Tuning, LoRAX-gestütztes Multi-LoRA-Serving und Turbo LoRA für schnelleren Durchsatz umfasst. Sie ermöglicht es Benutzern, mit deutlich weniger Daten zu trainieren und Modelle mit maximaler Geschwindigkeit bereitzustellen.

Hauptmerkmale und Vorteile:

- Reinforcement Fine-Tuning (RFT): Ermöglicht kontinuierliches Lernen durch Live-Belohnungsfunktionen, wodurch Modelle auch mit begrenzten Trainingsdaten eine außergewöhnliche Genauigkeit erzielen können. Sie können aufgabenspezifische Modelle mit minimalen Daten trainieren und die Modellleistung mit jeder Iteration verbessern. Passen Sie Belohnungsfunktionen in Echtzeit an, um sofortige Kurskorrekturen vorzunehmen.

- Turbo LoRA: Bietet einen 4x schnelleren Durchsatz im Vergleich zu anderen Lösungen und gewährleistet ultraschnelle Bereitstellungsgeschwindigkeiten ohne Einbußen bei der Genauigkeit.

- LoRAX-gestütztes Multi-LoRA-Serving: Ermöglicht die Ausführung von Inferenz im Massstab, wodurch die GPU-Kapazität effizient genutzt wird, indem Hunderte von feinabgestimmten Modellen auf einer einzigen GPU bereitgestellt werden.

- Mühelose GPU-Skalierung: Skaliert GPUs dynamisch in Echtzeit, um Inferenzspitzen zu bewältigen, wodurch keine Verlangsamungen und keine verschwendete Rechenleistung entstehen. Dedizierte A100- und H100-GPUs können für unternehmenstaugliche Zuverlässigkeit reserviert werden.

Anwendungsfälle:

- Anpassung und Bereitstellung von Open-Source-LLMs: Passen Sie Open-Source-LLMs an und stellen Sie sie bereit, um sie an spezifische Anwendungsfälle anzupassen, indem Sie die leistungsstarke Plattform von Predibase nutzen.

- Präzisions-Feinabstimmung: Nutzen Sie Belohnungsfunktionen und minimale gekennzeichnete Daten, um Modelle zu trainieren, die GPT-4 übertreffen.

- Nahtlose Bereitstellung in Unternehmen: Stellen Sie feinabgestimmte Modelle bereit, ohne dass eine separate Infrastruktur erforderlich ist, wodurch das Training kosteneffektiv wird.

Warum ist Predibase wichtig?

Predibase ist wichtig, weil es die Herausforderungen beim Trainieren und Bereitstellen von LLMs angeht und eine kostengünstige, hochleistungsfähige Lösung bietet. Es ermöglicht Entwicklern, Modelle mit weniger Daten feinabzustimmen, sie schneller bereitzustellen und effizient zu skalieren.

Wo kann ich Predibase verwenden?

Sie können Predibase in verschiedenen Szenarien verwenden, darunter:

- Kundenservice: Entwickeln Sie bessere Produkte für Ihre Kunden, was zu transparenteren und effizienteren Praktiken führt.

- Automatisierung: Erschließen Sie neue Automatisierungsanwendungsfälle, die zuvor unwirtschaftlich waren.

- Unternehmensanwendungen: Stellen Sie geschäftskritische AI-Anwendungen mit hochverfügbarer Multiregion, Protokollierung und Metriken sowie einem 24/7-Bereitschaftsdienst bereit.

Anwenderberichte:

- Giuseppe Romagnuolo, VP of AI, Convirza: "Predibase bietet die Zuverlässigkeit, die wir für diese Workloads mit hohem Volumen benötigen. Der Gedanke, diese Infrastruktur selbst aufzubauen und zu warten, ist entmutigend – zum Glück müssen wir das mit Predibase nicht tun."

- Vlad Bukhin, Staff ML Engineer, Checkr: "Durch die Feinabstimmung und Bereitstellung von Llama-3-8b auf Predibase haben wir die Genauigkeit verbessert, eine blitzschnelle Inferenz erzielt und die Kosten im Vergleich zu GPT-4 um das 5-fache gesenkt."

- Paul Beswick, Global CIO, Marsh McLennan: "Mit Predibase benötigte ich keine separate Infrastruktur für jedes feinabgestimmte Modell, und das Training wurde unglaublich kostengünstig – eher Dutzende Dollar als Hunderttausende."

Vorteile der Predibase-Plattform:

- Der leistungsstärkste Weg zum Trainieren.

- Der schnellste Weg zum Bereitstellen.

- Der intelligenteste Weg zum Skalieren.

Preise:

Detaillierte Preisinformationen finden Sie auf der Seite Predibase Pricing.

Bester Weg, LLMs feinabzustimmen und bereitzustellen? Predibase vereinfacht den Prozess der Feinabstimmung und Bereitstellung von LLMs, indem es eine umfassende Plattform mit Reinforcement Fine-Tuning, Turbo LoRA und LoRAX bietet. Die nahtlose Bereitstellung in Unternehmen, die mühelose GPU-Skalierung und die flexiblen Bereitstellungsoptionen machen es zur besten Lösung für Entwickler, die die Leistung und Effizienz ihrer AI-Modelle maximieren möchten.

Beste Alternativwerkzeuge zu "Predibase"

Mit UBIAI können Sie in wenigen Minuten leistungsstarke und genaue benutzerdefinierte LLMs erstellen. Optimieren Sie Ihren KI-Entwicklungsprozess und optimieren Sie LLMs für zuverlässige KI-Lösungen.

Blitzschnelle KI-Plattform für Entwickler. Bereitstellen, Feinabstimmen und Ausführen von über 200 optimierten LLMs und multimodalen Modellen mit einfachen APIs - SiliconFlow.

Float16.Cloud bietet serverlose GPUs für eine schnelle KI-Entwicklung. Führen Sie KI-Modelle ohne Einrichtung sofort aus, trainieren und skalieren Sie sie. Mit H100-GPUs, sekundengenauer Abrechnung und Python-Ausführung.

Anyscale, powered by Ray, ist eine Plattform zum Ausführen und Skalieren aller ML- und KI-Workloads in jeder Cloud oder On-Premises-Umgebung. Erstellen, debuggen und implementieren Sie KI-Anwendungen einfach und effizient.

Dynamiq ist eine On-Premise-Plattform zum Erstellen, Bereitstellen und Überwachen von GenAI-Anwendungen. Vereinfachen Sie die AI-Entwicklung mit Funktionen wie LLM-Feinabstimmung, RAG-Integration und Beobachtbarkeit, um Kosten zu senken und den Geschäfts-ROI zu steigern.

Unsloth AI bietet Open-Source-Feinabstimmung und verstärkendes Lernen für LLMs wie gpt-oss und Llama, mit 30-mal schnellerem Training und reduziertem Speicherverbrauch, wodurch KI-Training zugänglich und effizient wird.

Label Studio ist eine flexible Open-Source-Datenkennzeichnungsplattform für die Feinabstimmung von LLMs, die Vorbereitung von Trainingsdaten und die Bewertung von KI-Modellen. Unterstützt verschiedene Datentypen wie Text, Bilder, Audio und Video.

Xander ist eine Open-Source-Desktop-Plattform, die No-Code-KI-Modelltraining ermöglicht. Beschreiben Sie Aufgaben in natürlicher Sprache für automatisierte Pipelines in Textklassifikation, Bildanalyse und LLM-Fine-Tuning, mit Garantie für Datenschutz und Leistung auf Ihrem lokalen Gerät.

Trainieren, verwalten und evaluieren Sie benutzerdefinierte große Sprachmodelle (LLMs) schnell und effizient auf Entry Point AI, ohne dass Code erforderlich ist.

xTuring ist eine Open-Source-Bibliothek, die Benutzern ermöglicht, Large Language Models (LLMs) effizient anzupassen und zu optimieren, mit Fokus auf Einfachheit, Ressourcenoptimierung und Flexibilität für die KI-Personalisierung.

Yepp AI ist eine KI-gestützte Marketingplattform, die Unternehmen dabei unterstützt, mehr Leads zu generieren und das Unternehmenswachstum durch Content-Erstellung, Datenanalyse und Marketing-Automatisierung voranzutreiben.

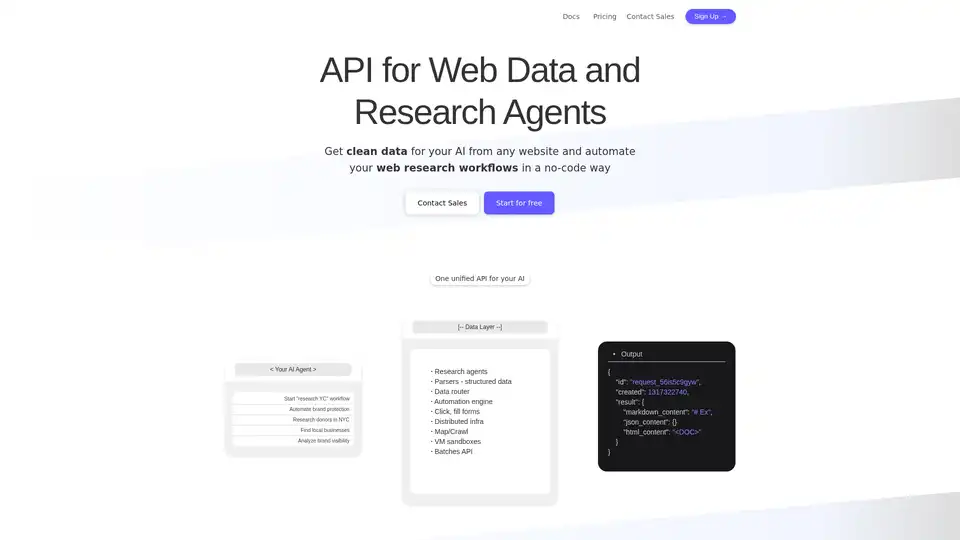

Olostep ist eine Webdaten-API für KI und Forschungsagenten. Sie ermöglicht es Ihnen, strukturierte Webdaten von jeder Website in Echtzeit zu extrahieren und Ihre Web-Research-Workflows zu automatisieren. Anwendungsfälle sind Daten für KI, Tabellenkalkulationsanreicherung, Leadgenerierung und mehr.

Refact.ai, der führende Open-Source-KI-Agent für Softwareentwicklung, automatisiert Codierung, Debugging und Tests mit vollständiger Kontextsensitivität. Eine Open-Source-Alternative zu Cursor und Copilot.

Vext entwickelt kundenspezifische KI-Lösungen für Unternehmen, einschließlich LLM-Anwendungen, Modell-Feinabstimmung, Managed Hosting und kundenspezifische API-Dienste.