VModel

Übersicht von VModel

VModel: Der Kern der Integration und Bereitstellung von KI-Modellen

Was ist VModel?

VModel vereinfacht die KI-Bereitstellung durch die Bereitstellung skalierbarer APIs für die Bildgenerierung, Textverarbeitung und benutzerdefinierte Modellintegration. Es ermöglicht Benutzern, KI-Modelle einfach auszuführen und zu verbessern sowie benutzerdefinierte Modelle mit minimalem Codeaufwand skaliert bereitzustellen.

Hauptmerkmale:

- Einfache KI-Modellbereitstellung: Stellen Sie benutzerdefinierte Modelle mit einer einzigen Codezeile bereit.

- Große Modellvielfalt: Greifen Sie über eine einheitliche API auf eine große Auswahl an KI-Modellen zu.

- Skalierbare APIs: Unterstützt Bildgenerierung, Textverarbeitung und benutzerdefinierte Modellintegration.

- Einfache API-Integration: Unkomplizierte REST-API und umfassende Dokumentation.

- Flexible Preisgestaltung: Pay-as-you-go-Preise ohne versteckte Gebühren oder monatliche Verpflichtungen.

Wie funktioniert VModel?

Die VModel-Plattform ermöglicht es Benutzern, Modelle einfach auszuführen, indem sie eine einzige Codezeile integrieren. Die Plattform bietet vortrainierte und tief optimierte Stilmodelle für hohe Leistung. Sie bietet eine REST-API, die mit jeder Programmiersprache oder jedem Framework funktioniert.

Der Prozess umfasst:

- Modelle erkunden: Entdecken Sie verschiedene Modelle, die für den Produktionseinsatz bereit sind.

- Modelle ausführen: Integrieren Sie Modelle mit nur einer einzigen Codezeile.

- Skalierung auf VModel: Verlassen Sie sich auf VModel, um KI-gesteuerte Lösungen zu betreiben.

curl -X POST https://api.vmodel.ai/api/tasks/v1/create \

-H "Authorization: $VModel_API_TOKEN" \

-H "Content-Type: application/json" \

-d '{

"version": "d4f292d1ea72ac4e501e6ac7be938ce2a5c50c6852387b1b64dedee01e623029",

"input": {

"swap_image": "https://example.com/swap_image.png",

"target_image": "https://example.com/target_image.png"

}

}'

Warum VModel wählen?

VModel bietet eine universelle API, blitzschnelle Leistung und erstklassigen Service ohne den Premium-Preis. Es abstrahiert die komplexe Infrastruktur und ermöglicht es Benutzern, sich auf die Entwicklung von KI-Anwendungen in Echtzeit zu konzentrieren. Mit VModel können Sie über eine einheitliche API auf eine breite Palette von KI-Modellen in verschiedenen Typen und Stilen zugreifen.

Für wen ist VModel geeignet?

VModel ist für jeden Anwendungsfall konzipiert, von Startups bis hin zu Unternehmen, und unterstützt KI-Anwendungen in verschiedenen Branchen:

- E-Commerce: Verbessern Sie die Produktbildgenerierung, virtuelle Anproben und personalisierte Empfehlungen.

- Content Creation: Automatisieren Sie die Content-Generierung, Bildbearbeitung und Videoverarbeitung.

- Unternehmen: Optimieren Sie die Dokumentenverarbeitung, die Automatisierung des Kundenservice und Business-Intelligence-Lösungen.

Preisgestaltung

VModel verwendet ein Pay-as-you-go-Preismodell, das es Benutzern ermöglicht, Credits einmalig zu kaufen und sie für immer zu verwenden. Jedes Modell hat seine eigene Preisstruktur, was Flexibilität bietet. Credits können in der gesamten Modellbibliothek verwendet werden und verfallen nie.

Was unsere Benutzer sagen

- Alex Chen, Senior Developer bei TechCorp: "Die API-Integration von VModel war nahtlos. Wir haben unsere KI-Implementierungszeit von Wochen auf nur wenige Stunden reduziert. Die Dokumentation ist ausgezeichnet und der Support ist reaktionsschnell."

- Sarah Kim, Product Manager bei StartupXYZ: "Das Credit-System ist brillant - keine monatlichen Gebühren und Credits verfallen nie. Perfekt für unsere variable Arbeitslast. Die Modellvielfalt ist auch beeindruckend."

- Mike Johnson, CTO bei InnovateLab: "Schnell, zuverlässig und kostengünstig. VModel ist zu unserer Go-to-Plattform für die Bereitstellung von KI-Modellen geworden. Die Leistungskennzahlen sind durchweg hervorragend."

Wie verwende ich VModel?

- Anmelden: Erstellen Sie ein Konto auf der VModel-Website.

- Modelle erkunden: Durchsuchen Sie die umfangreiche Bibliothek vortrainierter Modelle.

- API integrieren: Verwenden Sie die bereitgestellten API-Endpunkte in Ihrem Code.

- Credits verwalten: Kaufen Sie Credits, um sie für verschiedene Modelle zu verwenden.

Hauptvorteile von VModel

- Schnelle Integration: Beginnen Sie mit nur wenigen Codezeilen.

- Umfangreiche Dokumentation: Greifen Sie auf umfassende Anleitungen, Beispiele und API-Referenzen zu.

- Universelle Credits: Verwenden Sie ein Credit-System für alle Modelle.

Fazit

VModel vereinfacht die KI-Bereitstellung und -Integration und erleichtert es Entwicklern und Unternehmen, KI in ihren Anwendungen zu nutzen. Mit seiner flexiblen Preisgestaltung, der umfangreichen Modellbibliothek und der unkomplizierten API bietet VModel eine umfassende Lösung für die KI-Modellbereitstellung und -verwaltung.

Beste Alternativwerkzeuge zu "VModel"

Blitzschnelle KI-Plattform für Entwickler. Bereitstellen, Feinabstimmen und Ausführen von über 200 optimierten LLMs und multimodalen Modellen mit einfachen APIs - SiliconFlow.

Vereinfachen Sie die KI-Bereitstellung mit Synexa. Führen Sie leistungsstarke KI-Modelle sofort mit nur einer Codezeile aus. Schnelle, stabile und entwicklerfreundliche Serverless-KI-API-Plattform.

FinetuneFast: Starten Sie KI-Modelle schnell. Das Boilerplate, um Ihre KI-Modelle schnell zu starten. Beinhaltet RAG-Anwendungen.

Elham.ai ist eine automatisierte Machine-Learning-Plattform, die es Benutzern ermöglicht, KI-Modelle ohne Programmierung zu erstellen und bereitzustellen. Sie rationalisiert Daten-Workflows, wandelt Rohdaten in verwertbare Erkenntnisse um und vereinfacht den KI-Entwicklungsprozess.

GPUX ist eine serverlose GPU-Inferenzplattform, die 1-Sekunden-Kaltstarts für KI-Modelle wie StableDiffusionXL, ESRGAN und AlpacaLLM mit optimierter Leistung und P2P-Fähigkeiten ermöglicht.

Nexa SDK ermöglicht schnelle und private KI-Inferenz auf dem Gerät für LLMs, multimodale, ASR- und TTS-Modelle. Stellen Sie auf Mobilgeräten, PCs, in der Automobilindustrie und auf IoT-Geräten mit produktionsbereiter Leistung auf NPU, GPU und CPU bereit.

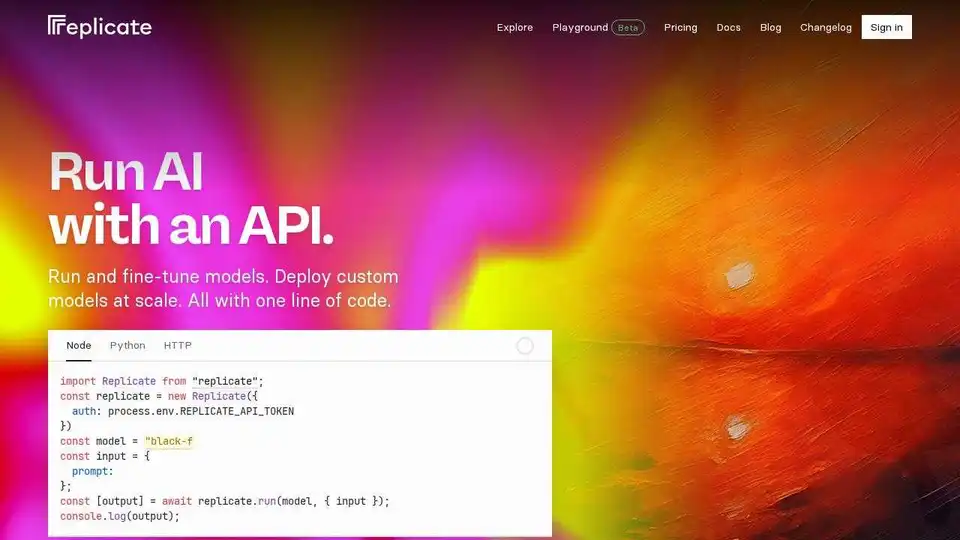

Mit Replicate können Sie Open-Source-Modelle für maschinelles Lernen mit einer Cloud-API ausführen und optimieren. Erstellen und skalieren Sie KI-Produkte mit Leichtigkeit.

ManagePrompt vereinfacht die KI-App-Entwicklung durch die Handhabung von Integrationen, Tests, Authentifizierung und Analysen. Erstellen Sie schnell KI-gestützte Apps mit nahtloser Modellbereitstellung und Sicherheitskontrollen.

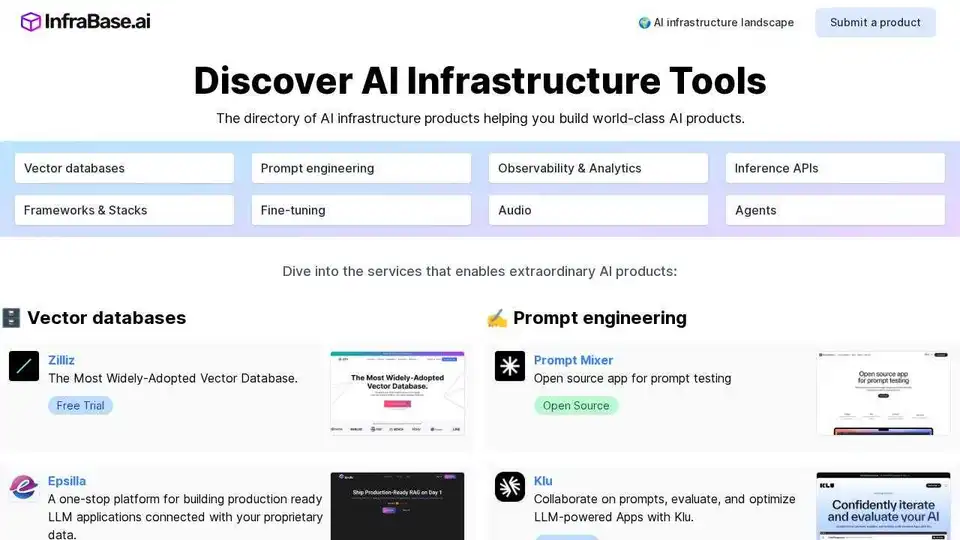

Infrabase.ai ist das Verzeichnis zur Entdeckung von KI-Infrastruktur-Tools und -Diensten. Finden Sie Vektor-Datenbanken, Prompt-Engineering-Tools, Inferenz-APIs und mehr, um erstklassige KI-Produkte zu entwickeln.

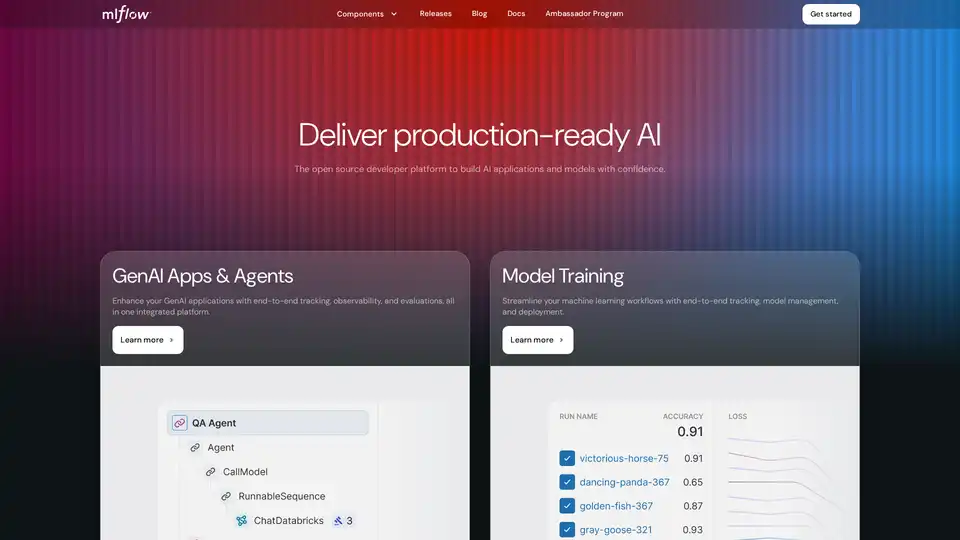

MLflow ist eine Open-Source-Plattform, die entwickelt wurde, um den gesamten Lebenszyklus des maschinellen Lernens zu verwalten. Es bietet Tools zum Verfolgen von Experimenten, Verwalten von Modellen und Optimieren der Bereitstellung und wird von Tausenden von Organisationen genutzt.

Kortical ist eine KI-Plattform für Datenwissenschaftler und bietet AutoML- und ML Ops-Funktionen für die schnelle Erstellung und Bereitstellung von KI-Lösungen der Enterprise-Klasse. Es unterstützt Code- und UI-Schnittstellen und fördert so eine schnellere Iteration und eine bessere Modellleistung.

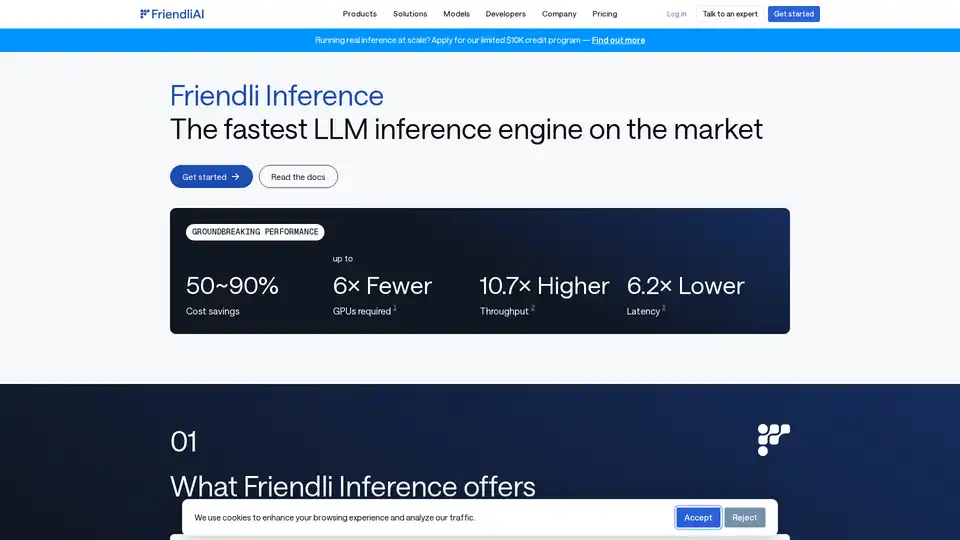

Friendli Inference ist die schnellste LLM-Inferenz-Engine, optimiert für Geschwindigkeit und Kosteneffizienz, die GPU-Kosten um 50-90 % senkt und gleichzeitig einen hohen Durchsatz und eine geringe Latenz bietet.

Bytebot ist ein Open-Source-KI-Desktop-Agent, der Aufgaben über mehrere Apps hinweg mithilfe eines virtuellen Computers automatisiert. Skalieren Sie von einem auf Hunderte von Agenten parallel und integrieren Sie sie in jede Software.

Deployo vereinfacht die KI-Modellbereitstellung und verwandelt Modelle in wenigen Minuten in produktionsreife Anwendungen. Cloud-agnostische, sichere und skalierbare KI-Infrastruktur für mühelosen Machine-Learning-Workflow.