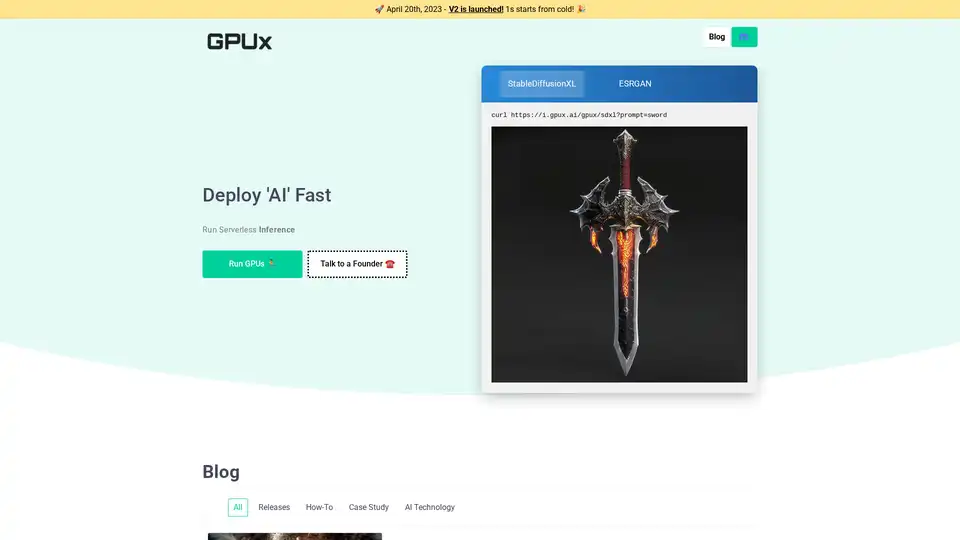

GPUX

Übersicht von GPUX

Was ist GPUX?

GPUX ist eine moderne serverlose GPU-Inferenzplattform, die speziell für KI- und Machine-Learning-Workloads entwickelt wurde. Die Plattform revolutioniert die Art und Weise, wie Entwickler und Organisationen KI-Modelle bereitstellen und ausführen, indem sie beispiellose 1-Sekunden-Cold-Start-Zeiten bietet, was sie ideal für Produktionsumgebungen macht, in denen Geschwindigkeit und Reaktionsfähigkeit entscheidend sind.

Wie funktioniert GPUX?

Serverlose GPU-Infrastruktur

GPUX arbeitet mit einer serverlosen Architektur, die es Benutzern erspart, die zugrunde liegende Infrastruktur verwalten zu müssen. Die Plattform stellt GPU-Ressourcen automatisch nach Bedarf bereit und skaliert nahtlos, um verschiedene Workloads ohne manuelle Eingriffe zu bewältigen.

Cold-Start-Optimierungstechnologie

Der bahnbrechende Erfolg der Plattform ist ihre Fähigkeit, 1-Sekunden-Cold-Starts aus einem vollständigen Leerlaufzustand zu erreichen. Dies ist besonders bedeutsam für KI-Inferenz-Workloads, die traditionell unter langen Initialisierungszeiten litten.

P2P-Fähigkeiten

GPUX integriert Peer-to-Peer-Technologie, die es Organisationen ermöglicht, ihre privaten KI-Modelle sicher zu teilen und zu monetarisieren. Diese Funktion ermöglicht es Modellbesitzern, Inferenzanfragen an andere Organisationen zu verkaufen, während sie die vollständige Kontrolle über ihr geistiges Eigentum behalten.

Kernfunktionen und Fähigkeiten

⚡ Blitzschnelle Inferenz

- 1-Sekunden-Cold-Starts aus vollständigem Leerlaufzustand

- Optimierte Leistung für beliebte KI-Modelle

- Niedrige Latenzzeiten für Produktionsworkloads

🎯 Unterstützte KI-Modelle

GPUX unterstützt derzeit mehrere führende KI-Modelle, darunter:

- StableDiffusion und StableDiffusionXL für Bildgenerierung

- ESRGAN für Bildsuperauflösung und -verbesserung

- AlpacaLLM für natürliche Sprachverarbeitung

- Whisper für Spracherkennung und Transkription

🔧 Technische Funktionen

- Lese-/Schreib-Volumes für persistente Datenspeicherung

- P2P-Modellfreigabe für sichere Modellverteilung

- curl-basierter API-Zugriff für einfache Integration

- Plattformübergreifende Kompatibilität (Windows 10, Linux OS)

Leistungsbenchmarks

Die Plattform hat bemerkenswerte Leistungsverbesserungen gezeigt, insbesondere macht sie StableDiffusionXL 50 % schneller auf RTX 4090 Hardware. Diese Optimierung zeigt die Fähigkeit von GPUX, die maximale Leistung aus verfügbaren Hardware-Ressourcen zu extrahieren.

Wie verwendet man GPUX?

Einfache API-Integration

Benutzer können auf die Fähigkeiten von GPUX durch einfache curl-Befehle zugreifen:

curl https://i.gpux.ai/gpux/sdxl?prompt=sword

Dieser unkomplizierte Ansatz eliminiert komplexe Einrichtungsverfahren und ermöglicht eine schnelle Integration in bestehende Workflows.

Bereitstellungsoptionen

- Webanwendungszugriff über die GPUX-Plattform

- GitHub-Verfügbarkeit für Entwickler, die Open-Source-Komponenten suchen

- Plattformübergreifende Unterstützung für verschiedene Betriebsumgebungen

Zielgruppe und Anwendungsfälle

Hauptbenutzer

- KI-Forscher, die schnelle Modellbereitstellung benötigen

- Startups, die kosteneffektive GPU-Ressourcen benötigen

- Unternehmen, die proprietäre KI-Modelle monetarisieren möchten

- Entwickler, die vereinfachte KI-Inferenzinfrastruktur suchen

Ideale Anwendungen

- Echtzeit-Bildgenerierung und -Bearbeitung

- Sprache-zu-Text-Transkriptionsdienste

- Anwendungen zur natürlichen Sprachverarbeitung

- Forschungs- und Entwicklungsprototyping

- Produktions-KI-Dienste, die zuverlässige Inferenz erfordern

Warum GPUX wählen?

Wettbewerbsvorteile

- Unübertroffene Cold-Start-Leistung - 1-Sekunden-Initialisierung

- Serverlose Architektur - keine Infrastrukturverwaltung erforderlich

- Monetarisierungsmöglichkeiten - P2P-Modellfreigabefähigkeiten

- Hardwareoptimierung - maximierte GPU-Auslastung

- Entwicklerfreundlich - einfache API-Integration

Geschäftswert

GPUX adressiert die grundlegende Herausforderung der GPU-Ressourcenzuteilung für KI-Workloads, ähnlich wie spezialisiertes Schuhwerk anatomische Unterschiede adressiert. Die Plattform bietet "die richtige Passform" für Machine-Learning-Workloads und gewährleistet optimale Leistung und Kosteneffizienz.

Unternehmenshintergrund

GPUX Inc. hat seinen Hauptsitz in Toronto, Kanada, mit einem verteilten Team, darunter:

- Annie - Marketing in Krakau

- Ivan - Technologie in Toronto

- Henry - Betrieb in Hefei

Das Unternehmen unterhält einen aktiven Blog, der technische Themen abdeckt, einschließlich KI-Technologie, Fallstudien, How-To-Anleitungen und Release Notes.

Erste Schritte

Benutzer können über mehrere Kanäle auf GPUX zugreifen:

- Webanwendung (V2 derzeit verfügbar)

- GitHub-Repository für Open-Source-Komponenten

- Direkter Kontakt mit dem Gründungsteam

Die Plattform entwickelt sich weiter, mit regelmäßigen Updates und Leistungsverbesserungen, die durch ihre Release Notes und technischen Blogbeiträge dokumentiert werden.

Mit GPUX Verwandte Tags