Backmesh

Vue d'ensemble de Backmesh

Backmesh : Sécurisez vos clés d’API LLM et contrôlez l’accès

Qu’est-ce que Backmesh ? Backmesh est un backend open source, rigoureusement testé, conçu pour protéger vos clés d’API de grands modèles linguistiques (LLM). Il agit comme un contrôleur d’accès API, permettant à votre application d’interagir en toute sécurité avec les LLM. Cela évite les fuites coûteuses et les accès non autorisés, protégeant ainsi vos ressources.

Comment fonctionne Backmesh ?

Backmesh offre plusieurs fonctionnalités clés pour améliorer la sécurité et le contrôle de votre utilisation de l’API LLM :

- Authentification JWT: Backmesh vérifie les requêtes à l’aide de jetons Web JSON (JWT) provenant du fournisseur d’authentification de votre application. Cela garantit que seuls les utilisateurs autorisés peuvent accéder à l’API LLM via Backmesh.

- Limites de débit: Configurez des limites de débit par utilisateur pour éviter les abus. Par exemple, vous pouvez limiter les utilisateurs à un maximum de 5 appels d’API OpenAI par heure.

- Contrôle d’accès aux ressources de l’API: Protégez les ressources d’API sensibles comme les fichiers et les threads, en vous assurant que seuls les utilisateurs qui les ont créés peuvent y accéder.

Principales fonctionnalités et avantages

- Sécurité renforcée: Protège vos clés d’API LLM contre l’exposition dans le code frontend de votre application, évitant ainsi les fuites et l’utilisation non autorisée.

- Maîtrise des coûts: Mettez en œuvre des limites de débit pour éviter une utilisation excessive de l’API et des coûts imprévus.

- Contrôle d’accès: Gérez l’accès à des ressources d’API spécifiques, assurant ainsi la confidentialité et la sécurité des données.

- Analyse des utilisateurs de LLM: Instrumentez tous les appels d’API LLM pour suivre les schémas d’utilisation, réduire les coûts et améliorer la satisfaction des utilisateurs au sein de vos applications d’IA.

Comment utiliser Backmesh ?

Backmesh est conçu pour être facilement intégré à votre architecture d’application existante. Déployez simplement le backend Backmesh et configurez votre application pour acheminer les requêtes d’API LLM via celui-ci.

- Commencez avec le backend open source: Vous pouvez tirer parti de la nature open source de Backmesh pour le déployer et le personnaliser en fonction de vos besoins spécifiques.

- Intégration: Dirigez les appels d’API LLM de votre application via Backmesh.

- Analyse: Obtenez des informations grâce au suivi de l’utilisation pour optimiser les coûts et l’expérience utilisateur.

À qui s’adresse Backmesh ?

Backmesh est idéal pour les développeurs et les organisations qui :

- Développent des applications qui utilisent des LLM.

- Doivent protéger leurs clés d’API LLM.

- Souhaitent contrôler l’accès aux API LLM.

- Souhaitent suivre l’utilisation de l’API LLM.

Pourquoi choisir Backmesh ?

Choisir Backmesh, c’est opter pour une solution robuste, sécurisée et rentable pour gérer vos interactions avec l’API LLM. Sa nature open source favorise les améliorations et la transparence axées sur la communauté, tandis que ses fonctionnalités intégrées offrent un contrôle granulaire et des analyses perspicaces. En mettant en œuvre Backmesh, vous vous assurez que votre application peut exploiter en toute sécurité et efficacement la puissance des LLM sans compromettre la sécurité ou le budget.

Prêt à prendre le contrôle de la sécurité de votre API LLM ? Commencez avec Backmesh et créez vos applications d’IA en toute confiance.

Meilleurs outils alternatifs à "Backmesh"

Découvrez la Suite d'Images AI de Jasper : Remplacez les arrière-plans, supprimez le texte, agrandissez les images et décadrez instantanément pour des visuels évolutifs et de marque. Boostez les campagnes avec une efficacité pilotée par l'IA.

GPT for Work intègre les meilleures IA telles que ChatGPT, Gemini dans Excel, Word, Sheets & Docs, automatisant des tâches telles que la traduction, la génération de contenu et l'analyse de données. Idéal pour les professionnels à la recherche d'une productivité accrue.

WhyLabs fournit l'observabilité de l'IA, la sécurité LLM et la surveillance des modèles. Protégez les applications d'IA générative en temps réel pour atténuer les risques.

Sécurisez vos systèmes d'IA avec le red teaming automatisé et les tests de sécurité de Mindgard. Identifiez et résolvez les risques spécifiques à l'IA, en garantissant des modèles et des applications d'IA robustes.

UpTrain est une plateforme LLMOps complète qui fournit des outils de qualité entreprise pour évaluer, expérimenter, surveiller et tester les applications LLM. Hébergez dans votre propre environnement cloud sécurisé et mettez l'IA à l'échelle en toute confiance.

GPT-trainer vous permet de créer des agents IA personnalisés pour les ventes, le support, etc. Intégrez-les à vos systèmes et automatisez les flux de travail en quelques minutes. Commencez gratuitement dès aujourd'hui !

APIPark est une passerelle LLM open source et un portail pour développeurs d'API permettant de gérer les LLM en production, garantissant la stabilité et la sécurité. Optimisez les coûts LLM et créez votre propre portail API.

Superagent fournit une protection en temps réel pour les agents d'IA avec des modèles spécialement entraînés. Il protège contre les attaques, vérifie les sorties et expurge les données sensibles en temps réel, garantissant ainsi la sécurité et la conformité.

Langtrace est une plateforme d'observabilité et d'évaluations open source conçue pour améliorer les performances et la sécurité des agents d'IA. Suivez les métriques essentielles, évaluez les performances et assurez une sécurité de niveau entreprise pour vos applications LLM.

You.com propose des solutions d'IA d'entreprise et une API de recherche Web pour les LLM, permettant aux entreprises de créer des applications d'IA sécurisées et évolutives avec un contrôle total. Obtenez des résultats Web en temps réel et étayés par des citations.

Vext crée des solutions d'IA personnalisées pour les entreprises, notamment des applications LLM, le réglage fin de modèles, l'hébergement géré et les services d'API personnalisés.

UsageGuard propose une plateforme IA unifiée pour un accès sécurisé aux LLMs d'OpenAI, Anthropic et plus, avec des sauvegardes intégrées, optimisation des coûts, surveillance en temps réel et sécurité de niveau entreprise pour rationaliser le développement IA.

Future AGI offre une plateforme unifiée d'observabilité LLM et d'évaluation d'agents IA pour les applications d'IA, garantissant la précision et l'IA responsable du développement à la production.

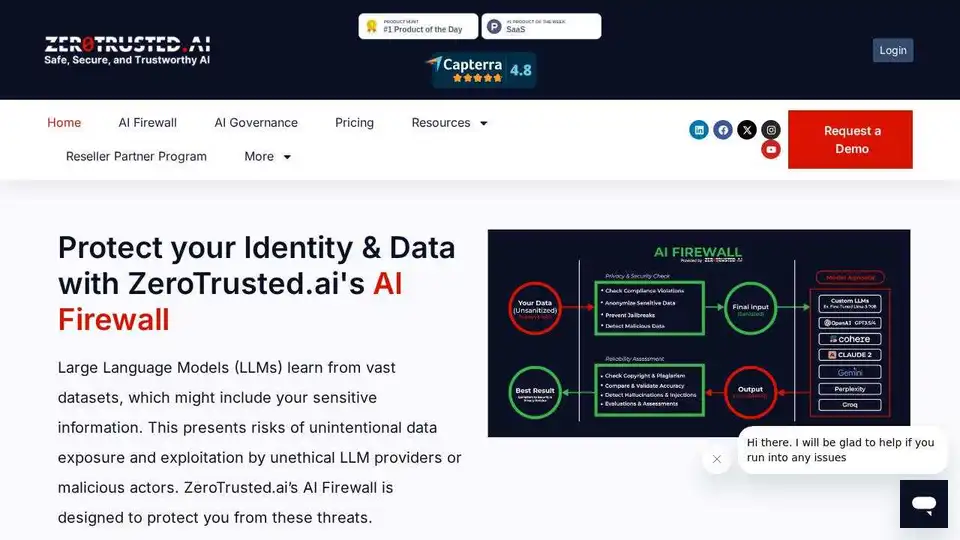

ZeroTrusted.ai propose un pare-feu IA, une passerelle IA et un contrôle de santé IA pour sécuriser votre écosystème IA. Découvrez et bloquez les outils d'IA non autorisés, assurez la sécurité des données et maintenez la conformité.