Reflection 70B の概要

Reflection 70B: 世界最高のオープンソース AI モデル

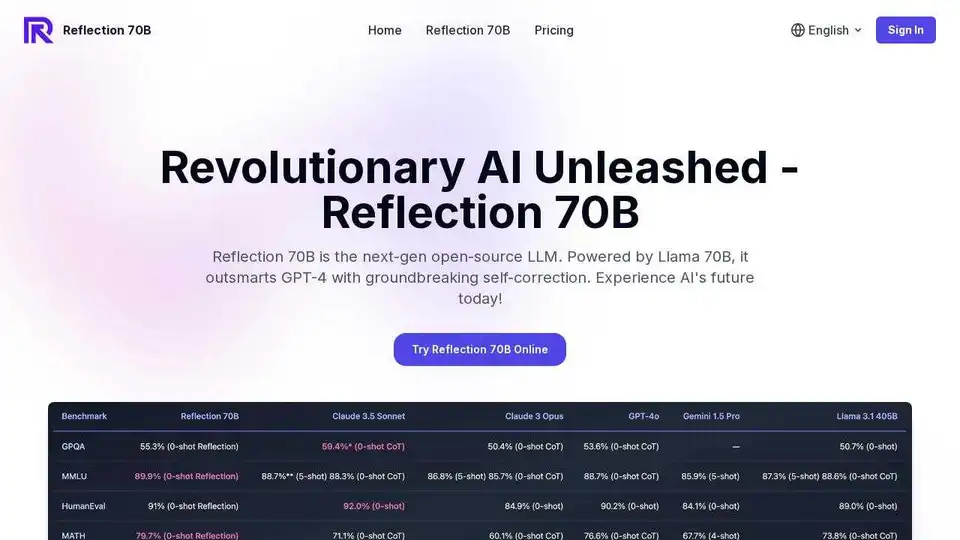

Reflection 70B とは何ですか? Reflection 70B は、Reflection-Tuning と呼ばれる新しいトレーニング技術を活用した、画期的なオープンソースの大規模言語モデル (LLM) です。このアプローチにより、モデルはリアルタイムで独自の推論の誤りを検出し、修正できるため、より正確で信頼性の高い出力が得られます。

主な機能と利点:

- Reflection-Tuning: モデルが推論エラーを動的に識別して修正できる独自のトレーニング方法を採用しています。

- 最高のパフォーマンス: さまざまなベンチマークで他のオープンソース LLM よりも優れた性能を発揮し、優れた推論および言語理解能力を示しています。この優れたパフォーマンスにより、AI 研究者や開発者にとって最適な選択肢となっています。

- リアルタイム推論: 明確な思考、反省、および出力段階でモデルの思考プロセスの透明なビューを提供します。これにより、ユーザーはモデルがどのように結論に至るかを理解できます。

- 多彩なアプリケーション: 複雑な推論、質疑応答、およびクリエイティブな執筆など、幅広いタスクに適しています。企業は、カスタマーサービスからコンテンツ作成まで、多くのユースケースで Reflection 70B を活用できます。

- 簡単な統合: 既存の Llama モデルパイプラインおよびチャット形式との互換性を持つように設計されており、既存のプロジェクトへのシームレスな統合を保証します。

- オープンソース: 個人および商用プロジェクトの両方で無料で使用でき、透明性と協調的な AI 開発を促進します。

Reflection 70B はどのように機能しますか?

Reflection 70B は、Reflection-Tuning 技術を利用しています。Reflection-Tuning はどのように機能しますか? この技術は、モデルに独自の推論プロセスを批判的に評価し、エラーを識別するように教えます。モデルは、自身の誤りを反省することにより、それらを修正することを学習し、より信頼性が高く正確な出力につながります。この機能により、Reflection 70B は他のオープンソース LLM と差別化されます。

よくある質問

Reflection 70B とその機能について、最もよく寄せられる質問を以下に示します。

- Reflection 70B とは何ですか? Reflection 70B は、Reflection-Tuning と呼ばれる新しい技術を使用してトレーニングされた、世界最高のオープンソース大規模言語モデル (LLM) です。推論プロセスにおける誤りを検出して修正できます。

- Reflection-Tuning はどのように機能しますか? Reflection-Tuning は、モデルに推論における誤りを識別して修正するように教え、より正確で信頼性の高い出力につながります。

- Reflection 70B をユニークにするものは何ですか? Reflection 70B は、独自の推論を反省する能力、ベンチマークでの優れたパフォーマンス、およびオープンソースの性質により際立っています。

- Reflection 70B はどのように使用できますか? チャットインターフェイスを介して Reflection 70B を使用するか、標準の Llama モデルパイプラインおよびチャット形式を使用してプロジェクトに統合できます。

- Reflection 70B は無料で使用できますか? はい、Reflection 70B はオープンソースであり、個人および商用目的で無料で使用できます。

- Reflection 70B はどのような種類のタスクを処理できますか? Reflection 70B は、複雑な推論、質疑応答、クリエイティブな執筆、およびさまざまな他の自然言語処理タスクに優れています。

- Reflection 70B をモバイルデバイスで使用できますか? はい、Reflection 70B は、スマートフォンやタブレットを含むすべてのデバイスで完全にレスポンシブで機能するように設計されています。

- Reflection 70B は個人データを保存しますか? いいえ、Reflection 70B は個人データまたはユーザーが入力したコンテンツを保存せず、プライバシーとセキュリティを保証します。

- Reflection 70B に関する詳細情報はどこで入手できますか? Reflection 70B に関する詳細情報は、当社のウェブサイトまたは AI 技術に特化した評判の良い教育ウェブサイトで入手できます。

- Reflection 70B を自分のプロジェクトに統合できますか? はい、開発者は Reflection 70B を自分のプロジェクトに統合することを歓迎します。 API アクセスと詳細については、開発者向けセクションをご覧ください。

結論

Reflection 70B は、オープンソース AI モデルにおける大きな進歩を表しており、複雑な推論、言語理解、およびクリエイティブなタスクのための強力なツールをユーザーに提供します。独自の Reflection-Tuning 機能、および簡単な統合と無料の可用性と組み合わされて、AI 開発者、研究者、および企業にとって貴重なリソースとなっています。 Reflection 70B を探索し、AI プロジェクトにおけるリアルタイム推論の可能性を解き放ちます。

"Reflection 70B" のベストな代替ツール

Nebius AI Studio Inference Service は、ホストされたオープンソースモデルを提供し、独自 API よりも高速で安価で正確な推論結果を実現します。MLOps 不要でシームレスにスケールし、RAG や本番ワークロードに最適です。

Private LLMは、オフラインで動作するiOSおよびmacOS用のローカルAIチャットボットであり、情報を完全にデバイス上に保持し、安全かつプライベートに保ちます。 iPhone、iPad、Macで検閲されていないチャットをお楽しみください。

Alan AIは、エンタープライズアプリケーション向けの自己コーディングインテリジェンスを可能にするアダプティブアプリAIプラットフォームです。自己コーディングシステムでオンデマンドで機能を提供し、開発者の労力を削減し、ユーザーエクスペリエンスを変革します。

Falcon LLM は TII のオープンソース生成大規模言語モデルファミリーで、Falcon 3、Falcon-H1、Falcon Arabic などのモデルを備え、多言語・多モード AI アプリケーションを日常デバイスで効率的に実行します。

Unsloth AI は、gpt-oss や Llama などの LLM にオープンソースの微調整と強化学習を提供し、トレーニングを 30 倍高速化し、メモリ使用量を削減することで、AI トレーニングをアクセスしやすく効率的にします。

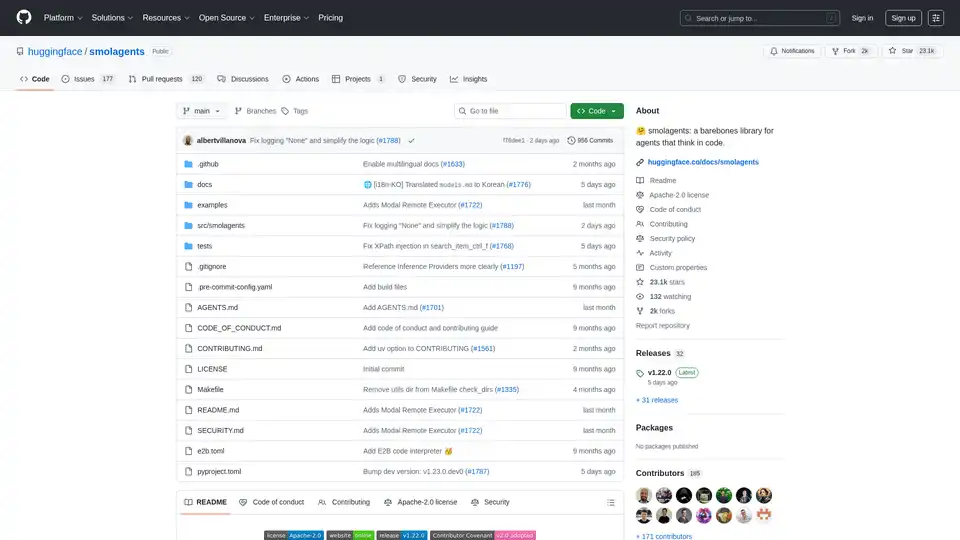

smolagents は、コードを通じて推論し行動する AI エージェントを作成するためのミニマリスト Python ライブラリです。LLM 無関係のモデル、安全なサンドボックス、Hugging Face Hub とのシームレスな統合をサポートし、高効率のコードベースのエージェントワークフローを実現します。

Lampi AIは、金融専門家向けのAIエージェントを提供し、複雑な金融ワークフローを構造化された高品質の分析に数分で変換します。M&A、投資銀行、プライベートエクイティ、および法律部門に最適です。

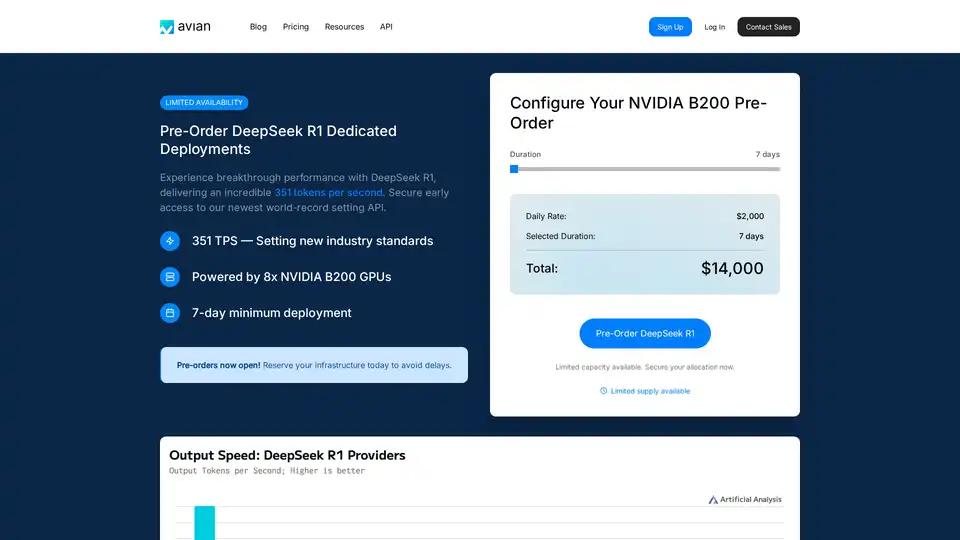

Avian APIは、オープンソースLLMに最速のAI推論を提供し、DeepSeek R1で351 TPSを達成します。OpenAI互換APIを使用して、HuggingFace LLMを3〜10倍の速度でデプロイします。エンタープライズグレードのパフォーマンスとプライバシー。

Reflection 70Bをオンラインで試してみてください。Llama 70Bに基づくオープンソースLLMです。革新的な自己修正により、GPT-4を上回ります。オンライン無料トライアルが利用可能です。

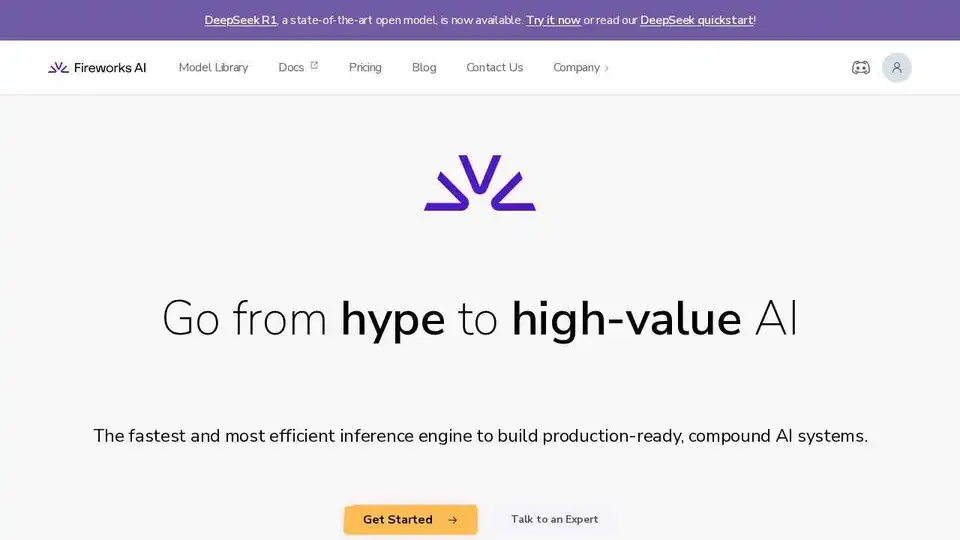

Fireworks AIは、最先端のオープンソースモデルを使用して、生成AI向けの非常に高速な推論を提供します。追加費用なしで独自のモデルを微調整してデプロイできます。AIワークロードをグローバルに拡張します。

Predibaseは、オープンソースLLMを微調整して提供するための開発者向けプラットフォームです。強化学習機能を備えた、エンドツーエンドのトレーニングおよびサービスインフラストラクチャにより、比類のない精度と速度を実現します。

Xanderは、オープンソースのデスクトッププラットフォームで、ノーコードAIモデルトレーニングを可能にします。自然言語でタスクを記述するだけで、テキスト分類、画像分析、LLMファインチューニングの自動化パイプラインを実行し、ローカルマシンでプライバシーとパフォーマンスを確保します。

Sagify は、オープンソースの Python ツールで、AWS SageMaker 上の機械学習パイプラインを簡素化し、独自およびオープンソースの大規模言語モデルをシームレスに統合する統一 LLM ゲートウェイを提供します。

Atla AI の Selene は、AI アプリのパフォーマンスに関する正確な判断を提供します。業界をリードする精度と信頼性の高い AI 評価のために、オープンソース LLM Judge モデルをご覧ください。