FILM Frame Interpolation の概要

FILM フレーム補間とは何ですか?

FILM(Frame Interpolation for Large Motion の略)は、Google Research が開発した最先端のニューラルネットワークで、特に大きなシーンの動きを含むビデオで滑らかな中間フレームを生成します。光学フローや深度推定のために事前訓練されたネットワークに依存する伝統的な方法とは異なり、FILM は統一されたシングルネットワークアプローチを使用します。これにより、トレーニング中にフレームトリプレットから直接高品質な補間を作成する効率的で強力なものになります。オープンソースの TensorFlow 2 実装としてリリースされており、複雑なセットアップなしでビデオの流動性を向上させたい開発者や研究者にとってアクセスしやすくなっています。

このモデルは、大規模なシーンの動き——高速で移動する物体やダイナミックなカメラパン——を扱う能力で際立っています。従来の補間手法はしばしば失敗し、アーティファクトやぼやけを生じさせます。多スケール特徴抽出器間で畳み込み重みを共有することで、FILM は最先端のベンチマークスコアを達成しつつ、アーキテクチャを軽量に保ち、基本入力から訓練可能にしています。

FILM はどのように動作しますか?

核心では、FILM は 2 つの入力フレーム(frame1 と frame2)を処理し、指定されたタイムスタンプの中間フレームを予測します。プロセスは多スケール特徴抽出段階から始まり、畳み込み層が異なる解像度で入力 を分析して、細かな詳細と広範な動きパターンを捉えます。これらの特徴は、次第の上サンプリングとブレンド操作を通じて融合・洗練され、出力フレームやビデオシーケンスを生成します。

その革新の鍵は外部依存の回避です。伝統的なフレーム補間は光学フローを使ってピクセルレベルの対応を計算するかもしれませんが、FILM はネットワーク内でこれを暗黙的に学習します。推論中では、'times_to_interpolate' パラメータで補間深度を制御:1 に設定すると単一の中間フレーム(t=0.5 で)、またはより高く(最大 8)で指数関数的にフレームが増える完全なビデオ(合計 2^times_to_interpolate + 1、30 FPS で)。この再帰的呼び出しは、オクルージョンや急速な変形などの挑戦的なシナリオでも滑らかなトランジションを保証します。

2022 年の基盤技術レポートは、モデルが多様なビデオデータセットで訓練され、ピクセル完璧な精度ではなく知覚品質を最適化した詳細を説明しています。これにより、人間の知覚を模倣した視覚的に魅力的な出力が生まれ、原始合成を超えたアプリケーションに理想的です。

FILM フレーム補間をどのように使用しますか?

FILM の開始は簡単で、Replicate などのプラットフォームでの API アクセスや GitHub リポジトリでのローカル実行のおかげです。

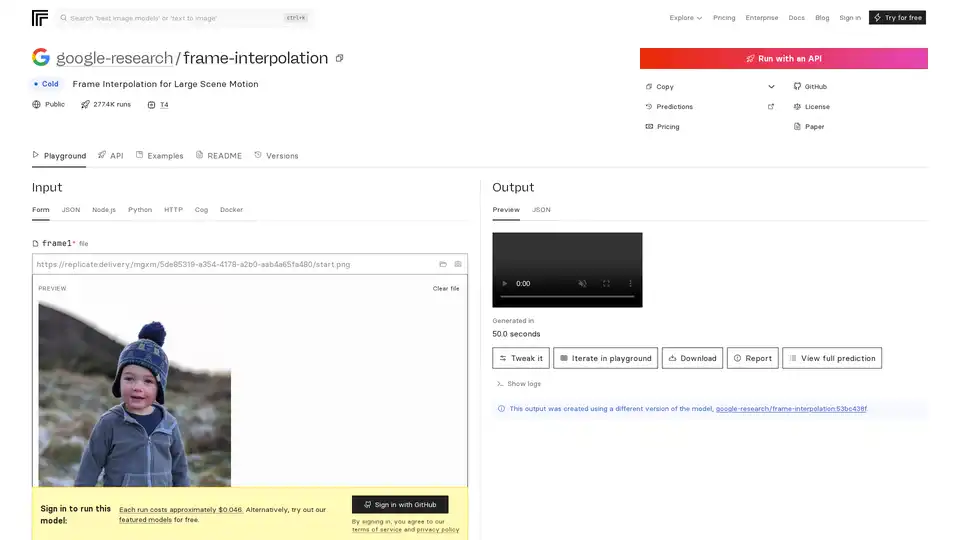

Replicate API 経由:frame1 と frame2 として 2 つの画像ファイルをアップロードします。出力の複雑さを定義するために 'times_to_interpolate'(デフォルト 1)を調整。Nvidia T4 GPU で予測が実行され、通常 4 分以内に完了し、1 回あたり約 $0.046 のコスト(1 ドルあたり約 21 回)。出力にはプレビュー画像、ダウンロード可能なビデオ、または JSON メタデータが含まれます。Featured モデルでの無料トライアルではサインイン不要ですが、GitHub ログインでフルアクセスが解除されます。

Docker を使用したローカルセットアップ:https://github.com/google-research/frame-interpolation の GitHub リポジトリをクローン。Docker で簡単な環境隔離——イメージをプルしてコマンドラインで予測を実行、または Python/Node.js スクリプトに統合。Cog フレームワークはカスタム入力をサポートし、バッチ処理のための拡張性を提供します。

入力要件:フレームはシーケンシャル画像(例: JPEG/PNG)であるべきです。ビデオ補間の場合、再帰的にペアを処理。クイックテストのための Webcam キャプチャがサポートされます。

Replicate での例は、スポーツ映像やアニメーションシーケンスの補間などの実世界の使用を示し、アーティファクトのない結果をデモンストレーションします。

プロジェクトで FILM をなぜ選ぶのですか?

FILM は他のツールが失敗するところで優れ、多モデルパイプラインの計算オーバーヘッドなしに大規模動きの優れた処理を提供します。ECCV 2022 論文のベンチマークスコアは、補間 PSNR や SSIM などのメトリクスで競合他社に対する優位性を強調します。許可的なライセンスの下でオープンソースであり、コミュニティ貢献を促進——zsxkib/film-frame-interpolation-for-large-motion などのフォークや関連モデルがビデオ特化タスクに適応させています。

コスト効果も魅力:無料のローカル実行対手頃なクラウド予測。さらに、YouTube デモと論文が透明な検証を提供し、本番使用への信頼を築きます。ドローンやアクションカメラからのジャーキーな低 FPS ビデオを扱う場合、FILM はそれらを努力なくシネマティックな体験に変えます。

FILM フレーム補間は誰のためのものですか?

このツールは、AI 愛好家、ビデオエディター、コンピュータビジョンに焦点を当てた機械学習実践者向けです。

開発者と研究者:論文やプロトタイプでニューラル補間を実験するのに理想的、特にビデオ圧縮やアニメーションの分野で。

コンテンツクリエイター:映画製作者や YouTuber はフレームレートをアップスケールしてスムーズな再生を向上させ、高価なハードウェアなしでモバイルやウェブビデオを強化できます。

業界プロ:ゲーム(例: スムーズなアニメーションのためのフレームレートブースト)や監視(スパース映像の補間)で、FILM の効率が輝きます。予測時間のためリアルタイムアプリケーションには不向きですが、オフライン強化に完璧です。

Replicate 上の関連モデル、例 pollinations/rife-video-interpolation や zsxkib/st-mfnet はビデオ-to-ビデオワークフローを提供して FILM を補完しますが、FILM の大規模動きへの焦点がニッチな利点を与えます。

実用的価値とユースケース

FILM の真の力は汎用性にあります。教育では、物理デモのスローモーション分析を作成するのに役立ちます。マーケティングでは、製品ショットの補間により流れるような回転を披露。GitHub のユーザー反馈は、実映像で一般的ないオクルージョンを扱う容易さを称賛しています。

ケースを考えてみてください:手持ちカメラの揺れる 15 FPS クリップを持つ野生動物ビデオグラファー。FILM を使用して 30 FPS 出力を生成し、速い動物の動きの詳細を保持——生の映像をプロフェッショナルなリールに変えます。

価格スキームは透明:Replicate の pay-per-run モデルは使用量にスケールし、自ホストは継続コストを排除。FAQ については、入力のトラブルシューティングやバージョン差(例: 現在は google-research/frame-interpolation:53bc438f を使用)で README を確認。

要約すると、FILM は Google のメディア強化のためのアクセス可能な AI へのコミットメントを表します。ワークフローを最適化したり研究の限界を押し広げたりするにせよ、優れたフレーム補間の信頼できる選択です。GitHub リポジトリや Replicate プレイグラウンドに飛び込んで行動を見てみてください——あなたのビデオは二度とと同じに見えません。

"FILM Frame Interpolation" のベストな代替ツール

VideoProc Converter AIは、GPUアクセラレーションによるビデオ/画像/オーディオの強化、変換、編集、圧縮、ダウンロード、録画を行うためのワンストップAIメディア処理ソリューションです。4K/8Kビデオ、DVD、オンラインメディアをサポートします。

WinXDVD: DVD リッピング、AI ビデオエンハンスメント、iPhone データ管理用のマルチメディア ソリューション。ビデオを強化し、DVD をすばやくリッピングし、iPhone データを簡単に転送します。世界中の何百万人ものユーザーから信頼されています。

VIDIOはAIでビデオ編集を簡素化し、時間を短縮し、初心者でも簡単に利用できるようにします。機能には、AI搭載のモーショングラフィックス、ハイライト作成、オブジェクト変換、ビデオエンハンスメントが含まれます。クラウドストレージとデスクトップエディタに対応。

HitPaw VikPeaを使用してビデオ品質を8Kに向上させます。これは、ワンクリックでビデオを鮮明化、復元、色付けするAIビデオエンハンサーです。 高速で安定した大規模なビデオエンハンスメントを体験してください。

Topaz Video でビデオを強化しましょう。これは、アップスケール、ノイズ除去、安定化、および映像のスムージングを行う AI 搭載ソフトウェアです。映画品質の結果を得るために、クリエイティブなプロから信頼されています。

Winxvideo AI は、ビデオ/画像を 4K にアップスケールし、手ぶれビデオを安定化し、fps を高め、変換、圧縮、ビデオ編集、GPU 高速化による画面録画を行うための包括的な AI ビデオ ツールキットです。

AVCLabs Video Enhancer AIは先進のAI技術を使用してビデオ品質を向上させ、SDから8Kへの解像度アップスケール、古い映像の修復、白黒ビデオのカラー化、揺れる映像の安定化をプロ級の結果で実現します。

AniPortraitは、オープンソースのAIフレームワークで、音声またはビデオ入力によって駆動されるフォトリアリスティックなポートレートアニメーションを生成します。自駆動、顔再現、オーディオ駆動モードをサポートし、高品質なビデオ合成を実現します。

AnimateDiffは、AI生成のビジュアルに動きを加える無料のオンラインビデオメーカーです。テキストプロンプトからアニメーションを作成したり、既存の画像を実際のビデオから学んだ自然な動きでアニメーション化したりできます。このプラグアンドプレイフレームワークは、Stable Diffusionのような拡散モデルにビデオ機能を追加し、再トレーニング不要です。AnimateDiffのテキスト-to-ビデオと画像-to-ビデオ生成ツールで、AIコンテンツ作成の未来を探求しましょう。

bigmp4を発見、先進AIツールで2K/4K/8Kへの無損ビデオ拡大、白黒ビデオ彩色化、60-240fpsの滑らかなAI補間、シルキーなスローモーション。MP4、MOVなどをサポート。

AnyEnhancerは、4Kへのアップスケーリング、ノイズ除去、彩色、スムージング、顔の復元により、ビデオを高画質に変換するAIビデオエンハンサーです。 今すぐビデオを強化してください!

FocalのAIを活用した動画作成ソフトウェアで、独自のテレビ番組や映画を作成しましょう。スクリプトから生成したり、チャットで編集したり、最新のAIモデルを使用してビデオの拡張やフレーム補間などを行ったりできます。

Anvsoftは、マルチメディア体験を向上させるために設計されたAVCLabs Video Enhancer AIを含む、AI搭載のビデオおよび写真ツールを提供しています。