Llama Family の概要

Llama Family:オープンソースのAIモデルエコシステム

Llama Familyとは? Llama Familyは、Llamaモデルと関連技術を中心とした共同作業を通じて、汎用人工知能(AGI)の開発を促進することに特化したオープンソースコミュニティです。開発者や愛好家が、大規模モデルから小規模モデル、テキストからマルチモーダル機能、ソフトウェアからハードウェアアルゴリズムの最適化まで、AIのさまざまな側面を網羅するオープンソースのエコシステムに貢献できるプラットフォームの構築を目指しています。

Llama Familyの主要コンポーネント

モデル: このコミュニティは、Metaによってオープンソース化されたさまざまなLlamaモデル(Llama、Llama 2、Llama 3、Code Llama、Atomなど)に焦点を当てています。これらのモデルは、さまざまなユースケースや研究の方向性に対応するため、さまざまなパラメータサイズとトレーニングデータセットをカバーしています。

計算リソース: このコミュニティは、モデルのトレーニングと実験のためのコラボレーションとリソースの共有を奨励しています。これには、GeForce RTXシリーズ、NVIDIA H100、A100 Tensor Core GPUなどのGPUリソースの活用が含まれます。

コミュニティ: Llama Familyの中心となるのは、開発者、研究者、愛好家からなる活気のあるコミュニティです。このコミュニティは、コラボレーション、知識の共有、リソースとツールの共同作成を促進します。

Llamaモデル

Meta Llama

Metaによってオープンソース化されたLlamaモデルは、産業界と学術界の両方で広く使用されています。バージョンには、1B、3B、8B、70B、405Bがあり、トレーニングデータは15.0Tトークンを超えています。Visionモデルには、11Bと90Bがあり、60億を超える画像-テキストペアでトレーニングされています。

| Model | Training Data | Params | Tokens | Release Date |

|---|---|---|---|---|

| LLaMA | English CommonCrawl, C4, Github, Wikipedia, Gutenberg and Books3, ArXiv, Stack Exchange | 7B (6.7B) | 1.0T | 2023/02/24 |

| 13B (13.0B) | 1.0T | |||

| 33B (32.5B) | 1.4T | |||

| 65B (65.2B) | 1.4T | |||

| Llama 2 | A new mix of publicly available online data | 7B | 2.0T | 2023/07/18 |

| 13B | 2.0T | |||

| 34B | 2.0T | |||

| 70B | 2.0T | |||

| Llama 3 | A new mix of publicly available online data | 8B | 15.0T | 2024/04/18 |

| 70B | 15.0T | |||

| Llama 3.1 | Collected from publicly available sources, over 5% of the Llama 3 pretraining dataset consists of high-quality non-English data that covers over 30 languages | 8B | 15.0T | 2024/07/23 |

| 70B | 15.0T | |||

| 405B | 15.0T | |||

| Llama 3.2 | Llama 3.2-Text: A new mix of publicly available online data | 1B (1.23B) | 9.0T | 2024/09/25 |

| 3B (3.21B) | 9.0T | |||

| Llama 3.2-Vision | Pretrained on image and text pairs. The instruction tuning data includes publicly available vision instruction datasets, as well as over 3M synthetically generated examples | 11B (10.6B) | 6B (image, text) pairs | |

| 90B (88.8B) | 6B (image, text) pairs |

Code Llama

Code Llamaは、Llama 2をベースにコードデータを使用してトレーニングされており、Base Model、Python Model、Instruct Modelに分類され、パラメータサイズは7B、13B、34B、70Bです。コードの継続、入力、および指示ベースのプログラミングをサポートしています。

| Model | Training Data | Params | Type |

|---|---|---|---|

| Code Llama | Based on Llama 2, trained using a public code dataset of 500B tokens. To help the model retain natural language understanding skills, 8% of the sample data comes from natural language datasets related to code. | 7B | Base Model: a foundational model for code generation tasks |

| Python: a version specialized for Python | |||

| Instruct: a fine-tuned version with human instructions and self-instruct code synthesis data | |||

| 13B | |||

| 34B | |||

| 70B |

Atom

Atomは、AtomEchoとLlama Familyが共同で開発したもので、Llamaアーキテクチャに基づいており、2.7Tの中国語および多言語コーパスでトレーニングされており、パラメータサイズは1B、7B、13Bです。Atomは、Llamaモデルの中国語能力を強化します。

| Model | Training Data | Params | Tokens | Release Date |

|---|---|---|---|---|

| Atom | Chinese and multilingual encyclopedias, books, blogs, news, novels, financial data, legal data, medical data, code, paper, Chinese NLP competition datasets, etc. | 1B | 2.7T | 2023/12/20 |

| 7B | 2.7T | 2023/08/28 | ||

| 13B | 2.7T | 2023/07/31 |

Llama Familyへの貢献方法

- コミュニティに参加する:フォーラム、チャットグループ、イベントを通じて、他の開発者や愛好家と交流します。

- コードを貢献する:バグ修正、新機能、またはモデルの改善を含むプルリクエストを送信します。

- リソースを共有する:データセット、トレーニングスクリプト、および事前トレーニング済みモデルをコミュニティと共有します。

- フィードバックを提供する:既存のモデルとツールに関するフィードバックを提供して、品質と使いやすさの向上に役立てます。

Llama Familyが重要な理由

Llama Familyは、コラボレーションを促進し、オープンソースのAIモデルの開発を加速するため、重要です。開発者と研究者がリソースと知識を共有するためのプラットフォームを提供することで、Llama FamilyはAIテクノロジーへのアクセスを民主化し、イノベーションを促進するのに役立ちます。

結論

Llama Familyは、オープンソースのコラボレーションを通じてAIの進歩に専念する成長中のコミュニティです。今すぐLlama Familyに参加して、AIの未来に貢献しましょう!

"Llama Family" のベストな代替ツール

ChatLLaMA は LLaMA モデルに基づく LoRA 訓練 AI アシスタントで、ローカル GPU でカスタム個人会話が可能。デスクトップ GUI を備え、Anthropic の HH データセットで訓練、7B、13B、30B モデル対応。

xTuring は、オープンソースのライブラリで、ユーザーが大規模言語モデル(LLM)を効率的にカスタマイズおよび微調整できるようにし、シンプルさ、リソース最適化、AI パーソナライゼーションのための柔軟性に焦点を当てています。

Janは、オープンソースのオフライン優先AIクライアントです。プライバシーを保護し、API料金なしで大規模言語モデル(LLM)をローカルで実行します。さまざまなモデルやサービスに接続します。

Nebius AI Studio Inference Service は、ホストされたオープンソースモデルを提供し、独自 API よりも高速で安価で正確な推論結果を実現します。MLOps 不要でシームレスにスケールし、RAG や本番ワークロードに最適です。

Falcon LLM は TII のオープンソース生成大規模言語モデルファミリーで、Falcon 3、Falcon-H1、Falcon Arabic などのモデルを備え、多言語・多モード AI アプリケーションを日常デバイスで効率的に実行します。

Unsloth AI は、gpt-oss や Llama などの LLM にオープンソースの微調整と強化学習を提供し、トレーニングを 30 倍高速化し、メモリ使用量を削減することで、AI トレーニングをアクセスしやすく効率的にします。

LlamaChat は、Mac 上でローカルに LLaMA、Alpaca、GPT4All モデルとチャットできる macOS アプリです。 今すぐダウンロードして、ローカル LLM チャットを体験してください!

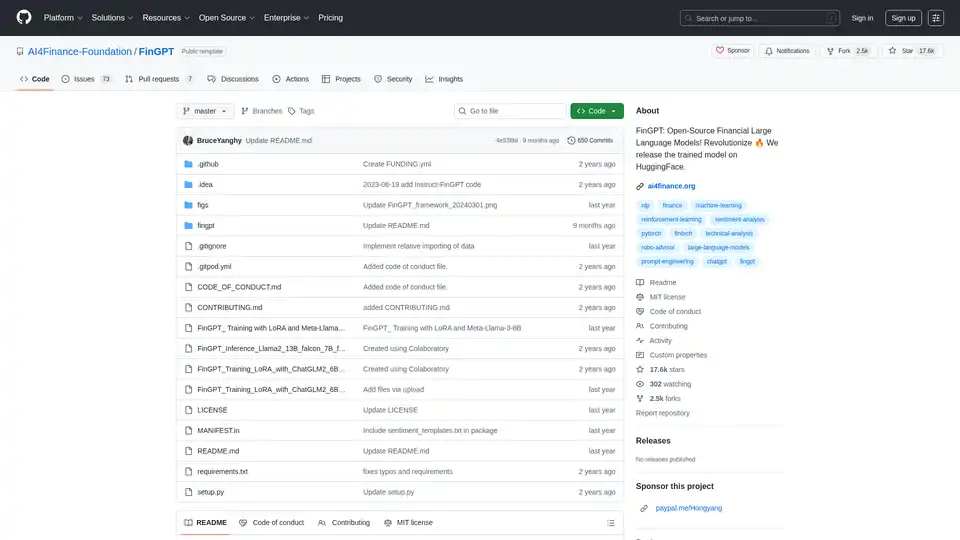

FinGPT:金融データ、センチメント分析、予測を民主化するためのオープンソースの金融大規模言語モデル。 迅速な市場の洞察を得るために迅速に微調整。

Cheshire Cat AI は、AI エージェントの構築を簡素化するオープンソースフレームワークです。LLM、外部 API、およびプラグインをサポートし、これらはすべて、簡単なデプロイメントとカスタマイズのために Docker 化された環境内にあります。

Sagify は、オープンソースの Python ツールで、AWS SageMaker 上の機械学習パイプラインを簡素化し、独自およびオープンソースの大規模言語モデルをシームレスに統合する統一 LLM ゲートウェイを提供します。

LM Studioは、LLaMaやGemmaなどのオープンソース大規模言語モデル(LLM)をローカルPCで実行およびダウンロードするための使いやすいデスクトップアプリケーションです。アプリ内チャットUIとOpenAI互換のローカルサーバーを備え、プログラミングスキルなしでオフラインAIモデルとの対話を可能にします。

llama.cpp を使用して効率的な LLM 推論を有効にします。これは、多様なハードウェア向けに最適化された C/C++ ライブラリで、量子化、CUDA、GGUF モデルをサポートしています。 ローカルおよびクラウド展開に最適です。

Arbiusは、グローバルにGPUを搭載した分散型ネットワークで、生成AIを中心に共有経済を構築します。ユーザーはガバナンスに参加し、ステーキングを通じて料金を獲得し、オープンAIを推進できます。

Replicate を使用すると、クラウド API でオープンソースの機械学習モデルを実行および微調整できます。AI 製品を簡単に構築および拡張できます。