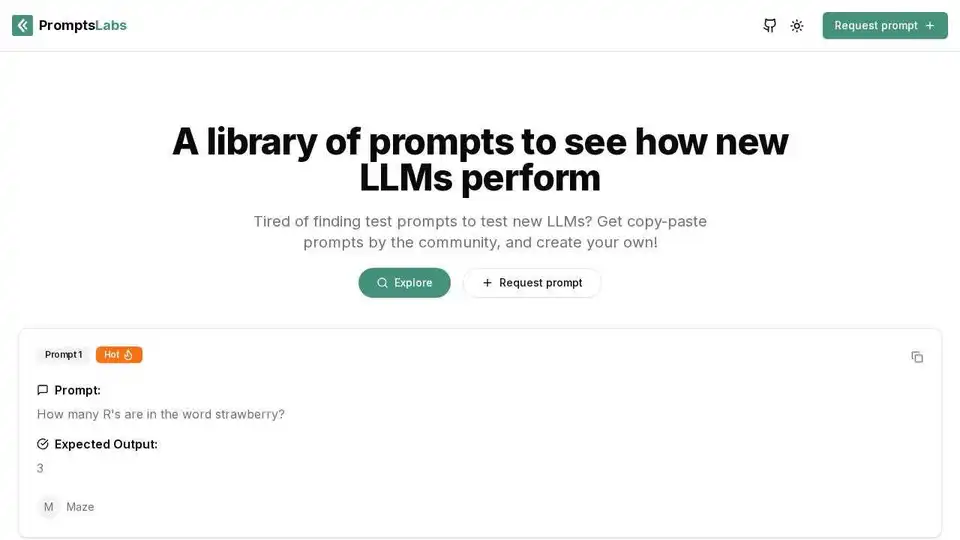

PromptsLabs の概要

PromptsLabs:LLMテストのための包括的なAIプロンプトライブラリ

PromptsLabsとは? PromptsLabsは、ユーザーが新しい大規模言語モデル(LLM)をテストするのに役立つように設計されたAIプロンプトライブラリです。コミュニティから提供されたプロンプトのコレクションを提供し、ユーザーはテスト目的でプロンプトを簡単にコピー&ペーストできます。新しいLLMのテストプロンプトを見つけるのに苦労しているなら、PromptsLabsはテストプロセスを効率化するためにここにあります。

主な機能

- コミュニティ主導のプロンプト: コミュニティによって作成および共有された膨大なプロンプトライブラリ。これにより、多様なテストシナリオとプロンプトスタイルが保証されます。

- 簡単なコピー&ペースト機能: プロンプトは簡単にコピー&ペーストできるため、テストプロセスが迅速かつ効率的になります。

- 独自のプロンプトを投稿する: ユーザーは独自のプロンプトを作成および送信して、ライブラリの成長と多様性に貢献できます。

PromptsLabsの仕組み

PromptsLabsは、LLMのさまざまな側面をテストするように設計されたプロンプトの集中リポジトリを提供することで機能します。各プロンプトには以下が含まれます。

- プロンプト: LLMに与えられる実際のテキストプロンプト。

- 期待される出力: LLMからの望ましいまたは正しい応答。

ユーザーはライブラリを閲覧し、プロンプトを選択して、LLMテスト環境にコピーできます。LLMの実際の出力を期待される出力と比較することにより、ユーザーはLLMのパフォーマンスを評価し、改善の余地がある領域を特定できます。

PromptsLabsの使い方

PromptsLabsの使用は簡単です。

- ライブラリを探索する: 利用可能なプロンプトを閲覧して、関連するテストシナリオを見つけます。

- プロンプトを選択する: テスト目標に合致するプロンプトを選択します。

- プロンプトをコピーする: コピー&ペースト機能を使用して、プロンプトをLLMテスト環境に転送します。

- 出力を評価する: LLMの出力を期待される出力と比較して、パフォーマンスを評価します。

- 貢献する(オプション): 独自のプロンプトをコミュニティと共有して、ライブラリの改善に役立てます。

PromptsLabsは誰のため?

PromptsLabsは以下に最適です。

- AI/MLエンジニア: 新しいLLMを開発およびテストする専門家。

- 研究者: LLMの機能と制限に関する研究を実施する個人。

- プロンプトエンジニア: LLMの効果的なプロンプトの作成に焦点を当てている人。

- 教育者: LLMとプロンプトエンジニアリングについて教えるインストラクター。

PromptsLabsが重要な理由

テストは、LLMの信頼性と有効性を確保するために不可欠です。PromptsLabsは、すぐに利用できるテストプロンプトライブラリを提供することにより、このプロセスを簡素化します。これにより、時間と労力が節約され、ユーザーは結果の分析とモデルの改善に集中できます。

プロンプトの例

PromptsLabsで利用可能なプロンプトの例をいくつか示します。

- プロンプト1: 「strawberryという単語にRは何個ありますか?」

- 期待される出力:「3」

- プロンプト2: 「今日リンゴを3つ持っています。昨日1つ食べました。今日残りいくつありますか?」

- 期待される出力:「今日はリンゴが3つあります。昨日1つ食べても、今日の状況は変わりません。」

- プロンプト3: 「9.9と9.11を比較してください。どちらが一番大きい数字ですか?」

- 期待される出力:「9.9の方が大きいです。なぜなら、小数比較では、左から右に数字を確認するからです。10分の位(最初の小数点)では、9が1より大きいので、9.9 > 9.11です。」

これらのプロンプトを使用することで、LLMの推論、数学、および論理的機能をテストできます。

実用的な価値

- 時間を節約: プロンプトを最初から作成する必要はありません。

- テスト品質の向上: 多様な範囲のプロンプトにアクセスできます。

- コラボレーションの促進: コミュニティの知識に貢献し、恩恵を受けます。

結論

PromptsLabsは、大規模言語モデルを扱うすべての人にとって貴重なリソースです。その包括的なプロンプトライブラリ、使いやすいインターフェース、およびコミュニティ主導のアプローチにより、LLMテストに不可欠なツールとなっています。今すぐPromptsLabsの探索を開始して、LLMの開発と研究の取り組みを強化してください。LLMのパフォーマンスをテストする最良の方法は何ですか? AIプロンプトライブラリPromptsLabsを使用して、精度と有効性を確保してください。

"PromptsLabs" のベストな代替ツール

Prompt Genie は AI 駆動ツールで、ChatGPT や Claude などの LLM 向けに最適化されたスーパープロンプトを即座に作成し、プロンプトエンジニアリングの面倒を排除します。Chrome 拡張経由でテスト、保存、共有して、10 倍良い結果を得られます。

GPT Prompt Lab は、ChatGPT、Gemini などを対象とした無料 AI プロンプト ジェネレーターで、コンテンツ クリエイターが任意のトピックから高品質なプロンプトを作成するのに役立ちます。ブログ、メール、コード、SEO コンテンツのプロンプトを数秒で生成、テスト、最適化します。

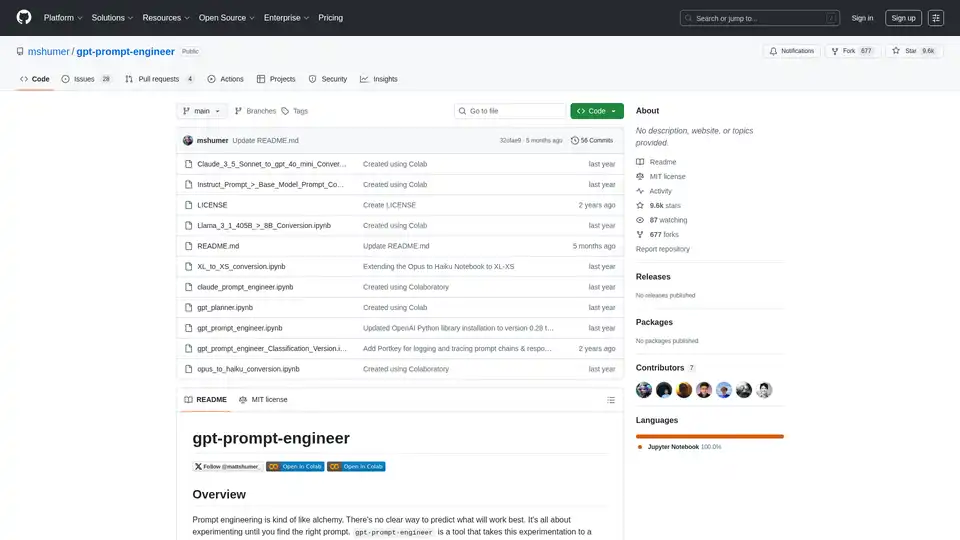

gpt-prompt-engineerは、カスタムテストケースに基づいてプロンプトを生成、テスト、ランク付けすることにより、大規模言語モデル(LLM)に最適なプロンプトを見つけるプロセスを自動化します。GPT-4およびClaude 3を使用してAIプロンプトを最適化します。

PromptLayer は、プロンプト管理、評価、LLM 可観測性のための AI エンジニアリング プラットフォームです。専門家と協力し、AI エージェントを監視し、強力なツールでプロンプトの品質を向上させます。

PromptPointは、自動プロンプトテストにより、プロンプトを迅速に設計、テスト、デプロイするのに役立ちます。 高品質のLLM出力で、チームのプロンプトエンジニアリングを強化します。

Latitudeは、プロンプトエンジニアリングのためのオープンソースプラットフォームであり、ドメインの専門家がエンジニアと協力して、本番環境グレードのLLM機能を提供できるようにします。自信を持ってAI製品を構築、評価、デプロイします。

Lunary は、信頼性の高い AI アプリケーションを構築するための可観測性、プロンプト管理、および分析を提供するオープンソース LLM エンジニアリング プラットフォームです。 デバッグ、パフォーマンスの追跡、およびデータセキュリティの確保のためのツールを提供します。

Bolt Foundryは、AIの動作を予測可能かつテスト可能にするためのコンテキストエンジニアリングツールを提供し、信頼できるLLM製品の構築を支援します。コードをテストするのと同じようにLLMをテストします。

Parea AIは、チームがLLMアプリケーションを自信を持ってリリースするのに役立つAI実験およびアノテーションプラットフォームです。実験の追跡、可観測性、ヒューマンレビュー、プロンプトのデプロイメントなどの機能を提供します。

Athinaは、チームがLLMベースの機能を10倍速く構築、テスト、監視するのを支援するコラボラティブAIプラットフォームです。プロンプト管理、評価、可観測性ツールを備え、データプライバシーを確保し、カスタムモデルをサポートします。

SmartGPTは、ChatGPTや他のモデル向けに基本的なプロンプトを瞬時にエキスパートレベルのものに変換するAIツールです。自動化されたプロンプトエンジニアリング、アーカイブ機能、高度なAI統合でマーケティング、ライティングなどの生産性を向上させます。

Infrabase.aiは、AIインフラストラクチャツールとサービスを発見するためのディレクトリです。ベクトルデータベース、プロンプトエンジニアリングツール、推論APIなどを見つけて、ワールドクラスのAI製品を構築してください。

Entry Point AI で、カスタム大規模言語モデル (LLM) を迅速かつ効率的にトレーニング、管理、評価できます。コードは不要です。