Que Problemas Chave o MCP Server Resolve? Por Que os Agentes de IA Precisam Dele

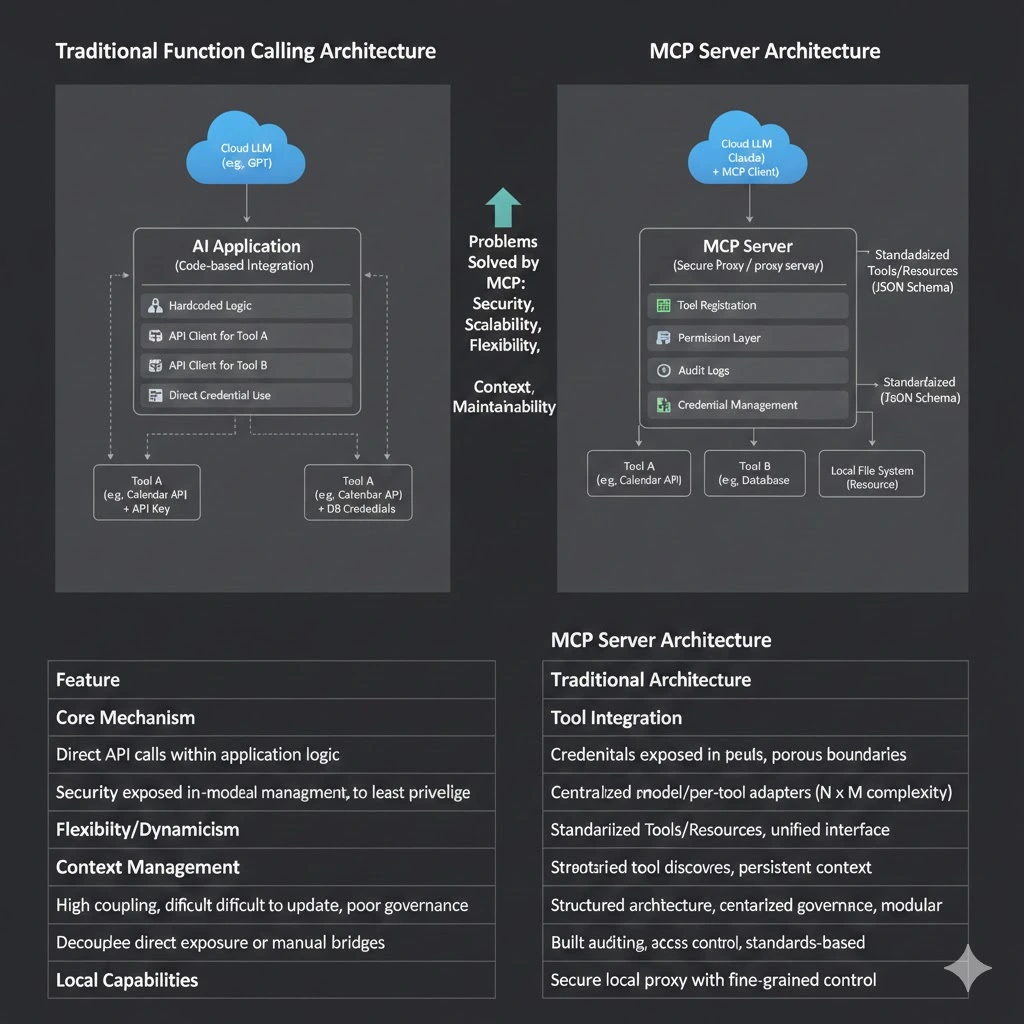

Nos primórdios das aplicações de IA, chamar APIs via "Function Calling" era suficiente para necessidades simples de automação. No entanto, à medida que a IA evolui de uma "ferramenta de conversação" para um Agente com capacidades autônomas de planejamento e execução, começamos a encontrar uma série de desafios de engenharia sistêmica: dificuldade em unificar e conectar ferramentas com segurança, e arquiteturas que lutam para evoluir de forma flexível junto às iterações do modelo.

A raiz desses problemas reside na falta de uma camada de capacidade padronizada projetada especificamente para padrões de interação de IA. O Model Context Protocol (MCP) e sua implementação central, o MCP Server, surgiram nesse contexto. Ele define uma forma padronizada de conectar modelos com fontes de dados externas, ferramentas e serviços, suportando assim sistemas de Agentes de IA escaláveis.

Este artigo interpreta o valor central trazido pelo surgimento dos MCP Servers e os problemas chave que eles resolvem.

Público-alvo:

- Entusiastas de tecnologia e aprendizes iniciantes

- Profissionais e gerentes em busca de melhorias de eficiência

- Tomadores de decisão empresariais e chefes de departamentos de negócios

- Usuários gerais interessados nas tendências futuras da IA

Sumário:

- 1. Quando LLMs Precisam de "Capacidades de Ação": Como Acessar o Mundo Real com Segurança?

- 2. Quando as Tarefas Se Tornam Abertas: Por Que Fluxos de Trabalho Fixos Falham?

- 3. Quando os Modelos Continuam Mudando: Como Evitar o Acoplamento Ferramenta-Modelo?

- 4. Quando as Tarefas Ficam Longas: Por Que o Contexto se Torna Fragmentado?

- 5. Quando as Capacidades São Locais: Como Conectar com Segurança a Modelos na Nuvem?

- 6. Quando a Escala de Agentes Aumenta: Como Manter o Sistema?

- 7. Quando a IA Entra na Empresa: Como Reutilizar Sistemas Internos com Segurança?

- O MCP Server Não É Apenas Um Protocolo, Mas Uma Infraestrutura Chave para a Era do Agente de IA

1. Quando LLMs Precisam de "Capacidades de Ação": Como Acessar o Mundo Real com Segurança?

Contexto

Large Language Models (LLMs) são projetados principalmente para raciocínio e geração baseados em texto, mas não possuem inerentemente a capacidade de acessar diretamente sistemas externos ou executar ações. Para conectar um LLM ao mundo externo, é preciso fornecer acesso a APIs, bancos de dados ou sistemas de arquivos. Isso imediatamente introduz barreiras de segurança e adaptação; sem uma camada de execução unificada e segura, adaptar cada ferramenta individualmente é tedioso e inseguro.

Sem o MCP Server

Os desenvolvedores precisam escrever código de integração específico para cada ferramenta e expor credenciais sensíveis (como chaves de API) ou sistemas internos diretamente à aplicação de IA. Isso resulta em limites de segurança nebulosos e altos riscos. Resumo:

- LLMs podem apenas "gerar texto" e não podem desencadear ações físicas.

- Cada sistema externo deve ter código de adaptação único escrito para cada tipo de modelo.

- Chaves de API ou credenciais internas devem ser expostas ao chamador, criando riscos de segurança.

A Solução do MCP Server

Um dos papéis centrais de um MCP Server é atuar como um proxy de segurança. Ele é executado em um ambiente confiável e é responsável por manter e gerenciar todas as credenciais sensíveis. De acordo com as definições oficiais do MCP, o Server expõe Ferramentas padronizadas, que descrevem suas funções e parâmetros necessários via um JSON Schema claro. A aplicação de IA (MCP Client) recupera as descrições das ferramentas através de tools/list, e o modelo decide quando chamar uma ferramenta com base nessas descrições. A execução específica — incluindo validação de permissões e registro de auditoria — é totalmente controlada pelo MCP Server. Este design garante a implementação do Princípio do Menor Privilégio.

Um MCP Server é um programa do lado do servidor que segue o protocolo MCP. Ele pode encapsular capacidades externas em interfaces de ferramentas (Tools) ou interfaces de recursos (Resources) de forma padronizada e controlar o acesso através de mecanismos de segurança.

- Encapsula várias capacidades do mundo real (bancos de dados, APIs, sistemas de arquivos) em ferramentas padronizadas.

- Os modelos só precisam entender a descrição da capacidade da ferramenta e a estrutura de parâmetros.

- A verificação real de permissões, execução e limites de segurança são tratados pelo MCP Server.

Os LLMs são assim capazes de interagir com segurança com o mundo real, evoluindo de "apenas conversar" para Agentes de IA executores de tarefas sem o risco de expor diretamente os sistemas centrais. É importante notar que, embora o protocolo MCP defina o padrão para expor e chamar capacidades, o controle de segurança e os modelos de permissão são tratados por implementações específicas do MCP Server.

2. Quando as Tarefas Se Tornam Abertas: Por Que Fluxos de Trabalho Fixos Falham?

Contexto

O valor de um Agente de IA reside no tratamento de tarefas complexas de domínio aberto e multi-etapas, onde o caminho de execução é frequentemente dinâmico e não determinístico. Os modelos tradicionais de integração de API dependem de desenvolvedores que pré-escrevem uma lógica de chamada fixa, o que não consegue se adaptar a essa flexibilidade.

Limitações de API / Function Calling Tradicionais

Toda vez que um fluxo de trabalho de tarefa muda ou uma ferramenta é adicionada, o código da aplicação deve ser modificado e reimplantado. Isso cria um sistema rígido que tem dificuldade em se adaptar a necessidades que mudam rapidamente. Problemas chave incluem:

- A lógica de chamada é codificada na aplicação.

- Adicionar ferramentas ou mudar processos requer modificação e reimplantamento de código.

- Inadequado para tarefas de tomada de decisão dinâmicas e de domínio aberto.

A Solução do MCP Server

O protocolo MCP suporta descoberta dinâmica de ferramentas. Um MCP Client (integrado à aplicação de IA) pode descobrir automaticamente quais ferramentas um Server conectado fornece ao iniciar. Isso significa que o conjunto de ferramentas pode ser atualizado e expandido independentemente da aplicação de IA. Agentes podem raciocinar e planejar autonomamente quais ferramentas chamar e em que ordem, com base nas capacidades descobertas em tempo real. Isso marca uma mudança fundamental de "fluxos de trabalho definidos por humanos" para "planejamento dinâmico orientado por modelo".

O protocolo MCP define Schemas padrão para ferramentas e recursos, permitindo que sejam "dinamicamente descobertos e chamados".

- As ferramentas expõem sua funcionalidade através de Schemas padronizados.

- As decisões de chamada e as sequências de execução são determinadas pelo raciocínio do modelo, e não por codificação.

- O MCP fornece a exposição de capacidade necessária e a base de contexto para o planejamento autônomo do Agente.

A Mudança Essencial

O núcleo de inteligência do sistema muda de lógica de código fixo para raciocínio em tempo real realizado pelo modelo com base em sua compreensão das capacidades da ferramenta. Ele se move de "processos definidos por humanos" para "processos planejados por modelo baseados em semântica".

3. Quando os Modelos Continuam Mudando: Como Evitar o Acoplamento Ferramenta-Modelo?

Contexto

Os modelos no campo da IA iteram rapidamente. Uma organização pode usar simultaneamente modelos da OpenAI, Anthropic, Google ou outros provedores de código aberto. Se o código de integração de ferramentas estiver profundamente ligado ao SDK ou método de chamada de um modelo específico, mudar ou adicionar modelos incorrerá em custos massivos de desenvolvimento e manutenção redundantes.

Sem o MCP Server

Cada modelo requer uma camada de adaptação de ferramentas independente, criando uma complexidade de integração de N modelos x M ferramentas (N x M). Os custos de manutenção aumentam exponencialmente.

- Cada modelo tem seu próprio conjunto de definições de ferramentas.

- Os desenvolvedores devem escrever lógica de compatibilidade para diferentes modelos separadamente.

- Os custos de manutenção do sistema aumentam significativamente.

A Solução do MCP Server

Como um protocolo aberto, o MCP atua como uma linguagem intermediária universal. Qualquer aplicação de IA que implemente um MCP Client (como Claude Desktop, Cursor IDE, etc.) pode se comunicar com qualquer Server que siga o protocolo MCP. Os desenvolvedores de ferramentas só precisam implementar um MCP Server uma vez de acordo com o padrão para tornar suas capacidades disponíveis para múltiplas aplicações de IA com diferentes backends. Isso desacopla completamente as ferramentas de modelos de IA específicos; um único MCP Server pode ser usado por vários LLMs diferentes simultaneamente.

O surgimento do MCP Server liberta os desenvolvedores do trabalho repetitivo de "escrever adaptadores" para modelos específicos, permitindo-lhes construir uma infraestrutura de capacidade de IA sustentável, reutilizável e agnóstica a modelos.

4. Quando as Tarefas Ficam Longas: Por Que o Contexto se Torna Fragmentado?

Contexto

Em tarefas complexas de Agentes de várias etapas, a informação está espalhada entre diferentes resultados de ferramentas, conteúdos de arquivos lidos e histórico de conversas. Em métodos tradicionais, organizar essa informação não estruturada de forma eficaz e fornecê-la continuamente ao modelo é um grande desafio, muitas vezes levando o modelo a "esquecer" informações chave ou a tomar decisões contraditórias.

Problemas Comuns

- Resultados de chamadas de ferramentas são difíceis de reutilizar.

- O estado é inconsistente em tarefas de várias etapas.

- Os modelos carecem de uma consciência contextual holística.

A Solução do MCP Server

O protocolo MCP define Recursos como uma primitiva central. Recursos são fontes de dados estruturadas e somente leitura (como arquivos, documentação de API ou esquemas de banco de dados). Um MCP Server pode expor Recursos, e um MCP Client pode lê-los conforme necessário (resources/read) para fornecer seu conteúdo ao modelo como contexto. Isso fornece ao Agente conhecimento externo contínuo e estruturado, aliviando eficazmente o problema da fragmentação do contexto.

MCP Servers permitem que os Agentes mantenham um contexto contínuo e estruturado ao longo de tarefas multi-etapas, em vez de "lembrar temporariamente informações".

5. Quando as Capacidades São Locais: Como Conectar com Segurança a Modelos na Nuvem?

Muitas capacidades empresariais centrais (como acesso a sistemas de arquivos locais, repositórios Git ou cadeias de ferramentas de desenvolvimento internas) residem na máquina local de um usuário ou dentro de uma intranet corporativa. Os usuários podem querer usar poderosos LLMs baseados em nuvem para impulsionar essas capacidades, mas conceder permissões locais diretamente a modelos na nuvem é altamente inseguro.

Sem o MCP Server

- Sistemas de arquivos e sistemas de controle de versão não podem ser acessados com segurança.

- Permissões excessivamente altas devem ser concedidas para permitir chamadas.

- Alto risco de vazamento ou abuso de credenciais.

A Solução do MCP Server

Um MCP Server pode ser executado como um processo leve em um ambiente local e expor apenas as capacidades autorizadas; assim, o modelo pode acessar com segurança os recursos necessários sem ultrapassar limites. Por exemplo, no Claude Desktop, os usuários podem configurar sistemas de arquivos locais ou MCP Servers Git. Esses Servers expõem apenas operações estritamente definidas e inofensivas (como ler arquivos em um diretório específico ou buscar um log do git) para o Claude baseado em nuvem. Todas as solicitações passam por um canal local seguro, e as instruções do modelo da nuvem são validadas e executadas pelo Server local. O escopo da exposição da capacidade é precisamente controlado. Esta é precisamente a razão pela qual a arquitetura MCP pode equilibrar funcionalidade poderosa com segurança em cenários de assistente de codificação inteligente IDE.

Este design é a razão central para a rápida adoção do MCP em IDEs e cenários de desenvolvimento local.

6. Quando a Escala de Agentes Aumenta: Como Manter o Sistema?

Em sistemas de grande escala, um Agente pode precisar acessar dezenas de ferramentas. Políticas de permissão complexas e lógica de chamada dispersa dificultam a manutenção.

Pontos de Dor da Arquitetura Tradicional

- As ferramentas estão espalhadas por toda parte, sem governança unificada.

- A lógica do Agente se torna muito complexa para manter.

- As permissões e auditorias são fragmentadas.

A Solução do MCP Server

O MCP fornece uma camada de gerenciamento centralizada para ferramentas e acesso a dados:

- Registro e gerenciamento centralizados de ferramentas.

- Os Agentes só se preocupam com suas capacidades disponíveis.

- O MCP Server se torna a "camada de abstração de capacidade" para o Agente.

Esta governança em camadas é ideal para atualizar arquiteturas de sistemas de nível empresarial.

7. Quando a IA Entra na Empresa: Como Reutilizar Sistemas Internos com Segurança?

As empresas desejam alavancar a IA para melhorar a eficiência operacional, mas os sistemas internos (como CRM, ERP e bancos de dados) geralmente têm interfaces não padronizadas, modelos de permissão complexos e requisitos rigorosos de conformidade e auditoria. Expor diretamente esses sistemas a um modelo é inseguro.

A Solução do MCP Server

Na arquitetura empresarial, o MCP Server pode atuar como um "Gateway de Capacidade" específico para IA. Cada sistema interno chave (como Salesforce, Jira ou bancos de dados internos) pode ser encapsulado por um MCP Server dedicado. Este Server é responsável por:

- Adaptação e Abstração: Converter APIs internas complexas em Ferramentas MCP padronizadas, ocultando a complexidade das APIs internas.

- Centralização de Permissões: Integrar autenticação de identidade empresarial (como SSO) e implementar controle de acesso no nível da ferramenta.

- Registro de Auditoria: Registrar centralmente logs detalhados de todas as operações iniciadas por IA para atender aos requisitos de conformidade.

Dessa forma, um MCP Server pode ser visto como o "firewall e adaptador" da camada de capacidade de IA dentro de uma arquitetura empresarial. Ele fornece um método de acesso consistente e seguro para diferentes Agentes e modelos, permitindo que a IA capacite os negócios sob condições seguras e controláveis.

O MCP Server Não É Apenas Um Protocolo, Mas Uma Infraestrutura Chave para a Era do Agente de IA

Em resumo, o MCP Server não resolve um único ponto técnico; em vez disso, ele aborda uma série de desafios estruturais enfrentados pelos Agentes de IA à medida que avançam para aplicações em grande escala e engenharia:

- Desafios de Segurança: Implementar acesso de menor privilégio via um modelo de proxy.

- Desafios de Integração: Desacoplar ferramentas e modelos através de um protocolo padronizado para reduzir a complexidade de integração

N x M. - Desafios de Flexibilidade: Suportar o planejamento autônomo do Agente através da descoberta dinâmica para se adaptar a tarefas de domínio aberto.

- Desafios de Contexto: Fornecer memória externa estruturada através de primitivas como Recursos.

- Desafios Empresariais: Satisfazer os requisitos de permissão, auditoria e conformidade via um modelo de gateway.

MCP (Model Context Protocol) não apenas define uma forma padronizada para os modelos se comunicarem com sistemas externos, mas também fornece a infraestrutura para construir plataformas de Agentes de IA escaláveis e seguras.

Ele resolve uma classe inteira de problemas sistêmicos que vão desde "exposição de capacidade" e "governança de ferramentas" até "desacoplamento de modelos", "gerenciamento de contexto" e "acesso seguro", tornando o desenvolvimento de Agentes de IA em cenários de múltiplos modelos, múltiplas ferramentas e tarefas complexas sustentável, manutenível e seguro.

Como a Anthropic declarou ao anunciar a doação do MCP para a Linux Foundation para estabelecer a Agentic AI Foundation, esta ação visa promover o desenvolvimento aberto de padrões de interoperabilidade de Agentes de IA. O MCP Server é um componente chave desta visão, fornecendo uma camada de infraestrutura sólida e confiável para um futuro onde diferentes IAs e ferramentas colaboram de forma segura e eficiente. À medida que a IA passa de demos para produção e de aplicações de ponto único para sistemas complexos, o MCP Server oferece uma resposta de engenharia bem pensada e escalável.

Série de artigos MCP:

- Análise Abrangente do Servidor MCP: O Hub de Comunicação de Contexto e Ferramentas na Era dos Agentes de IA

- Que Problemas Chave o MCP Server Resolve? Por Que os Agentes de IA Precisam Dele

- Arquitetura e Princípios de Funcionamento do Servidor MCP: Do Protocolo ao Fluxo de Execução

- Guia Prático do Servidor MCP: Construção, Teste e Implantação do Zero ao Um

- Avaliação de Cenários de Aplicação e Guia de Seleção Técnica do Servidor MCP

Sobre o Autor

Este conteúdo é compilado e publicado pela Equipe Editorial de Conteúdo NavGood. NavGood é uma plataforma focada em ferramentas de IA e no ecossistema de aplicações de IA, fornecendo rastreamento de longo prazo de Agentes de IA, fluxos de trabalho automatizados e o desenvolvimento e implementação prática da tecnologia de IA Generativa.

Isenção de Responsabilidade: Este artigo representa o entendimento pessoal e a experiência prática do autor. Não representa a posição oficial de qualquer framework, organização ou empresa, nem constitui aconselhamento comercial, financeiro ou de investimento. Todas as informações são baseadas em fontes públicas e pesquisa independente do autor.

References:

[1]: https://modelcontextprotocol.io/docs/learn/server-concepts "Understanding MCP servers - Model Context Protocol"

[2]: https://modelcontextprotocol.io/docs/learn/architecture "Architecture overview - Model Context Protocol"

[3]: https://cloud.google.com/blog/products/ai-machine-learning/announcing-official-mcp-support-for-google-services "Announcing Model Context Protocol (MCP) support for Google services"

[4]: https://developer.pingidentity.com/identity-for-ai/agents/idai-what-is-mcp.html "What is Model Context Protocol (MCP)?"