Llama Family

Visão geral de Llama Family

Família Llama: O Ecossistema de Modelos de IA de Código Aberto

O que é a Família Llama? A Família Llama é uma comunidade de código aberto dedicada a promover o desenvolvimento da Inteligência Artificial Geral (IAG) através de esforços colaborativos centrados nos modelos Llama e tecnologias relacionadas. Visa criar uma plataforma onde desenvolvedores e entusiastas possam contribuir para um ecossistema de código aberto que abrange vários aspetos da IA, desde modelos de grande escala a modelos menores, de texto a capacidades multimodais e de software a otimizações de algoritmos de hardware.

Componentes-Chave da Família Llama

Modelos: A comunidade concentra-se em vários modelos Llama de código aberto pela Meta, incluindo Llama, Llama 2, Llama 3, Code Llama e Atom. Estes modelos cobrem uma variedade de tamanhos de parâmetros e conjuntos de dados de treino, atendendo a diferentes casos de uso e direções de pesquisa.

Computação: A comunidade incentiva a colaboração e a partilha de recursos para treino e experimentação de modelos. Isto inclui a utilização de recursos de GPU como a série GeForce RTX, NVIDIA H100 e A100 Tensor Core GPUs.

Comunidade: Central para a Família Llama é a sua vibrante comunidade de desenvolvedores, investigadores e entusiastas. A comunidade fomenta a colaboração, a partilha de conhecimento e a co-criação de recursos e ferramentas.

Modelos Llama

Meta Llama

O modelo Llama de código aberto pela Meta é amplamente utilizado tanto na indústria como na academia. As versões incluem 1B, 3B, 8B, 70B e 405B, com dados de treino que excedem os 15.0T tokens. Os modelos de visão incluem 11B e 90B, treinados em mais de 6 mil milhões de pares imagem-texto.

| Model | Training Data | Params | Tokens | Release Date |

|---|---|---|---|---|

| LLaMA | English CommonCrawl, C4, Github, Wikipedia, Gutenberg and Books3, ArXiv, Stack Exchange | 7B (6.7B) | 1.0T | 2023/02/24 |

| 13B (13.0B) | 1.0T | |||

| 33B (32.5B) | 1.4T | |||

| 65B (65.2B) | 1.4T | |||

| Llama 2 | A new mix of publicly available online data | 7B | 2.0T | 2023/07/18 |

| 13B | 2.0T | |||

| 34B | 2.0T | |||

| 70B | 2.0T | |||

| Llama 3 | A new mix of publicly available online data | 8B | 15.0T | 2024/04/18 |

| 70B | 15.0T | |||

| Llama 3.1 | Collected from publicly available sources, over 5% of the Llama 3 pretraining dataset consists of high-quality non-English data that covers over 30 languages | 8B | 15.0T | 2024/07/23 |

| 70B | 15.0T | |||

| 405B | 15.0T | |||

| Llama 3.2 | Llama 3.2-Text: A new mix of publicly available online data | 1B (1.23B) | 9.0T | 2024/09/25 |

| 3B (3.21B) | 9.0T | |||

| Llama 3.2-Vision | Pretrained on image and text pairs. The instruction tuning data includes publicly available vision instruction datasets, as well as over 3M synthetically generated examples | 11B (10.6B) | 6B (image, text) pairs | |

| 90B (88.8B) | 6B (image, text) pairs |

Code Llama

Code Llama é treinado em cima do Llama 2 usando dados de código e é categorizado em Modelo Base, Modelo Python e Modelo Instruct, com tamanhos de parâmetros de 7B, 13B, 34B e 70B. Suporta continuação, preenchimento e programação baseada em instruções de código.

| Model | Training Data | Params | Type |

|---|---|---|---|

| Code Llama | Based on Llama 2, trained using a public code dataset of 500B tokens. To help the model retain natural language understanding skills, 8% of the sample data comes from natural language datasets related to code. | 7B | Base Model: a foundational model for code generation tasks |

| Python: a version specialized for Python | |||

| Instruct: a fine-tuned version with human instructions and self-instruct code synthesis data | |||

| 13B | |||

| 34B | |||

| 70B |

Atom

Atom, desenvolvido em conjunto pela AtomEcho e Família Llama, é baseado na arquitetura Llama e treinado em 2.7T de corpus chineses e multilingues, com tamanhos de parâmetros incluindo 1B, 7B e 13B. Atom melhora as capacidades de língua chinesa do modelo Llama.

| Model | Training Data | Params | Tokens | Release Date |

|---|---|---|---|---|

| Atom | Chinese and multilingual encyclopedias, books, blogs, news, novels, financial data, legal data, medical data, code, paper, Chinese NLP competition datasets, etc. | 1B | 2.7T | 2023/12/20 |

| 7B | 2.7T | 2023/08/28 | ||

| 13B | 2.7T | 2023/07/31 |

Como Contribuir para a Família Llama

- Junte-se à Comunidade: Interaja com outros desenvolvedores e entusiastas através de fóruns, grupos de chat e eventos.

- Contribua com Código: Submeta pedidos de pull com correções de bugs, novas funcionalidades ou melhorias de modelo.

- Partilhe Recursos: Partilhe conjuntos de dados, scripts de treino e modelos pré-treinados com a comunidade.

- Forneça Feedback: Ofereça feedback sobre os modelos e ferramentas existentes para ajudar a melhorar a sua qualidade e usabilidade.

Por que é que a Família Llama é importante?

A Família Llama é importante porque fomenta a colaboração e acelera o desenvolvimento de modelos de IA de código aberto. Ao fornecer uma plataforma para desenvolvedores e investigadores partilharem recursos e conhecimento, a Família Llama ajuda a democratizar o acesso à tecnologia de IA e a promover a inovação.

Conclusão

A Família Llama é uma comunidade crescente dedicada a promover a IA através da colaboração de código aberto. Junte-se à Família Llama hoje para contribuir para o futuro da IA!

Melhores ferramentas alternativas para "Llama Family"

ChatLLaMA é um assistente de IA treinado com LoRA baseado em modelos LLaMA, permitindo conversas personalizadas no seu GPU local. Inclui GUI de desktop, treinado no dataset HH da Anthropic, disponível para modelos 7B, 13B e 30B.

LM Studio é um aplicativo de desktop fácil de usar para executar e baixar modelos de linguagem grandes (LLMs) de código aberto como LLaMa e Gemma localmente no seu computador. Ele apresenta uma UI de chat no aplicativo e um servidor compatível com OpenAI para interação offline, tornando a IA acessível sem habilidades de programação.

Jan é um cliente de IA de código aberto e com prioridade offline. Execute modelos de linguagem grandes (LLM) localmente com privacidade e sem cobranças de API. Conecte-se a vários modelos e serviços.

Replicate permite que você execute e ajuste modelos de aprendizado de máquina de código aberto com uma API na nuvem. Construa e dimensione produtos de IA com facilidade.

Sesame AI tem como objetivo alcançar a 'presença de voz' na IA, fazendo com que as interações faladas pareçam reais e compreensíveis. Explore seu modelo de fala conversacional (CSM) para um diálogo natural.

FinGPT: Um grande modelo de linguagem financeira de código aberto para democratizar dados financeiros, análise de sentimento e previsão. Ajuste fino rapidamente para obter insights de mercado oportunos.

Falcon LLM é uma família de modelos de linguagem grandes generativos de código aberto da TII, com modelos como Falcon 3, Falcon-H1 e Falcon Arabic para aplicações de IA multilíngues e multimodais que rodam eficientemente em dispositivos do dia a dia.

TextGen é um plugin de IA de código aberto para Obsidian, aprimorando a tomada de notas com modelos baseados em IA e geração de conteúdo inteligente.

ProxyAI é um assistente de código com tecnologia de IA para IDEs JetBrains, oferecendo preenchimento de código, edição em linguagem natural e suporte offline com LLMs locais. Melhore sua codificação com IA.

Cheshire Cat AI é um framework de código aberto que simplifica a construção de agentes de IA. Ele suporta LLMs, APIs externas e plugins, tudo dentro de um ambiente Dockerizado para fácil implantação e personalização.

Explore o repositório Awesome ChatGPT Prompts, uma coleção curada de prompts para otimizar ChatGPT e outros LLMs como Claude e Gemini em tarefas de escrita a codificação. Melhore interações com IA usando exemplos comprovados.

Chat online gratuito Llama 4 Maverick, com tecnologia Meta AI. Explore a educação em IA e baixe códigos de modelos grandes. Não requer inscrição.

OpenUI é uma ferramenta de código aberto que permite descrever componentes de UI em linguagem natural e renderizá-los ao vivo usando LLMs. Converta descrições em HTML, React ou Svelte para prototipagem rápida.

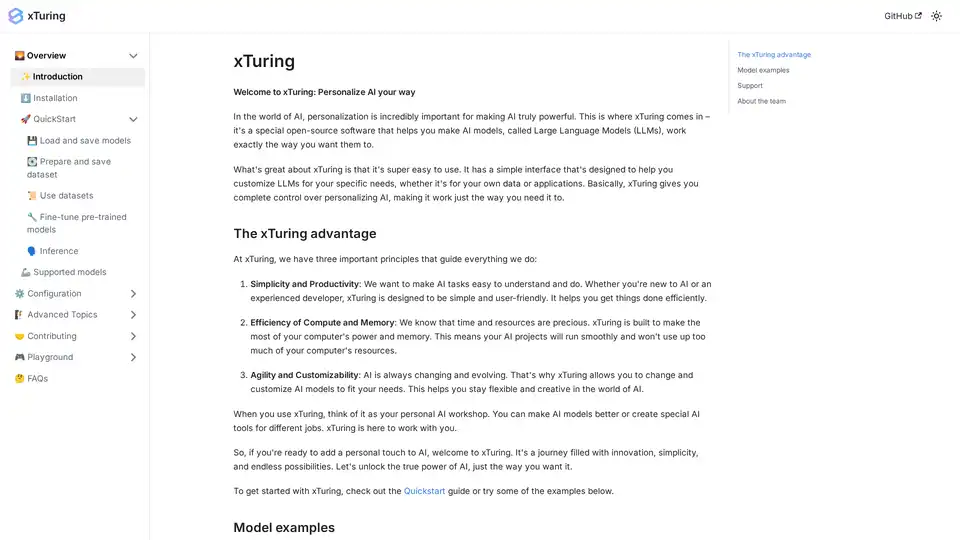

xTuring é uma biblioteca open-source que capacita os usuários a personalizar e fazer fine-tuning de Modelos de Linguagem Grandes (LLMs) de forma eficiente, focando em simplicidade, otimização de recursos e flexibilidade para personalização de IA.