Ducky 概述

Ducky: 全托管的 AI 搜索基础设施,支持 RAG

Ducky 是一个全托管的 AI 检索和 RAG(检索增强生成)基础设施,专为需要极速且准确搜索结果的开发者设计。它简化了向产品添加 AI 驱动的搜索功能的过程,使开发者能够专注于构建功能,而不是管理复杂的基础设施。

主要特性和优势:

- 快速部署: 在几分钟内部署 AI 搜索,跳过数月的 инфраструктура 构建和配置。

- 一体化平台: 统一的平台处理整个 AI 搜索管道,为所有需求提供单一界面。

- 简化的 API: 复杂的 AI 搜索功能被打包成简单、直观的 API。

- 多模态智能: 无缝搜索各种内容格式,如文本、图像和 PDF。

- 自动分块和排序: 自动拆分和优化文档以进行检索,并通过多阶段重新排序来确保首先显示最佳结果。

- 高级元数据支持: 通过基于日期、类别、标签或任何其他相关属性的过滤器来支持精确搜索。

- 零设置要求: 完全托管的服务,可以立即使用,无需任何配置。

- 开发者优先的体验: 直观的 API、全面的文档以及对 Python 和 TypeScript SDK 的支持。

- 即时结果: 智能默认设置从第一天开始就提供准确的结果,无需调整或优化。

- 自我改进的准确性: Ducky 从搜索模式中学习,自动提高结果排名和相关性。

- LLM 兼容性: 与当今的 LLM 和未来的 AI 模型无缝协作。

- 降低成本: 通过上下文过滤将令牌使用量减少高达 80%,从而降低 API 费用。

- 减少幻觉: 通过仅向 агенты 提供准确和相关的上下文,Ducky 消除了 AI 错误的根本原因。

Ducky 的工作原理:

Ducky 通过处理从索引到检索的整个管道来简化 AI 驱动的搜索。它自动化文档分块和排序,支持多模态智能,并提供高级元数据过滤。该平台的自我改进准确性确保搜索结果随着时间的推移变得更加相关,而无需手动调整。

什么是 Ducky? Ducky 是一个全托管的 AI 搜索基础设施,旨在简化向应用程序添加 AI 驱动的搜索的过程。

Ducky 如何工作? Ducky 通过提供一个全面的平台来工作,该平台处理 AI 搜索的各个方面,包括索引、检索和排序。它利用先进的技术,如自动分块、多模态智能和元数据支持,以提供准确和相关的结果。

如何使用 Ducky? 要使用 Ducky,开发者可以利用该平台直观的 API 和 Python 和 TypeScript 的 SDK。该服务需要零设置,允许开发者专注于构建他们的应用程序,而不是管理基础设施。

为什么要选择 Ducky? 选择 Ducky 是因为它具有快速部署、一体化平台、简化的 API 和自我改进的准确性。它消除了 AI 搜索的复杂性,并允许开发者快速有效地发布 AI 驱动的功能。

Ducky 适用于谁? Ducky 非常适合希望向其产品添加 AI 驱动的搜索,而无需管理复杂基础设施的负担的开发者、产品团队和组织。它适用于广泛的应用,包括电子商务、内容管理和知识库。

实施 AI 驱动搜索的最佳方式是什么? 实施 AI 驱动搜索的最佳方式是使用像 Ducky 这样的全托管平台,它可以处理所有的复杂性,并允许您专注于构建您的应用程序。Ducky 提供快速部署、多模态智能和自我改进的准确性,使其成为实施 AI 驱动搜索的绝佳选择。

使用案例:

- AI Agents: Агенты 提出问题并收到包含来源归属的完整答案,从而自动执行从搜索到综合的整个管道。

- 语义搜索: 在数小时内实施低延迟语义搜索管道。

Ducky 适用于谁?

Ducky 专为现代 AI 开发而构建,使团队能够快速发布功能,而无需构建和配置基础设施的复杂性。它专为希望快速有效地向其产品添加 AI 搜索功能的开发者设计。

定价:

Ducky 提供简单的定价计划,包括具有有限索引和检索令牌的免费试用版。如果您需要更多资源,可以使用付费计划,额外的令牌按每 1k 定价。

客户评价:

- “Ducky 使 Vendori 的 AI 功能的报价和交易数据索引变得毫不费力。它提供了完美的检索。”

- “Ducky 已经改变了游戏规则。在几个小时内,我们就拥有了一个功能齐全、低延迟的语义搜索管道。”

"Ducky"的最佳替代工具

探索 NVIDIA NIM API,优化领先 AI 模型的推理和部署。使用无服务器 API 构建企业级生成式 AI 应用,或在您的 GPU 基础设施上进行自托管。

ThirdAI 是一个在 CPU 上运行的 GenAI 平台,提供具有增强的安全性、可扩展性和性能的企业级 AI 解决方案。它简化了 AI 应用程序的开发,减少了对专用硬件和技能的需求。

Weaviate 是一个 AI 原生向量数据库,简化了 AI 驱动的应用程序的构建。它提供语义搜索、RAG 和 AI 代理等功能。受到 AI 创新者的信赖,可扩展到数十亿个向量。

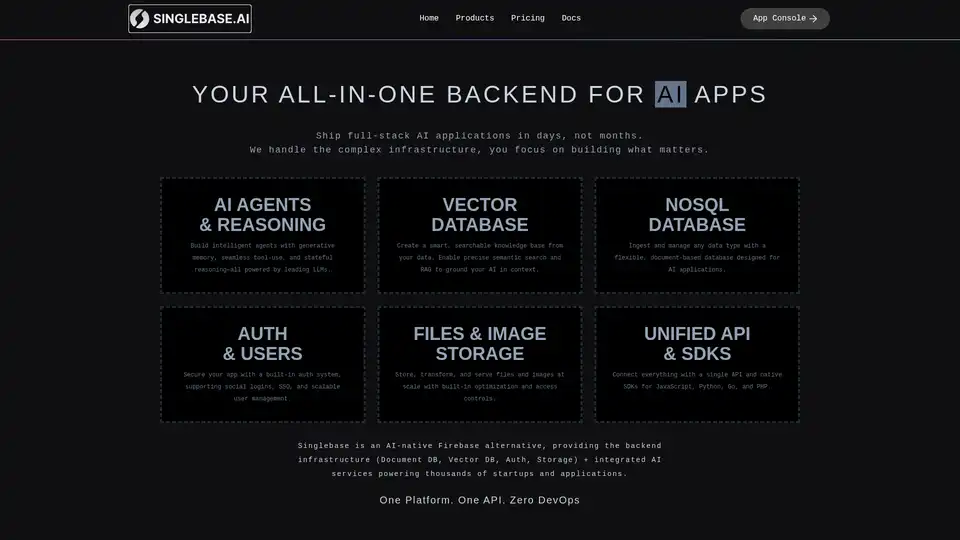

Singlebase 是一个 AI 原生的 Firebase 替代品,为 AI 应用程序提供统一的后端。它在一个平台上提供向量数据库、NoSQL 数据库、身份验证、存储和集成的 AI 服务。

Sagify 是一个开源 Python 工具,可简化 AWS SageMaker 上的机器学习管道,提供统一的 LLM 网关,实现专有和开源大型语言模型的无缝集成,提高生产力。

AskJack将您公司的知识整合到一个即时AI驱动的中心。从Slack、Google Drive和Notion等应用程序获取AI答案,每周节省5+小时。

Ragie 是一款完全托管的 RAG 即服务,为开发人员提供简单的 API 和应用程序连接器,通过快速准确的检索实现最先进的生成式 AI 应用程序。

Nuclia 是一个 Agentic RAG-as-a-Service 平台,可索引非结构化数据以驱动 AI 应用。从任何数据源获取 AI 搜索和生成式答案。

Vespa.ai是一个用于开发和运营大规模应用程序的AI搜索平台,它结合了大数据、向量搜索、机器学习排序和实时推理,从而支持实时AI应用程序。

Momen是一个无代码平台,允许非技术创始人构建具有集成AI代理的可用于生产的Web应用程序。可视化设计,扩展到数百万用户,并通过内置的SEO和Stripe集成实现盈利。

Toolhouse 是一个云基础设施,可为 LLM 提供操作和知识。只需 3 行代码即可构建和部署具有抓取工具、网络搜索等的 AI 代理。