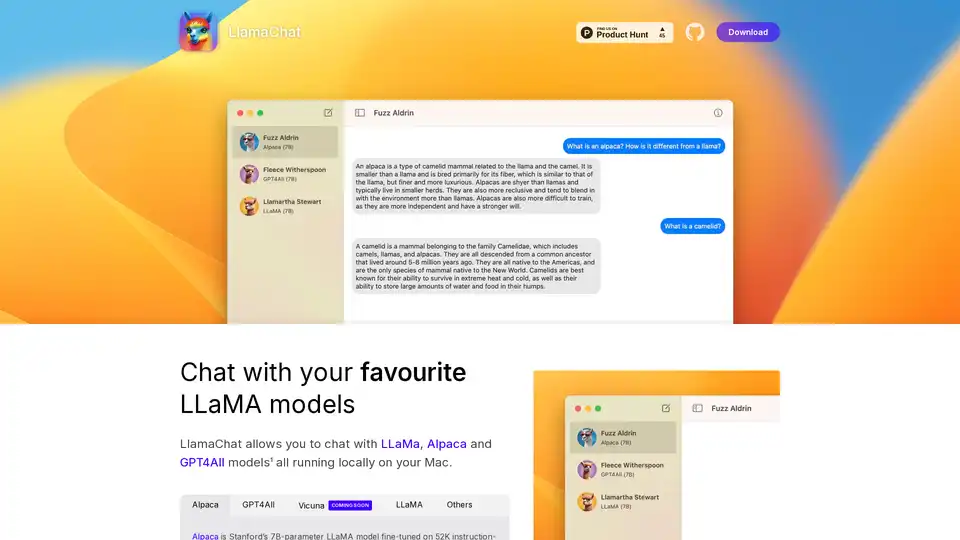

LlamaChat 概述

LlamaChat:在你的 Mac 上与本地 LLaMA 模型聊天

什么是 LlamaChat?LlamaChat 是一款 macOS 应用程序,使用户能够直接在他们的 Mac 上与各种大型语言模型 (LLM)(如 LLaMA、Alpaca 和 GPT4All)进行交互,而无需依赖基于云的服务。这意味着模型在本地运行,从而提供增强的隐私和控制。

主要特性和功能

- 本地 LLM 支持: LlamaChat 支持包括 LLaMA、Alpaca 和 GPT4All 在内的多个 LLM,所有这些都在你的 Mac 上本地运行。

- 模型转换: LlamaChat 可以导入原始 PyTorch 模型检查点或预转换的 .ggml 模型文件,以便于使用。

- 开源: 由 llama.cpp 和 llama.swift 等开源库提供支持,确保透明度和社区驱动的开发。

- 免费和开源: LlamaChat 是完全免费和开源的,确保可访问性和社区贡献。

支持的模型

- Alpaca: 斯坦福大学的 7B 参数 LLaMA 模型,在从 OpenAI 的 text-davinci-003 生成的 52K 指令跟随演示上进行了微调。

- GPT4All: 一个开源 LLM。

- Vicuna: 一个开源 LLM。

- LLaMA: Meta 的基础 LLM。

LlamaChat 如何工作?

LlamaChat 利用开源库直接在你的机器上运行 LLM。它使用 llama.cpp 和 llama.swift 构建。这允许你转换和导入原始 PyTorch 模型检查点或预转换的 .ggml 模型文件。

如何使用 LlamaChat?

- 下载: 从官方网站或使用

brew install --cask llamachat下载 LlamaChat。 - 安装: 在你的 macOS 13 或更高版本上安装该应用程序。

- 导入模型: 将你的 LLaMA、Alpaca 或 GPT4All 模型导入到应用程序中。

- 聊天: 开始与你最喜欢的 LLM 模型在本地聊天。

为什么选择 LlamaChat?

- 隐私: 在本地运行模型,而无需将数据发送到外部服务器。

- 控制: 完全控制使用的模型和数据。

- 成本效益: 无需订阅费或使用费。

- 开源: 受益于社区驱动的改进和透明度。

LlamaChat 适合谁?

LlamaChat 非常适合:

- 开发者: 在本地机器上试验 LLM。

- 研究人员: 进行研究而无需依赖外部服务。

- 注重隐私的用户: 希望保持其数据本地和私有的用户。

安装

可以通过以下方式安装 LlamaChat:

- 下载: 直接从项目的 GitHub 页面或 Product Hunt 下载。

- Homebrew: 使用命令

brew install --cask llamachat。

开源库

LlamaChat 基于以下内容构建:

- llama.cpp: 用于在 CPU 上高效推断 LLM。

- llama.swift: 为 LLM 提供原生 macOS 界面。

免责声明

LlamaChat 与 Meta Platforms, Inc.、Leland Stanford Junior University 或 Nomic AI, Inc. 没有关联。用户有责任按照其提供商规定的各自条款和条件获取和集成适当的模型文件。

"LlamaChat"的最佳替代工具

Private LLM 是一款适用于 iOS 和 macOS 的本地 AI 聊天机器人,可离线工作,让您的信息完全在设备上、安全且私密。 在 iPhone、iPad 和 Mac 上享受无审查的聊天。

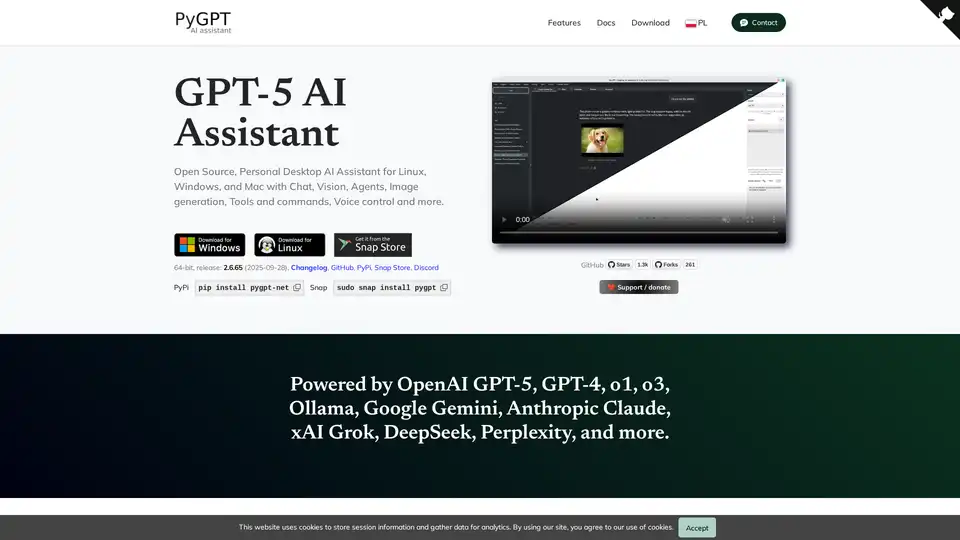

PyGPT 是一款免费的开源桌面 AI 助手,适用于 Windows、macOS 和 Linux。它提供聊天、视觉、代理、图像生成、语音控制等功能,由 GPT-5、GPT-4、Google Gemini 等模型提供支持。

Nexa SDK 实现了 LLM、多模态、ASR 和 TTS 模型的快速、私密的设备上 AI 推理。通过 NPU、GPU 和 CPU 在移动设备、PC、汽车和 IoT 设备上实现生产就绪的性能。

FridayGPT 是一款适用于 Mac 的 AI 助手,可即时访问 ChatGPT、Claude 和其他 LLM。功能包括 Whisper 驱动的语音转文本和一键式 AI 操作,从而提高工作效率。

Enclave AI 是一款注重隐私的 AI 助手,适用于 iOS 和 macOS,完全离线运行。它提供本地 LLM 处理、安全对话、语音聊天和文档交互,无需互联网连接。

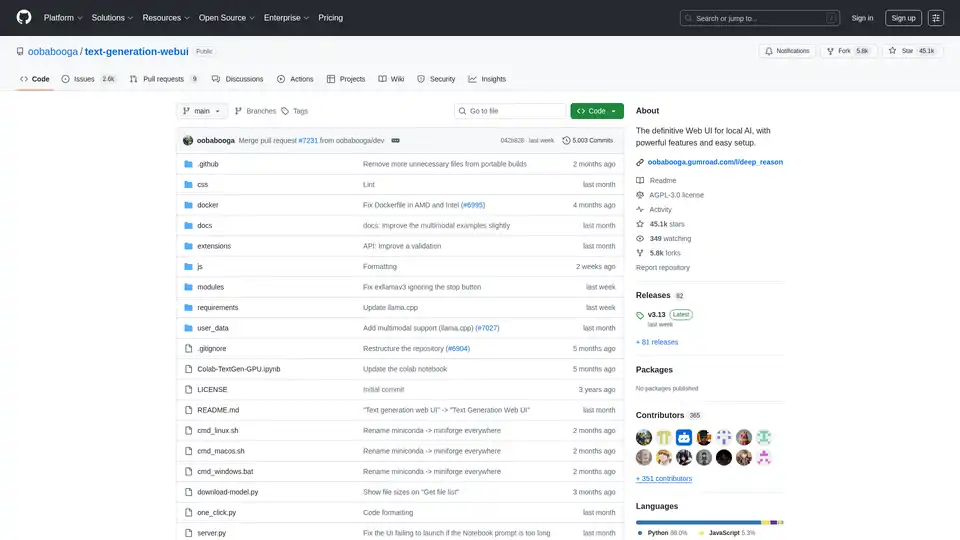

Text Generation Web UI是一个功能强大且用户友好的Gradio Web界面,适用于本地AI大型语言模型。支持多个后端、扩展,并提供离线隐私。

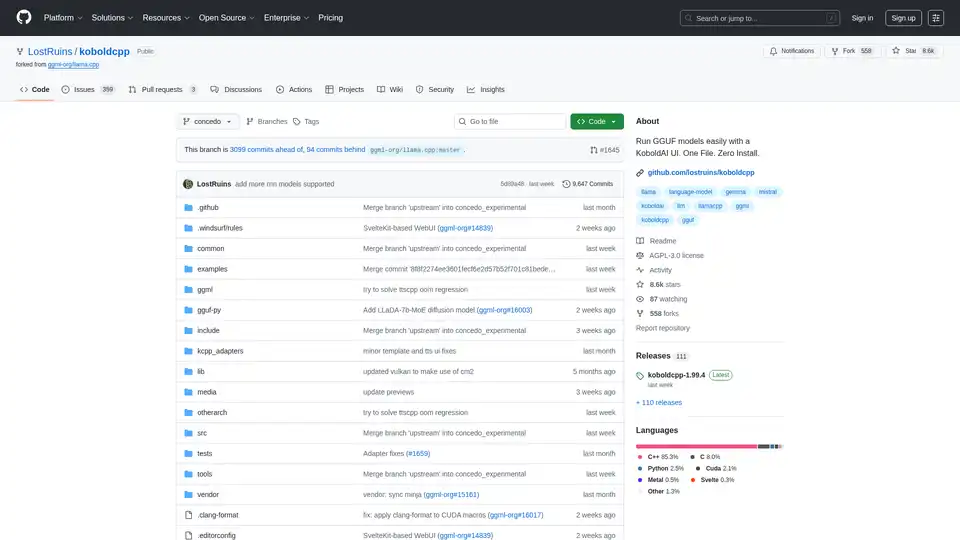

KoboldCpp:使用 KoboldAI UI 轻松运行 GGUF 模型,进行 AI 文本和图像生成。单文件,零安装。支持 CPU/GPU、语音转文本、文本转语音和 Stable Diffusion。

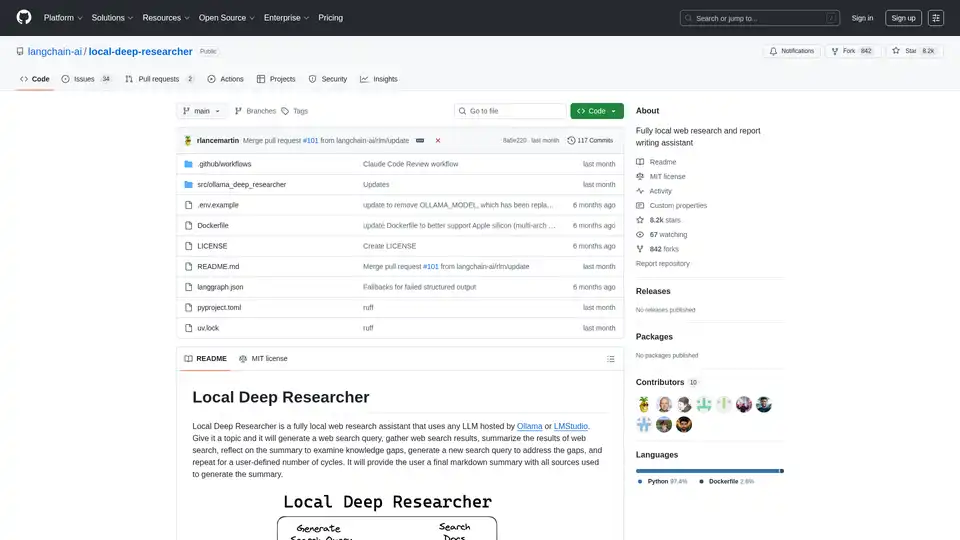

Local Deep Researcher是一个完全本地化的网络研究助手,通过Ollama或LMStudio使用LLM生成搜索查询、收集结果、总结发现并创建带有适当引用的全面研究报告。

Essential 是一款开源 MacOS 应用,作为屏幕 AI 共同飞行员,帮助开发者即时修复错误,并通过摘要和截图记住关键工作流程——数据永不离开设备。

GrammarBot是一款AI驱动的语法和拼写检查器,适用于MacOS,可离线工作。只需下载应用程序和AI模型一次,即可永久提高您的英语水平。个人许可证12美元。

AnythingLLM 是一款一体化人工智能应用程序,允许您与文档聊天、提高生产力,并在本地和私密地运行最先进的 LLM。利用人工智能代理和自定义模型,无需任何设置。

LM Studio: 在您的笔记本电脑上本地运行 LLaMa、MPT、Gemma 和其他 LLM。从 Hugging Face 下载兼容的模型并离线使用。

MacCopilot:macOS原生Copilot AI。使用GPT-4o、ClaudeAI和Google Gemini与任何屏幕内容互动。