Trainkore

Übersicht von Trainkore

Trainkore: Automatisieren Sie Prompts und sparen Sie 85 % der LLM-Kosten

Was ist Trainkore?

Trainkore ist eine Prompting- und RAG-Plattform (Retrieval Augmented Generation), die entwickelt wurde, um Prompts zu automatisieren, den Modellwechsel zu erleichtern und den Bewertungsprozess zu optimieren. Es hilft Unternehmen, bis zu 85 % der Kosten für Large Language Models (LLM) zu sparen.

Hauptmerkmale und Vorteile:

- Automatische Prompt-Generierung: Generieren Sie dynamisch Prompts für verschiedene Anwendungsfälle und optimieren Sie die Modellleistung.

- Modell-Router: Wählen Sie automatisch das kostenoptimierte Modell aus einem Dropdown-Menü aus, um eine höhere Leistung zu geringeren Kosten zu gewährleisten.

- Observability Suite: Gewinnen Sie Einblicke aus wichtigen Metriken und debuggen Sie mit detaillierten Protokollen.

- Prompt-Versionierung: Verwalten und iterieren Sie Prompts in Ihrer gesamten Organisation mit einem erstklassigen Playground.

- Integration: Funktioniert nahtlos mit OpenAI und anderen KI-Anbietern und ist nativ in Langchain, LlamaIndex und mehr integriert.

Wie man Trainkore benutzt:

- Integrieren: Integrieren Sie Trainkore einfach mit Node.js, Python oder Curl.

- Prompts erstellen: Verwenden Sie den interaktiven Playground, um Prompts zu verwalten und zu iterieren.

- Modelle auswählen: Wählen Sie aus einer Vielzahl von Modellen aus, darunter OpenAI, Gemini, Cohere, Anthropic und Azure.

- Automatisieren: Automatisieren Sie die Prozesse der Prompt-Generierung, des Modellwechsels und der Bewertung.

Warum ist Trainkore wichtig?

Trainkore ermöglicht es Fachexperten, die besten Prompt-Ingenieure zu werden, indem es ihnen die Werkzeuge an die Hand gibt, um ihre Benutzer zu verstehen und die KI-Leistung zu optimieren. Es bietet eine einheitliche Plattform für die Verwaltung von LLMs, iterativen Protokollen und Leistungsanalysen.

Erweiterte Steuerelemente:

- Automatische Prompt-Generierung für jedes Modell.

- Generieren Sie dynamisch Prompts für verschiedene Anwendungsfälle.

- Gewinnen Sie Einblicke aus den wichtigsten Metriken und debuggen Sie mit detaillierten Protokollen.

Wo kann ich Trainkore verwenden?

Trainkore kann in verschiedenen Anwendungen eingesetzt werden, darunter:

- Chatbots

- Inhaltsgenerierung

- Datenanalyse

- Kundendienst

Softwarestandard: LLMs in einer einheitlichen Plattform

Beim Aufbau guter KI geht es darum, Ihre Benutzer zu verstehen. Deshalb sind Fachexperten die besten Prompt-Ingenieure.

- Erstklassiger Playground - Verwalten und iterieren Sie Prompts in Ihrer gesamten Organisation.

- Alle Modelle - OpenAI, Anthropic, Llama2 und Ihre eigenen Modelle.

- Modellwechsel - Wechseln Sie automatisch zum besten Modell basierend auf Ihren Prompts.

- Iterative Protokolle und Leistungsanalyse - Erhalten Sie die Eingabe, Ausgabe, Bewertung, Prompts, Metadaten und vieles mehr

- Modellagnostische Vorlage für jedes Modell

Trainkore bietet eine leistungsstarke Plattform zur Optimierung der LLM-Leistung und zur Reduzierung der Kosten. Probieren Sie es noch heute aus, um Ihre Prompts zu automatisieren und Ihre KI-Workflows zu verbessern.

Beste Alternativwerkzeuge zu "Trainkore"

Parea AI ist eine KI-Experimentier- und Annotationsplattform, die Teams dabei unterstützt, LLM-Anwendungen zuverlässig auszuliefern. Sie bietet Funktionen für die Experimentverfolgung, Observability, Human Review und Prompt-Bereitstellung.

Zep ist eine Context-Engineering-Plattform zum Erstellen personalisierter KI-Agenten. Sie verfügt über Agentenspeicher, Graph RAG und automatisierte Kontextzusammenstellung, sodass sich Agenten wichtige Details merken und auf relevante Daten zugreifen können.

Parea AI ist die ultimative Experimentier- und Human-Annotationsplattform für AI-Teams, die nahtlose LLM-Bewertung, Prompt-Tests und Produktionsbereitstellung für zuverlässige AI-Anwendungen ermöglicht.

Klu ist eine LLM-App-Plattform der nächsten Generation, die Teams dabei unterstützt, LLM-basierte Anwendungen sicher zu iterieren, zu bewerten und zu optimieren. Arbeiten Sie gemeinsam an Prompts, verfolgen Sie Änderungen und iterieren Sie schnell mit Erkenntnissen.

BuildOwn.AI: Ein Entwicklerleitfaden zum Erstellen realer KI-Anwendungen mit großen Sprachmodellen (LLM).

Trainieren, verwalten und evaluieren Sie benutzerdefinierte große Sprachmodelle (LLMs) schnell und effizient auf Entry Point AI, ohne dass Code erforderlich ist.

Quixl: Die No-Code-KI-Agenten-Entwicklungsplattform ermöglicht es Unternehmen, Gen AI zu nutzen, um die Effizienz zu steigern und Abläufe zu transformieren.

Teammately ist der KI-Agent für KI-Ingenieure, der jeden Schritt beim Aufbau zuverlässiger KI in großem Maßstab automatisiert und beschleunigt. Bauen Sie schneller KI in Produktionsqualität mit Prompt-Generierung, RAG und Observabilität.

Erstellen Sie aufgabenorientierte benutzerdefinierte Agenten für Ihren Codebase, die Engineering-Aufgaben mit hoher Präzision ausführen, angetrieben durch Intelligenz und Kontext aus Ihren Daten. Erstellen Sie Agenten für Anwendungsfälle wie Systemdesign, Debugging, Integrationstests, Onboarding usw.

UsageGuard bietet eine einheitliche KI-Plattform für sicheren Zugriff auf LLMs von OpenAI, Anthropic und mehr, mit integrierten Schutzmaßnahmen, Kostoptimierung, Echtzeit-Überwachung und Enterprise-Sicherheit, um die KI-Entwicklung zu vereinfachen.

Allganize bietet sichere Enterprise AI-Lösungen mit fortschrittlicher LLM-Technologie, einschließlich agentischem RAG, No-Code AI-Buildern und On-Premise-Bereitstellung für Datenhoheit.

Lunary ist eine Open-Source-LLM-Engineering-Plattform, die Observability, Prompt-Management und Analysen für die Erstellung zuverlässiger KI-Anwendungen bietet. Es bietet Tools für das Debugging, die Leistungsverfolgung und die Gewährleistung der Datensicherheit.

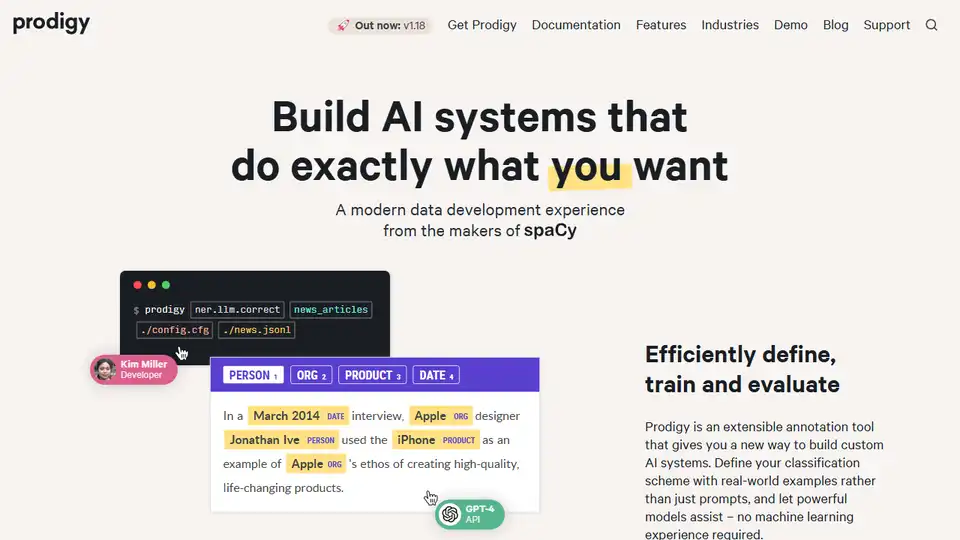

Prodigy: Ein herunterladbares Annotationswerkzeug für KI-, ML- und NLP-Aufgaben. Trainieren Sie Modelle mit realen Beispielen. Läuft lokal, volle Privatsphäre.

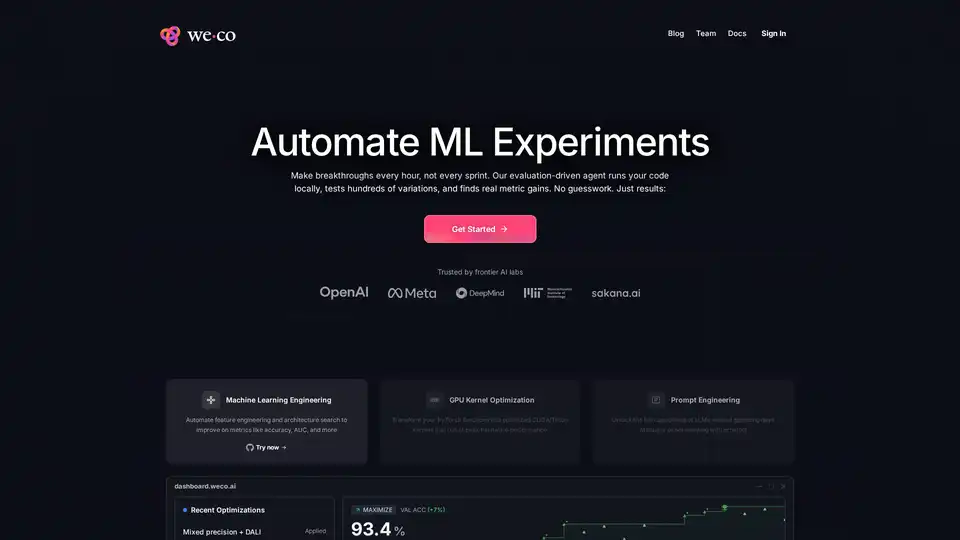

Weco AI automatisiert maschinelle Lern-Experimente mit AIDE ML-Technologie, optimiert ML-Pipelines durch KI-gestützte Codebewertung und systematische Experimente zur Verbesserung von Genauigkeits- und Leistungskennzahlen.