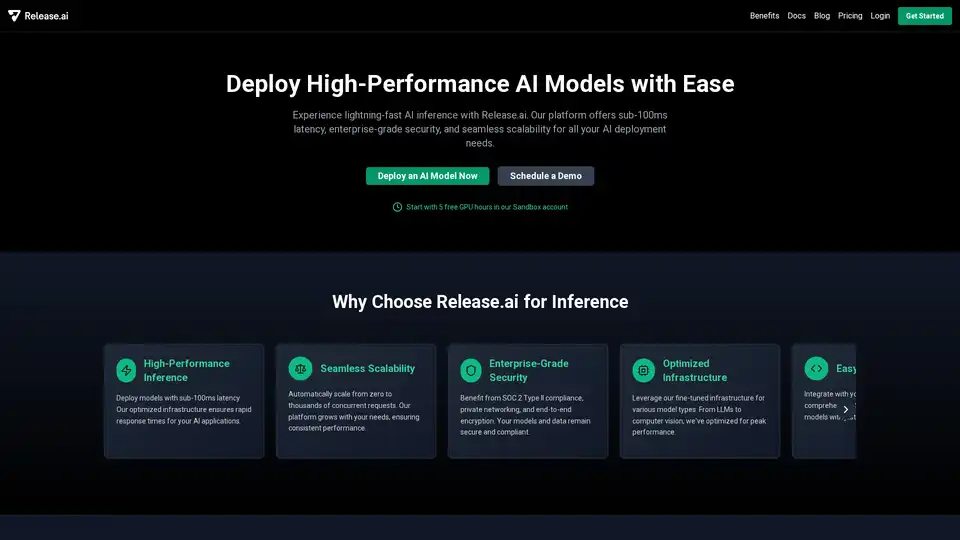

Release.ai 概述

什么是 Release.ai?

Release.ai 是一个旨在简化 AI 模型部署和管理的平台。它提供亚 100 毫秒延迟的高性能推理能力、企业级安全性和无缝的可扩展性,使开发人员可以更轻松地将 AI 集成到他们的应用程序中。

Release.ai 如何工作?

Release.ai 为各种 AI 模型类型(从大型语言模型 (LLM) 到计算机视觉模型)提供优化的基础设施。它允许用户使用全面的 SDK 和 API,只需几行代码即可快速部署模型。该平台自动扩展以处理数千个并发请求,同时确保一致的性能。

Release.ai 的主要特性:

- 高性能推理: 部署具有亚 100 毫秒延迟的模型,确保 AI 应用程序的快速响应时间。

- 无缝可扩展性: 自动从零扩展到数千个并发请求,以适应您的需求。

- 企业级安全性: 受益于 SOC 2 Type II 合规性、专用网络和端到端加密。

- 优化的基础设施: 利用针对 LLM、计算机视觉和其他模型类型进行微调的基础设施。

- 轻松集成: 使用全面的 SDK 和 API 与您现有的技术堆栈集成。

- 可靠的监控: 通过实时监控和详细的分析来跟踪模型性能。

- 经济高效的定价: 只为您使用的部分付费,定价随您的使用情况而变化。

- 专家支持: 从 ML 专家处获得帮助,以优化模型并解决问题。

为什么选择 Release.ai?

领先的公司选择 Release.ai 是因为其能够快速有效地部署 AI 模型。与其他平台不同,Release.ai 提供完全自动化的基础设施管理、企业级安全性和卓越的性能优化。

| Feature | Release.ai | Baseten.co |

|---|---|---|

| Model Deployment Time | Under 5 minutes | 15-30 minutes |

| Infrastructure Management | Fully automated | Partially automated |

| Performance Optimization | Sub-100ms latency | Variable latency |

| Security Features | Enterprise-grade (SOC 2 Type II compliant) | Standard |

| Scaling Capabilities | Automatic (zero to thousands of concurrent requests) | Manual configuration required |

如何使用 Release.ai?

- 注册: 创建一个 Release.ai 帐户以访问该平台。

- 部署模型: 使用 SDK 和 API,只需几行代码即可部署您的 AI 模型。

- 集成: 将部署的模型集成到您现有的应用程序中。

- 监控: 使用实时监控和分析来跟踪模型性能。

Release.ai 适合谁?

Release.ai 非常适合:

- 开发人员: 快速部署 AI 模型并将其集成到应用程序中。

- AI 工程师: 优化模型性能和可扩展性。

- 企业: 利用 AI 实现各种用例,并具有企业级安全性。

在 Release.ai 上探索 AI 模型

Release.ai 提供各种预训练的 AI 模型,您可以部署这些模型,包括:

- deepseek-r1: 推理模型,其性能与 OpenAI-o1 相当。

- olmo2: 在高达 5T tokens 上训练的模型,与 Llama 3.1 竞争。

- command-r7b: 用于在商品 GPU 上构建 AI 应用程序的高效模型。

- phi4: 来自 Microsoft 的最先进的开放模型。

- dolphin3: 用于编码、数学和一般用例的指令调整模型。

部署 AI 模型的最佳方式?

Release.ai 提供了一种简化的解决方案,用于部署具有高性能、安全性和可扩展性的 AI 模型。其优化的基础设施和易于集成的工具使其成为希望利用 AI 的开发人员和企业的首选。

Release.ai 的平台旨在通过其优化的部署平台提供高性能、安全且可扩展的 AI 推理。它以提供亚 100 毫秒延迟、企业级安全性和无缝可扩展性而著称,从而确保 AI 应用程序的快速响应时间和一致的性能。

Release.ai 针对各种模型类型进行了优化,包括 LLM 和计算机视觉,它提供全面的 SDK 和 API,只需几行代码即可实现快速部署。其功能包括实时监控和详细分析,用于跟踪模型性能,确保用户可以快速识别和解决问题。

凭借随使用量扩展的经济高效的定价,Release.ai 还提供专家支持,以帮助用户优化其模型并解决任何问题。该平台对企业级安全性、SOC 2 Type II 合规性、专用网络和端到端加密的承诺确保模型和数据保持安全和合规。

"Release.ai"的最佳替代工具

FriendliAI 是一个 AI 推理平台,为部署 AI 模型提供速度、规模和可靠性。 它支持 459,400 多个 Hugging Face 模型,提供定制优化,并确保 99.99% 的正常运行时间。

GPUX是一个无服务器GPU推理平台,可为StableDiffusionXL、ESRGAN和AlpacaLLM等AI模型实现1秒冷启动,具有优化的性能和P2P功能。

Fireworks AI 使用最先进的开源模型为生成式人工智能提供极快的推理。 免费微调和部署您自己的模型。 在全球范围内扩展 AI 工作负载。

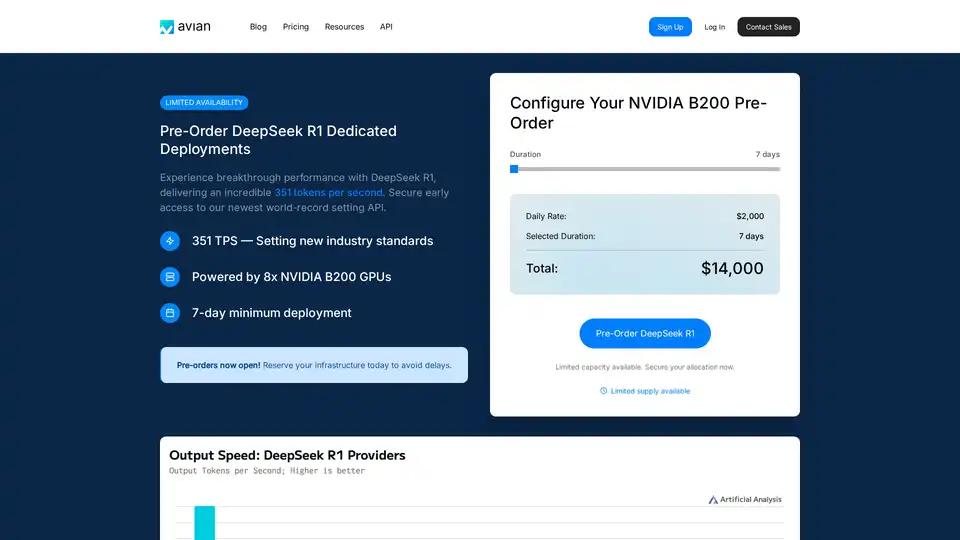

Avian API为开源LLM提供最快的AI推理,在DeepSeek R1上实现351 TPS。使用兼容OpenAI的API以3-10倍的速度部署任何HuggingFace LLM。企业级性能和隐私。

SaladCloud 提供经济高效、安全且社区驱动的分布式 GPU 云,用于 AI/ML 推理。节省高达 90% 的计算成本。非常适合 AI 推理、批量处理等。

Lightning AI是一个一体化云工作空间,旨在构建、部署和训练AI代理、数据和AI应用程序。只需一个订阅即可获得模型API、GPU训练和多云部署。

BrainHost VPS 提供高性能 KVM 虚拟服务器,配备 NVMe 存储,适用于 AI 推理、网站和电商。香港和美西 30 秒快速部署,确保可靠的全球访问。

Deep Infra 是一个低成本、可扩展的 AI 推理平台,支持 100 多个 ML 模型,如 DeepSeek-V3.2、Qwen 和 OCR 工具。提供开发者友好 API、GPU 租赁、零数据保留和美国安全基础设施,用于生产 AI 工作负载。

新一代企业级AI构建工作室,用于训练、验证、调优和部署AI模型。探索IBM watsonx.ai的集成工具,实现可扩展的生成式AI开发。