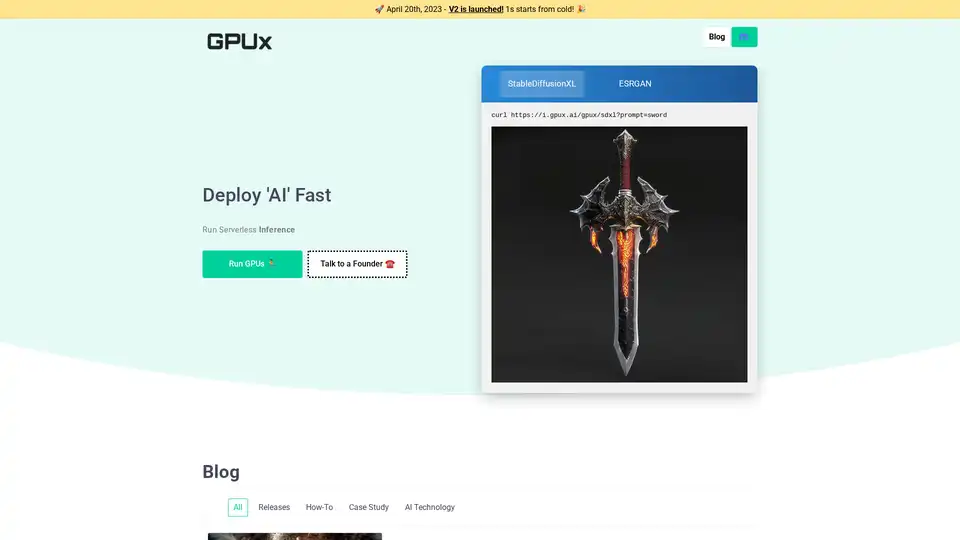

GPUX の概要

GPUXとは?

GPUXは、AIおよび機械学習ワークロードに特化して設計された最先端のサーバーレスGPU推論プラットフォームです。このプラットフォームは、前例のない1秒コールドスタート時間を提供することで、開発者や組織がAIモデルをデプロイおよび実行する方法を革新し、速度と応答性が重要な本番環境に最適です。

GPUXの仕組み

サーバーレスGPUインフラストラクチャ

GPUXはサーバーレスアーキテクチャで動作し、ユーザーが基盤インフラを管理する必要を排除します。プラットフォームはオンデマンドでGPUリソースを自動プロビジョニングし、手動介入なしで様々なワークロードをシームレスにスケーリングします。

コールドスタート最適化技術

プラットフォームの画期的な成果は、完全なアイドル状態から1秒コールドスタートを実現する能力です。これは、従来長い初期化時間に悩まされてきたAI推論ワークロードにとって特に重要です。

P2P機能

GPUXはピアツーピア技術を組み込んでおり、組織が独自のAIモデルを安全に共有し収益化できます。この機能により、モデル所有者は知的財産を完全にコントロールしながら、他の組織に推論リクエストを販売できます。

コア機能と能力

⚡ 高速推論

- 完全なアイドル状態からの1秒コールドスタート

- 人気AIモデルの最適化されたパフォーマンス

- 本番ワークロードの低レイテンシ応答時間

🎯 対応AIモデル

GPUXは現在、以下の主要AIモデルに対応しています:

- 画像生成のためのStableDiffusionおよびStableDiffusionXL

- 画像超解像と強化のためのESRGAN

- 自然言語処理のためのAlpacaLLM

- 音声認識と文字起こしのためのWhisper

🔧 技術的特長

- 永続的数据ストレージのための読み取り/書き込みボリューム

- 安全なモデル配布のためのP2Pモデル共有

- 簡単な統合のためのcurlベースのAPIアクセス

- クロスプラットフォーム互換性(Windows 10, Linux OS)

パフォーマンスベンチマーク

プラットフォームは顕著なパフォーマンス向上を示しており、特にStableDiffusionXLをRTX 4090ハードウェアで50%高速化します。この最適化は、GPUXが利用可能なハードウェアリソースから最大パフォーマンスを引き出す能力を示しています。

GPUXの使用方法

簡単なAPI統合

ユーザーは簡単なcurlコマンドでGPUXの機能にアクセスできます:

curl https://i.gpux.ai/gpux/sdxl?prompt=sword

この straightforwardなアプローチは複雑なセットアップ手順を排除し、既存のワークフローへの迅速な統合を可能にします。

デプロイメントオプション

- GPUXプラットフォームを通じたWebアプリケーションアクセス

- オープンソースコンポーネントを求める開発者のためのGitHub可用性

- 様々な操作環境のためのクロスプラットフォームサポート

ターゲットユーザーとユースケース

主要ユーザー

- 迅速なモデルデプロイメントを必要とするAI研究者

- 費用対効果の高いGPUリソースを必要とするスタートアップ

- 独自AIモデルの収益化を目指す企業

- 簡素化されたAI推論インフラを求める開発者

理想的なアプリケーション

- リアルタイム画像生成と操作

- 音声テキスト変換サービス

- 自然言語処理アプリケーション

- 研究開発プロトタイピング

- 信頼性の高い推論を必要とする本番AIサービス

GPUXを選ぶ理由

競争優位性

- 比類なきコールドスタート性能 - 1秒初期化

- サーバーレスアーキテクチャ - インフラ管理不要

- 収益化機会 - P2Pモデル共有機能

- ハードウェア最適化 - GPU利用率最大化

- 開発者フレンドリー - 簡単なAPI統合

ビジネス価値

GPUXは、専門靴が解剖学的差異に対処するのと同様に、AIワークロードのGPUリソース割り当ての根本的課題に対処します。プラットフォームは機械学習ワークロードに「適切な適合」を提供し、最適なパフォーマンスとコスト効率を保証します。

会社背景

GPUX Inc.はカナダのTorontoに本社を置き、分散型チームには以下が含まれます:

- Annie - マーケティング(Krakow拠点)

- Ivan - テクノロジー(Toronto拠点)

- Henry - オペレーション(Hefei拠点)

会社はAI技術、ケーススタディ、ハウツーガイド、リリースノートを含む技術トピックをカバーするアクティブなブログを維持しています。

はじめに

ユーザーは複数のチャネルでGPUXにアクセスできます:

- Webアプリケーション(現在V2利用可能)

- オープンソースコンポーネントのGitHubリポジトリ

- 創業チームとの直接連絡

プラットフォームは進化を続け、定期的な更新とパフォーマンス強化がリリースノートと技術ブログ投稿を通じて文書化されています。

GPUX関連タグ