Agent Cloud

Übersicht von Agent Cloud

Agent Cloud ist eingestellt und nicht mehr aktiv.

Was war Agent Cloud?

Agent Cloud war eine Open-Source-Plattform, die Unternehmen beim Aufbau und der Bereitstellung privater Large Language Model (LLM) Chat-Anwendungen unterstützen sollte. Sie ermöglichte es Teams, sicher mit ihren Daten zu interagieren und bot eine robuste Lösung für verschiedene KI-gesteuerte Anwendungen.

Hauptmerkmale und Funktionen:

- Datensynchronisation für Vektor-Datenbanken: Agent Cloud erleichterte die Erstellung von datenverbundenen Agenten mit Zugriff auf aktuelle Vektordaten für Retrieval Augmented Generation (RAG).

- Vielseitige Datenerfassung: Die Plattform unterstützte die Erfassung von Daten aus über 260 Quellen, darunter Dateien (PDF, DOCX, TXT, CSV) und Datenbanken (PostgreSQL, Snowflake, BigQuery), mit Optionen zur Auswahl bestimmter Tabellen und Spalten.

- Datenvorbereitung: Agent Cloud ermöglichte es Benutzern, Daten mit Anweisungen zu teilen, zu chunkieren und einzubetten, wobei Modelle wie OpenAI's

text-embedding-3-smalloder Open-Source-Alternativen wie BGE/base verwendet wurden. - Vektor-Datenspeicherung: Eingebettete Daten wurden in einer Vektor-Datenbank gespeichert, die wichtige Optionen wie Qdrant und Pinecone für selbst gehostete Deployments unterstützt.

- Geplante Datenaktualisierungen: Benutzer konnten die Häufigkeit der Datensynchronisation aus der Quelle festlegen, um über manuelle, geplante oder Cron-basierte Aktualisierungen Zugriff auf die neuesten Daten zu gewährleisten.

- LLM-agnostisches Design: Agent Cloud war LLM-agnostisch konzipiert, sodass Benutzer ihre eigenen Open-Source-Modelle verbinden oder OpenAI nutzen konnten. Selbstverwaltete Benutzer konnten sich für vollständige Privatsphäre mit lokal gehosteten Modellen verbinden.

Wie Agent Cloud funktionierte:

- Datenquellenauswahl: Benutzer wählten ihre Datenquellen aus einer Sammlung von Konnektoren aus, darunter Systeme wie Confluence oder direkte Datei-Uploads.

- Datenvorbereitung: Es wurden Anweisungen zur Aufteilung und Chunkierung von Daten bereitgestellt, mit Optionen zur Verwendung von OpenAI's

text-embedding-3-smalloder Open-Source-Modellen für die Einbettung. - Vektorspeicherung: Die Plattform speicherte die eingebetteten Daten in einer Vektor-Datenbank.

- Datensynchronisation: Benutzer legten eine Häufigkeit für die Synchronisierung von Daten aus der Quelle fest.

- Chat-Oberfläche: Agenten wurden mit der LLM-Auswahl des Benutzers erstellt, wodurch Chat-Sitzungen mit den synchronisierten Daten ermöglicht wurden.

Anwendungsfälle:

- Erstellung von RAG-Chat-Anwendungen: Agent Cloud ermöglichte die Erstellung von Chat-Anwendungen für die direkte Abfrage synchronisierter Daten über eine Chat-Oberfläche oder APIs.

- Private Dateninteraktion: Es ermöglichte Teams den sicheren Zugriff auf KI-Apps innerhalb ihrer Organisation und gewährleistete den Datenschutz, indem die Open-Source-App auf ihrer Infrastruktur bereitgestellt und LLMs On-Premise ausgeführt wurden.

Für wen war Agent Cloud gedacht?

Agent Cloud richtete sich an Entwickler und Ingenieure, die KI-Anwendungen für sich selbst und ihre Teams entwickeln wollten, und bot eine Plattform für die Erstellung von Einzelagenten-Chat-Apps, Mehragenten-Chat-Apps und Wissensabruf-Apps.

Agent Cloud wurde eingestellt, aber die Website bleibt zu Archivierungszwecken online.

Beste Alternativwerkzeuge zu "Agent Cloud"

Private LLM ist ein lokaler KI-Chatbot für iOS und macOS, der offline funktioniert und Ihre Informationen vollständig auf dem Gerät, sicher und privat hält. Genießen Sie unzensierte Chats auf Ihrem iPhone, iPad und Mac.

Joythee AI ist eine KI-Begleiter-App, die für fesselnde und erhebende Gespräche entwickelt wurde. Sie bietet Funktionen wie Multi-KI-Agenten-Chat, Inkognito-Modus, personalisierte Erlebnisse und kontinuierliche Updates.

Enclave AI ist ein datenschutzorientierter KI-Assistent für iOS und macOS, der vollständig offline läuft. Er bietet lokale LLM-Verarbeitung, sichere Konversationen, Voice-Chat und Dokumenteninteraktion, ohne dass eine Internetverbindung erforderlich ist.

AI Horde ist ein freiwilliger, gemeinschaftlich erstellter, verteilter Cluster für die KI-Bild- und Textgenerierung. Werden Sie Mitarbeiter oder nutzen Sie die API kostenlos!

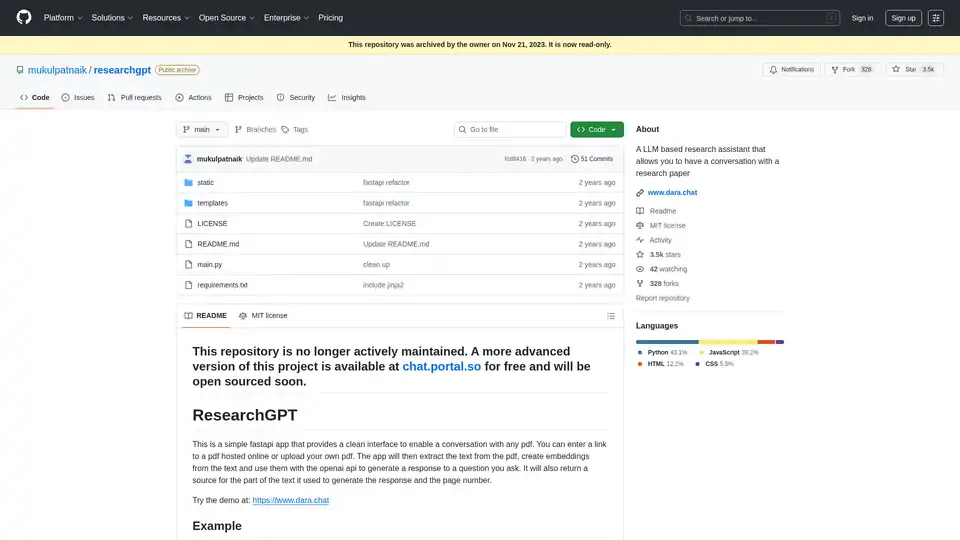

ResearchGPT ist ein Forschungsassistent, mit dem Sie sich mit Forschungsarbeiten unterhalten können. Es verwendet LLM und bietet eine übersichtliche Oberfläche zum Chatten mit jedem PDF.

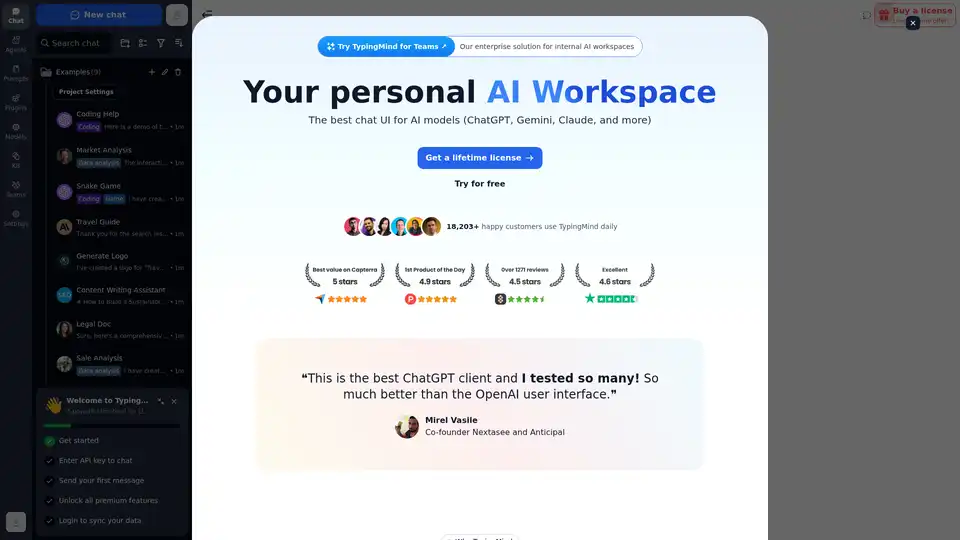

Chatten Sie mit KI unter Verwendung Ihrer API-Schlüssel. Zahlen Sie nur für das, was Sie nutzen. Unterstützt GPT-4, Gemini, Claude und andere LLMs. Die beste Chat-LLM-Frontend-OI für alle KI-Modelle.

Nutzen Sie Faune, um im Internet zu suchen, Bilder zu generieren und mit den weltweit führenden LLMs von OpenAI, Anthropic, Cohere.ai, MistralAI und mehr zu interagieren.

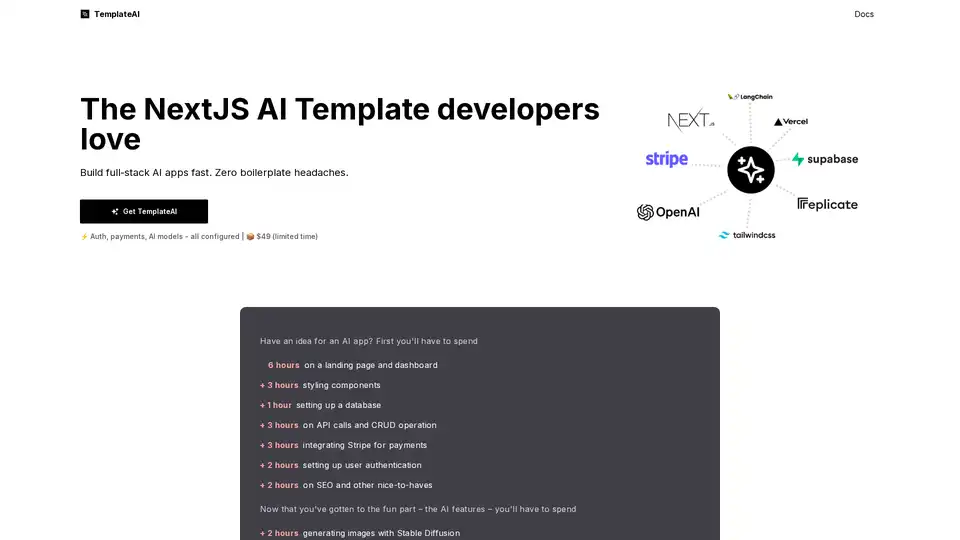

TemplateAI ist die führende NextJS-Vorlage für AI-Apps mit Supabase-Authentifizierung, Stripe-Zahlungen, OpenAI/Claude-Integration und einsatzbereiten AI-Komponenten für schnelle Full-Stack-Entwicklung.

LlamaChat ist eine macOS-App, mit der Sie lokal auf Ihrem Mac mit LLaMA-, Alpaca- und GPT4All-Modellen chatten können. Laden Sie es jetzt herunter und erleben Sie lokales LLM-Chatten!

Prompto ist eine Open-Source-Web-App, die die LLM-Interaktion über LangChain.js vereinfacht. Zu den Funktionen gehören mehrere LLMs, Temperaturregelung, Chat, Notebook, Vorlagen, Arena und Diskussionsmodi.

NaturalReader ist ein KI-Text-to-Speech-Tool, das natürliche KI-Stimmen für die Online-, mobile App-, kommerzielle und Bildungsnutzung bietet. Vertraut von 10 Millionen Nutzern. Beinhaltet LLM-mehrsprachige Stimmen und Stimmenklonierung.

Selene von Atla AI bietet präzise Beurteilungen der Leistung Ihrer KI-App. Entdecken Sie Open-Source-LLM-Judge-Modelle für branchenführende Genauigkeit und zuverlässige KI-Bewertung.

TemplateAI ist eine NextJS AI-Vorlage mit Supabase-Authentifizierung, Stripe-Zahlungen, OpenAI/Claude-Integration und produktionsbereiten KI-Komponenten. Erstellen Sie schnell Full-Stack-KI-Apps ohne Boilerplate.

LM Studio: Führen Sie LLaMa, MPT, Gemma und andere LLMs lokal auf Ihrem Laptop aus. Laden Sie kompatible Modelle von Hugging Face herunter und verwenden Sie sie offline.