Nebius

Übersicht von Nebius

Nebius: Die ultimative Cloud für AI-Innovatoren

Nebius wurde als die ultimative Cloud-Plattform für AI-Innovatoren konzipiert, mit dem Ziel, die AI-Infrastruktur zu demokratisieren und Entwickler weltweit zu stärken. Sie bietet eine umfassende Suite von Ressourcen und Diensten, um jede Phase des AI-Entwicklungslebenszyklus zu unterstützen.

Was ist Nebius?

Nebius ist eine Cloud-Plattform, die speziell für anspruchsvolle AI-Workloads entwickelt wurde. Sie integriert NVIDIA GPU-Beschleuniger mit vorkonfigurierten Treibern, hochleistungsfähigem InfiniBand und Orchestrierungswerkzeugen wie Kubernetes oder Slurm. Diese Kombination gewährleistet höchste Effizienz sowohl für das AI-Modelltraining als auch für die Inferenz in jeder Größenordnung.

Hauptmerkmale und Vorteile:

- Flexible Architektur: Nahtlose Skalierung von AI-Workloads von einer einzelnen GPU bis hin zu voroptimierten Clustern mit Tausenden von NVIDIA GPUs.

- Getestete Leistung: Entwickelt für anspruchsvolle AI-Workloads, um höchste Effizienz zu gewährleisten.

- Langfristiger Wert: Optimiert jede Schicht des Stacks für beispiellose Effizienz und erheblichen Kundennutzen.

- Neueste NVIDIA GPUs: Zugriff auf NVIDIA GB200 NVL72, HGX B200, H200, H100 und L40S GPUs, verbunden durch ein InfiniBand-Netzwerk mit bis zu 3,2 Tbit/s pro Host.

- Managed Services: Zuverlässige Bereitstellung von MLflow, PostgreSQL und Apache Spark ohne Wartungsaufwand.

- Cloud-Native-Erlebnis: Verwalten Sie die Infrastruktur als Code mit Terraform, API und CLI oder nutzen Sie die intuitive Konsole.

- Experten-Support: 24/7 Experten-Support und engagierte Unterstützung durch Lösungsarchitekten.

Wie funktioniert Nebius?

Nebius optimiert jede Schicht des AI-Stacks, um eine hochleistungsfähige Umgebung bereitzustellen. Dies beinhaltet:

- NVIDIA GPU-Integration: Verwendet NVIDIA GPU-Beschleuniger mit vorkonfigurierten Treibern.

- Hochleistungsfähige Vernetzung: Verwendet InfiniBand-Technologie, um eine schnelle Datenübertragung zu gewährleisten.

- Orchestrierungswerkzeuge: Nutzt Kubernetes und Slurm für effizientes Ressourcenmanagement.

Warum Nebius wählen?

Nebius bietet mehrere Vorteile gegenüber Wettbewerbern:

- Kosteneinsparungen: Verbesserte Kosteneinsparungen bei NVIDIA GPUs mit einer Abnahme von Hunderten von Einheiten für mindestens 3 Monate.

- Skalierbarkeit: Möglichkeit zur Skalierung von einer einzelnen GPU auf Tausende in einem Cluster.

- Zuverlässigkeit: Vollständig verwaltete Dienste gewährleisten eine zuverlässige Bereitstellung kritischer Tools und Frameworks.

Für wen ist Nebius geeignet?

Nebius ist ideal für:

- AI-Forscher und -Entwickler

- Machine-Learning-Ingenieure

- Data Scientists

- Organisationen, die eine skalierbare AI-Infrastruktur benötigen

Praktische Anwendungen und Anwendungsfälle:

Nebius hat maßgeblich zur Beschleunigung der AI-Innovation in verschiedenen Bereichen beigetragen:

- CRISPR-GPT (Gen-Editierung): Ermöglichte schnelles Modell-Screening und -Feintuning und verwandelte die Gen-Editierung in automatisierte Workflows.

- Shopify (E-Commerce): Bietet große GPU-Cluster für die AI-Modellentwicklung und verbessert so die Produktsuche und den Checkout-Prozess.

- vLLM (Open-Source LLM Inferenz): Optimierte die Inferenzleistung für Transformer-basierte Modelle mit hohem Durchsatz und nahtloser Skalierbarkeit.

- Brave Software (Websuche): Liefert AI-Zusammenfassungen in Echtzeit für Suchanfragen unter Beibehaltung der Datenschutzstandards.

- CentML Platform (AI-Bereitstellung): Optimiert Inferenzplattformen und bietet flexible Skalierung und verbesserte Hardwareauslastung.

- TheStage AI (Stable Diffusion): Reduziert GPU-Kosten durch DNN-Optimierungswerkzeuge.

- Recraft (AI-Design-Tool): Trainierte das erste generative AI-Modell für Designer von Grund auf.

- Wubble (Musikerstellung): Optimierte die Musikerstellung mit hochwertiger, lizenzfreier Musikgenerierung.

- Simulacra AI (Quantenchemie): Generiert hochpräzise Datensätze für Molekulardynamikmodelle.

- Quantori (Wirkstoffforschung): Entwickelt ein AI-Framework zur Generierung von Molekülen mit präzisen 3D-Formen.

Nebius AI Cloud vs. Nebius AI Studio

Nebius bietet zwei Hauptprodukte:

- AI Cloud: Bietet Self-Service-Zugriff auf die AI-Infrastruktur.

- AI Studio: Bietet eine verwaltete Umgebung für die AI-Entwicklung.

Preisgestaltung

Nebius bietet wettbewerbsfähige Preise für NVIDIA GPUs, einschließlich:

- NVIDIA B200 GPU

- NVIDIA H200 GPU

- NVIDIA H100 GPU

Zusammenfassend

Nebius zeichnet sich als robuste, flexible und kosteneffiziente Cloud-Plattform aus, die die AI-Innovation beschleunigen soll. Durch den Zugang zu modernsten NVIDIA GPUs, optimierter Infrastruktur und Experten-Support versetzt Nebius AI-Entwickler in die Lage, in verschiedenen Branchen bemerkenswerte Ergebnisse zu erzielen.

Beste Alternativwerkzeuge zu "Nebius"

Runpod ist eine KI-Cloud-Plattform, die die Erstellung und Bereitstellung von KI-Modellen vereinfacht. Bietet On-Demand-GPU-Ressourcen, serverlose Skalierung und Enterprise-Grade-Uptime für KI-Entwickler.

Mieten Sie mit Vast.ai kostengünstig Hochleistungs-GPUs. Stellen Sie sofort GPU-Mieten für KI, maschinelles Lernen, Deep Learning und Rendering bereit. Flexible Preise und schnelle Einrichtung.

Massed Compute bietet On-Demand-GPU- und CPU-Cloud-Computing-Infrastruktur für KI, maschinelles Lernen und Datenanalyse. Greifen Sie mit flexiblen und erschwinglichen Plänen auf hochleistungsfähige NVIDIA-GPUs zu.

Cirrascale AI Innovation Cloud beschleunigt die KI-Entwicklung, das Training und die Inferenz-Workloads. Testen und implementieren Sie auf führenden KI-Beschleunigern mit hohem Durchsatz und geringer Latenz.

AIStocks.io ist eine KI-gestützte Aktienforschungsplattform, die Echtzeit-Prognosen, automatisierte Trading-Signale und umfassende Risikomanagement-Tools für selbstbewusste Anlageentscheidungen bietet.

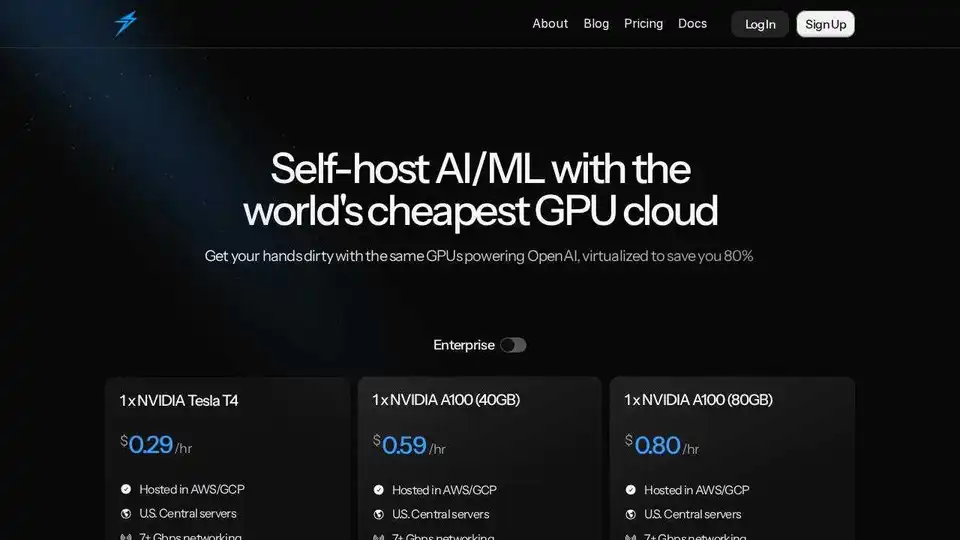

Thunder Compute ist eine GPU-Cloud-Plattform für KI/ML, die GPU-Instanzen mit einem Klick in VSCode zu Preisen anbietet, die 80 % niedriger sind als die der Konkurrenz. Perfekt für Forscher, Startups und Datenwissenschaftler.

Fluidstack ist eine führende KI-Cloud-Plattform, die sofortigen Zugriff auf Tausende von GPUs mit InfiniBand für KI-Training und Inferenz bietet. Sichere, hochleistungsfähige GPU-Cluster für Forschung, Unternehmen und souveräne KI-Initiativen.

SaladCloud bietet eine erschwingliche, sichere und Community-gesteuerte verteilte GPU-Cloud für KI/ML-Inferenz. Sparen Sie bis zu 90 % der Rechenkosten. Ideal für KI-Inferenz, Stapelverarbeitung und mehr.

Runpod ist eine All-in-One-KI-Cloud-Plattform, die das Erstellen und Bereitstellen von KI-Modellen vereinfacht. Trainieren, optimieren und stellen Sie KI mühelos mit leistungsstarker Rechenleistung und automatischer Skalierung bereit.

Novita AI bietet mehr als 200 Model-APIs, benutzerdefinierte Bereitstellung, GPU-Instanzen und serverlose GPUs. Skalieren Sie die KI, optimieren Sie die Leistung und innovieren Sie mühelos und effizient.

GreenNode bietet umfassende KI-fähige Infrastruktur und Cloud-Lösungen mit H100-GPUs ab 2,34 $/Stunde. Greifen Sie auf vorkonfigurierte Instanzen und eine Full-Stack-KI-Plattform für Ihre KI-Reise zu.

Modal: Serverlose Plattform für KI- und Datenteams. Führen Sie CPU-, GPU- und datenintensive Berechnungen mit Ihrem eigenen Code in großem Maßstab aus.

Vocareum bietet KI-Bildungslösungen mit Cloud-Labs, KI-Notebooks und KI-Gateways für praktisches Lernen und Forschung.

Phala Cloud bietet eine vertrauenswürdige Open-Source-Cloud-Infrastruktur für die Bereitstellung von KI-Agenten und Web3-Anwendungen, die von TEE unterstützt wird. Es gewährleistet Datenschutz, Skalierbarkeit und wird durch Code gesteuert.